Claude Opus 4.7, lanzado el 16 de abril de 2026, es una mejora significativa respecto a Opus 4.6 en programación, flujos de trabajo basados en agentes, visión y seguimiento de instrucciones. Logra +6.8pp en SWE-bench Verified (87.6% vs 80.8%), +10.9pp en SWE-bench Pro (64.3% vs 53.4%), +12pp en CursorBench (70% vs 58%), y ofrece una visión con 3.3× más resolución con bucles de autoverificación que reducen las alucinaciones en tareas largas. Los precios oficiales se mantienen idénticos ($5/$25 por millón de tokens), pero el esfuerzo bajo de 4.7 iguala la calidad del esfuerzo medio de 4.6, reduciendo los costos reales.

En CometAPI, obtienes ambos modelos (Claude Opus 4.7 y Opus 4.6) a $4 entrada / $20 salida con endpoints compatibles con OpenAI y cero bloqueo de proveedor. Actualiza si ejecutas agentes de programación en producción, análisis de documentos complejos o flujos de trabajo multi-sesión—4.7 es el nuevo valor por defecto para trabajo de vanguardia.

Claude Opus 4.7 vs Opus 4.6: Comparación rápida

Conclusión: Opus 4.7 se siente como “Opus 4.6 pero sin limitaciones y refinado”. Elimina limitaciones que ocasionalmente aparecían en 4.6 (p. ej., abandono prematuro de tareas, menor agudeza visual) y agrega eficiencia mediante razonamiento adaptativo. Los usuarios reportan que es más “opinativo” y colaborativo—como trabajar con un ingeniero senior que verifica su propio trabajo.

Por qué Claude Opus 4.7 importa en 2026

El 16 de abril de 2026, Anthropic lanzó discretamente su modelo más capaz de disponibilidad general hasta la fecha: Claude Opus 4.7. Pocas semanas después del restringido Mythos Preview (un potente enfoque cibernético), Opus 4.7 recupera la corona para cargas de trabajo en producción manteniendo exactamente el mismo precio que Opus 4.6.

Los desarrolladores y las empresas ya no necesitan vigilar las tareas de programación más difíciles. Los usuarios reportan delegar a 4.7 “las que antes requerían supervisión cercana” con confianza. El modelo ahora auto-verifica salidas, sigue instrucciones literalmente y mantiene ejecuciones agénticas de varias horas con menos errores de herramientas y mejor recuperación de errores.

El modelo destaca en:

- Tareas rigurosas y de larga duración con autoverificación incorporada (Plan → Ejecutar → Verificar → Informar).

- Seguimiento literal de instrucciones—no más interpretaciones laxas de “considera” o “podrías”.

- Visión sustancialmente mejor (hasta 2,576 px en el borde largo ≈ 3.75 MP, más de 3× la resolución previa).

- Mayor gusto y creatividad en entregables profesionales como interfaces, diapositivas y documentos.

- Mejor memoria del sistema de archivos para verdadera autonomía multi-sesión.

Las nuevas funciones incluyen un nivel de esfuerzo xhigh (entre high y max), presupuestos de tarea en la Platform API e integración con la herramienta Claude Design. El ID del modelo ahora es claude-opus-4-7. El precio no cambia oficialmente, pero las mejoras en eficiencia de tokens a menudo reducen el costo efectivo por tarea.

Mejoras de capacidades principales – Qué cambió realmente

Ingeniería de software avanzada y programación con agentes

Opus 4.7 destaca en los problemas más difíciles. En un benchmark interno de programación de 93 tareas, logró un aumento del 13% sobre 4.6, resolviendo cuatro tareas que ni 4.6 ni Sonnet 4.6 pudieron resolver. Rakuten-SWE-Bench mostró 3× más tareas de grado producción resueltas sin intervención humana. CursorBench (flujos reales de IDE) subió +12 puntos hasta 70%.

El benchmark interno de 93 tareas mostró un aumento del 13%, resolviendo cuatro tareas que ni 4.6 ni Sonnet 4.6 pudieron resolver. En flujos agénticos, Box reportó 2× menos llamadas al LLM (7.1 vs 16.3) y 30% menos uso de unidades de IA para el mismo resultado—traduciéndose directamente en ganancias de costo y latencia.

Por qué importa para desarrolladores: Ahora puedes confiar en Opus 4.7 para “el trabajo de programación más difícil” que antes necesitaba supervisión. Presta atención precisa a las instrucciones, verifica sus propias salidas y reutiliza memoria del sistema de archivos a través de sesiones—perfecto para refactorizaciones autónomas durante días.

Logros en el mundo real incluyen:

- Motor de texto a voz en Rust autónomo a partir de un solo prompt.

- Corrección de condiciones de carrera y errores de concurrencia que frustraron a modelos previos en Terminal-Bench 2.0 (+4.0 pp).

- Aumento del 10–15% en éxito de tareas de Factory Droids con ⅓ menos errores de herramientas.

- Mejoras de dos dígitos en calidad de código, calidad de pruebas y precisión de revisiones (CodeRabbit, Qodo).

El esfuerzo bajo de 4.7 ahora iguala la calidad del esfuerzo medio de 4.6, así que haces más con el mismo (o menor) gasto de tokens.

Salto en visión y multimodalidad

Esta es la mayor mejora individual. La resolución máxima de imagen salta de 1.15 MP (1568 px) a 3.75 MP (2576 px en el borde largo) — un aumento de 3.3× en píxeles con mapeo de coordenadas 1:1. No más cálculos de factor de escala para capturas de pantalla o diagramas.

Resultados:

- Benchmark de agudeza visual: 98.5% vs 54.5% en 4.6.

- CharXiv-R (sin herramientas): +13.4 pp; con herramientas: +13.6 pp.

- Habilita agentes de uso de computadora con precisión de píxel, análisis denso de capturas, análisis de estructuras químicas y revisión de UI/UX.

Flujos de trabajo con agentes, fiabilidad y seguimiento de instrucciones

Opus 4.7 introduce auto-verificación nativa—el modelo planifica, ejecuta, verifica y luego informa. Esto reduce drásticamente respuestas seguras pero incorrectas en tareas de largo horizonte. Las mejoras en la memoria del sistema de archivos permiten una verdadera autonomía de varios días.

El seguimiento de instrucciones es más estricto y literal. Los prompts ajustados al estilo más laxo de 4.6 pueden necesitar auditoría—frases como “considera” ahora se tratan como requisitos estrictos. Esto es una ventaja para trabajos de precisión, pero requiere migrar prompts.

Nota sobre regresiones: La recuperación de agujas en contextos largos (MRCR) cayó notablemente (p. ej., 91.9% → 59.2% en 256K). Anthropic señala que están eliminando estas pruebas sintéticas en favor de métricas GraphWalks aplicadas, donde la comprensión de código real sigue siendo sólida.

Nuevo nivel de esfuerzo xhigh + presupuestos de tarea

Opus 4.7 añade xhigh entre high y max para control granular. Claude Code ahora usa xhigh por defecto en los planes. El nuevo task_budget (beta pública) permite al modelo rastrear el total de tokens en todo un bucle agéntico y terminar elegantemente.

Seguimiento de instrucciones, auto-verificación y memoria

Opus 4.7 interpreta los prompts más literalmente — excelente para precisión, pero los prompts vagos antiguos pueden necesitar afinarse. Ahora diseña sus propios pasos de verificación (Plan → Ejecutar → Verificar → Informar) y reutiliza la memoria del sistema de archivos en trabajos multi-sesión mucho mejor que 4.6. Para equipos que construyen agentes persistentes, esta es una de las mejoras más útiles porque reduce reexplicar, recargar y replanificar.

Actualización del tokenizador

El nuevo tokenizador mejora la calidad pero puede consumir 1.0–1.35× más tokens (hasta +35%). El endpoint de conteo de tokens ahora devuelve números diferentes. Efecto neto: mayor calidad por tarea a menudo compensa el aumento, especialmente en niveles de esfuerzo bajos.

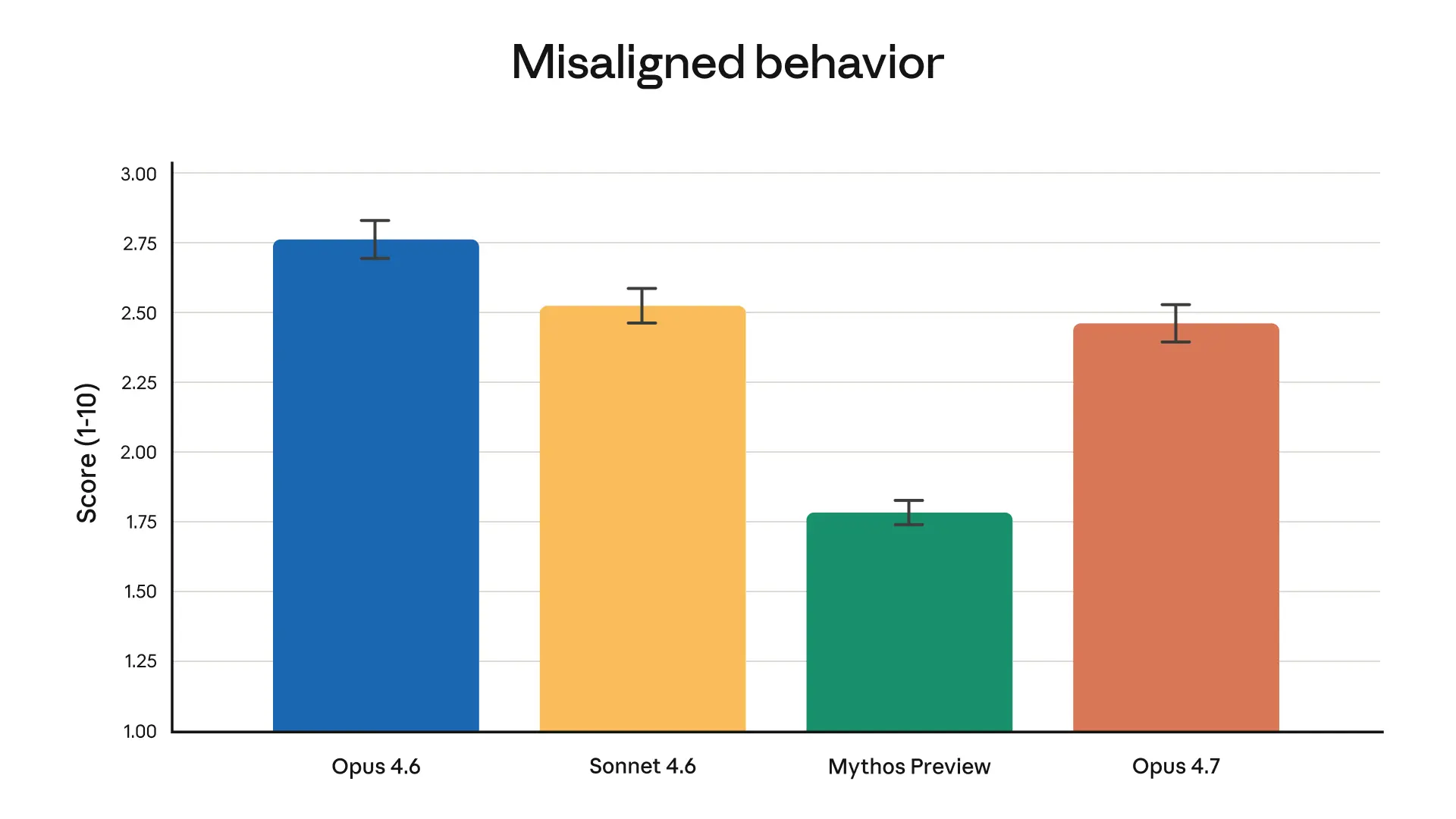

Seguridad, alineamiento y ciberseguridad

El perfil de seguridad es similar al de 4.6 (baja desalineación), con mejoras modestas en honestidad y resistencia a inyecciones de prompt.

Opus 4.7 incluye las protecciones de Project Glasswing: bloqueo en tiempo real de usos cibernéticos prohibidos/de alto riesgo. La puntuación de CyberGym se mantiene intencionalmente plana. El comportamiento desalineado mejora modestamente sobre 4.6. La ficha de sistema completa está disponible en el sitio de Anthropic.

Precios, eficiencia de tokens y ahorros con CometAPI

El precio oficial es idéntico, pero el costo efectivo por tarea baja porque el esfuerzo bajo en 4.7 ≈ calidad de esfuerzo medio en 4.6, y las mayores tasas de éxito significan menos reintentos. El nuevo tokenizador aumenta los tokens de entrada entre 0–35% para el mismo texto, pero el uso neto suele ser favorable a calidad igualada.

Ventaja de CometAPI: Accede a ambos modelos a $4 entrada / $20 salida por millón de tokens—20% más barato que el oficial—además de conmutación fluida entre 500+ modelos (GPT-5.4, Gemini 3.1, etc.) mediante un único endpoint compatible con OpenAI o Anthropic Messages. Sin tiempo de inactividad si los proveedores cambian precios. Cero bloqueo de proveedor. Pruebas en Playground y facturación unificada hacen la migración sin esfuerzo.

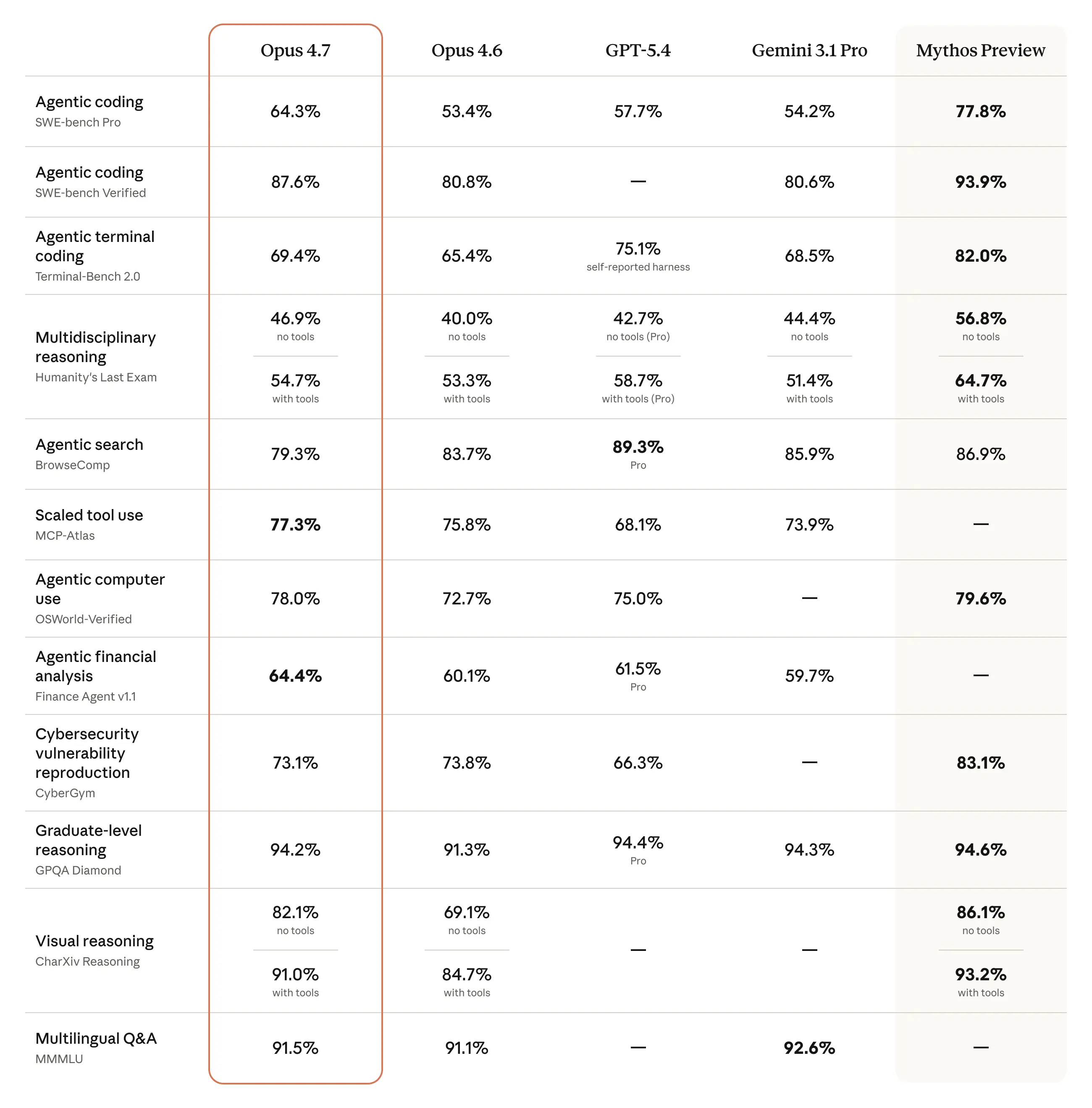

Análisis comparativo en profundidad lado a lado

Aquí está el enfrentamiento completo en 14 benchmarks de los datos de lanzamiento de Anthropic (verificados por socios):

Benchmarks de programación

- SWE-bench Verified: 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4% (+4.0 pp)

Uso de herramientas y flujos agénticos

- MCP-Atlas: 62.7% → 77.3% (+14.6 pp) — el mayor salto individual

- OSWorld-Verified: 72.7% → 78.0% (+5.3 pp)

- Finance Agent: 60.7% → 64.4% (+3.7 pp)

Razonamiento y conocimiento

- GPQA Diamond: 91.3% → 94.2% (+2.9 pp)

- HLE (sin herramientas): 40.0% → 46.9% (+6.9 pp)

- MMMLU: 91.1% → 91.5% (+0.4 pp)

Visión

- CharXiv-R (sin herramientas): 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (herramientas): 77.4% → 91.0% (+13.6 pp)

Regresiones (transparentes)

- BrowseComp: 84.0% → 79.3% (–4.7 pp) — sensible al arnés

- CyberGym: 73.8% → 73.1% (–0.7 pp) — intencional por seguridad

Benchmark interno de Research-Agent: 0.715 global (máxima puntuación empatada), con el módulo Finance subiendo de 0.767 a 0.813.

Rendimiento en el mundo real y casos de uso

Las pruebas de flujos agénticos de Box mostraron que Opus 4.7 completó tareas con 7.1 llamadas al LLM vs 16.3 para 4.6 (2.3× menos) y 30% menos uso de AI Unit. La latencia cayó de 242 s a 183 s en mediana.

Socios empresariales (Harvey, Databricks, Hebbia, Ramp, Genspark) reportan:

- 21% menos errores en razonamiento sobre documentos.

- Mejor coordinación multi-agente durante horas.

- Integración más ajustada de presentaciones, hojas de cálculo y código.

¿Quién debería actualizar de inmediato?

- Equipos de ingeniería de software que usan Cursor/Claude Code.

- Creadores de agentes de IA que necesitan autonomía fiable de largo horizonte.

- Flujos de trabajo intensivos en visión (capturas de pantalla, diagramas, revisión de UI).

- Automatización en finanzas, legal y trabajos de conocimiento.

Cambios de API, guía de migración y ejemplos de código

Cambios incompatibles (Messages API)

- Presupuestos extendidos de pensamiento eliminados → usa

thinking: {"type": "adaptive"}. - Parámetros de muestreo (

temperature, etc.) ya no se aceptan → usa prompting. - El contenido de pensamiento se omite por defecto.

- El nuevo tokenizador requiere margen en

max_tokens.

Guía de migración + ejemplos de código (CometAPI)

Paso 1: Actualiza el nombre del modelo a claude-opus-4-7 (o alias de CometAPI).

Paso 2: Audita los prompts para interpretación literal.

Paso 3: Prueba niveles de esfuerzo (comienza con xhigh para programación).

Paso 4: Usa presupuestos de tarea para limitar el gasto.

Aquí tienes un ejemplo en Python listo para ejecutar usando el endpoint compatible con Anthropic de CometAPI (también funciona con el SDK oficial):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Prompt de demostración de auto-verificación (funciona mucho mejor en 4.7):

(texto):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Ejecuta pruebas A/B en tus propias cargas de trabajo—la mayoría de equipos ve 20–40% menos iteraciones.

Nota:

Primero, el nuevo tokenizador genera más tokens a partir del mismo texto. Opus 4.7 introdujo un nuevo tokenizador que mejora cómo el modelo procesa texto. La contrapartida es que la misma entrada se mapeará a más tokens; el número exacto depende del tipo de contenido, pero está entre 1.0 y 1.35 veces.

En segundo lugar, niveles de esfuerzo más altos permiten una consideración más exhaustiva, especialmente en escenarios de agentes multi-turno.

Esto conduce a una mejor fiabilidad, pero también a más tokens de salida.

La solución oficial ofrece tres enfoques:

- Ajustar el nivel de esfuerzo usando el parámetro

efficiency - Limitar el presupuesto usando task budgets

- Indicar al modelo que “sea más conciso” en el prompt.

Limitaciones conocidas y notas de migración

- Extended thinking budgets removed → usa

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}ya no está soportado; usa pensamiento adaptativo en su lugar. - Sampling params (

temperature, etc.) no longer accepted → usa prompting.temperature,top_pytop_kdeben eliminarse de las solicitudes al migrar a Opus 4.7. - El modelo se describe como más literal y más directo que Opus 4.6, lo cual es útil para precisión pero puede requerir prompts más precisos.

- New tokenizer requires headroom in

max_tokens. Anthropic recomienda volver a comprobar el margen demax_tokensporque Opus 4.7 puede producir recuentos de tokens más altos para el mismo texto. - Thinking content omitted by default.

Veredicto final y recomendación

Claude Opus 4.7 es el claro ganador para cualquier carga de trabajo seria de programación, agentes o visión en 2026. Las ganancias no son incrementales — son transformadoras para producción. Si usas Opus 4.6, migra esta semana. La combinación de mayor calidad, menos llamadas y precio idéntico (o menor vía CometAPI) lo convierte en una elección obvia.

Pasos a seguir:

- Prueba 4.7 en el Playground de CometAPI con tus cargas de trabajo reales.

- Actualiza primero un servicio (Cursor o tu framework de agentes).

- Monitoriza el uso de tokens durante la primera semana.

- Escala con confianza sabiendo que tienes acceso unificado y más barato a más de 500 modelos.