a fecha del 15 de diciembre de 2025 los hechos públicos muestran que Google’s Gemini 3 Pro (preview) y OpenAI’s GPT-5.2 ambos establecen nuevas fronteras en razonamiento, multimodalidad y trabajo con contextos largos — pero adoptan rutas de ingeniería diferentes (Gemini → MoE disperso + contexto enorme; GPT-5.2 → diseños densos/de “enrutamiento”, compactación y modos de razonamiento xhigh) y, por tanto, intercambian victorias pico en benchmarks frente a predictibilidad de ingeniería, herramientas y ecosistema. Cuál es “mejor” depende de tu necesidad principal: las aplicaciones agénticas multimodales de contexto extremo se inclinan por Gemini 3 Pro; el tooling estable para desarrolladores empresariales, los costes predecibles y la disponibilidad inmediata de API favorecen GPT-5.2.

¿Qué es GPT-5.2 y cuáles son sus características principales?

GPT-5.2 es la versión del 11 de diciembre de 2025 de OpenAI en la familia GPT-5 (variantes: Instant, Thinking, Pro). Está posicionado como el modelo más capaz de la empresa para el “trabajo profesional del conocimiento”, optimizado para hojas de cálculo, presentaciones, razonamiento de contexto largo, llamadas a herramientas, generación de código y tareas de visión. OpenAI puso GPT-5.2 a disposición de usuarios de pago de ChatGPT y vía la API de OpenAI (Responses API / Chat Completions) bajo nombres de modelo como gpt-5.2, gpt-5.2-chat-latest y gpt-5.2-pro.

Variantes del modelo y uso previsto

- gpt-5.2 / GPT-5.2 (Thinking) — el mejor para razonamiento complejo y de múltiples pasos (la variante predeterminada “Thinking” usada en Responses API).

- gpt-5.2-chat-latest / Instant — menor latencia para uso cotidiano de asistente y chat.

- gpt-5.2-pro / Pro — máxima fidelidad/confiabilidad para los problemas más difíciles (cómputo adicional, admite

reasoning_effort: "xhigh").

Principales características técnicas (de cara al usuario)

- Mejoras en visión y multimodalidad — mejor razonamiento espacial en imágenes y comprensión de video mejorada cuando se combina con herramientas de código (herramienta de Python), además de soporte para herramientas estilo code-interpreter para ejecutar fragmentos.

- Esfuerzo de razonamiento configurable (

reasoning_effort: none|minimal|low|medium|high|xhigh) para intercambiar latencia/coste por profundidad.xhighes nuevo en GPT-5.2 (y está disponible en Pro). - Manejo mejorado de contexto largo y funciones de compactación para razonar a través de cientos de miles de tokens (OpenAI reporta métricas fuertes en MRCRv2 / contexto largo).

- Llamadas a herramientas avanzadas y flujos agénticos — mejor coordinación multi-turno, mejor orquestación de herramientas en una arquitectura de “megaagente único” (OpenAI destaca el rendimiento en herramientas de Tau2-bench).

¿Qué es Gemini 3 Pro Preview?

Gemini 3 Pro Preview es el modelo de IA generativa más avanzado de Google, lanzado como parte de la familia más amplia Gemini 3 en noviembre de 2025. El modelo está construido con énfasis en la comprensión multimodal — capaz de comprender y sintetizar texto, imágenes, video y audio — y cuenta con una gran ventana de contexto (~1 millón de tokens) para manejar documentos o bases de código extensos.

Google posiciona Gemini 3 Pro como líder en estado del arte en profundidad y matiz del razonamiento, y sirve como motor central para múltiples herramientas de desarrolladores y empresas, incluidas Google AI Studio, Vertex AI y plataformas de desarrollo agéntico como Google Antigravity.

Por ahora, Gemini 3 Pro está en preview — lo que significa que la funcionalidad y el acceso siguen ampliándose, pero el modelo ya obtiene altas puntuaciones en lógica, comprensión multimodal y flujos de trabajo agénticos.

Características técnicas y de producto clave

- Ventana de contexto: Gemini 3 Pro Preview admite una ventana de contexto de entrada de 1,000,000 tokens (y hasta 64k tokens de salida), lo que supone una ventaja práctica importante para ingerir documentos, libros o transcripciones de video extremadamente grandes en una sola solicitud.

- Funciones de API: parámetro

thinking_level(low/high) para intercambiar latencia y profundidad de razonamiento; configuracionesmedia_resolutionpara controlar la fidelidad multimodal y el uso de tokens; se admiten grounding de búsqueda, contexto de archivos/URL, ejecución de código y llamadas a funciones. Las firmas de pensamiento y el almacenamiento en caché de contexto ayudan a mantener el estado en flujos de múltiples llamadas. - Modo Deep Think / razonamiento superior: una opción “Deep Think” ofrece una pasada adicional de razonamiento para impulsar las puntuaciones en benchmarks difíciles. Google publica Deep Think como una ruta de alto rendimiento separada para problemas complejos.;

- Soporte multimodal nativo: entradas de texto, imagen, audio y video con grounding estrecho para búsqueda e integraciones de producto (se destacan puntuaciones en Video-MMMU y otros benchmarks multimodales).

Vista rápida — GPT-5.2 vs Gemini 3 Pro

Tabla comparativa compacta con los datos más importantes (fuentes citadas).

| Aspecto | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Proveedor / posicionamiento | OpenAI — actualización insignia GPT-5.x centrada en trabajo profesional del conocimiento, codificación y flujos agénticos. | Google DeepMind / Google AI — generación insignia de Gemini centrada en razonamiento multimodal con contexto ultra largo e integración de herramientas. |

| Sabores principales del modelo | Instant, Thinking, Pro (y cambio automático entre ellos). Pro añade mayor esfuerzo de razonamiento. | Familia Gemini 3, incluyendo Gemini 3 Pro y modos Deep-Think; enfoque multimodal/agéntico. |

| Ventana de contexto (entrada/salida) | ~400,000 tokens de capacidad total de entrada; hasta 128,000 tokens de salida/razonamiento (diseñado para documentos y bases de código muy largos). | Hasta ~1,000,000 tokens de entrada/ventana de contexto (1M) con salidas de hasta 64K tokens |

| Fortalezas / enfoque clave | Razonamiento de contexto largo, llamadas a herramientas agénticas, codificación, tareas estructuradas de oficina (hojas, presentaciones); actualizaciones de seguridad/ficha del sistema que enfatizan la confiabilidad. | Comprensión multimodal a escala, razonamiento + composición de imágenes, contexto muy grande + modo de razonamiento “Deep Think”, sólidas integraciones de herramientas en el ecosistema de Google. |

| Capacidades multimodales e imagen | Mejora en visión y grounding multimodal; ajustado para uso de herramientas y análisis de documentos. | Generación de imágenes de alta fidelidad + composición mejorada por razonamiento, edición de imágenes con múltiples referencias y renderizado de texto legible. |

| Latencia / interactividad | El proveedor enfatiza inferencia más rápida y mayor capacidad de respuesta (menor latencia que modelos GPT-5.x previos); múltiples niveles (Instant / Thinking / Pro). | Google enfatiza “Flash”/serving optimizados y velocidades interactivas comparables para muchos flujos; el modo Deep Think intercambia latencia por razonamiento más profundo. |

| Funciones/diferenciadores notables | Niveles de esfuerzo de razonamiento (medium/high/xhigh), llamadas a herramientas mejoradas, generación de código de alta calidad, alta eficiencia de tokens para flujos empresariales. | Contexto de 1M tokens, potente ingestión multimodal nativa (video/audio), modo de razonamiento “Deep Think”, integraciones estrechas con productos de Google (Docs/Drive/NotebookLM). |

| Usos típicos (corto) | Análisis de documentos largos, flujos agénticos, proyectos de codificación complejos, automatización empresarial (hojas/informes). | Proyectos multimodales extremadamente grandes, flujos agénticos de largo horizonte que necesitan contexto de 1M tokens, canalizaciones avanzadas de imagen + razonamiento. |

¿Cómo se comparan arquitectónicamente GPT-5.2 y Gemini 3 Pro?

Arquitectura central

- Benchmarks / evaluaciones de trabajo real: GPT-5.2 Thinking logró 70.9% de victorias/empates en GDPval (evaluación de trabajo del conocimiento con 44 ocupaciones) y grandes mejoras en benchmarks de ingeniería y matemáticas frente a variantes GPT-5 previas. Mejoras importantes en codificación (SWE-Bench Pro) y QA científico de dominio (GPQA Diamond).

- Herramientas y agentes: sólido soporte integrado para llamadas a herramientas, ejecución de Python y flujos agénticos (búsqueda de documentos, análisis de archivos, agentes de ciencia de datos). 11x de velocidad / <1% de coste frente a expertos humanos para algunas tareas de GDPval (medida de valor económico potencial, 70.9% vs. ~38.8% previo), y muestra ganancias concretas en modelado de hojas (p. ej., +9.3% en una tarea de analista junior de banca de inversión vs GPT-5.1).

- Gemini 3 Pro: Transformer de Mezcla de Expertos Dispersa (MoE). El modelo activa un pequeño conjunto de expertos por token, lo que permite una capacidad de parámetros total extremadamente grande con cómputo por token sublineal. Google publica una ficha del modelo que aclara que el diseño de MoE disperso es un contribuyente clave al perfil de rendimiento mejorado. Esta arquitectura hace viable impulsar la capacidad del modelo mucho más alto sin coste de inferencia lineal.

- GPT-5.2 (OpenAI): OpenAI continúa usando arquitecturas basadas en Transformer con estrategias de enrutamiento/compactación en la familia GPT-5 (un “router” activa distintos modos — Instant vs Thinking — y la compañía documenta técnicas de compactación y gestión de tokens para contextos largos). GPT-5.2 enfatiza el entrenamiento y evaluación para “pensar antes de responder” y la compactación para tareas de horizonte largo en lugar de anunciar un MoE disperso clásico a escala.

Implicaciones de las arquitecturas

- Intercambios de latencia y coste: los modelos MoE como Gemini 3 Pro pueden ofrecer mayor capacidad pico por token manteniendo un coste de inferencia inferior para muchas tareas porque solo se ejecuta un subconjunto de expertos. Sin embargo, pueden añadir complejidad al servicio y la programación (equilibrio de expertos en cold start, E/S). El enfoque de GPT-5.2 (denso/enrutado con compactación) favorece latencia predecible y ergonomía para desarrolladores — especialmente cuando se integra en las herramientas establecidas de OpenAI como Responses, Realtime, Assistants y APIs por lotes.

- Escalado de contexto largo: la capacidad de entrada de 1M tokens de Gemini te permite alimentar nativamente documentos extremadamente largos y flujos multimodales. El contexto combinado de ~400k de GPT-5.2 (entrada+salida) sigue siendo enorme y cubre la mayoría de necesidades empresariales, pero es menor que la especificación de 1M de Gemini. Para corpus muy grandes o transcripciones de video de varias horas, la especificación de Gemini ofrece una ventaja técnica clara.

Tooling, agentes e infraestructura multimodal

- OpenAI: integración profunda para llamadas a herramientas, ejecución de Python, modos de razonamiento “Pro” y ecosistemas de agentes de pago (ChatGPT Agents / integraciones de herramientas empresariales). Fuerte enfoque en flujos centrados en código y generación de hojas/diapositivas como salidas de primera clase.

- Google / Gemini: grounding integrado a Google Search (función opcional de pago), ejecución de código, contexto de URL y archivos, y controles explícitos de resolución de medios para intercambiar tokens por fidelidad visual. La API ofrece

thinking_levely otros ajustes para modular coste/latencia/calidad.

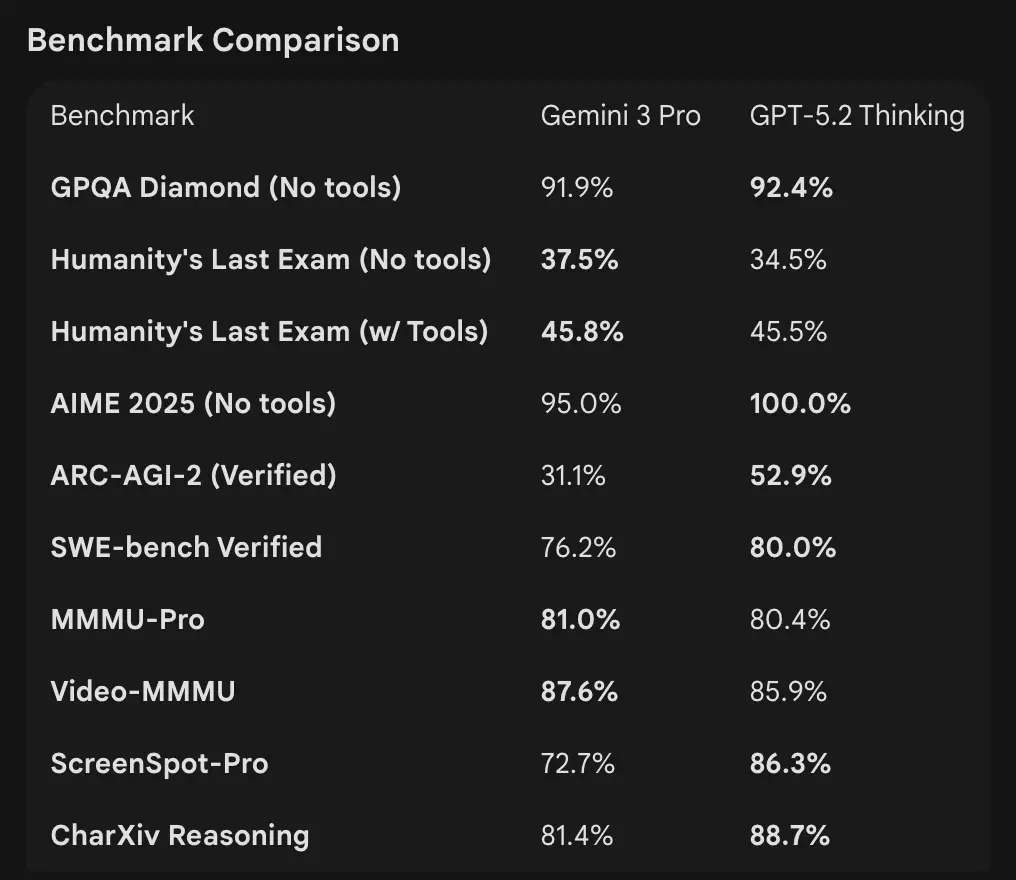

¿Cómo se comparan los números de benchmark?

Ventanas de contexto y manejo de tokens

- Gemini 3 Pro Preview: 1,000,000 tokens de entrada / 64k tokens de salida (ficha de modelo de Pro preview). Knowledge cutoff: January 2025 (Google).

- GPT-5.2: OpenAI demuestra un sólido rendimiento en contexto largo (puntuaciones MRCRv2 en tareas de aguja en pajar de 4k–256k con rangos >85–95% en muchos ajustes) y usa funciones de compactación; los ejemplos públicos de contexto de OpenAI indican un rendimiento robusto incluso en contextos muy grandes, pero OpenAI lista ventanas específicas por variante (y enfatiza la compactación en lugar de un único número de 1M). Para uso de API, los nombres de modelo son

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro.

Benchmarks de razonamiento y agénticos

- OpenAI (selección): Tau2-bench Telecom 98.7% (GPT-5.2 Thinking), fuertes ganancias en uso de herramientas de múltiples pasos y tareas agénticas (OpenAI destaca la consolidación de sistemas multiagente en un “megaagente”). GPQA Diamond y ARC-AGI mostraron incrementos respecto a GPT-5.1.

- Google (selección): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81%, Video-MMMU 87.6%, alta puntuación en GPQA y Humanity’s Last Exam; Google también demuestra planificación de largo horizonte mediante ejemplos agénticos.

Tooling y agentes:

GPT-5.2: Sólido soporte integrado para llamadas a herramientas, ejecución de Python y flujos agénticos (búsqueda de documentos, análisis de archivos, agentes de ciencia de datos). 11x de velocidad / <1% de coste vs expertos humanos para algunas tareas de GDPval (medida de valor económico potencial, 70.9% vs. ~38.8% previo), y muestra ganancias concretas en modelado de hojas (p. ej., +9.3% en una tarea de analista junior de banca de inversión vs GPT-5.1).

Interpretación: los benchmarks son complementarios — OpenAI enfatiza benchmarks de trabajo del conocimiento del mundo real (GDPval) que muestran que GPT-5.2 destaca en tareas de producción como hojas de cálculo, diapositivas y secuencias agénticas largas. Google enfatiza los rankings de razonamiento en bruto y ventanas de contexto de solicitud única extremadamente grandes. Qué importa más depende de tu carga de trabajo: las canalizaciones empresariales agénticas y de documentos largos favorecen el rendimiento probado de GPT-5.2 en GDPval; la ingestión de contexto masivo (p. ej., corpus de video completos/libros enteros en una pasada) favorece la ventana de entrada de 1M de Gemini.

¿Cómo se comparan las capacidades multimodales?

Entradas y salidas

- Gemini 3 Pro Preview: admite entradas de texto, imagen, video, audio, PDF y salidas de texto; Google proporciona controles granulares de

media_resolutiony un parámetrothinking_levelpara ajustar el coste frente a la fidelidad en el trabajo multimodal. Límite de tokens de salida 64k; entrada hasta 1M tokens. - GPT-5.2: admite flujos de trabajo de visión y multimodales enriquecidos; OpenAI destaca mejor razonamiento espacial (etiquetas estimadas de componentes de imagen con delimitación), comprensión de video (puntuaciones Video MMMU) y visión habilitada por herramientas (la herramienta de Python en tareas de visión mejora las puntuaciones). GPT-5.2 enfatiza que las tareas complejas de visión + código se benefician mucho cuando está habilitado el soporte de herramientas (ejecución de código Python).

Diferencias prácticas

Granularidad vs. amplitud: Gemini expone un conjunto de controles multimodales (media_resolution, thinking_level) orientados a permitir que los desarrolladores ajusten los intercambios por tipo de medio. GPT-5.2 enfatiza el uso integrado de herramientas (ejecutar Python en el bucle) para combinar visión, código y tareas de transformación de datos. Si tu caso de uso implica análisis intensivo de video + imagen con contextos extremadamente grandes, la afirmación de 1M de contexto de Gemini es convincente; si tus flujos requieren ejecutar código en el bucle (transformaciones de datos, generación de hojas), el tooling de código y la afinidad agéntica de GPT-5.2 pueden ser más convenientes.

¿Qué hay del acceso a API, SDKs y precios?

OpenAI GPT-5.2 (API y precios)

- API:

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-provía Responses API / Chat Completions. SDKs consolidados (Python/JS), guías “cookbook” y un ecosistema maduro. - Precios (público): $1.75 / 1M tokens de entrada y $14 / 1M tokens de salida; descuentos por caché (90% para entradas en caché) reducen el coste efectivo para datos repetidos. OpenAI enfatiza la eficiencia de tokens (precio por token más alto pero menor coste total para alcanzar un umbral de calidad).

Gemini 3 Pro Preview (API y precios)

- API:

gemini-3-pro-previewvía Google GenAI SDK y endpoints de Vertex AI/GenerativeLanguage. Nuevos parámetros (thinking_level,media_resolution) e integración con groundings y herramientas de Google. - Precios (preview público): aproximadamente $2 / 1M tokens de entrada y $12 / 1M tokens de salida para niveles de preview por debajo de 200k tokens; pueden aplicarse cargos adicionales por Search grounding, Maps u otros servicios de Google (la facturación de Search grounding comienza el 5 de enero de 2026).

Usa GPT-5.2 y Gemini 3 vía CometAPI

CometAPI es una puerta de enlace/API agregadora: un único endpoint REST con formato tipo OpenAI que te da acceso unificado a cientos de modelos de muchos proveedores (LLMs, modelos de imagen/video, embeddings, etc.). En lugar de integrar muchos SDKs de proveedores, CometAPI busca permitirte llamar a endpoints con formato OpenAI (chat/completions/embeddings/images) mientras cambias de modelo o proveedor bajo el capó.

Los desarrolladores pueden disfrutar de modelos insignia de dos empresas diferentes simultáneamente vía CometAPI sin cambiar de proveedor, y los precios de la API son más asequibles, generalmente con un 20% de descuento.

Ejemplo: fragmentos rápidos de API (copiar y pegar para probar)

A continuación hay ejemplos mínimos que puedes ejecutar. Reflejan los quickstarts publicados por los proveedores (OpenAI Responses API + cliente de Google GenAI). Sustituye $OPENAI_API_KEY / $GEMINI_API_KEY por tus claves.

GPT-5.2 — Python (OpenAI Responses API, reasoning configurado en xhigh para problemas profundos)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

Notas: reasoning.effort te permite intercambiar coste por profundidad. Usa gpt-5.2-chat-latest para estilo de chat Instant. La documentación de OpenAI muestra ejemplos para responses.create.

GPT-5.2 — curl (simple)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(Inspecciona el JSON para output_text o salidas estructuradas.)

Gemini 3 Pro Preview — Python (cliente de Google GenAI)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Notas: thinking_level controla la deliberación interna del modelo; media_resolution puede configurarse para imágenes/videos. Los ejemplos REST y JS están en la guía de desarrollo de Gemini de Google.;

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

La documentación de Google incluye ejemplos multimodales (imagen con datos inline, media_resolution).

¿Qué modelo es “mejor”? — guía práctica

No hay un “ganador” único; en su lugar elige según el caso de uso y las restricciones. A continuación una breve matriz de decisión.

Elige GPT-5.2 si:

- Necesitas integración estrecha con herramientas de ejecución de código (ecosistema de intérprete/herramientas de OpenAI) para canalizaciones programáticas de datos, generación de hojas de cálculo o flujos de código agénticos. OpenAI destaca mejoras en la herramienta de Python y el uso de un megaagente único.

- Priorizas la eficiencia de tokens según lo que afirma el proveedor y quieres precios por token de OpenAI explícitos y predecibles con grandes descuentos en entradas en caché (ayuda en flujos por lotes/producción).

- Quieres el ecosistema de OpenAI (integración con el producto ChatGPT, alianzas con Azure/Microsoft y tooling alrededor de Responses API y Codex).

Elige Gemini 3 Pro si:

- Necesitas entrada multimodal extrema (video + imágenes + audio + pdfs) y quieres un único modelo que acepte nativamente todas estas entradas con una ventana de entrada de 1,000,000 tokens. Google lo comercializa explícitamente para videos largos, canalizaciones grandes de documentos + video y casos de uso interactivos de Search/AI Mode.&

- Estás construyendo sobre Google Cloud / Vertex AI y deseas integración estrecha con grounding de búsqueda de Google, aprovisionamiento en Vertex y las APIs del cliente GenAI. Te beneficiarás de las integraciones de producto de Google (Search AI Mode, AI Studio, tooling agéntico Antigravity).

Conclusión: ¿Cuál es mejor en 2026?

En el enfrentamiento GPT-5.2 vs. Gemini 3 Pro Preview, la respuesta es dependiente del contexto:

- GPT-5.2 lidera en trabajo profesional del conocimiento, profundidad analítica y flujos estructurados.

- Gemini 3 Pro Preview sobresale en comprensión multimodal, ecosistemas integrados y tareas de gran contexto.

Ningún modelo es universalmente “mejor”; sus fortalezas complementan demandas reales distintas. Los adoptantes inteligentes deben ajustar la elección del modelo a casos de uso específicos, restricciones de presupuesto y alineación con el ecosistema.

Lo que está claro en 2026 es que la frontera de la IA ha avanzado significativamente, y tanto GPT-5.2 como Gemini 3 Pro están empujando los límites de lo que los sistemas inteligentes pueden lograr en la empresa y más allá.

Si quieres probar ahora mismo, explora las capacidades de GPT-5.2 y Gemini 3 Pro de CometAPI en el Playground y consulta la guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y obtenido la clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar?→ Prueba gratuita de GPT-5.2 y Gemini 3 Pro !

Si quieres