GPT-5.2 es la versión puntual de diciembre de 2025 de OpenAI dentro de la familia GPT-5: una familia insignia de modelos multimodales (texto + visión + herramientas) ajustada para el trabajo profesional del conocimiento, razonamiento de largo contexto, uso agente de herramientas y la ingeniería de software. OpenAI posiciona a GPT-5.2 como el modelo más capaz de la serie GPT-5 hasta la fecha y afirma que se desarrolló con énfasis en un razonamiento multiepásico confiable, manejo de documentos muy grandes y mayor seguridad/conformidad con políticas; el lanzamiento incluye tres variantes orientadas al usuario — Instant, Thinking y Pro — y se está desplegando primero para suscriptores de pago de ChatGPT y clientes de la API.

¿Qué es GPT-5.2 y por qué importa?

GPT-5.2 es el miembro más reciente de la familia GPT-5, una nueva serie de modelos “frontera” diseñada específicamente para cerrar la brecha entre asistentes conversacionales de un solo turno y sistemas que deben razonar a través de documentos largos, llamar herramientas, interpretar imágenes y ejecutar flujos de trabajo multietapa de forma confiable. OpenAI presenta 5.2 como su lanzamiento más capaz hasta ahora para el trabajo profesional del conocimiento: establece nuevos resultados de vanguardia en benchmarks internos (notablemente un nuevo benchmark GDPval para el trabajo del conocimiento), demuestra un rendimiento más sólido en programación en benchmarks de ingeniería de software y ofrece capacidades significativamente mejoradas de largo contexto y visión.

En términos prácticos, GPT-5.2 es más que “un modelo de chat más grande”. Es una familia de tres variantes ajustadas (Instant, Thinking, Pro) que equilibran latencia, profundidad de razonamiento y costo, y que, junto con la API de OpenAI y el enrutamiento de ChatGPT, pueden usarse para ejecutar trabajos de investigación largos, construir agentes que llamen herramientas externas, interpretar imágenes y gráficos complejos y generar código de calidad de producción con mayor fidelidad que versiones anteriores. El modelo admite ventanas de contexto muy grandes (los documentos de OpenAI enumeran una ventana de contexto de 400,000 tokens y un límite máximo de salida de 128,000 para los modelos insignia), nuevas funciones de API para niveles explícitos de esfuerzo de razonamiento y un comportamiento de invocación de herramientas “agente”.

5 capacidades clave mejoradas en GPT-5.2

1) ¿GPT-5.2 es mejor en lógica multietapa y matemáticas?

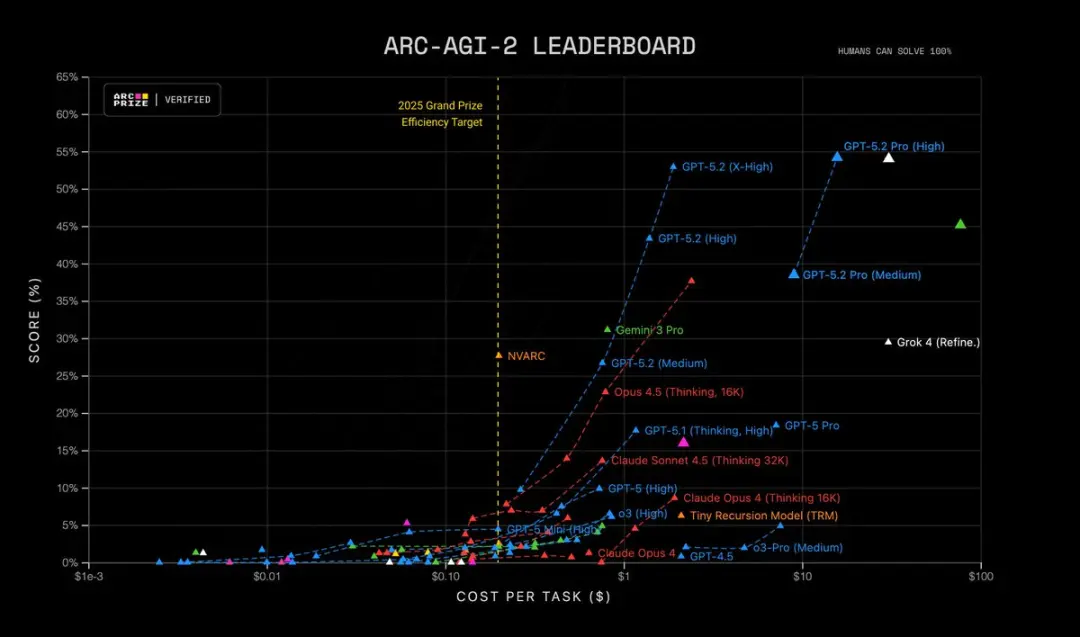

GPT-5.2 ofrece un razonamiento multietapa más agudo y un rendimiento notablemente más sólido en matemáticas y resolución estructurada de problemas. OpenAI afirma que añadieron un control más granular sobre el esfuerzo de razonamiento (nuevos niveles como xhigh), diseñaron soporte de “tokens de razonamiento” y ajustaron el modelo para mantener la cadena de pensamiento a lo largo de trazas internas de razonamiento más largas. Benchmarks como FrontierMath y pruebas de estilo ARC-AGI muestran ganancias sustantivas frente a GPT-5.1; presenta márgenes mayores en benchmarks específicos de dominio usados en flujos de trabajo científicos y financieros. En resumen: GPT-5.2 “piensa durante más tiempo” cuando se le solicita y puede realizar trabajo simbólico/matemático más complicado con mejor consistencia.

| RC-AGI-1 (Verificado) Razonamiento abstracto | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (Verificado) Razonamiento abstracto | 52.9% | 17.6% |

GPT-5.2 Thinking establece récords en múltiples pruebas avanzadas de ciencia y razonamiento matemático:

- GPQA Diamond Science Quiz: 92.4% (versión Pro 93.2%)

- ARC-AGI-1 Razonamiento abstracto: 86.2% (primer modelo en superar el umbral del 90%)

- ARC-AGI-2 Razonamiento de orden superior: 52.9%, marcando un nuevo récord para el modelo Thinking Chain

- FrontierMath Prueba de Matemáticas Avanzadas: 40.3%, superando ampliamente a su predecesor;

- HMMT Problemas de Competencia Matemática: 99.4%

- Prueba AIME de Matemáticas: 100% Solución completa

Además, GPT-5.2 Pro (Alta) es el estado del arte en ARC-AGI-2, logrando una puntuación de 54.2% a un costo de $15.72 por tarea. Supera a todos los demás modelos.

Por qué importa: muchas tareas del mundo real — modelado financiero, diseño de experimentos, síntesis de programas que requieren razonamiento formal — están limitadas por la capacidad de un modelo para encadenar muchos pasos correctos. GPT-5.2 reduce los “pasos alucinados” y produce trazas intermedias de razonamiento más estables cuando le pides que muestre su trabajo.

2) ¿Cómo han mejorado la comprensión de texto largo y el razonamiento entre documentos?

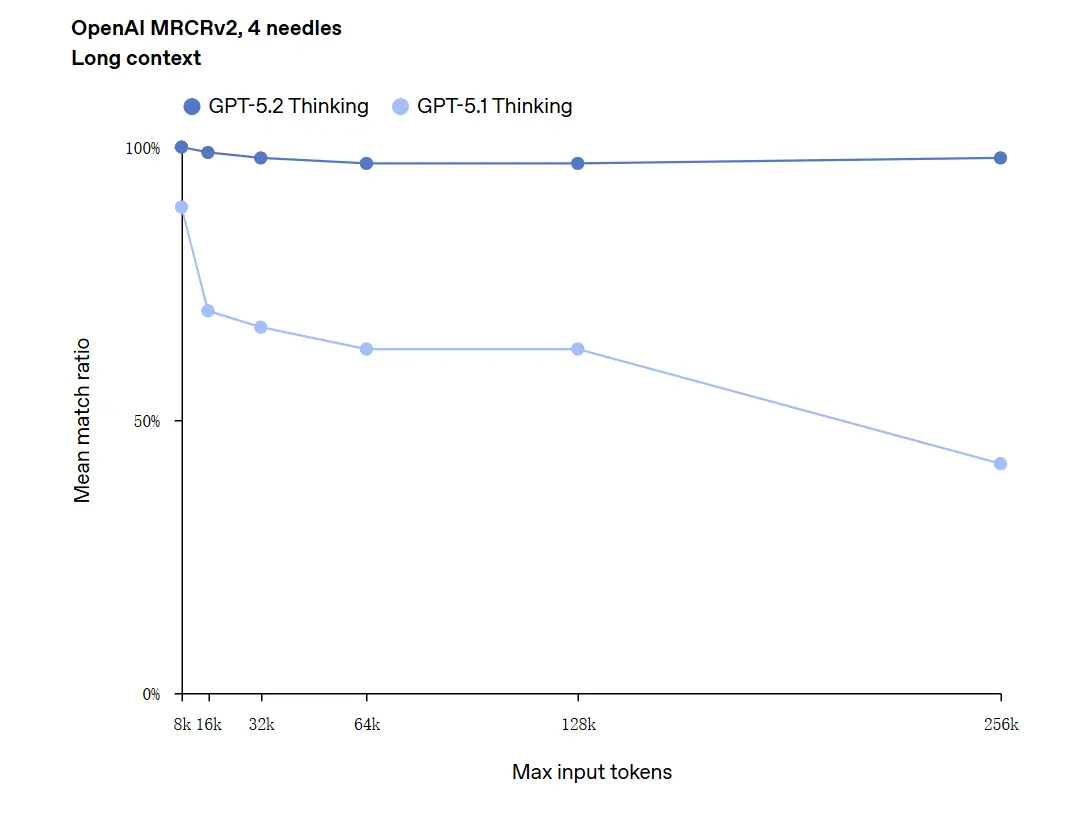

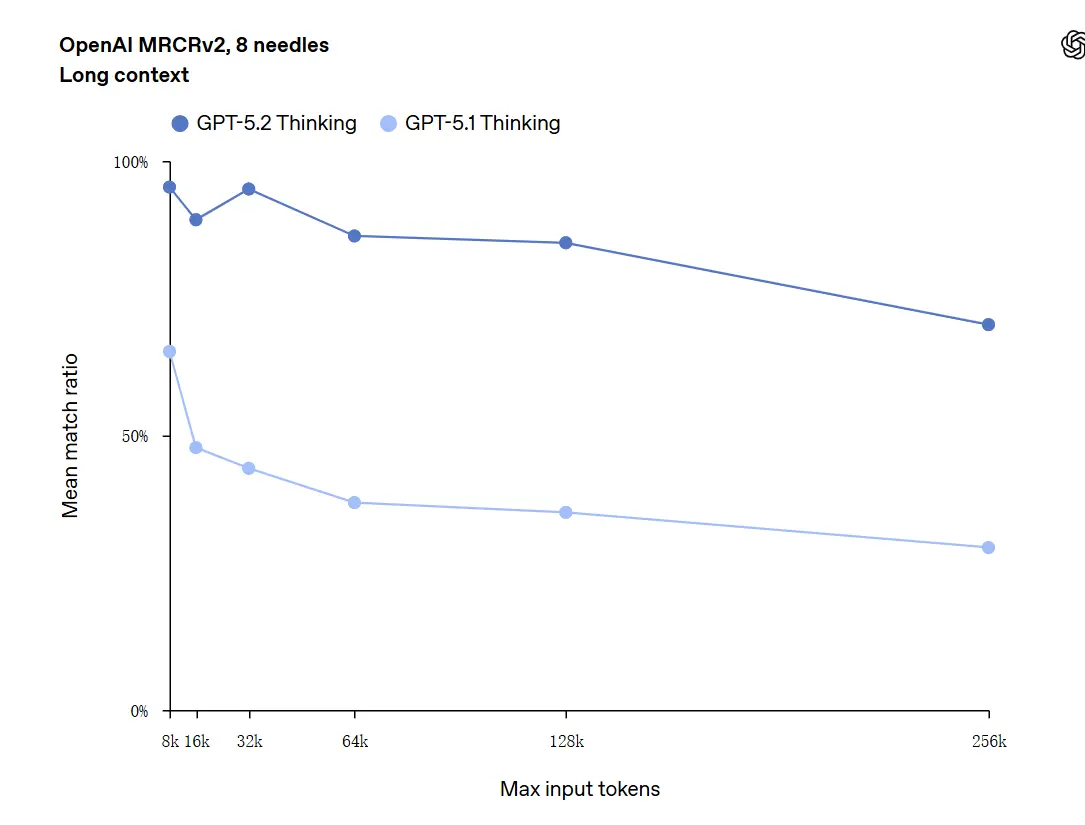

La comprensión de contexto largo es una de las mejoras destacadas. El modelo subyacente de GPT-5.2 admite una ventana de contexto de 400k tokens y — lo que es importante — mantiene mayor precisión a medida que el contenido relevante se desplaza profundamente en ese contexto. GDPval, un conjunto de tareas para “trabajo del conocimiento bien especificado” en 44 ocupaciones, donde GPT-5.2 Thinking alcanza la paridad o supera a jueces humanos expertos en una gran parte de las tareas. Informes independientes confirman que el modelo retiene y sintetiza información a través de muchos documentos mucho mejor que los modelos anteriores. Esto es un avance realmente práctico para tareas como due diligence, resúmenes legales, revisiones de literatura y comprensión de bases de código.

GPT-5.2 puede manejar contextos de hasta 256,000 tokens (aproximadamente más de 200 páginas de documentos). Además, en la prueba de comprensión de texto largo "OpenAI MRCRv2", GPT-5.2 Thinking alcanzó una tasa de precisión cercana al 100%.

Advertencia sobre el “100% de precisión”: describió las mejoras como “acercándose al 100%” para microtareas estrechas; los datos de OpenAI se describen mejor como “estado del arte y en muchos casos a la par o por encima de niveles de expertos humanos en las tareas evaluadas”, no literalmente perfecto en todos los usos. Los benchmarks muestran grandes avances pero no una perfección universal.

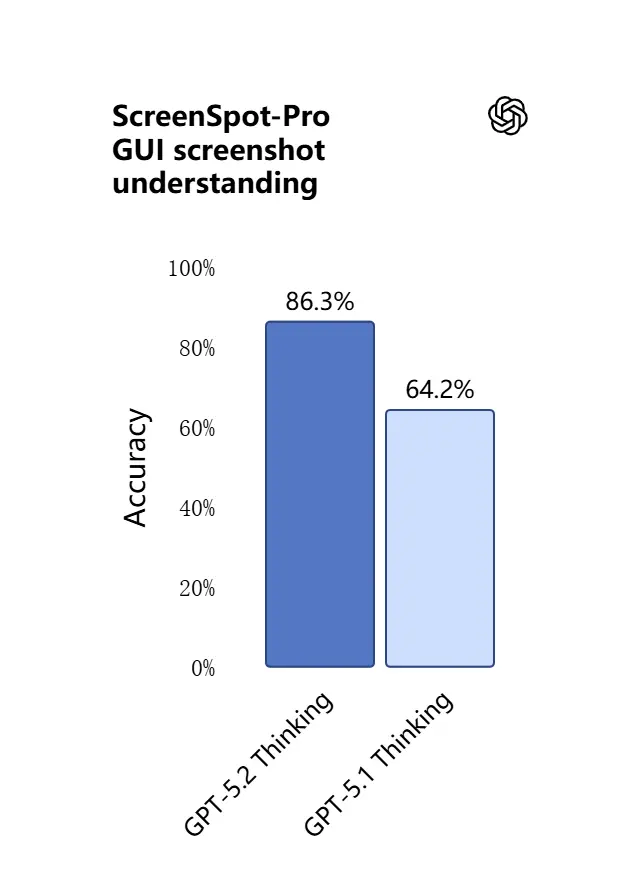

3) ¿Qué hay de nuevo en comprensión visual y razonamiento multimodal?

Las capacidades de visión en GPT-5.2 son más precisas y prácticas. El modelo es mejor interpretando capturas de pantalla, leyendo gráficos y tablas, reconociendo elementos de interfaz y combinando entradas visuales con un contexto textual largo. No es solo subtitulado: GPT-5.2 puede extraer datos estructurados de imágenes (p. ej., tablas en un PDF), explicar gráficos y razonar sobre diagramas de formas que respaldan acciones posteriores con herramientas (p. ej., generar una hoja de cálculo a partir de un informe fotografiado).

.webp)

Efecto práctico: los equipos pueden introducir directamente al modelo presentaciones completas, informes de investigación escaneados o documentos con abundantes imágenes y solicitar síntesis entre documentos, reduciendo enormemente el trabajo manual de extracción.

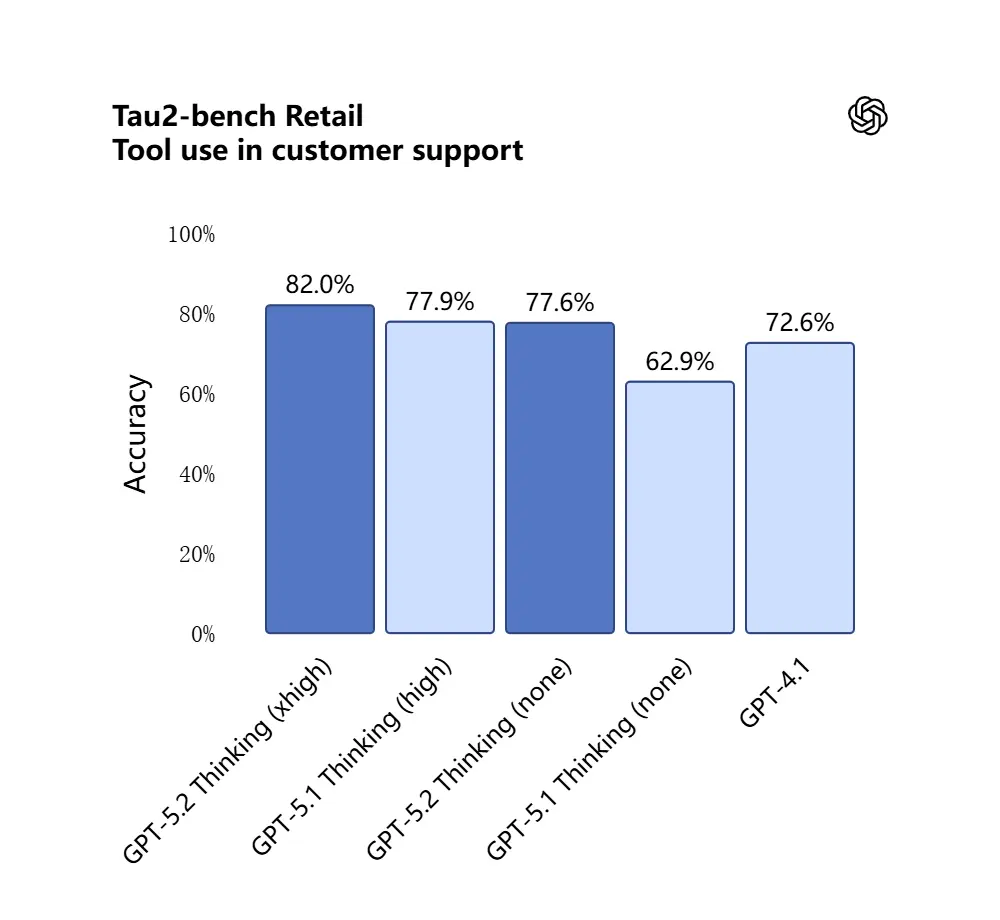

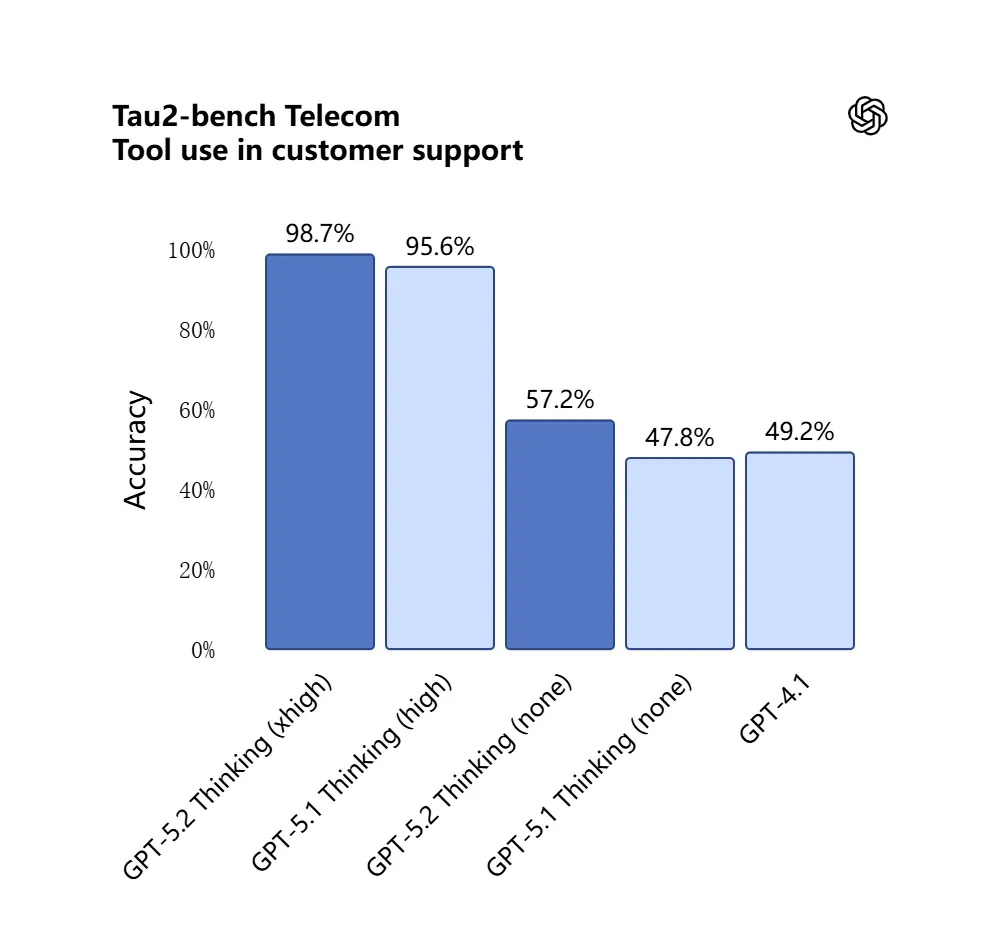

4) ¿Cómo han cambiado la invocación de herramientas y la ejecución de tareas?

GPT-5.2 avanza más hacia el comportamiento agente: es mejor planificando tareas multietapa, decidiendo cuándo llamar herramientas externas y ejecutando secuencias de llamadas a API/herramientas para terminar un trabajo de extremo a extremo. Mejoras en “llamado de herramientas agente” — el modelo propondrá un plan, llamará herramientas (bases de datos, cómputo, sistemas de archivos, navegador, ejecutores de código) y sintetizará resultados en un entregable final de forma más confiable que versiones anteriores. La API introduce enrutamiento y controles de seguridad (listas de herramientas permitidas, andamiaje de herramientas) y la interfaz de ChatGPT puede enrutar automáticamente las solicitudes a la variante 5.2 adecuada (Instant vs Thinking).

GPT-5.2 obtuvo 98.7% en el benchmark Tau2-Bench Telecom, demostrando sus capacidades maduras de llamado de herramientas en tareas complejas y de múltiples turnos.

Por qué importa: esto hace que GPT-5.2 sea más útil como asistente autónomo para flujos de trabajo como “ingiere estos contratos, extrae cláusulas, actualiza una hoja de cálculo y redacta un correo de resumen”, tareas que antes requerían una orquestación cuidadosa.

5) Evolución de la capacidad de programación

GPT-5.2 es notablemente mejor en tareas de ingeniería de software: escribe módulos más completos, genera y ejecuta pruebas de forma más confiable, comprende gráficos complejos de dependencias de proyectos y es menos propenso a la “pereza al programar” (omitir boilerplate o no conectar módulos). En benchmarks de codificación de nivel industrial (SWE-bench Pro, etc.) GPT-5.2 establece nuevos récords. Para equipos que usan LLMs como pair-programmers, esa mejora puede reducir la verificación manual y el retrabajo necesarios después de la generación.

En la prueba SWE-Bench Pro (tarea real de ingeniería de software industrial), la puntuación de GPT-5.2 Thinking mejoró a 55.6%, mientras que también alcanzó un nuevo máximo de 80% en la prueba SWE-Bench Verified.

_Software%20engineering.webp)

En aplicaciones prácticas, esto significa:

- Depuración automática de código en entorno de producción conlleva mayor estabilidad;

- Soporte para programación multilenguaje (no limitado a Python);

- Capacidad para completar de forma independiente tareas de reparación de extremo a extremo.

¿Cuáles son las diferencias entre GPT-5.2 y GPT-5.1?

Respuesta corta: GPT-5.2 es una mejora iterativa pero sustancial. Mantiene la arquitectura y las bases multimodales de la familia GPT-5, pero avanza en cuatro dimensiones prácticas:

- Profundidad y consistencia del razonamiento. 5.2 introduce niveles más altos de esfuerzo de razonamiento y mejor encadenamiento para problemas multietapa; 5.1 mejoró el razonamiento antes, pero 5.2 eleva el techo para matemáticas complejas y lógica multinivel.

- Confiabilidad en contexto largo. Ambas versiones ampliaron el contexto, pero 5.2 está ajustada para mantener la precisión a gran profundidad en entradas muy largas (OpenAI afirma una mejor retención hasta cientos de miles de tokens).

- Fidelidad en visión + multimodal. 5.2 mejora la interreferencia entre imágenes y texto — p. ej., leer un gráfico e integrar esos datos en una hoja de cálculo — mostrando mayor precisión a nivel de tarea.

- Comportamiento agente con herramientas y funciones de API. 5.2 expone nuevos parámetros de esfuerzo de razonamiento (

xhigh) y funciones de compactación de contexto en la API, y OpenAI ha refinado la lógica de enrutamiento en ChatGPT para que la UI pueda elegir automáticamente la mejor variante. - Menos errores, mayor estabilidad: GPT-5.2 reduce su “tasa de alucinación” (tasa de respuestas falsas) en un 38%. Responde con mayor fiabilidad a preguntas de investigación, redacción y análisis, reduciendo instancias de “hechos fabricados”. En tareas complejas, su salida estructurada es más clara y su lógica más estable. Mientras tanto, la seguridad de las respuestas del modelo mejora significativamente en tareas relacionadas con salud mental. Se desempeña con mayor solidez en escenarios sensibles como salud mental, autolesiones, suicidio y dependencia emocional.

En evaluaciones del sistema, GPT-5.2 Instant obtuvo 0.995 (de 1.0) en la tarea de “Apoyo a la salud mental”, significativamente más alto que GPT-5.1 (0.883).

Cuantitativamente, los benchmarks publicados por OpenAI muestran ganancias medibles en GDPval, benchmarks de matemáticas (FrontierMath) y evaluaciones de ingeniería de software. GPT-5.2 supera a GPT-5.1 en tareas de hojas de cálculo de banca de inversión junior por varios puntos porcentuales.

¿GPT-5.2 es gratis? — ¿cuánto cuesta?

¿Puedo usar GPT-5.2 gratis?

OpenAI lanzó GPT-5.2 comenzando con planes de pago de ChatGPT y acceso a la API. Históricamente OpenAI ha mantenido los modelos más rápidos/profundos detrás de niveles de pago mientras que hace variantes más livianas disponibles más ampliamente más tarde; con 5.2 la compañía dijo que el despliegue iniciaría en planes de pago (Plus, Pro, Business, Enterprise) y que la API está disponible para desarrolladores. Eso significa que el acceso gratuito inmediato es limitado: el nivel gratuito puede recibir acceso degradado o enrutado (por ejemplo, a subvariantes más ligeras) más adelante conforme OpenAI escala el despliegue.

La buena noticia es que CometAPI ahora se integra con GPT-5.2, y actualmente está en oferta navideña. Ahora puedes usar GPT-5.2 a través de CometAPI; el playground te permite interactuar libremente con GPT-5.2, y los desarrolladores pueden usar la API de GPT-5.2 (CometAPI tiene un precio del 20% del de OpenAI) para construir flujos de trabajo.

¿Cuánto cuesta a través de la API (uso de desarrollador/producción)?

El uso de la API se factura por token. Los precios publicados por OpenAI en el lanzamiento muestran (CometAPI tiene un precio del 20% del de OpenAI):

- GPT-5.2 (chat estándar) — $1.75 por 1M tokens de entrada y $14 por 1M tokens de salida (se aplican descuentos por entradas en caché).

- GPT-5.2 Pro (insignia) — $21 por 1M tokens de entrada y $168 por 1M tokens de salida (significativamente más caro porque está destinado a cargas de trabajo de alta precisión y alto cómputo).

- En comparación, GPT-5.1 era más barato (p. ej., $1.25 entrada / $10 salida por 1M tokens).

Interpretación: los costos de API aumentaron con respecto a generaciones anteriores; el precio indica que el rendimiento premium de 5.2 en razonamiento y contexto largo se cotiza como un nivel de producto distinto. Para sistemas en producción, los costos del plan dependen en gran medida de cuántos tokens ingresas/emites y con qué frecuencia reutilizas entradas en caché (las entradas en caché obtienen grandes descuentos).

Lo que significa en la práctica

- Para uso casual a través de la UI de ChatGPT, los planes de suscripción mensual (Plus, Pro, Business, Enterprise) son el camino principal. Los precios de los niveles de suscripción de ChatGPT no cambiaron con el lanzamiento de 5.2 (OpenAI mantiene estables los precios del plan incluso si cambian las ofertas de modelos).

- Para uso de producción y desarrolladores, presupuesta los costos por tokens. Si tu app transmite muchas respuestas largas o procesa documentos extensos, el precio de tokens de salida ($14 / 1M tokens para Thinking) dominará los costos a menos que almacenes cuidadosamente entradas en caché y reutilices salidas.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

OpenAI lanzó GPT-5.2 con tres variantes diseñadas para casos de uso específicos: Instant, Thinking y Pro:

- GPT-5.2 Instant: Rápido, rentable, ajustado para trabajo cotidiano — FAQs, guías, traducciones, borradores rápidos. Menor latencia; buenos primeros borradores y flujos simples.

- GPT-5.2 Thinking: Respuestas más profundas y de mayor calidad para trabajo sostenido — resúmenes de documentos largos, planificación multietapa, revisiones de código detalladas. Latencia y calidad equilibradas; la “bestia de carga” predeterminada para tareas profesionales.

- GPT-5.2 Pro: Máxima calidad y confiabilidad. Más lento y más costoso; ideal para tareas difíciles y de alto riesgo (ingeniería compleja, síntesis legal, decisiones de alto valor) y donde se requiere un esfuerzo de razonamiento ‘xhigh’.

Tabla comparativa

| Característica / Métrica | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Uso previsto | Tareas cotidianas, borradores rápidos | Análisis profundo, documentos largos | Máxima calidad, problemas complejos |

| Latencia | Más baja | Moderada | Más alta |

| Esfuerzo de razonamiento | Estándar | Alto | xHigh disponible |

| Ideal para | FAQ, tutoriales, traducciones, prompts cortos | Resúmenes, planificación, hojas de cálculo, tareas de código | Ingeniería compleja, síntesis legal, investigación |

| Ejemplos de nombre de API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Precio por token de entrada (API) | $1.75 / 1M | $1.75 / 1M | $21 / 1M |

| Precio por token de salida (API) | $14 / 1M | $14 / 1M | $168 / 1M |

| Disponibilidad (ChatGPT) | Despliegue progresivo; planes de pago y luego más amplio | Despliegue progresivo a planes de pago | Usuarios Pro / Enterprise (pago) |

| Ejemplo de caso de uso | Redactar email, fragmentos menores de código | Construir modelo financiero multihoja, Q&A sobre informe largo | Auditar codebase, generar diseño de sistema de producción |

¿Quién es adecuado para usar GPT-5.2?

GPT-5.2 está diseñado con un conjunto amplio de usuarios objetivo en mente. A continuación, recomendaciones por rol:

Empresas y equipos de producto

Si construyes productos para trabajo del conocimiento (asistentes de investigación, revisión de contratos, canalizaciones de analítica o herramientas para desarrolladores), las capacidades de contexto largo y agente de 5.2 pueden reducir significativamente la complejidad de integración. Las empresas que necesitan comprensión robusta de documentos, informes automatizados o copilotos inteligentes encontrarán útiles Thinking/Pro. Microsoft y otros socios de plataforma ya están integrando 5.2 en stacks de productividad (p. ej., Microsoft 365 Copilot).

Desarrolladores y equipos de ingeniería

Los equipos que quieren usar LLMs como pair-programmers o para automatizar generación/pruebas de código se beneficiarán de la mayor fidelidad de programación en 5.2. El acceso a la API (con modos thinking o pro) permite síntesis más profundas de grandes bases de código gracias a la ventana de contexto de 400k tokens. Espera pagar más en la API al usar Pro, pero la reducción en depuración y revisión manual puede justificar ese costo para sistemas complejos.

Investigadores y analistas intensivos en datos

Si sintetizas literatura con regularidad, analizas informes técnicos extensos o deseas diseño de experimentos asistido por modelos, el contexto largo y las mejoras en matemáticas de GPT-5.2 ayudan a acelerar los flujos de trabajo. Para investigación reproducible, acompaña el modelo con ingeniería de prompts cuidadosa y pasos de verificación.

Pequeñas empresas y power users

ChatGPT Plus (y Pro para power users) obtendrá acceso enrutado a las variantes 5.2; esto hace que la automatización avanzada y salidas de alta calidad sean alcanzables para equipos pequeños sin construir una integración con la API. Para usuarios no técnicos que necesitan mejores resúmenes de documentos o creación de diapositivas, GPT-5.2 ofrece un valor práctico notable.

Notas prácticas para desarrolladores y operadores

Funciones de API a observar

- Niveles de

reasoning.effort(p. ej.,medium,high,xhigh) te permiten indicar al modelo cuántos recursos computacionales dedicar al razonamiento interno; úsalo para intercambiar latencia por precisión por solicitud. - Compactación de contexto: la API incluye herramientas para comprimir y compactar el historial de modo que el contenido realmente relevante se preserve en cadenas largas. Esto es crítico cuando debes mantener el uso efectivo de tokens manejable.

- Andamiaje de herramientas y controles de herramientas permitidas: los sistemas de producción deben incluir explícitamente en listas blancas lo que el modelo puede invocar y registrar las llamadas a herramientas para auditoría.

Consejos de control de costos

- Cachea embeddings de documentos usados con frecuencia y usa entradas en caché (que reciben fuertes descuentos) para consultas repetidas contra el mismo corpus. La plataforma de precios de OpenAI incluye descuentos significativos para entradas en caché.

- Enruta consultas exploratorias/de bajo valor a Instant y reserva Thinking/Pro para trabajos por lotes o pasadas finales.

- Estima cuidadosamente el uso de tokens (entrada + salida) al proyectar costos de API porque las salidas largas multiplican el costo.

Conclusión — ¿deberías actualizar a GPT-5.2?

Si tu trabajo depende del razonamiento sobre documentos largos, síntesis entre documentos, interpretación multimodal (imágenes + texto) o construcción de agentes que llamen herramientas, GPT-5.2 es una actualización clara: eleva la precisión práctica y reduce el trabajo manual de integración. Si principalmente ejecutas chatbots de gran volumen y baja latencia o aplicaciones estrictamente limitadas por presupuesto, Instant (o modelos anteriores) pueden seguir siendo una opción razonable.

GPT-5.2 representa un cambio deliberado de “mejor chat” a “mejor asistente profesional”: más cómputo, más capacidad y niveles de costo más altos — pero también ganancias reales de productividad para equipos que pueden aprovechar un contexto largo confiable, mejor matemáticas/razonamiento, comprensión de imágenes y ejecución agente de herramientas.

Para comenzar, explora las capacidades de los modelos GPT-5.2 (GPT-5.2;GPT-5.2 pro, GPT-5.2 chat) en el Playground y consulta la guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y obtenido la clave de la API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar?→ Prueba gratuita de modelos gpt-5.2