Réponse rapide : Quel modèle d’IA les développeurs doivent-ils privilégier en 2026 ?

Pour les tâches exigeant un raisonnement autonome maximal et une hallucination minimale, les développeurs devraient choisir GPT-5.5 (xhigh), leader du marché avec un Indice d’intelligence de 60. Les applications nécessitant une interactivité en temps réel devraient utiliser Mercury 2, actuellement le plus rapide avec environ 859 jetons par seconde. Pour la production à grande échelle où le budget est la contrainte principale, DeepSeek V4 Pro et Kimi K2.6 offrent une intelligence proche de l’état de l’art pour environ 10% du coût des modèles propriétaires phares.

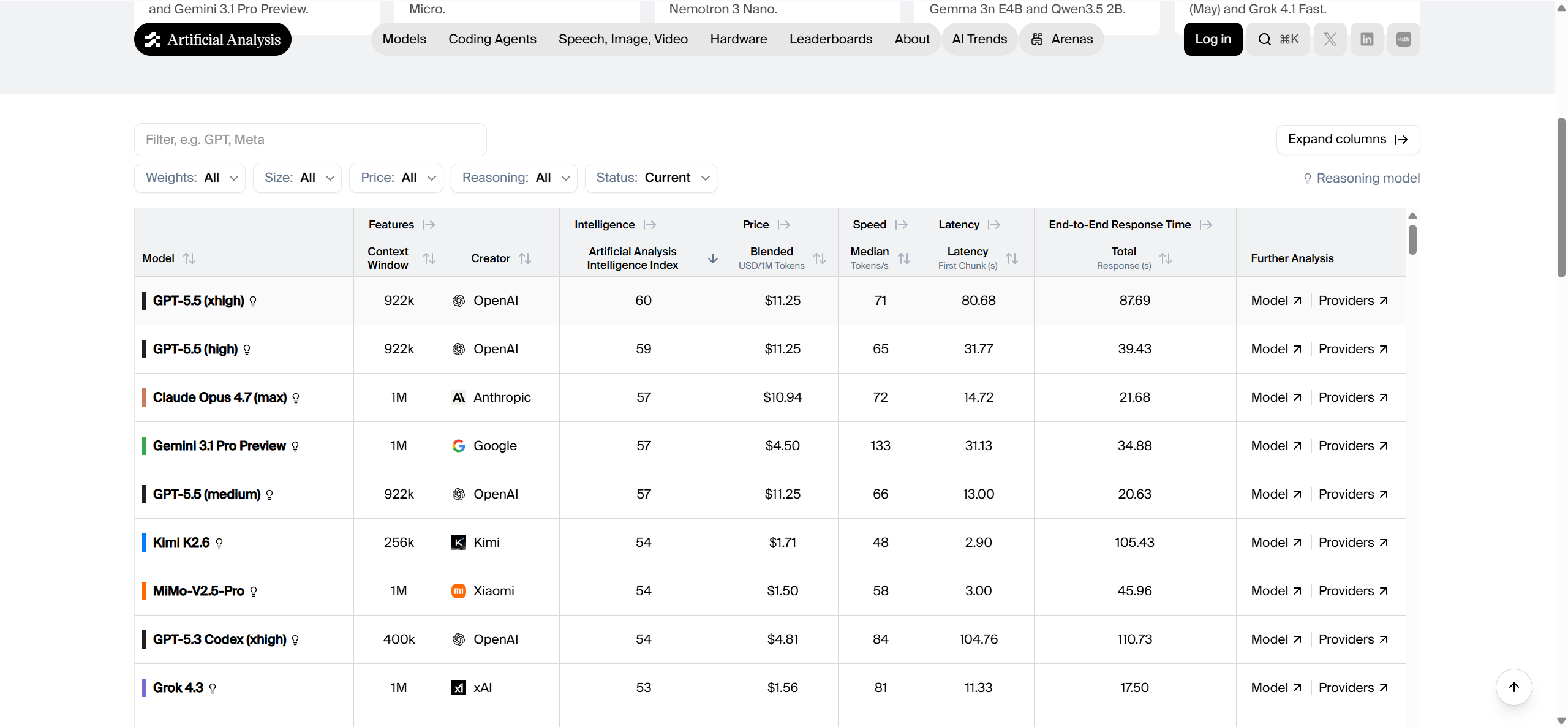

L’Indice d’intelligence : classement des modèles de pointe

Le paysage de l’IA en 2026 est passé de la course au nombre de paramètres à l’optimisation de la densité de “pensée”. L’Artificial Analysis Intelligence Index v4.0 sert de norme industrielle pour quantifier la capacité des modèles sur dix dimensions spécialisées, y compris le codage de niveau professionnel et la déduction logique extrême.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Scientific research and logic |

| GPT-5.5 (high) | 59 | 922K | Professional-grade coding |

| Claude Opus 4.7 (max) | 57 | 1M | Autonomous agents and planning |

| Gemini 3.1 Pro | 57 | 1M - 2M | Multimodal data synthesis |

| Kimi K2.6 | 54 | 256K | Terminal-based agentic work |

| MiMo-V2.5-Pro | 54 | 1M | Full-stack software engineering |

| DeepSeek V4 Pro (Max) | 52 | 1M | Scalable reasoning workflows |

| GLM-5.1 | 51 | 200K | Long-horizon autonomous tasks |

Comment lire ce tableau

Parmi les cinq meilleurs modèles, trois sont des modèles GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 et Gemini 3.1 Pro. Ces trois modèles phares occidentaux se tiennent dans un mouchoir de poche, tandis que Kimi K2 et mimo-v2.5 pro, deux modèles chinois, offrent des performances comparables aux meilleurs modèles occidentaux à des prix extrêmement compétitifs.

L’Artificial Analysis Intelligence Index est une métrique normalisée dérivée d’évaluations indépendantes telles que Terminal-Bench Hard et IFBench. Un point de différence représente un écart statistiquement significatif dans le “seuil d’autonomie” d’un modèle. Par exemple, l’écart de 3 points entre GPT-5.5 (60) et Claude Opus 4.7 (57) se traduit souvent par la différence entre un modèle qui nécessite une intervention humaine tous les quelques pas et un autre capable de compléter une chaîne logique complexe de manière autonome. Un indice plus élevé est généralement associé à des taux de réussite plus élevés à “Humanity's Last Exam” et à une réduction des erreurs d’appel d’outils dans des environnements agentiques.

Les réflexes : latence et vitesse de génération

Pour les logiciels interactifs — des assistants IDE en direct aux agents vocaux côté client — l’intelligence brute est secondaire par rapport au Temps jusqu’au premier jeton (TTFT) et au débit de génération.

Top 5 des modèles les plus rapides (débit)

Le débit mesure la vitesse à laquelle un modèle génère du texte après la phase de traitement initiale. Un débit élevé est essentiel pour la génération de contenus longs et la refactorisation rapide de code.

- Mercury 2 : Environ 859 jetons/s

- Granite 4.0 H Small : Environ 407 jetons/s

- Granite 3.3 8B : Environ 365 jetons/s

- Gemini 3.1 Flash-Lite**** : Environ 331 jetons/s

- Qwen3.5 0.8B : Environ 287 jetons/s

Top 5 des modèles à plus faible latence (TTFT)

La latence indique le délai avant que le premier jeton n’atteigne l’utilisateur. C’est la métrique critique pour le “ressenti” et la réactivité perçue en UI/UX.

- NVIDIA Nemotron 3 Nano : Environ 0.40s

- Ministral 3 3B : Environ 0.47s

- Qwen3.5 0.8B : Environ 0.52s

- LFM2 24B A2B : Environ 0.55s

- Grok 3 mini Reasoning : Environ 0.58s

Comment choisir votre modèle en 2026

La sélection d’un modèle exige d’équilibrer le ratio “Intelligence par dollar” avec les exigences de disponibilité spécifiques à votre application. Le marché en 2026 s’est scindé en trois trajectoires architecturales distinctes.

Développeurs indépendants et équipes sensibles au budget

Pour les développeurs solo ou les petites équipes exécutant des milliers de boucles d’agents expérimentales, DeepSeek V4 Pro est le choix stratégique optimal. Il utilise une architecture Mixture-of-Experts (MoE) massive de 1.6T paramètres où seuls 49B paramètres sont activés par jeton, lui permettant d’offrir des performances de niveau phare pour environ $0.416 par million de jetons. Une autre excellente option pour les tâches de codage spécifiques est Kimi K2.6, qui se spécialise dans les workflows “terminal-first”. Ces modèles offrent près de 90% de la puissance de raisonnement des modèles premium tout en étant environ 70-80% moins chers, prolongeant efficacement la durée de trésorerie d’une startup.

Environnements de production entreprise

Pour des déploiements à l’échelle de l’entreprise où la stabilité et le respect d’invites système complexes sont non négociables, la norme industrielle reste GPT-5.5 Pro et Claude Opus 4.7. GPT-5.5 Pro est conçu pour une précision à forts enjeux, excellant dans des domaines comme la modélisation en banque d’investissement et l’exploration scientifique où le coût d’une erreur dépasse le coût de l’appel API. Claude Opus 4.7 est privilégié par les équipes nécessitant une fiabilité soutenue sur des projets de plusieurs jours, car il présente un taux d’hallucination significativement plus faible dans les environnements terminal par rapport à la famille GPT au sens large. Les entreprises utilisent généralement CometAPI pour intégrer ces modèles via une passerelle unique, garantissant une disponibilité de 99.9% et un basculement immédiat si un fournisseur principal subit des pics de latence régionaux.

Applications interactives en temps réel

Les applications telles que les bots d’assistance client en temps réel ou le sous-titrage vidéo instantané nécessitent une IA “fluide” qui semble instantanée. Dans cette catégorie, Mercury 2 et Gemini 3.1 Flash-Lite sont les meilleurs choix. Mercury 2 offre un débit près de dix fois supérieur aux modèles de raisonnement standard, ce qui le rend idéal pour la rédaction de documents en temps réel. Gemini 3.1 Flash-Lite offre une capacité multimodale équilibrée, traitant texte, audio et images dans un contexte unifié à environ 2.5x la vitesse des générations précédentes, tout en prenant en charge une fenêtre de contexte de 1 million de jetons.

Fenêtre de contexte : des extraits aux dépôts entiers

La fenêtre de contexte agit comme la “mémoire à court terme” du modèle. En 2026, l’industrie s’est divisée entre des fenêtres standard (128K) et des capacités à l’échelle du dépôt (1M-10M).

- Llama 4 Scout : 10,000,000 tokens

- Grok 4.20 : 2,000,000 tokens

- Gemini 3.1 Pro : Approximately 1,048,576 tokens

- DeepSeek V4 Pro : 1,000,000 tokens

- GPT-5.5 Pro : 1,050,000 tokens

Quand la taille du contexte est-elle importante ?

Une fenêtre de contexte de 128K — standard pour des modèles comme DeepSeek-V3.2 — est désormais la base pour les conversations simples et le résumé d’articles individuels. Cependant, l’ingénierie logicielle professionnelle requiert une conscience “du système entier”.

Une fenêtre d’1 million de jetons permet à un agent IA d’ingérer un dépôt logiciel entier, y compris tous les fichiers source, la documentation et les journaux historiques, en une seule passe avant. Cela évite la “dérive de mémoire” associée aux systèmes RAG traditionnels où des données pertinentes peuvent être manquées lors du découpage. Un exemple concret est une refactorisation d’une base de code : un modèle avec 1M de jetons peut comprendre comment une modification dans un schéma de base de données central affecte cinquante endpoints d’API différents à travers des fichiers séparés, alors qu’un modèle plus petit pourrait seulement “voir” quelques fichiers à la fois, conduisant à des dépendances rompues.

Comparaison économique : prix unitaire par 1 million de jetons

Le tableau suivant utilise une métrique USD mixte/1M jetons, en supposant un ratio de 3:1 entre les jetons d’entrée et de sortie pour refléter les schémas d’utilisation réels.

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Approximately $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Approximately $10.00 | High | 20% OFF |

| Gemini 3.1 Pro | Approximately $4.50 | Balanced | 20% OFF |

| Kimi K2.6 | Approximately $1.71 | High-Value | 20% OFF |

| DeepSeek V4 Pro | Approximately $0.53 | Extreme-Value | 20% OFF |

| Qwen3.5 0.8B | Approximately $0.02 | Utility | 20% OFF |

Tous les tarifs vérifiés en mai 2026. Les tarifs des fournisseurs officiels sont généralement 20% plus élevés que les tarifs remisés proposés via des passerelles unifiées.

Stratégie d’optimisation des coûts

Pour aider à la planification architecturale, nous avons estimé les dépenses mensuelles pour trois paliers de croissance courants.

- Petite équipe de développeurs (10M jetons/mois) : Les équipes utilisant principalement Kimi K2.6 pour la création de fonctionnalités et DeepSeek V4 Flash pour la logique simple verront une dépense mensuelle comprise entre $15 et $40. Cela permet un prototypage agressif avec une charge financière ne dépassant pas un abonnement SaaS standard.

- SaaS de taille moyenne (100M jetons/mois) : Une startup qui met à l’échelle une plateforme d’automatisation pilotée par l’IA en utilisant Claude Sonnet 4.6 et Gemini 3.1 Flash peut s’attendre à des coûts mensuels entre $250 et $550. En utilisant la mise en cache des invites disponible sur ces modèles, le coût effectif baisse souvent de 15% supplémentaires.

- Grande entreprise (1B jetons/mois) : Les entreprises mondiales exécutant des workflows agentiques à forte concurrence avec GPT-5.5 et Claude Opus 4.7 dépenseront probablement entre $3,000 et $6,500 par mois. À cette échelle, l’intégration via une passerelle API unifiée devient essentielle pour la facturation centralisée et pour éviter les frais généraux liés à la gestion de contrats séparés avec plusieurs fournisseurs.

Conclusion : choisissez votre trajectoire en 2026

L’ère du “modèle universel” est révolue. L’architecture IA moderne nécessite l’orchestration d’une flotte de modèles spécialisés : GPT-5.5 pour le raisonnement à forte intensité de calcul, Mercury 2 pour l’interactivité, et DeepSeek V4 pour l’exécution à grand volume. En s’intégrant une fois à CometAPI, les développeurs gagnent la portabilité pour échanger les modèles au fil de l’évolution des benchmarks tout en obtenant une remise permanente de 20-40% sur chaque requête.

FAQ

Quel est actuellement le modèle d’IA le plus intelligent ?

Selon l’Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) est le modèle le plus intelligent actuellement disponible, avec un score de 60. Il est suivi de près par GPT-5.5 (high) à 59 et Claude Opus 4.7 (max) à 57.

Quel est le modèle d’IA le plus rapide pour les applications en temps réel ?

Mercury 2 est le champion de la vitesse en 2026, délivrant environ 859.1 jetons par seconde. Pour la faible latence (TTFT), NVIDIA Nemotron 3 Nano mène avec un temps de réponse d’environ 0.40 secondes.

À quel niveau l’Indice d’intelligence doit-il se situer pour des agents en production ?

Pour l’automatisation ou la classification de base, un score entre 30 et 40 (comme GPT-5.4 nano) est souvent suffisant. Cependant, pour l’“Agentic Engineering” où l’IA gère des bases de code ou des sessions de navigateur entières, un score supérieur à 54 (tel que Kimi K2.6 ou GPT-5.5) est recommandé afin d’assurer la cohérence dans la planification à long horizon.

À prix similaire, dois-je choisir GPT-5.5 ou Claude Opus 4.7 ?

Si votre flux de travail implique l’exécution dans le terminal et le “Vibe Coding”, GPT-5.5 excelle généralement sur ces benchmarks spécifiques. En revanche, si vous exigez une cohérence extrême pour la rédaction professionnelle, la recherche juridique ou des cycles d’agents sur plusieurs jours avec de faibles taux d’hallucination, Claude Opus 4.7 est le leader documenté dans ces catégories.

Quel est l’écart de performance réel entre les open-weights (DeepSeek) et les modèles propriétaires ?

En 2026, l’écart s’est réduit à environ 10-15% sur les benchmarks de raisonnement brut. Bien que les modèles propriétaires phares comme GPT-5.5 (xhigh) restent en tête en “logique de pointe” (Index 60), les modèles open-weights comme DeepSeek V4 Pro (Index 52) et Kimi K2.6 (Index 54) offrent plus de 85% de la capacité pour environ 1/10e du coût.

Comment puis-je réduire mes coûts API globaux pour ces modèles ?

L’utilisation d’une couche API unifiée comme CometAPI vous permet d’accéder à l’ensemble du catalogue à des tarifs 20% à 40% inférieurs aux prix des fournisseurs officiels grâce aux achats groupés et au routage intelligent.

Quel modèle possède la plus grande fenêtre de contexte pour les documents longs ?

Llama 4 Scout prend actuellement en charge la plus grande fenêtre de contexte du marché avec 10 millions de jetons. Grok 4.20 suit avec 2 millions de jetons, tandis que GPT-5.5 Pro, Gemini 3.1 Pro et DeepSeek V4 Pro supportent tous environ 1 million de jetons.

Existe-t-il un moyen de tester ces benchmarks sans coût initial élevé ?

Oui. Vous pouvez créer un compte gratuit sur CometAPI pour recevoir des crédits de test sans carte bancaire requise, ce qui vous permet d’exécuter des tests comparatifs de performance sur plus de 500 modèles dans le Playground intégré.