OpenAI’s GPT-5.4 (publié le 5 mars 2026) et Claude Sonnet 4.6 d’Anthropic (publié le 17 février 2026) représentent deux approches concurrentes pour le même marché : des modèles à grand contexte, capables d’agir en tant qu’agents, optimisés pour le travail de connaissance, le codage et des workflows longs et multi-étapes. Tous deux prennent en charge des fenêtres de contexte d’un million de tokens (en bêta), mais ils font des compromis différents en termes de prix, d’efficacité par token et de priorités d’ingénierie.

- GPT-5.4 se positionne comme le modèle de pointe d’OpenAI pour le travail professionnel : il unifie le raisonnement, le codage (lignée Codex) et des capacités natives d’utilisation de l’ordinateur/de l’agent, et OpenAI rapporte un score moyen de 87.3% sur un benchmark de modélisation de feuilles de calcul pour des tâches d’analyste junior en banque d’investissement. Il expose également un mode « Thinking » qui met en avant des plans en cours lors d’un raisonnement multi-étapes.

- Claude Sonnet 4.6 est le modèle milieu de gamme d’Anthropic qui a reçu une grande mise à niveau — visant délibérément des performances de niveau Opus à des prix de classe Sonnet. Sonnet 4.6 atteindrait ~79.6% sur SWE-bench (codage), de bons scores outils/agents (OSWorld, variantes Terminal), et est désormais le modèle Claude par défaut pour de nombreux produits Anthropic.

Utiliser simultanément les modèles GPT-5.4 et Claude 4.6 nécessite de basculer entre différents fournisseurs et d’engendrer des coûts élevés pour chacun. Cependant, CometAPI résout ce problème. Avec une seule clé API, vous pouvez passer d’un modèle à l’autre simultanément, en ne payant que les tokens utilisés, sans abonnement.

Qu’est-ce que GPT-5.4 ?

GPT-5.4 est une version incrémentale de raisonnement de pointe d’OpenAI destinée au travail de connaissance professionnel, déployée dans ChatGPT (sous le nom « GPT-5.4 Thinking »), l’API et Codex. OpenAI le présente comme le premier modèle de raisonnement principal à hériter des capacités de codage de pointe de leur lignée GPT-5.3-Codex, avec une meilleure utilisation de l’ordinateur, une recherche d’outils, moins d’hallucinations et une prise en charge expérimentale de 1M tokens dans Codex. Il est disponible sous gpt-5.4 (et gpt-5.4-pro pour des performances supérieures) dans l’API.

Caractéristiques clés du produit (ce qui a changé par rapport à GPT-5.2 / 5.3)

- Plan de réflexion en amont : GPT-5.4 peut fournir et présenter un plan initial de son raisonnement afin que les utilisateurs puissent piloter la réponse en cours — une amélioration de workflow pour les tâches longues et les livrables multi-étapes.

- Recherche d’outils et intégration améliorée : meilleure découverte de connecteurs et utilisation des outils plus fluide pour les agents à travers outils/fichiers.

- Efficacité en tokens et vitesse : OpenAI affirme que GPT-5.4 est plus efficace en tokens et plus rapide par effort de raisonnement que GPT-5.2, c’est-à-dire moins de tokens pour parvenir à la même réponse (ce qui se traduit par des gains de coût et de latence dans de nombreux workflows).

- Expérimentation sur la fenêtre de contexte : Codex inclut une prise en charge expérimentale d’une fenêtre de contexte de 1M token (drapeau API / configuration expérimentale). Dans ChatGPT, les fenêtres de contexte restent aux paramètres standard (non-1M) au lancement ; les parcours Codex/Dev permettent des contextes plus larges pour l’instant.

Forces mesurées et éléments fournis par OpenAI

OpenAI a publié une série de résultats de benchmark pour GPT-5.4 montrant :

- GDPval (tâches professionnelles) : GPT-5.4 atteint 83.0% (gagne ou fait jeu égal face à des baselines produites par des professionnels) — présenté comme un nouvel état de l’art dans les évaluations GDPval d’OpenAI.

- Codage (SWE-Bench Pro) : GPT-5.4 affiche 57.7% sur SWE-Bench Pro (la variante de benchmark de codage rapportée publiquement par OpenAI). GPT-5.4 montre aussi des gains substantiels sur des tâches internes de modélisation de feuilles de calcul (score moyen 87.3% vs 68.4% pour GPT-5.2).

- Performance Outils/Navigation : OpenAI rapporte BrowseComp 82.7% pour GPT-5.4, montrant une amélioration de la recherche web et de la récupération adossée aux outils.

- Factuel : OpenAI indique que les affirmations individuelles de GPT-5.4 sont 33% moins susceptibles d’être fausses et que les réponses complètes sont 18% moins susceptibles de contenir une erreur vs GPT-5.2 sur un ensemble de requêtes utilisateurs désidentifiées. C’est une amélioration non négligeable pour la documentation de production et les workflows juridiques/financiers.

Qu’est-ce que Claude Sonnet 4.6 ?

Claude Sonnet 4.6 d’Anthropic est une mise à niveau générationnelle de la gamme Sonnet : Sonnet est la famille de modèles « cheval de bataille » milieu de gamme qui équilibre capacité et coût. Sonnet 4.6 vise à offrir une intelligence de niveau Opus sur de nombreuses tâches (Opus est la gamme premium d’Anthropic), avec une prise en charge de 1M tokens de contexte (bêta / réserves de disponibilité) et de grandes améliorations en robustesse agentique, compréhension de documents et codage. Anthropic a fait de Sonnet 4.6 le modèle Sonnet par défaut pour claude.ai et Claude Cowork sans augmenter le prix de Sonnet.

Caractéristiques clés du produit

- Raisonnement hybride + fiabilité agentique : Sonnet 4.6 améliore le suivi d’instructions, la fiabilité des outils et les modes de pensée adaptatifs utilisés dans les pipelines agentiques. Cela améliore les performances sur des workflows multi-étapes et des approches multi-agents orchestrées (compactage de contexte + sous-agents).

- Contexte 1M tokens (bêta) : Anthropic prend en charge 1M de contexte pour plusieurs tâches et documents internes, et publie des résultats à la fois pour les variantes publiques de l’API <1M et des évaluations internes >1M — avec des méthodes de compactage de contexte pour étendre la capacité effective au-delà de la fenêtre brute.

- Continuité des prix : Sonnet 4.6 conserve les tarifs précédents de Sonnet — $3 / 1M tokens en entrée et $15 / 1M tokens en sortie, ce qui le maintient attractif pour un usage de production à grande échelle.

Forces mesurées et éléments fournis par Anthropic

Anthropic a publié une fiche système Sonnet 4.6 et un billet de blog détaillant des évaluations internes et tierces :

- SWE-bench Verified (codage) : Sonnet 4.6 atteint 79.6% sur les résultats SWE-bench Verified rapportés par Anthropic — très solide sur des tâches réelles de développeur et des tests de résolution de tickets GitHub. (Remarque : les variantes SWE d’Anthropic et SWE-Bench Pro d’OpenAI ne sont pas nécessairement identiques — réserve ci-dessous.)

- BrowseComp : Sonnet 4.6 atteint 74.01% en test BrowseComp agent unique, et avec orchestration multi-agent (via compactage de contexte et sous-agents) 82.07% — démontrant que les configurations multi-agents de Sonnet peuvent égaler ou dépasser en pratique les résultats BrowseComp agent unique des concurrents. Anthropic rapporte aussi des bénéfices de scaling du calcul au moment de l’inférence.

Comparaison rapide : GPT-5.4 vs Claude Sonnet 4.6

Le tableau ci-dessous compare les spécifications techniques principales des deux modèles.

| Feature | GPT-5.4 | Claude Sonnet 4.6 |

|---|---|---|

| Developer | OpenAI | Anthropic |

| Release | March 2026 | February 2026 |

| Context Window | ~1.05M tokens | Up to ~1M tokens |

| Maximum Output | ~128K tokens | ~128K tokens |

| Modalities | Text, image, computer interaction | Text, image |

| Agent Capability | Native computer use | Tool-based automation |

| Architecture Focus | General AI agent | Safe reasoning AI |

| Best For | automation & agents | coding & reasoning |

| Reasoning style | chain-of-thought planning | adaptive reasoning |

GPT-5.4 se concentre sur l’autonomie agentique, tandis que Claude Sonnet 4.6 met l’accent sur un raisonnement structuré et un déploiement sûr.

Comparaison fonctionnelle et technique

1. Fenêtre de contexte (quantité que le modèle « voit » en une fois)

- GPT-5.4 : Les notes publiques d’OpenAI et la presse indiquent une prise en charge de très grandes fenêtres de contexte (OpenAI a mis en avant jusqu’à 1M tokens dans certaines variantes et notes d’intégration), avec des niveaux produit qui échangent contexte, latence et coût. Des informations précoces suggèrent une offre 400k courante sur les parcours dev et des fenêtres plus élevées en bêta pour Pro/Enterprise.

- Claude Sonnet 4.6 : Anthropic a explicitement annoncé une prise en charge bêta d’une fenêtre de contexte d’un million de tokens dans sa ligne Sonnet/Opus 4.6, positionnant le raisonnement à long horizon comme un objectif de conception central. La revendication de la famille Sonnet se concentre sur une chaîne de pensée soutenue sur de longs documents et des traces d’agents.

Effet pratique : Lorsque votre tâche consiste à raisonner sur des bases de code multi-fichiers, des contrats juridiques couvrant des mois, ou des lacs de données textuelles non structurées, la taille de la fenêtre de contexte améliore matériellement l’exactitude, réduit le besoin d’ingénierie de récupération manuelle et permet des workflows conversationnels qui référencent de longues historiques. Mais des fenêtres plus grandes impliquent des compromis d’ingénierie — latences plus longues, coût d’inférence plus élevé et complexité d’audit.

2. Utilisation native de l’ordinateur et capacités d’agent

- GPT-5.4 : Une capacité phare est « l’usage d’ordinateur intégré » — le modèle peut générer du code qui interagit avec l’OS hôte ou des applications (via Playwright et des chaînes d’outils similaires), émettre des commandes UI à partir de captures d’écran et orchestrer des flux d’automatisation multi-étapes. OpenAI présente cela comme permettant des agents autonomes capables d’exécuter des logiciels plutôt que de simplement produire du code.

- Claude Sonnet 4.6 : Sonnet 4.6 améliore la planification et la persistance des agents : planification à horizon plus long, meilleure gestion de l’état interne et sélection d’outils améliorée. Anthropic met l’accent sur la fiabilité des agents (maintenir des workflows multi-étapes), pas seulement l’automatisation brute.

Effet pratique : Pour des workflows lourds en automatisation (par ex., « scraper, analyser, rédiger un rapport, soumettre un ticket »), l’orientation usage d’ordinateur native de GPT-5.4 peut permettre des prototypages d’agents plus rapides. L’accent de Sonnet 4.6 sur la planification délibérative peut réduire les modes d’échec dans des chaînes agentiques plus longues — utile lorsque l’auditabilité et la justesse pas à pas sont primordiales.

GPT-5.4 gère les captures d’écran, les entrées souris et clavier, et les workflows multi-étapes à un niveau de pointe. C’est l’une des différences les plus importantes évoquées dans cet article pour les opérations, les tests, l’automatisation de navigateur et les tâches entre applications.

3. Programmation et génie logiciel

- GPT-5.4 : Mises à niveau de Codex et un « /fast mode » pour accélérer le débit de tokens et les boucles de retour développeur ; présenté comme plus fort sur les tâches de développement multi-étapes et l’intégration avec des plateformes comme GitHub Copilot et VS Code. Les premières intégrations montrent Copilot permettant l’assistance GPT-5.4 dans les IDE grand public.

- Claude Sonnet 4.6 : Anthropic se concentre sur la compression de projets de plusieurs jours en heures, l’amélioration du débogage, de la revue de code et de l’auto-correction. Anthropic souligne également une meilleure gestion de grandes bases de code et moins d’API hallucinées dans les tests unitaires.

Effet pratique : Les deux modèles accélèrent significativement les workflows développeur. Le choix dépend de l’intégration (votre stack, Copilot vs SDK Anthropic), de la latence/du coût à l’échelle, et du modèle qui s’aligne avec vos attentes de justesse sous contraintes adverses ou critiques pour la sécurité.

4. Travail de connaissance, documents et productivité bureautique

- GPT-5.4 : OpenAI a orienté GPT-5.4 vers les documents, feuilles de calcul et présentations ; l’entreprise a déployé des intégrations ChatGPT pour Excel et Sheets permettant au modèle d’exécuter des tâches complexes de modélisation financière. L’argument : permettre aux analystes d’automatiser des modèles à trois états, d’extraire des tableaux structurés et de générer des slides directement à partir de données brutes.

- Claude Sonnet 4.6 : Anthropic met l’accent sur la synthèse long-contexte et la planification pour le travail de connaissance — meilleur pour soutenir des arguments multi-parties à travers de longs documents et produire des sorties structurées pour des workflows juridiques, de recherche et de politique.

Effet pratique : Si votre entreprise a besoin d’automatisation de feuilles de calcul et d’intégrations étroites avec les suites de productivité Microsoft/Google, les modules complémentaires annoncés par OpenAI accélèrent l’adoption. Si votre besoin est l’analyse médico-légale sur de longs textes juridiques ou de recherche, les revendications long-contexte de Sonnet sont convaincantes.

5. Prise en charge multimodale

- GPT-5.4 : principalement promu comme un modèle d’abord textuel avec une gestion robuste des documents et feuilles de calcul ; la prise en charge de l’input image est notée dans certaines variantes de la série GPT-5, mais l’accent de GPT-5.4 porte sur le texte + les intégrations d’outils (et les fonctionnalités Codex orientées développeurs pour l’utilisation programmatique d’outils).

- Claude Sonnet 4.6 : Anthropic met en avant le texte, le codage et la planification d’agent. Sonnet 4.6 est décrit comme très capable en « utilisation d’ordinateur » (interactions GUI simulées, invocation automatique d’outils) et planification de sessions longues ; les revendications multimodales sont moins centrales que les forces de raisonnement/agent du modèle.

À retenir en pratique : Pour les workflows nécessitant médias mixtes (images + texte), les acheteurs doivent valider la prise en charge des modalités dans le niveau d’API spécifique qu’ils prévoient d’utiliser. Pour les workflows très axés texte, multi-fichiers et feuilles de calcul, les deux modèles privilégient des encodages et stratégies de compactage qui rendent le long contexte tractable.

Côte à côte : comparaison de capacités et benchmarks

Vous trouverez ci-dessous des points de données concis et directement comparables tirés des pages publiées par les fournisseurs et des fiches système. Les principales réserves sont incluses en ligne.

Navigation / recherche web (BrowseComp)

- GPT-5.4 (OpenAI) — 82.7% BrowseComp. (OpenAI : BrowseComp 82.7% dans les documents de sortie GPT-5.4.)

- Claude Sonnet 4.6 (Anthropic) — 74.01% BrowseComp agent unique ; 82.07% BrowseComp multi-agents lorsqu’exécuté avec un orchestrateur + sous-agents / compactage de contexte (Anthropic rapporte les deux valeurs et explique l’avantage multi-agents). Anthropic rapporte également un scaling du calcul au moment de l’inférence (par ex., 64.69% @1M tokens échantillonnés montant vers 74% à des totaux échantillonnés plus élevés).

Codage et travail développeur (SWE/Terminal)

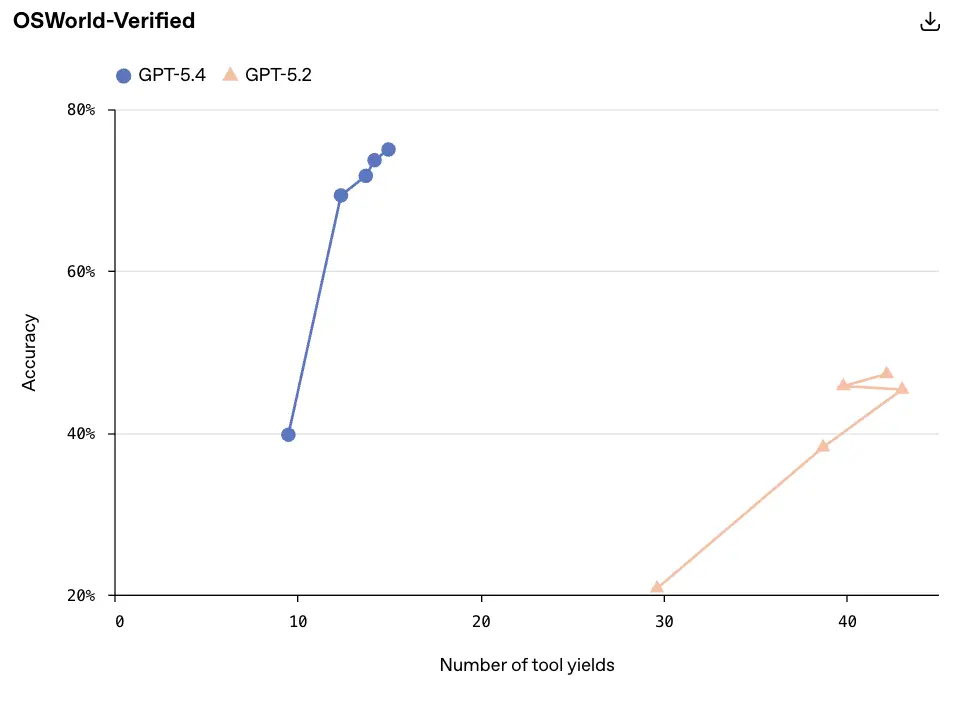

Tests de type SWE : Anthropic rapporte Sonnet 4.6 à 79.6% sur SWE-Bench Verified (leur sous-ensemble de codage vérifié et validé par des humains). OpenAI rapporte GPT-5.4 à 57.7% sur SWE-Bench Pro (la variante pro publique d’OpenAI). Ces résultats montrent Sonnet très fort sur la variante SWE choisie par Anthropic. Réserve importante : les jeux de données SWE et les protocoles d’évaluation diffèrent selon les fournisseurs ; la comparaison numérique directe doit être interprétée avec prudence.

Travail professionnel / de connaissance (GDPval / GDPval-AA / OfficeQA)

- OpenAI (GPT-5.4) — GDPval 83.0% (la métrique GDPval d’OpenAI sur 44 professions ; OpenAI indique que cela égale ou dépasse des professionnels de l’industrie dans 83% des comparaisons par paires). OpenAI rapporte également de très forts gains en feuilles de calcul/préparation de présentations (par ex., score moyen 87.3% sur des tâches internes de banque d’investissement vs 68.4% pour GPT-5.2).

- Anthropic (Sonnet 4.6) — Anthropic rapporte de bonnes performances sur ses évaluations internes finance/OfficeQA et Real-World Finance ; Sonnet égale Opus 4.6 sur OfficeQA et affiche des taux élevés d’achèvement de tâches dans les évaluations finance internes ; Anthropic rapporte Sonnet 4.6 à 89.9% sur GPQA Diamond et d’autres scores élevés sur des tests de domaine. Ce sont des signaux forts que Sonnet est très capable sur des tâches documentaires d’entreprise.

Tableau comparatif fondé sur des données

| Dimension | GPT-5.4 (OpenAI) | Claude Sonnet 4.6 (Anthropic) |

|---|---|---|

| BrowseComp (vendor reported) | 82.7% (base) / 89.3% (Pro, certains réglages). | 74.01% (agent unique) → 82.07% (multi-agents). |

| Coding (vendor VAR) | SWE-Bench Pro ~57.7% (rapporté par OpenAI). | SWE-bench Verified ~79.6% (rapporté par Anthropic). |

| Pricing (input/output per 1M tokens) | ~$2.50 / $15 (exemples de liste de base). | $3 / $15 ; fort cache et économies par lot. |

| 1M token context | Expérimental via Codex/dev ; déploiement ChatGPT variable. | Bêta 1M de contexte + stratégies de compactage. |

| Safety posture | Amélioration de la factualité (↓33% d’affirmations fausses vs GPT-5.2). Refus/achèvement équilibrés. | Très conservateur sur de nombreux segments sécurité (chiffres fiche système). |

Comparaison des prix

La tarification est l’un des facteurs les plus importants pour les organisations déployant l’IA à grande échelle.

Tarification API

| Pricing | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|

| Input tokens | $2.50 / 1M | $15 / 1M |

| Output tokens | $3/ 1M | $15 / 1M |

GPT-5.4 est légèrement moins cher sur les tokens d’entrée.

Cette différence devient significative pour des charges de travail à haut volume telles que :

- automatisation d’entreprise

- pipelines d’analyse de données

- génération de code à grande échelle

Tarification des abonnements

Les deux plateformes proposent des paliers d’abonnement similaires.

| Plan | ChatGPT | Claude |

|---|---|---|

| Standard | $20/month | $20/month |

| Premium | $200/month | $200/month |

Au niveau abonnement, la parité des prix signifie que la vraie différence de coût apparaît principalement dans l’usage API.

À la recherche du meilleur coût : accédez à GPT-5.4 et Opus 4.6 via CometAPI.

Si votre workflow nécessite à la fois GPT-5.4 et Claude 4.6 (chacun avec ses propres caractéristiques), payer des fournisseurs différents séparément peut être coûteux et lourd. C’est là que la plateforme d’agrégation multi-modèles de CometAPI devient stratégique.

La philosophie de CometAPI est simple : au lieu de maintenir plusieurs comptes officiels pour comparer les sorties, les utilisateurs peuvent accéder aux modèles leaders sur une seule plateforme, passer rapidement de l’un à l’autre et évaluer les workflows côte à côte. Elle offre également 20% de remise API et une tarification à l’usage sans abonnement.

Forces et faiblesses

Où GPT-5.4 l’emporte

Avantages :

- capacités d’automatisation supérieures

- meilleur codage en terminal

- coût API plus faible

- meilleures performances sur les tâches de travail de connaissance

- intelligence générale plus large

Idéal pour :

- startups

- systèmes d’automatisation

A* outils développeur - assistants de recherche

Où Claude Opus 4.6 l’emporte

Avantages :

- profondeur de raisonnement plus forte

- scores de benchmark de codage parmi les meilleurs de leur catégorie

- meilleure récupération en grand contexte

- outils de collaboration multi-agents

Idéal pour :

- équipes de logiciels d’entreprise

- ingénierie d’infrastructure

- environnements de recherche

L’avenir : des workflows multi-modèles

Une tendance importante de l’industrie émerge.

Plutôt que de choisir un seul modèle d’IA, de nombreuses équipes utilisent désormais plusieurs modèles simultanément.

Exemple de workflow :

- GPT-5.4 → automatisation et analyse de données

- Claude Opus 4.6 → codage approfondi et architecture

- autres modèles → tâches spécialisées

Cette architecture de routage de modèles permet aux équipes de maximiser les forces tout en minimisant les faiblesses.

Verdict final

GPT-5.4 et Claude Sonnet 4.6 comptent parmi les modèles d’IA les plus puissants disponibles en 2026. GPT-5.4 excelle en automatisation agentique et workflows intégrés, tandis que Claude Sonnet 4.6 offre des capacités de raisonnement efficaces et extensibles avec une tarification compétitive.

Les développeurs peuvent accéder aux API GPT-5.4, GPT-5.4-pro et Claude Sonnet 4.6 via CometAPI dès maintenant. Pour commencer, explorez les capacités des modèles dans le Playground et consultez le guide API pour des instructions détaillées. Avant d’y accéder, assurez-vous de vous connecter à CometAPI et d’obtenir la clé API. CometAPI propose un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à commencer ? → Inscrivez-vous à GPT-5.4 et Claude 4.6 dès aujourd’hui !

Si vous souhaitez en savoir plus sur des astuces, guides et actualités IA, suivez-nous sur VK, X et Discord !

%20.webp&w=3840&q=75)