Fonctionnalités clés (liste rapide)

- Deux variantes de modèle :

grok-4-fast-reasoningetgrok-4-fast-non-reasoning(réglables pour privilégier la profondeur ou la vitesse). - Très grande fenêtre de contexte : jusqu’à 2 000 000 tokens, permettant de traiter des documents extrêmement longs / des transcriptions de plusieurs heures / des flux de travail multi-documents.

- Efficacité en tokens / accent sur les coûts : xAI indique environ 40 % de tokens de réflexion en moins en moyenne par rapport à Grok-4, ainsi qu’une réduction d’environ 98 % du coût pour atteindre les mêmes performances de benchmark (selon les métriques communiquées par xAI).

- Intégration native des outils / de la navigation : entraîné de bout en bout avec un RL d’utilisation d’outils pour la navigation web/X, l’exécution de code et les comportements de recherche agentique.

- Multimodal & appel de fonctions : prend en charge les images et les sorties structurées ; l’appel de fonctions et les formats de réponse structurés sont pris en charge dans l’API.

Détails techniques

Architecture de raisonnement unifiée : Grok-4-Fast utilise une base de poids de modèle unique qui peut être orientée vers un comportement de raisonnement (longue chaîne de pensée) ou de non-raisonnement (réponses rapides) via des prompts système ou la sélection de variante, au lieu de proposer deux modèles dorsaux entièrement distincts. Cela réduit la latence de basculement et le coût en tokens pour les charges de travail mixtes.

Apprentissage par renforcement pour la densité d’intelligence : xAI indique utiliser un apprentissage par renforcement à grande échelle axé sur la densité d’intelligence (maximiser les performances par token), ce qui constitue la base des gains annoncés en efficacité de tokens.

Conditionnement aux outils et recherche agentique : Grok-4-Fast a été entraîné et évalué sur des tâches nécessitant l’invocation d’outils (navigation web, recherche X, exécution de code). Le modèle est présenté comme compétent pour choisir quand appeler des outils et comment intégrer les éléments issus de la navigation dans les réponses.

Performances de benchmark

Améliorations dans BrowseComp (44,9 % pass\@1 contre 43,0 % pour Grok-4), SimpleQA (95,0 % contre 94,0 %), ainsi que d’importants gains dans certains domaines chinois de navigation/recherche. xAI signale également une première place dans la Search Arena de LMArena pour une variante grok-4-fast-search.

Cas d’usage typiques et recommandés

- Recherche et récupération à haut débit — agents de recherche nécessitant un raisonnement web multi-sauts rapide.

- Assistants et bots agentiques — agents qui combinent navigation, exécution de code et appels d’outils asynchrones (lorsque cela est autorisé).

- Déploiements de production sensibles aux coûts — services nécessitant de nombreux appels et souhaitant une meilleure efficacité entre tokens consommés et utilité qu’avec un modèle de base plus lourd.

- Expérimentation pour développeurs — prototypage de flux multimodaux ou enrichis par le web reposant sur des requêtes rapides et répétées.

- Comment accéder à l’API Grok 4 fast

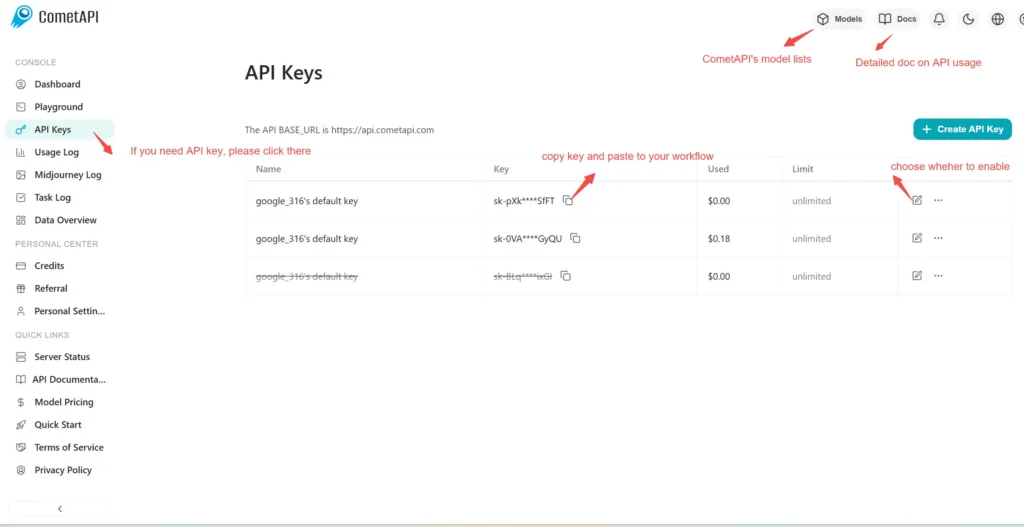

Étape 1 : S’inscrire pour obtenir une clé API

Connectez-vous à cometapi.com. Si vous n’êtes pas encore utilisateur, veuillez d’abord vous inscrire. Connectez-vous à votre console CometAPI. Obtenez la clé API d’accès à l’interface. Cliquez sur « Add Token » dans la section API token du centre personnel, obtenez la clé de jeton : sk-xxxxx et validez.

Étape 2 : Envoyer des requêtes à l’API Grok 4 fast

Sélectionnez le point de terminaison « \grok-4-fast-reasoning/ grok-4-fast-non-reasoning\ » pour envoyer la requête API et définissez le corps de la requête. La méthode de requête et le corps de requête sont disponibles dans la documentation API de notre site web. Notre site web fournit également un test Apifox pour votre commodité. Remplacez <YOUR_API_KEY> par votre clé CometAPI réelle issue de votre compte. L’URL de base est au format Chat(https://api.cometapi.com/v1/chat/completions).

Insérez votre question ou votre demande dans le champ content — c’est à cela que le modèle répondra. Traitez la réponse API pour obtenir la réponse générée.

Étape 3 : Récupérer et vérifier les résultats

Traitez la réponse API pour obtenir la réponse générée. Après traitement, l’API renvoie le statut de la tâche et les données de sortie.