TL;DR : La dernière version d’OpenClaw ajoute une prise en charge native, compatible avec les versions futures, de GPT-5.4 d’OpenAI et introduit une architecture « mémoire interchangeable à chaud » permettant aux agents OpenClaw de changer le modèle et le magasin de mémoire actifs à l’exécution avec une perturbation minimale. Cela débloque des flux de travail à grand contexte (fenêtres de contexte étendues de GPT-5.4), une spécialisation de modèle à la volée, ainsi que des optimisations de coût/latence pour les agents en production. La mise à niveau est disponible dans les versions et la documentation d’OpenClaw ; les exemples ci-dessous montrent une configuration pratique, des extraits de code, un contexte de benchmark et des bonnes pratiques recommandées.

Ce que la mise à jour d’OpenClaw a réellement livré (résumé rapide)

Le 9 mars 2026, le projet open source adjacent à OpenAI, OpenClaw, a publié une version majeure du cœur (2026.3.7) qui ajoute une prise en charge native de GPT-5.4 et un mécanisme inédit de mémoire « interchangeable à chaud » dans son moteur de contexte. Cette version convertit un framework d’agents expérimental largement utilisé en ce que les mainteneurs décrivent comme un « Agent Operating System » — visant à rendre fluides les flux de travail d’agents de niveau production et le basculement de modèles pour les développeurs et les équipes.

3 points pratiques qui comptent pour les créateurs d’agents :

- Prise en charge native de GPT-5.4 — alias de modèles et mappages de fournisseurs permettant aux agents de sélectionner GPT-5.4 comme modèle d’exécution principal (y compris les surcharges par canal et les épingles de modèle par agent).

- Moteur de contexte et liaison de canaux distribués — améliorations dans la manière dont OpenClaw assemble de longs contextes à partir de la mémoire, des sorties d’outils et de l’historique des canaux afin que les modèles à grande capacité reçoivent des entrées bien structurées.

- Architecture de mémoire interchangeable à chaud — interfaces de plugin mémoire plus claires et workflows permettant de remplacer les backends mémoire ou de mettre à niveau les agents sans perdre « l’identité » ni corrompre l’état persistant (la mémoire elle-même reste la source de vérité). La conception mémoire d’OpenClaw (fichiers Markdown simples, recherche indexée, récupération via plugins) permet un échange à chaud sécurisé.

GPT-5.4 — Ce qu’est GPT-5.4 et percées des benchmarks

GPT-5.4 est la dernière version de modèle de pointe d’OpenAI axée fortement sur la productivité professionnelle (tableurs, édition de documents et présentations, raisonnement multi-étapes et pilotage d’outils). Selon OpenAI et la presse indépendante, cette version met l’accent sur :

- Contexte étendu : GPT-5.4 introduit le prochain niveau de fenêtres de contexte, avec des options expérimentales à 1M de tokens et une meilleure gestion du long contexte disponibles via des endpoints Codex/compatibles Codex — des paramètres de configuration comme

model_context_windowetmodel_auto_compact_token_limitsont exposés aux développeurs. Cela permet de conserver un état de conversation, des documents et des bases de code bien plus volumineux dans le contexte actif. - Meilleure précision sur tableurs et raisonnement — OpenAI rapporte une amélioration majeure sur des tâches de modélisation de tableurs (scores moyens ~87 % contre ~68 % pour GPT-5.2 sur leur benchmark bancaire/analyste).

- Améliorations de l’exactitude et de la factualité : les premiers retours et QA montrent ~33 % de réduction des hallucinations et moins de sorties sujettes aux erreurs par rapport à GPT-5.2, avec des gains notables pour la rédaction de documents et le travail sur tableurs. Les testeurs ont également cité une baisse d’environ 18 % des réponses sujettes aux erreurs sur certaines tâches de productivité.

- Capacités d’utilisation d’ordinateur intégrées et améliorations issues de la lignée Codex — GPT-5.4 inclut des capacités héritées de la lignée Codex améliorant la génération de code, le débogage interactif et le pilotage opérationnel d’outils (automatisation souris/clavier/capture d’écran dans certaines démonstrations). Cela le rend meilleur dans le cycle écrire-exécuter-inspecter-corriger typique des boucles d’agents.

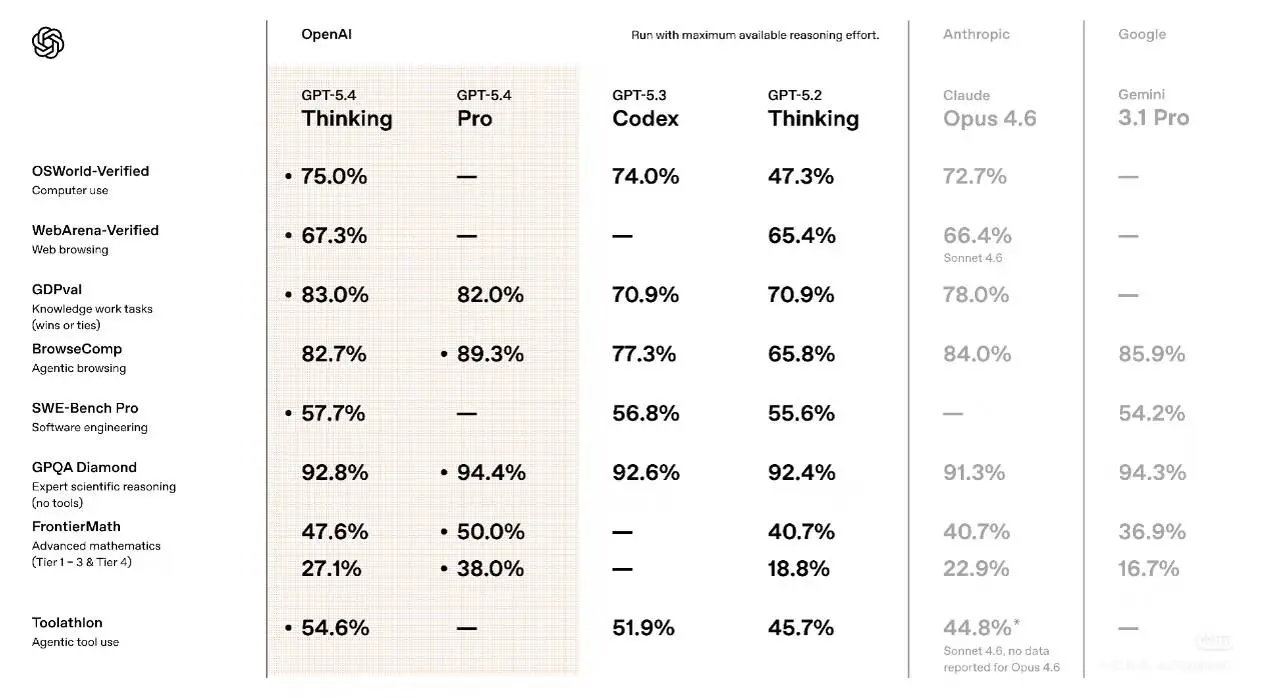

Benchmarks et contexte comparatif (ce que signifient les chiffres)

- Modélisation de tableurs : benchmark interne d’OpenAI pour tableurs : ~87,3 % de score moyen pour GPT-5.4 contre ~68,4 % pour GPT-5.2. C’est le fait marquant utilisé par l’éditeur pour illustrer les gains spécifiques à la tâche.

- Interaction informatique (OSWorld/tests de type agent) : des testeurs indépendants et des exécutions communautaires montrent que GPT-5.4 progresse sur des tâches d’interaction agent impliquant la manipulation d’un bureau ou d’une UI simulée, surpassant parfois de peu des variantes récentes de modèles Anthropic sur ces suites (écarts significatifs pour les agents, mais pas forcément décisifs pour toute charge).

Interprétation : GPT-5.4 n’est pas une « solution miracle » qui gagne partout. Il a des forces claires en utilisation d’outils intégrée, en motifs d’exécution de code et en raisonnement sur tableurs — exactement les charges que les agents OpenClaw exécutent souvent. Pour les concepteurs d’agents, la combinaison de fiabilité améliorée en exécution (lignée Codex) + compétence de planification + meilleure gestion du long contexte est très pertinente.

OpenClaw prend en charge GPT-5.4 : ce qui a changé et pourquoi c’est important

La version d’OpenClaw (voir la page des releases du projet) met à jour les résolveurs de modèles et le runtime pour être compatibles avec les versions futures des limites de contexte et de tokens de GPT-5.4 et ajoute la capacité de « mémoire interchangeable à chaud » afin que les agents puissent changer de backend mémoire ou de modèles à l’exécution. Cela se fait de trois manières concrètes : 1) mises à jour des métadonnées de modèle et du résolveur pour accepter des limites de contexte et de tokens plus grandes ; 2) changements du runtime de l’agent pour orchestrer des échanges de modèles en douceur et un préchauffage du cache ; 3) une API mémoire autorisant plusieurs canaux de mémoire et des déclencheurs de bascule à chaud.

La version 2026.3.7 avec prise en charge de GPT-5.4 et un design de mémoire interchangeable à chaud apporte deux avantages pratiques et complémentaires :

- Chemin de mise à niveau de modèle simple. OpenClaw peut désormais présenter GPT-5.4 comme un « runtime » sélectionnable pour les agents, vous permettant de passer d’anciens modèles GPT-5.x ou de fournisseurs alternatifs sans remanier votre logique d’agent. La mise à jour OpenClaw déclare explicitement une intégration GPT-5.4 stable dans le cœur.

- Mémoire interchangeable à chaud. Au lieu de persister un instantané mémoire linéaire unique, le Moteur de Contexte d’OpenClaw permet de détacher, échanger ou migrer des partitions de mémoire à l’exécution — par ex., insérer un shard de base vectorielle à haut rappel pour le débogage ou basculer vers une variante mémoire conforme RGPD pour des audits externes — sans arrêter l’agent. Cela réduit le risque de perturbation en production et permet des configurations mémoire adaptées aux cas d’usage (débogage vs confidentialité vs performance).

percées de performance pratiques et avantages

L’intégration d’OpenClaw se concentre sur trois domaines pratiques où GPT-5.4 excelle :

- Fidélité d’orchestration des outils. La recherche d’outils interne et le raisonnement améliorés de GPT-5.4 réduisent l’agitation des appels d’outils (moins d’appels redondants et moins de retries). Cela se traduit par moins d’appels API et des achèvements plus rapides pour les flux complexes. Les premiers retours indiquent des améliorations d’efficacité en tokens et en appels d’outils par rapport aux anciens modèles GPT-5.x.

- Gestion de contextes plus longs et plus riches. Les agents OpenClaw peuvent désormais conserver des contextes actifs bien plus volumineux (y compris des shards mémoire échangés), leur permettant de gérer de longues conversations, des projets multi-fichiers et un débogage itératif sans perdre l’état.

- Sorties de code plus déterministes. Pour les flux qui génèrent du code automatiquement (hooks CI, squelettes de fonctions, templates d’infrastructure), GPT-5.4 produit généralement des sorties plus cohérentes et exécutables, réduisant la charge de relecture humaine. Des tests indépendants montrent des améliorations notables des métriques de qualité de code par rapport aux modèles GPT-5 précédents.

- Continuité de la mémoire — la « mémoire interchangeable à chaud » vous permet de remplacer ou d’augmenter les magasins de mémoire (cache local, base vectorielle, mémoire LLM) sans perdre l’état ni le contexte de l’agent, permettant A/B tests, mises à niveau progressives et basculement.

Dans le test de benchmark OOLONG, la nouvelle version d’OpenClaw, conjointement avec le plugin lossless-claw, a atteint un score élevé de 74.8, laissant Claude Code (70.3 points) loin derrière. En particulier, OpenClaw a démontré stabilité et précision à mesure que la longueur de contexte augmentait, amenant les ingénieurs effectuant les tests sur site à s’exclamer que « dire que ça tourne bien est trop conservateur ».

Comment configurer et utiliser GPT-5.4 dans OpenClaw (étape par étape)

Un workflow OpenClaw simple utilisant GPT-5.4 :

- Une configuration typique est présentée ci-dessous :

- Les utilisateurs envoient des messages via des plateformes comme Discord ou Telegram.

- OpenClaw reçoit les messages via son serveur passerelle.

- La passerelle transfère les prompts à GPT-5.4 via le fournisseur d’API d’IA.

- GPT-5.4 génère une réponse ou déclenche une action d’outil.

- OpenClaw renvoie le résultat final à l’utilisateur.

Ci-dessous des exemples de configuration pragmatiques, prêts à copier-coller, et des workflows pour exécuter GPT-5.4 dans OpenClaw de manière sûre et reproductible. Ceux-ci sont volontairement conservateurs : activez d’abord le modèle dans un agent de test et instrumentez tout pour les métriques et erreurs.

Prérequis

- OpenClaw mis à niveau vers la version qui inclut les mappages GPT-5.4 (voir les notes de version mentionnées ci-dessus).

- Clé API OpenAI valide avec accès à GPT-5.4 (je choisis l’endpoint CometAPI avec un prix plus bas).

1) Sélection du modèle et configuration du résolveur (Json/YAML/CLI)

Placez ceci dans ~/.openclaw/openclaw.json (ou fusionnez-le dans votre config existante). Ajustez le nom du fournisseur et la référence de jeton selon votre environnement.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw utilise un résolveur de modèles pour mapper des noms de modèles logiques (par ex., openai/gpt-5.4) vers des endpoints et une configuration runtime. Ajoutez ou mettez à jour votre fichier de résolveur (exemple models.yml) :

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Ou définissez-le à l’exécution via le CLI :

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Remarque :

context_windowetmax

Notes

agents.defaults.model.primarychoisit le modèle par défaut. Utilisezchannels.modelByChannelpour des surcharges par canal afin d’acheminer les canaux à fort impact vers GPT-5.4 et les canaux moins exigeants vers des modèles moins coûteux. Voir la documentation de sélection de modèle d’OpenClaw pour la sémantique d’ordre.- Veuillez consulter la page modèle CometAPI pour les noms de modèles spécifiques. Si vous souhaitez utiliser OpenAI, remplacez l’URL et la clé API par celles d’OpenAI.

- Les clés

context_windowetmax_output_tokensreflètent les changements de compatibilité future du résolveur d’OpenClaw afin que l’agent n’essaie pas d’utiliser d’anciennes limites Codex.

2) Comment activer et tester la « mémoire interchangeable à chaud »

Le sous-système mémoire d’OpenClaw est basé sur des fichiers (fichiers Markdown) plus des indexeurs/plugins de recherche, ce qui vous permet d’échanger en toute sécurité les plugins de backend (par ex., vecteur SQLite, Milvus, ou services mémoire externes) sans perdre les fichiers mémoire bruts.

Un schéma courant :

- Standardiser l’emplacement de la mémoire : utiliser un workspace versionné par git :

~/.openclaw/workspace/oùMEMORY.mdetmemory/YYYY-MM-DD.mdfont foi. - Installer et configurer un plugin mémoire (exemple : sqlite-vec) et pointer

plugins.slots.memoryvers celui-ci dans la configuration. - Tester la migration : ajouter un nouveau plugin, exécuter un job d’indexation en shadow, comparer les résultats de récupération, puis basculer l’alias

plugins.slots.memoryvers le nouveau plugin une fois satisfait.

Exemple d’échange d’alias de plugin (pseudo-commandes bash) :

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Pourquoi c’est « interchangeable à chaud » : les fichiers mémoire restent la source de vérité. Les plugins implémentent les couches d’indexation et de récupération ; les échanger réindexe mais ne modifie pas les fichiers .md sous-jacents. Cela permet des échanges de modèles sans dérive catastrophique d’identité — l’agent lit toujours les mêmes MÉMOIRES.

3) Exemple : épingler un agent individuel sur GPT-5.4 (surcharge par agent)

Vous pouvez surcharger les modèles par agent ; ajoutez une entrée d’agent comme :

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Si la version communautaire ou votre version particulière d’OpenClaw exige le CLI, vous pouvez aussi définir un modèle par session à l’exécution :

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Conseil opérationnel : l’épinglage assure un comportement déterministe pour cet agent pendant que vous exécutez des tests A/B sur d’autres.

Si vous souhaitez utiliser OpenAI, remplacez l’URL et la clé API par celles d’OpenAI.

4) Utiliser les options de contexte 1M de Codex (paramètres API)

Si votre déploiement OpenClaw accède directement aux endpoints OpenAI Codex, passez des options de contexte :

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Les requêtes dépassant les fenêtres de contexte standard peuvent être comptabilisées à des taux d’usage différents (la documentation OpenAI mentionne un double comptage pour les requêtes au-delà des fenêtres standard en aperçu Codex).

Bonnes pratiques : maximiser les forces de GPT-5.4 dans OpenClaw

Coût, latence et panachage de modèles

- Stratégie de modèle hybride : utilisez un modèle plus petit et moins cher pour les requêtes courtes et le traitement en flux ; basculez à chaud vers GPT-5.4 pour l’analyse lourde, la synthèse et la génération de code nécessitant un long contexte. Cela réduit le coût total en tokens tout en préservant la qualité. (Implémentez via des déclencheurs dans la configuration mémoire ci-dessus.)

- Compactage des tokens et augmentation par récupération : utilisez des pipelines à récupération augmentée pour limiter les tokens envoyés au modèle — stockez les longs documents dans une base vectorielle, récupérez les segments pertinents et n’incluez que les morceaux les plus pertinents plus un plan compact. La recherche d’outils de GPT-5.4 aide ici en localisant automatiquement des outils ou documents utiles.

- Préchauffage et cold start : après un échange de modèle, préchauffez le modèle avec une courte exécution de « priming » de contexte pour éviter des pics de latence sur la première requête. Précompilez tout template de prompt et réhydratez les canaux mémoire critiques. La stratégie de rolling d’OpenClaw (voir la configuration) prend en charge le préchauffage.

Fiabilité et sécurité

- Repli en douceur : implémentez des timeouts et des plans de repli (par ex., dégrader vers une réponse mise en cache d’une session précédente) pour gérer des limites de débit API ou erreurs de quota.

- Couches de sécurité : maintenez des filtres de politique et une étape de vérification lorsque les sorties influencent des décisions. GPT-5.4 réduit statistiquement les hallucinations, mais la vérification reste importante pour les tâches à forts enjeux.

Évaluation et monitoring

- Reproduisez vos benchmarks : exécutez des tests face à face sur vos charges (complétion de code, refactorisation multi-fichiers, analyse de tableur) avec une grille standard. Les rapports publics indiquent des forces sur les tâches de tableur et de productivité — validez avec vos données.

- Télémétrie : surveillez la consommation de tokens, la latence du modèle, la fréquence des échanges mémoire et la qualité des réponses (notations humaines/tests automatisés). Utilisez la télémétrie pour affiner les seuils d’échange.

Exemple : agent de revue de code qui bascule à chaud

Objectif : exécuter une synthèse routine lint + tests unitaires lors d’un push (modèle économique) et escalader vers GPT-5.4 pour des suggestions de refactorisation multi-fichiers quand les tests échouent ou que les diffs dépassent 10 fichiers.

Flux (haut niveau) :

- Le déclencheur pre-commit exécute

local/fast-small-coderpour générer une synthèse lint. - Si

test_failures > 0oudiff_files > 10, déclencherhot_swapversopenai/gpt-5.4. Promouvoirlongterm_vectorcontenant l’historique du dépôt. - Exécuter un prompt GPT-5.4 contenant l’intégralité des traces d’échec + des fichiers de code pertinents intégrés au contexte. Générer un patch de refactorisation et des modifications de tests unitaires.

- Un réviseur humain évalue la sortie ; le feedback met à jour la mémoire.

Structure de prompt (envoyée à GPT-5.4 après récupération et compactage) :

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Ce cas d’usage illustre pourquoi un grand contexte + une mémoire interchangeable à chaud sont précieux : vous pouvez apporter l’intégralité de la trace d’échec et plusieurs fichiers dans le modèle simultanément. Implémentez des déclencheurs d’échange de manière conservatrice pour maîtriser les coûts.

Enfin : qui devrait adopter GPT-5.4 dans OpenClaw (et quand)

- Adoptez maintenant si vos agents exécutent des tâches code/outils multi-étapes, de l’automatisation lourde de tableurs ou une édition de documents complexe où les cycles itératifs écrire-exécuter-inspecter dominent le temps des développeurs. Les gains de productivité et de fiabilité sont les plus visibles ici.

- Adoptez avec prudence si vous opérez dans des canaux de chat volumineux sensibles aux coûts où un raisonnement plus simple suffit ; utilisez du routage pour préserver l’efficience des coûts.

- N’assumez pas la domination d’un seul modèle : benchmarkez sur vos données. GPT-5.4 est un candidat solide pour les charges d’agents, mais le choix de modèle doit être guidé par les preuves.

Les développeurs peuvent accéder à GPT-5.4 via CometAPI (CometAPI est une plateforme d’agrégation tout-en-un pour des APIs de grands modèles comme les APIs GPT, Nano Banana, etc.) dès maintenant. Pour commencer, explorez les capacités du modèle dans le Playground et consultez le guide d’intégration Openclaw pour des instructions détaillées. Avant d’y accéder, assurez-vous d’être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI offre un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à démarrer ? → Inscrivez-vous à OpenClaw dès aujourd’hui !

Si vous voulez plus d’astuces, de guides et d’actualités sur l’IA, suivez-nous sur VK, X et Discord !