Pengalaman developer dengan analisis video ChatGPT sering mentok: tautan YouTube langsung gagal, dan unggahan MP4 menghasilkan ringkasan “halusinasi” yang melewatkan nuansa visual. Ini bukan bug—ini batasan arsitektur. ChatGPT tidak melakukan streaming video; ia memproses urutan frame yang diekstrak dan teks transkrip. Jadi Anda mencoba mengunggah file MP4, yang berhasil… kurang lebih. Ringkasan menyebut transkrip audio tetapi sama sekali melewatkan lelucon visual di adegan ketiga yang membuat seluruh video masuk akal.

ChatGPT Bisa Menganalisis Video — Tapi Bukan dengan Benar-Benar “Menontonnya”

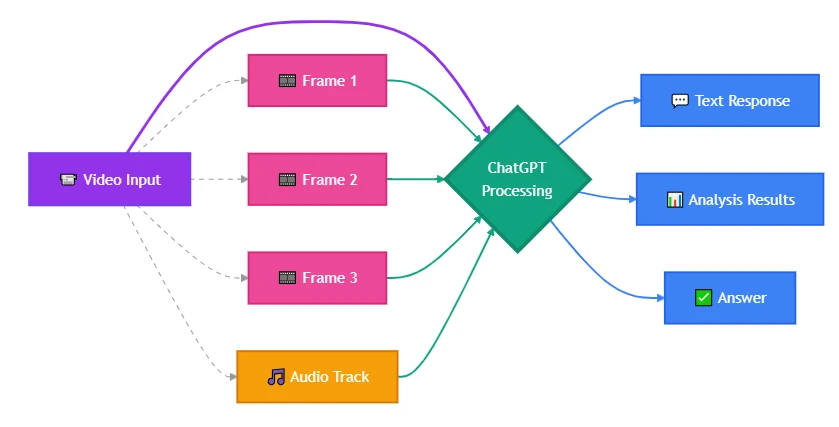

Begini yang sebenarnya terjadi: ChatGPT tidak “menonton” video seperti Anda. Ia tidak menekan play, melakukan streaming konten, dan mengamati gerak seiring waktu. Yang dilakukannya adalah memecah video menjadi komponen yang sudah dikuasainya — gambar diam dan transkrip teks — kemudian menalar kedua bagian itu secara terpisah. Model melihat video Anda sebagai album foto dengan narasi, bukan pengalaman kontinu. Itulah sebabnya ia menangkap penjelasan lisan namun melewatkan punchline visual: frame dengan lelucon itu mungkin tidak ada dalam set sampel.

Saat seseorang bertanya “bisakah ChatGPT menonton video,” biasanya yang dimaksud adalah salah satu dari dua hal: Bisakah ia melakukan streaming konten visual seperti pengamat manusia, atau bisakah ia mengekstrak dan menganalisis makna dari data video — adegan, dialog, timestamp, aksi di layar? Jawaban fungsionalnya ya untuk pertanyaan kedua, dengan batasan yang membuat kasus penggunaan tertentu gagal total. Varian ChatGPT modern memproses video dengan memperlakukannya sebagai frame yang diambil sampelnya digabung dengan transkripsi audio, baik melalui ekstraksi otomatis di antarmuka web maupun dengan menerima frame yang disediakan pengguna via API. Ini bekerja untuk peringkasan, deskripsi adegan, dan ekstraksi teks. Ini gagal untuk pelacakan gerak, analisis yang bergantung waktu, atau apa pun yang mengharuskan model “melihat” apa yang terjadi di antara frame.

Sebagian besar panduan berhenti pada konfirmasi bahwa kemampuan itu ada tanpa menjelaskan mengapa implementasi spesifik Anda tidak berhasil — atau metode input alternatif mana yang seharusnya digunakan.

ChatGPT Kemampuan Video: Apa yang Sebenarnya Dilihat Model

ChatGPT tidak memuat MP4 lalu menggesernya frame demi frame. Ia punya kemampuan visi — kemampuan menganalisis gambar statis — dan transkripsi audio melalui integrasi Whisper. Saat Anda mengirim video melalui antarmuka web atau aplikasi seluler ChatGPT, sistem mengekstrak keyframe, mentranskripsikan audio secara terpisah, lalu memberi keduanya ke model sebagai input yang berbeda. Model kemudian menggambarkan apa yang “dilihatnya” dalam frame-frame itu dan apa yang “didengarnya” dalam transkrip.

Dari perspektif Anda, ini terlihat seperti pemahaman video. Dari perspektif model, ini adalah analisis gambar plus pemrosesan teks. Distingsi arsitektural ini menentukan kasus penggunaan mana yang bekerja dan mana yang tidak.

Jika video Anda bergantung pada gerak, perubahan halus antar-frame, atau timing presisi — seperti mendeteksi kapan tepatnya sebuah objek memasuki frame, atau melacak bagaimana elemen UI dianimasikan — pendekatan berbasis keyframe akan meleset. ChatGPT tidak akan menangkap isyarat visual dua detik yang jatuh di antara frame yang disampel. Ia juga tidak akan melacak objek lintas waktu kecuali Anda secara eksplisit menyusun input untuk menunjukkan progresi.

Kemampuan video ChatGPT saat ini (per awal 2026):

- Analisis video berbasis gambar: Menerima file video atau frame yang diekstrak; menafsirkan konten visual dari gambar yang disampel

- Transkripsi audio: Mengonversi ucapan menjadi teks via Whisper; model kemudian dapat merangkum atau menelusuri transkrip

- Deskripsi adegan: Mengidentifikasi objek, aksi, lingkungan, dan teks yang terlihat di frame yang diberikan

- Kueri berbasis timestamp: Dapat merujuk momen spesifik jika Anda menyediakan timestamp frame atau membagi video secara manual

- Ekstraksi teks: Membaca caption di layar, label UI, atau dokumen yang terlihat dalam frame

Laju pengambilan sampel frame dan perilaku pemilihan keyframe otomatis di antarmuka web ChatGPT — tidak didokumentasikan secara publik per batas pengetahuan

Yang tidak termasuk:

- Input video streaming real-time melalui API

- Pelacakan gerak yang presisi atau persistensi objek lintas waktu

- Dukungan native untuk codec video — semua pemrosesan terjadi pada frame yang diekstrak dan audio

- Deteksi pergantian adegan otomatis tanpa permintaan eksplisit dari pengguna

Kapasitas video dibatasi oleh batas token dan ukuran file, bukan durasi. Meski 5–10 menit adalah heuristik praktis, batas sebenarnya berskala dinamis dengan kerapatan visual.

Jika kasus penggunaan Anda memerlukan kemampuan-kemampuan itu, Anda harus melakukan prapemrosesan video sendiri untuk mengekstrak frame yang tepat, atau beralih ke model dengan dukungan video native. Bagian berikut menguraikan metode input mana yang digunakan untuk skenario spesifik Anda.

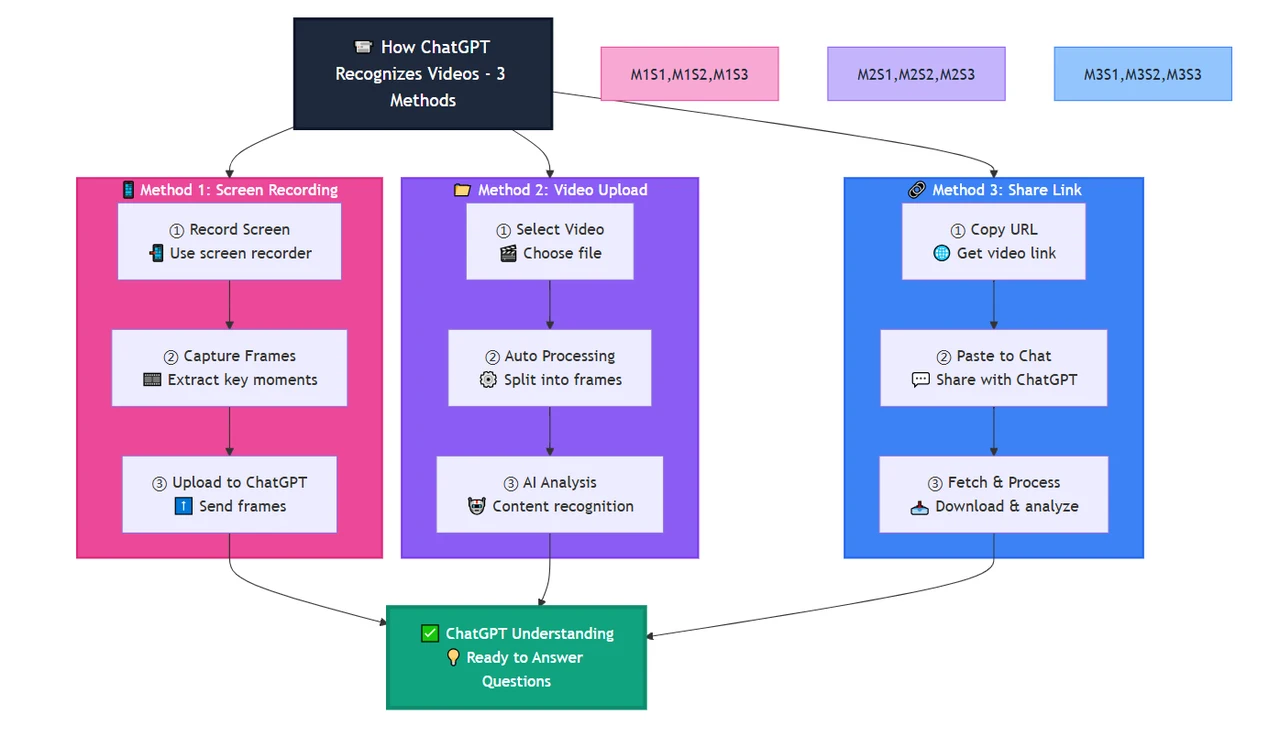

Bagaimana ChatGPT Mengenali Video: Tiga Metode Praktis

Tidak ada satu cara untuk mengirim video ke ChatGPT. Metode yang Anda pilih menentukan apa yang bisa dianalisis model dan apa yang akan terlewat. Sebagian besar kegagalan implementasi berasal dari memilih metode yang paling mudah, bukan yang paling tepat.

Metode 1: Ekstraksi frame manual + unggah gambar

Ekstrak frame sendiri menggunakan ffmpeg atau alat serupa, lalu unggah frame-frame spesifik itu sebagai gambar. Ini memberi Anda kontrol penuh atas apa yang dianalisis ChatGPT.

Contoh workflow(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Pendekatan ini memungkinkan Anda:

- Memfokuskan analisis pada momen spesifik (intro, aksi kunci, penutup) tanpa membuang konteks pada bagian yang tidak relevan

- Menangkap gerak dengan mengunggah frame berturut-turut pada laju sampling pilihan Anda

- Mengatasi batas ukuran file — gambar lebih kecil daripada file video penuh

- Mempertahankan kualitas frame yang mungkin menurun selama kompresi otomatis

Komprominya:

Anda menangani prapemrosesan sendiri. Untuk menganalisis ratusan video dalam skala besar, ini memerlukan otomasi. Untuk analisis mendalam satu kali atau debugging adegan tertentu, ini adalah metode paling andal.

Kapan menggunakan metode ini:

- Anda memerlukan analisis akurat per-frame pada momen tertentu

- Informasi visual krusial singkat atau terjadi di antara interval keyframe tipikal

- Anda membandingkan perubahan visual di sepanjang urutan (perubahan status UI, frame animasi)

- Anda ingin memverifikasi apa yang benar-benar “dilihat” model dengan memeriksa frame persis yang Anda unggah

Metode 2: Unggah file langsung via antarmuka ChatGPT

Aplikasi web ChatGPT dan aplikasi seluler menerima unggahan video langsung di chat. Seret file MP4 atau MOV ke kolom input, dan sistem akan menangani ekstraksi frame serta transkripsi secara otomatis.

Yang terjadi di balik layar:

- Layanan mengambil sampel frame pada interval (laju spesifik tidak didokumentasikan; diperkirakan 1–2 frame per detik berdasarkan perilaku yang diamati)

- Audio ditranskrip via Whisper atau layanan serupa

- Kedua output diberikan ke model sebagai input konteks terpisah

- Model menghasilkan respons berdasarkan frame yang terlihat dan transkrip yang didengar

Metode ini cocok untuk:

- Ringkasan video tingkat tinggi yang tidak memerlukan detail presisi per-frame

- Mengidentifikasi objek, orang, atau lingkungan kunci yang bertahan di beberapa adegan

- Mengekstrak konten ucapan atau teks di layar yang muncul di banyak frame

- Analisis eksploratif cepat tanpa prapemrosesan

Metode ini gagal untuk:

- Analisis presisi per-frame — Anda tidak mengontrol frame mana yang disampel

- Untuk konten video panjang yang melampaui kapasitas konteks nyaman model, segmentasi logis diperlukan. Tanpa chunking strategis atau prapemrosesan, model dapat mengalami degradasi atau pemotongan saat konsumsi token meningkat pada data visual berkepadatan tinggi

- Mendeteksi gerak, transisi, atau konten yang bergantung waktu yang memerlukan perbandingan frame berurutan

- Skenario di mana informasi visual kritis muncul singkat di antara frame yang disampel

Jika Anda memerlukan kontrol atas momen yang dianalisis, gunakan Metode 1.

Metode 3: Tautan YouTube + pengambilan transkrip

Beberapa plugin ChatGPT dan alat pihak ketiga mengklaim “menganalisis video YouTube.” Yang sebenarnya mereka lakukan adalah mengambil metadata publik dan transkrip video (jika tersedia), lalu meneruskan teks itu ke ChatGPT.

Ini berhasil ketika:

- Video memiliki caption yang dihasilkan otomatis atau diunggah pengguna

- Analisis Anda hanya memerlukan konten ucapan, bukan informasi visual

- Video dapat diakses publik (bukan privat, tidak terdaftar, atau dibatasi wilayah)

- Anda merangkum kuliah, podcast, atau wawancara di mana audio memuat sebagian besar makna

Ini tidak berhasil ketika:

- Anda perlu menganalisis konten visual (demo di layar, diagram, ekspresi wajah)

- Video tidak memiliki transkrip atau caption

- Informasi kritis muncul secara visual tanpa disebutkan dalam dialog

- Anda bekerja dengan file video privat atau konten di balik autentikasi

Kesalahan umum: Developer mengharapkan pemahaman video penuh (visual + audio) tetapi hanya menerima ringkasan transkrip. Ini baik untuk analisis konten materi lisan. Tidak berguna untuk meninjau demo produk, menganalisis desain visual, atau skenario apa pun di mana apa yang Anda lihat lebih penting daripada apa yang diucapkan.

Polanya: Metode 2 untuk ringkasan cepat ketika presisi tidak penting. Metode 1 untuk analisis terkontrol saat Anda memerlukan frame spesifik. Metode 3 untuk konten berfokus audio ketika informasi visual bersifat sekunder atau tidak ada. Pilih berdasarkan lokasi informasi kritis kasus penggunaan Anda — dalam gerak, pada frame tertentu, atau murni dalam dialog.

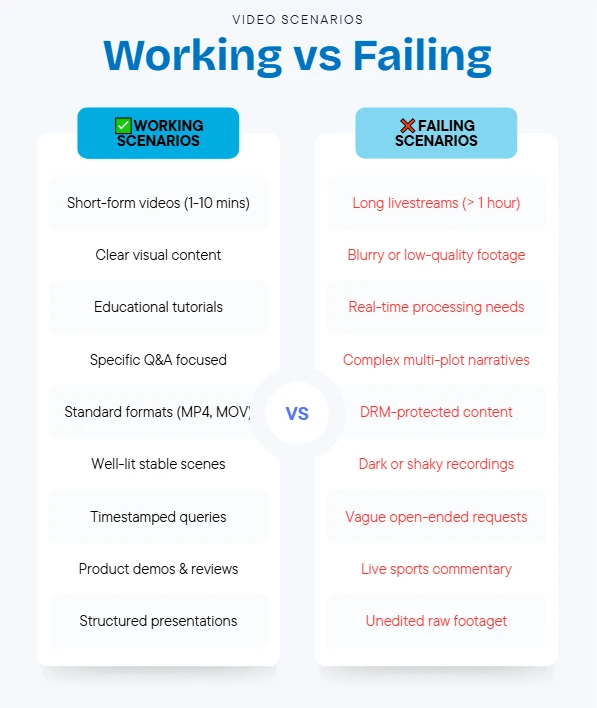

Skenario Aplikasi Video ChatGPT: Apa yang Benar-Benar Berfungsi di Produksi

Mengetahui ChatGPT dapat memproses komponen video tidak otomatis berarti alat ini tepat untuk masalah Anda. Skenario berikut menunjukkan di mana analisis berbasis frame berhasil — dan di mana batasan arsitekturalnya membuat kasus penggunaan gagal.

Skenario 1: Perangkum konten edukasi

Use case: Anda memiliki video tutorial 10 menit dan memerlukan ringkasan terstruktur tentang langkah kunci, alat yang disebut, dan contoh visual yang ditampilkan.

Alasannya berhasil: Video edukasi biasanya memiliki batas adegan yang jelas, teks di layar yang persisten, dan narasi yang selaras dengan visual. Pembicara menjelaskan apa yang mereka tunjukkan saat itu terlihat. ChatGPT dapat mentranskrip penjelasan, mengidentifikasi alat atau diagram di frame yang disampel, dan menggabungkan keduanya menjadi output terstruktur.

Pendekatan implementasi: Unggah video via antarmuka ChatGPT atau ekstrak 8–12 keyframe pada transisi topik besar. Prompt: “Daftarkan langkah utama yang dijelaskan dalam video ini, merujuk pada narasi dan teks di layar, diagram, atau nama alat apa pun yang Anda lihat.”

Di mana gagal: Video yang bergantung pada gerak kontinu — seperti screencast coding di mana instruktur mengetik cepat di banyak file — akan memiliki langkah yang hilang di antara frame. Anda memerlukan laju sampling frame lebih tinggi atau fokus pada transkrip audio saja.

Tips praktis: Untuk konten kuliah atau tutorial, gabungkan unggah otomatis (untuk transkrip) dengan frame yang diekstrak manual dari 3–5 momen visual paling penting. Ini memberi cakupan audio yang komprehensif dan gambar berkualitas tinggi dari konsep kunci.

Skenario 2: Analisis demo produk

Use case: Anda meninjau demo produk kompetitor dan ingin mengekstrak elemen UI, nama fitur, alur pengguna, dan detail harga yang muncul di layar.

Alasannya berhasil: Demo produk biasanya menahan setiap layar cukup lama sehingga sampling frame dapat menangkap UI statis. Teks overlay, label tombol, struktur menu, dan tabel harga tetap terlihat di banyak frame. Kemampuan visi ChatGPT dapat membaca dan mendeskripsikan elemen-elemen ini bahkan jika tidak disebutkan dalam narasi.

Pendekatan implementasi: Ekstrak frame pada pergantian adegan besar (slide intro, demo fitur 1, demo fitur 2, layar harga, CTA). Unggah frame-frame tersebut dan prompt: “Untuk setiap frame, identifikasi semua elemen UI yang terlihat, label tombol, nama fitur, dan informasi harga atau produk apa pun yang ditampilkan.”

Di mana gagal: Demo dengan transisi layar cepat, state hover yang memperlihatkan informasi secara singkat, atau elemen interaktif yang hanya tampil 1–2 detik tidak akan tertangkap oleh sampling frame. Jika kompetitor dengan cepat menampilkan tabel perbandingan fitur, Anda akan melewatkannya kecuali momen itu tepat disampel.

Tips praktis: Geser videonya secara manual terlebih dahulu untuk mengidentifikasi timestamp momen penting. Ekstrak frame pada momen spesifik tersebut alih-alih mengandalkan interval sampling otomatis.

Skenario 3: Transkripsi rapat atau wawancara dengan konteks visual

Use case: Anda merekam panggilan klien dan memerlukan transkrip beserta anotasi yang mencatat kapan dokumen tertentu, slide, atau screen share muncul.

Alasannya berhasil: Transkripsi audio menangani dialog lisan. Saat peserta berbagi layar atau mengangkat dokumen, itu muncul di frame yang disampel. ChatGPT dapat memberi anotasi “sekitar [timestamp], sebuah dokumen kontrak terlihat di layar” di samping transkrip — berguna untuk notulen rapat yang merujuk materi visual.

Pendekatan implementasi: Unggah video dan prompt: “Transkrip rapat ini dan catat setiap momen ketika dokumen, slide presentasi, screen share, atau referensi visual lain muncul. Untuk tiap elemen visual, jelaskan apa yang ditampilkan.”

Di mana gagal: Screen share singkat (di bawah 5–10 detik) mungkin jatuh di antara frame yang disampel. Teks yang terlalu kecil pada frame video terkompres tidak dapat diekstrak. Untuk kasus hukum atau kepatuhan yang memerlukan akurasi verbatim dari dokumen yang ditampilkan, verifikasi kualitas frame dan cakupan sampling sebelum mengandalkan output.

Tips praktis: Untuk rapat penting, rekam dalam resolusi lebih tinggi dan ekstrak frame secara manual pada momen saat seseorang berkata “izinkan saya tunjukkan dokumen ini” — menandakan referensi visual akan muncul.

Skenario 4: Moderasi konten atau tinjauan kepatuhan

Use case: Anda perlu memindai video yang diunggah pengguna untuk konten terlarang — logo tertentu, pola teks, atau elemen visual yang melanggar kebijakan platform.

Alasannya berhasil: ChatGPT dapat memindai frame untuk teks yang terlihat, objek yang dapat dikenali, atau adegan yang dideskripsikan. Jika Anda memeriksa “apakah ada video ini yang menampilkan logo kompetitor,” analisis berbasis frame mendeteksi logo yang bertahan di layar lebih dari satu-dua detik.

Pendekatan implementasi: Ekstrak frame pada interval reguler (setiap 3–5 detik), unggah, dan prompt: “Tinjau frame-frame ini dan identifikasi mana pun yang mengandung [logo tertentu, nama brand, simbol terlarang, dll.]. Untuk setiap kecocokan, jelaskan di mana posisinya dalam frame.”

Di mana gagal: Pelanggaran berbasis audio (musik berhak cipta, ucapan terlarang) memerlukan analisis audio terpisah. Pelanggaran berbasis gerak (gestur terlarang, aksi yang membentang lintas frame) tidak akan tertangkap oleh analisis gambar diam. Konten terlarang yang hanya muncul sekejap mungkin tidak terlihat di frame yang disampel.

Tips praktis: Gabungkan pemindaian visual ChatGPT dengan layanan fingerprinting audio khusus dan laju sampling frame lebih tinggi untuk kategori konten berisiko tinggi. Gunakan ChatGPT sebagai filter tahap awal, bukan satu-satunya lapisan moderasi.

Pola di skenario yang berhasil: konten bermakna hadir dalam frame-frame diskret dan stabil serta berkorelasi dengan elemen audio atau teks. Kegagalan terjadi saat informasi krusial berada dalam gerak, timing, transisi, atau muncul terlalu singkat untuk diambil sampelnya secara andal.

Kemampuan Video Gemini vs. Kemampuan Video Claude vs. ChatGPT

Jika arsitektur sampling frame ChatGPT tidak cocok untuk kasus penggunaan Anda, Anda dapat mengevaluasi alternatif. Gemini dan Claude menawarkan kemampuan terkait video yang berbeda — dan perbedaan tersebut menentukan model mana yang sesuai untuk implementasi spesifik Anda.

Pemrosesan video native Gemini

Model Gemini mendukung input video native di level API. Anda mengirim file video langsung tanpa prapemrosesan ke frame. Model memproses video sebagai aliran kontinu, memungkinkan pelacakan gerak, deteksi pergantian adegan, dan penalaran temporal yang tidak dapat ditangani pendekatan berbasis frame ChatGPT.

Contoh use case di mana Gemini unggul:

Anda perlu mendeteksi kapan objek tertentu masuk dan keluar frame sepanjang klip 30 detik, atau melacak bagaimana seseorang bergerak di suatu adegan. Gemini dapat mengikuti objek lintas frame dan menalar gerak. ChatGPT hanya akan melihat objek pada frame yang kebetulan disampel — berpotensi melewatkan momen masuk atau keluar sepenuhnya.

Kompromi:

- API native Gemini lebih hemat biaya daripada sampling berbasis frame OpenAI. Dengan menghindari overhead token linear lewat context caching, Gemini lebih skalabel untuk analisis panjang.

- Memproses video lebih panjang menimbulkan latensi lebih tinggi — model harus mencerna seluruh file sebelum merespons

- Tidak semua varian Gemini mendukung input video; memerlukan model Gemini yang lebih baru

- Batas panjang video ada, namun lebih longgar daripada batas konteks ChatGPT

Kapan memilih Gemini daripada ChatGPT:

- Kasus penggunaan Anda memerlukan pelacakan gerak, deteksi batas adegan, atau pemahaman hubungan temporal

- Informasi kritis muncul dan menghilang cepat di lintas frame

- Anda menganalisis video di mana progresi peristiwa penting (rekaman olahraga, tinjauan pengawasan, analisis animasi)

- Anda ingin menghindari prapemrosesan ekstraksi frame manual

Keterbatasan video Claude saat ini

Per awal 2026, model Claude tidak mendukung input video langsung via API. Anda dapat mengunggah gambar (termasuk frame video yang diekstrak manual), tetapi tidak ada kemampuan pemrosesan video native setara Gemini.

Apa yang bisa dilakukan Claude:

- Menganalisis urutan frame yang diunggah, mirip metode ekstraksi manual ChatGPT (Metode 2)

- Memberi deskripsi detail konten visual pada tiap frame

- Menalar gerak tersirat atau perubahan antar-frame jika diprompt secara eksplisit

- Menangani urutan gambar lebih panjang berkat jendela konteks yang diperluas (hingga 1M token di Claude Opus 4.7)

Apa yang tidak bisa dilakukan Claude:

- Menerima file video langsung melalui antarmuka apa pun

- Secara otomatis melacak gerak atau objek lintas frame tanpa pemintaan per frame

- Mentranskrip audio — memerlukan prapemrosesan terpisah dengan Whisper atau layanan serupa, lalu meneruskan transkrip ke Claude

Kapan Anda tetap memilih Claude:

- Alur kerja Anda sudah mencakup ekstraksi frame sebagai langkah prapemrosesan

- Anda menganalisis video panjang yang memerlukan banyak frame dan butuh jendela konteks besar milik Claude

- Anda membandingkan kualitas analisis visual dan mendapati deskripsi frame Claude lebih akurat/terperinci untuk domain Anda (mis. imaging medis, diagram teknis)

- Anda perlu menggabungkan analisis frame video dengan banyak informasi konteks lainnya

Tabel perbandingan kemampuan

| Fitur | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Unggah file video langsung | ✓ (antarmuka web/app) | ✓ (API + antarmuka web) | ✗ |

| Pelacakan gerak native | ✗ | ✓ | ✗ |

| Transkripsi audio | ✓ (integrasi Whisper) | ✓ (terintegrasi) | ✗ (memerlukan alat eksternal) |

| Analisis berbasis frame | ✓ | ✓ (juga pemrosesan kontinu) | ✓ (ekstraksi manual saja) |

| Deteksi pergantian adegan | ✗ (manual saja) | ✓ (otomatis) | ✗ |

| Penanganan panjang video | ~5–10 menit (dibatasi konteks) | ~1 jam (tergantung resolusi) | Tidak berlaku (jumlah frame dibatasi oleh konteks) |

| Use case terbaik | Ringkasan cepat, analisis level frame dengan kontrol | Pelacakan gerak, penalaran temporal, video kontinu | Deskripsi per frame mendalam dengan kebutuhan konteks besar |

| Dukungan video via API | ✗ (hanya gambar) | ✓ | ✗ |

Kerangka keputusan:

- Pilih ChatGPT ketika: Anda memerlukan ringkasan video cepat, informasi kritis bertahan di banyak frame, Anda bekerja dengan klip pendek (di bawah 10 menit), dan tidak butuh pelacakan gerak. Terbaik untuk konten edukasi, demo produk statis, transkripsi rapat.

- Pilih Gemini ketika: Kasus penggunaan Anda memerlukan pelacakan gerak, deteksi pergantian adegan, atau penalaran temporal tentang bagaimana elemen bergerak/berubah dari waktu ke waktu. Krusial untuk rekaman pengawasan, analisis olahraga, tinjauan animasi, atau skenario di mana “apa yang terjadi di antara frame” penting.

- Pilih Claude ketika: Pipeline Anda sudah mengekstrak frame, perlu menganalisis banyak frame dengan konteks tambahan ekstensif, atau Anda menilai deskripsi visual Claude lebih akurat untuk domain Anda. Memerlukan prapemrosesan terbanyak namun menawarkan jendela konteks terbesar.

Untuk developer yang bekerja lintas model, CometAPI menyediakan antarmuka terpadu untuk menguji kualitas pemrosesan video di varian GPT, Gemini, dan Claude tanpa menulis ulang kode integrasi — berguna saat Anda membandingkan kualitas output sebelum memilih penyedia tertentu.

Jawaban sebenarnya untuk “bisakah ChatGPT menonton video” bukan biner. Jawabannya “ya, dengan mengonversi video ke format yang sudah ditangani — dengan keterbatasan yang merusak kasus penggunaan tertentu.” Sebagian besar kegagalan implementasi berasal dari ketidakcocokan arsitektural, bukan celah kemampuan. Model berfungsi persis seperti yang dirancang; developer hanya mengharapkan desain yang berbeda.

Jika Anda membangun fitur analisis video dalam skala besar, uji alur kerja Anda dengan kasus tepi terlebih dahulu: unggah video yang sama melalui file langsung, frame yang diekstrak manual, dan metode transkrip saja. Bandingkan output. Metode yang menangkap sinyal kritis kasus penggunaan Anda — bukan yang tercepat diimplementasikan — adalah yang bertahan menghadapi trafik produksi.

Sebelum berkomitmen ke ChatGPT untuk video:

- Identifikasi apakah informasi kritis Anda berada di frame stabil, gerak, atau audio

- Uji cakupan sampling frame dengan mengekstrak frame secara manual pada interval yang Anda harapkan

- Verifikasi bahwa teks di layar dapat dibaca pada resolusi video Anda setelah kompresi

- Konfirmasikan panjang video Anda sesuai dengan batas konteks praktis untuk tier langganan Anda

- Siapkan fallback untuk konten yang muncul singkat atau di antara frame yang disampel

Untuk developer yang mengevaluasi beberapa penyedia AI untuk beban kerja video, CometAPI menawarkan playground terpadu untuk menguji ChatGPT, Gemini, dan Claude dengan input video yang sama — memungkinkan Anda membandingkan kualitas output, latensi, dan biaya sebelum membangun integrasi spesifik penyedia.

FAQ - Panduan Analisis Video AI

Jawaban cepat untuk pertanyaan umum tentang analisis video AI.

Bisakah ChatGPT menganalisis video?

Ya, ChatGPT (GPT-4o dan yang lebih baru) dapat menganalisis video dengan mengambil sampel frame (~1 per detik) dan mentranskrip audio. Ini bekerja baik untuk ringkasan rapat, mengekstrak teks dari slide, dan mengidentifikasi objek. Namun, ia kesulitan dengan pelacakan gerak, video di atas 10 menit, dan streaming real-time.

Bagaimana cara mengunggah video ke ChatGPT?

Unggah URL Langsung (Direkomendasikan): Unggah melalui URL publik untuk analisis cepat. Terbaik untuk video di bawah 10 menit.

Ekstraksi Frame Manual: Ekstrak frame spesifik untuk kontrol presisi. Terbaik saat Anda perlu menganalisis momen tertentu atau mengurangi biaya token.

Berapa panjang video maksimum yang dapat ditangani ChatGPT?

ChatGPT andal menangani video hingga 5–10 menit. Di atas itu, Anda perlu menyegmentasi video atau beralih ke Gemini 2.5 Pro, yang mendukung video hingga 60 menit secara native.

Apa keterbatasan analisis video ChatGPT?

- Tidak dapat melacak gerak kontinu (olahraga, tari)

- Timestamp tidak presisi (akurasi ±1 detik)

- Melewatkan konten yang muncul kurang dari 1 detik

- Batas praktis 10 menit

- Tidak ada dukungan streaming real-time

- Kesulitan pada video berkualitas rendah atau gelap

- Lemah pada penalaran sebab-akibat temporal *

Haruskah saya menggunakan ChatGPT atau Gemini untuk analisis video?

Gunakan ChatGPT untuk:

- Video di bawah 10 menit

- Penalaran teks unggul setelah analisis video

- Analisis level frame (slide, screenshot)

Gunakan Gemini untuk:

- Video 10–60 menit

- Pelacakan gerak dan analisis pergerakan

- Tugas penalaran temporal

- Rekaman olahraga, tari, atau pengawasan *

Bisakah Claude menganalisis video?

Tidak, Claude tidak mendukung input video langsung. Namun, Anda dapat mengekstrak frame dari video dan menganalisisnya dengan Claude, yang menawarkan penalaran teks dan jendela konteks superior untuk analisis panjang.

Berapa biaya analisis video?

Biaya bervariasi menurut model dan panjang video:

- ChatGPT 4o: ~$0,05 per menit

- Gemini 2.5 Pro: ~$0,04 per menit

CometAPI menawarkan kredit untuk pengguna baru agar dapat memulai.