GLM-4.6 adalah rilis utama terbaru dalam keluarga GLM milik Z.ai (sebelumnya Zhipu AI): model MoE (Mixture-of-Experts) model generasi ke-4 berbahasa besar yang disetel untuk alur kerja berbasis agen, penalaran konteks panjang, dan pengodean dunia nyata. Rilis ini menekankan integrasi agen/alat yang praktis, jendela konteks yang sangat besar, serta ketersediaan bobot terbuka untuk penerapan lokal.

Fitur utama

- Konteks panjang — jendela konteks native 200K token (diperluas dari 128K). (docs.z.ai)

- Kemampuan pengodean & berbasis agen — peningkatan yang dipasarkan pada tugas pengodean dunia nyata dan pemanggilan alat yang lebih baik untuk agen.

- Efisiensi — dilaporkan ~30% konsumsi token lebih rendah dibanding GLM-4.5 pada pengujian Z.ai.

- Penerapan & kuantisasi — integrasi FP8 dan Int4 pertama kali diumumkan untuk chip Cambricon; dukungan FP8 native di Moore Threads melalui vLLM.

- Ukuran model & jenis tensor — artefak yang dipublikasikan mengindikasikan model ~357B-parameter (tensor BF16 / F32) di Hugging Face.

Rincian teknis

Modalitas & format. GLM-4.6 adalah LLM khusus teks (modalitas masukan dan keluaran: teks). Panjang konteks = 200K token; keluaran maksimum = 128K token.

Kuantisasi & dukungan perangkat keras. Tim melaporkan kuantisasi FP8/Int4 pada chip Cambricon dan eksekusi FP8 native pada GPU Moore Threads menggunakan vLLM untuk inferensi — penting untuk menurunkan biaya inferensi dan memungkinkan penerapan di lokasi dan cloud domestik.

Perkakas & integrasi. GLM-4.6 didistribusikan melalui API Z.ai, jaringan penyedia pihak ketiga (mis., CometAPI), dan diintegrasikan ke agen pengodean (Claude Code, Cline, Roo Code, Kilo Code).

Rincian teknis

Modalitas & format. GLM-4.6 adalah LLM khusus teks (modalitas masukan dan keluaran: teks). Panjang konteks = 200K token; keluaran maksimum = 128K token.

Kuantisasi & dukungan perangkat keras. Tim melaporkan kuantisasi FP8/Int4 pada chip Cambricon dan eksekusi FP8 native pada GPU Moore Threads menggunakan vLLM untuk inferensi — penting untuk menurunkan biaya inferensi dan memungkinkan penerapan di lokasi dan cloud domestik.

Perkakas & integrasi. GLM-4.6 didistribusikan melalui API Z.ai, jaringan penyedia pihak ketiga (mis., CometAPI), dan diintegrasikan ke agen pengodean (Claude Code, Cline, Roo Code, Kilo Code).

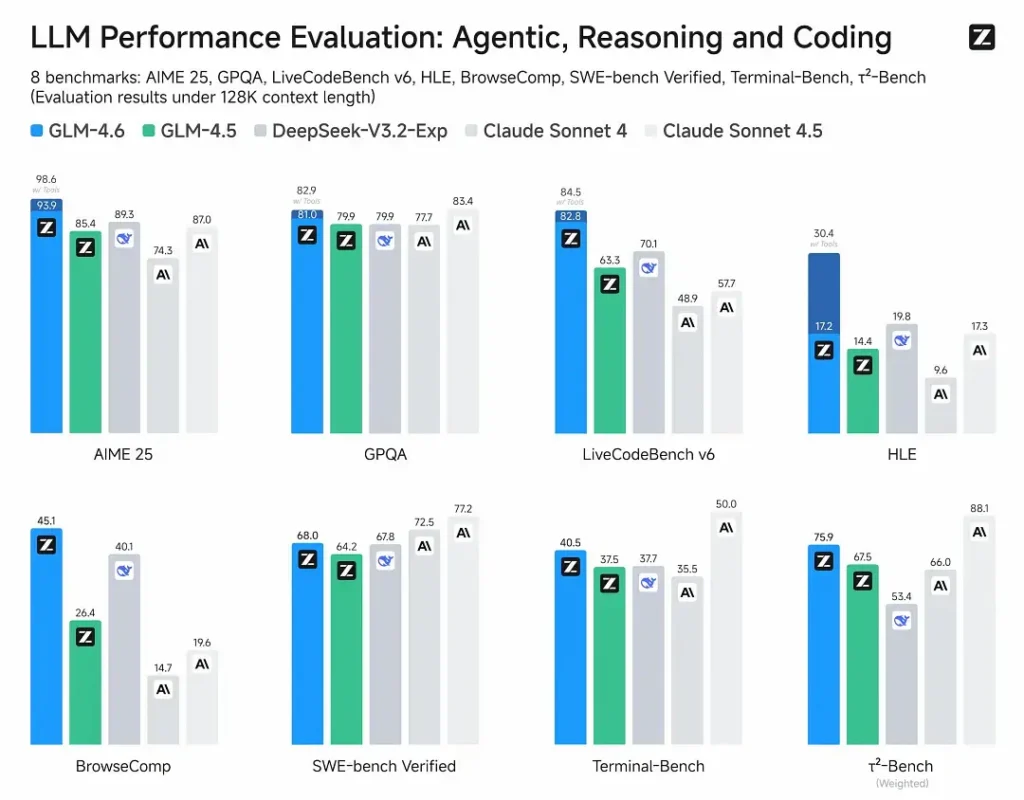

Performa benchmark

- Evaluasi yang dipublikasikan: GLM-4.6 diuji pada delapan benchmark publik yang mencakup agen, penalaran, dan pengodean dan menunjukkan kenaikan yang jelas dibanding GLM-4.5. Pada uji pengodean dunia nyata yang dievaluasi manusia (CC-Bench yang diperluas), GLM-4.6 menggunakan ~15% lebih sedikit token dibanding GLM-4.5 dan mencatat ~48.6% tingkat kemenangan versus Claude Sonnet 4 dari Anthropic (hampir setara di banyak leaderboard).

- Pemosisian: hasil mengklaim GLM-4.6 kompetitif dengan model domestik dan internasional terdepan (contoh yang dikutip mencakup DeepSeek-V3.1 dan Claude Sonnet 4).

Keterbatasan & risiko

- Halusinasi & kesalahan: seperti semua LLM saat ini, GLM-4.6 dapat dan memang membuat kesalahan faktual — dokumen Z.ai secara eksplisit memperingatkan keluaran dapat berisi kesalahan. Pengguna sebaiknya menerapkan verifikasi & retrieval/RAG untuk konten kritis.

- Kompleksitas model & biaya penyajian: konteks 200K dan keluaran yang sangat besar secara drastis meningkatkan kebutuhan memori & latensi dan dapat menaikkan biaya inferensi; rekayasa kuantisasi/inferensi diperlukan untuk berjalan dalam skala besar.

- Kesenjangan domain: meskipun GLM-4.6 melaporkan performa agen/pengodean yang kuat, beberapa laporan publik mencatat model ini masih tertinggal dari versi tertentu model pesaing pada mikrobenchmark spesifik (mis., beberapa metrik pengodean vs Sonnet 4.5). Nilai per tugas sebelum mengganti model produksi.

- Keamanan & kebijakan: bobot terbuka meningkatkan aksesibilitas namun juga menimbulkan pertanyaan tata kelola (mitigasi, guardrails, dan red-teaming tetap menjadi tanggung jawab pengguna).

Kasus penggunaan

- Sistem berbasis agen & orkestrasi alat: jejak agen panjang, perencanaan multi-alat, pemanggilan alat dinamis; penyesuaian berbasis agen model adalah nilai jual utama.

- Asisten pengodean dunia nyata: pembuatan kode multi-putaran, tinjauan kode, dan asisten IDE interaktif (terintegrasi di Claude Code, Cline, Roo Code—sesuai Z.ai). Peningkatan efisiensi token membuatnya menarik untuk paket pengembang dengan penggunaan berat.

- Alur kerja dokumen panjang: peringkasan, sintesis multi-dokumen, tinjauan hukum/teknis yang panjang berkat jendela 200K.

- Pembuatan konten & karakter virtual: dialog berkepanjangan, pemeliharaan persona yang konsisten dalam skenario multi-putaran.

Bagaimana GLM-4.6 dibandingkan dengan model lain

- GLM-4.5 → GLM-4.6: perubahan langkah dalam ukuran konteks (128K → 200K) dan efisiensi token (~15% lebih sedikit token pada CC-Bench); penggunaan agen/alat yang ditingkatkan.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai melaporkan hampir setara pada beberapa leaderboard dan tingkat kemenangan sekitar ~48.6% pada tugas pengodean dunia nyata CC-Bench (kompetisi ketat, dengan beberapa mikrobenchmark di mana Sonnet masih memimpin). Bagi banyak tim rekayasa, GLM-4.6 diposisikan sebagai alternatif hemat biaya.

- GLM-4.6 vs model konteks panjang lainnya (DeepSeek, varian Gemini, keluarga GPT-4): GLM-4.6 menekankan konteks besar & alur kerja pengodean berbasis agen; kekuatan relatif bergantung pada metrik (efisiensi token/integrasi agen vs akurasi sintesis kode mentah atau pipeline keamanan). Pemilihan empiris sebaiknya didorong oleh tugas.

Model andalan terbaru Zhipu AI GLM-4.6 dirilis: 355B total parameter, 32B aktif. Melampaui GLM-4.5 di semua kapabilitas inti.

- Pemrograman: Sejajar dengan Claude Sonnet 4, terbaik di China.

- Konteks: Diperluas menjadi 200K (dari 128K).

- Penalaran: Meningkat, mendukung pemanggilan alat selama inferensi.

- Pencarian: Peningkatan pemanggilan alat dan performa agen.

- Penulisan: Lebih selaras dengan preferensi manusia dalam gaya, keterbacaan, dan role-playing.

- Multibahasa: Peningkatan penerjemahan lintas bahasa.