Il 28 aprile 2025, Alibaba Cloud ha presentato Qwen 3, l'ultima versione della sua famiglia di modelli linguistici di grandi dimensioni (LLM). Questa release segna una pietra miliare significativa nell'evoluzione dell'intelligenza artificiale open source, offrendo una suite di modelli che soddisfano diverse applicazioni ed esigenze degli utenti. Che siate sviluppatori, ricercatori o aziende, capire come accedere e utilizzare Qwen 3 può aprire nuove possibilità nell'elaborazione del linguaggio naturale e oltre.

Che cos'è Qwen 3?

Qwen 3 è la terza generazione di LLM open source di Alibaba Cloud, basata sulle fondamenta gettate dai suoi predecessori. Rilasciata il 28 aprile 2025, Qwen 3 introduce una gamma di modelli con dimensioni variabili dei parametri, che includono architetture sia dense che sparse. Questi modelli sono stati addestrati su un ampio dataset di 36 trilioni di token in 119 lingue e dialetti, posizionando Qwen 3 come uno strumento versatile per applicazioni globali.

Caratteristiche principali di Qwen 3

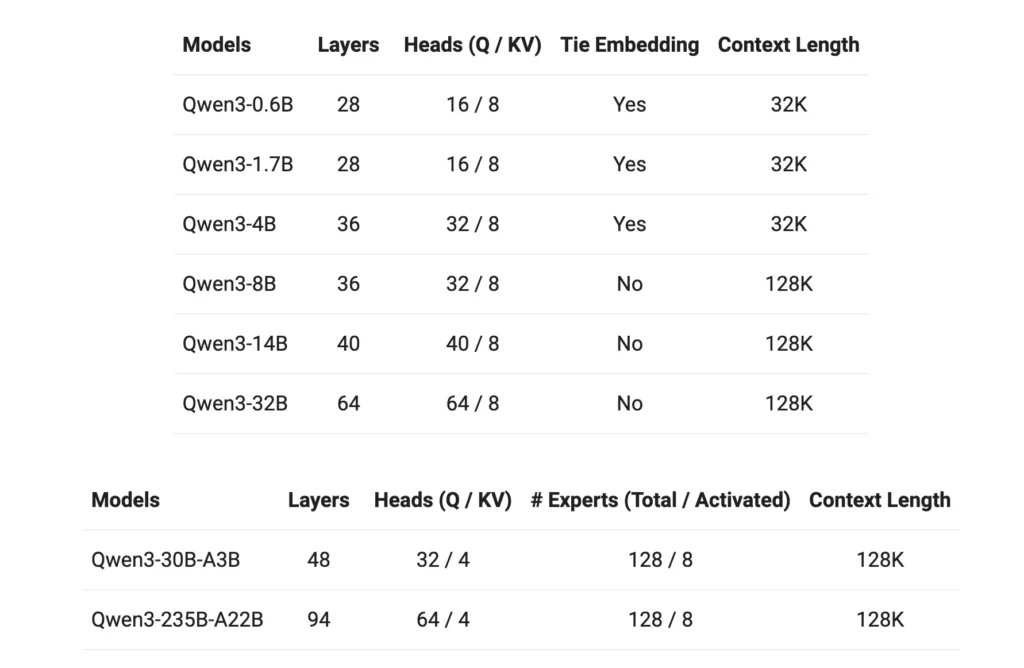

- Varianti del modello:Qwen 3 offre modelli densi con parametri 0.6B, 1.7B, 4B, 8B, 14B e 32B, nonché modelli sparsi con 30B (3B di parametri attivati) e 235B (22B di parametri attivati).

- Finestra di contesto estesa:La maggior parte dei modelli supporta una finestra di contesto del token da 128K, facilitando l'elaborazione di contenuti di formato lungo.

- Capacità di ragionamento:È possibile attivare o disattivare funzioni di ragionamento avanzate tramite il tokenizzatore, consentendo prestazioni adattabili in base a compiti specifici.

- Competenza multilingue:Con dati di addestramento che comprendono 119 lingue e dialetti, Qwen 3 è attrezzato per diverse applicazioni linguistiche.

- Licenze: Tutti i modelli sono rilasciati con licenza Apache 2.0, promuovendo la collaborazione e l'innovazione open source.

Come puoi accedere a Qwen3?

Accedere a Qwen 3, l'ultima suite di modelli linguistici di grandi dimensioni (LLM) di Alibaba Cloud, è semplice e versatile. Che siate sviluppatori che desiderano integrare funzionalità di intelligenza artificiale avanzate nelle proprie applicazioni o ricercatori che esplorano modelli all'avanguardia, Qwen 3 offre diversi punti di accesso per soddisfare diverse esigenze.

1. Tramite l'interfaccia Web di QwenChat

Per un'interazione immediata senza alcuna configurazione, QwenChat offre un'interfaccia web intuitiva:

- Visita QwenChat: Passa a Piattaforma QwenChat.

- Seleziona un modello: Scegli tra i modelli disponibili come Qwen3-8B, Qwen3-14B o Qwen3-32B in base alle tue esigenze.

- Inizia a chattare: Interagisci direttamente con il modello tramite l'interfaccia della chat per attività quali domande e risposte, generazione di contenuti o assistenza nella codifica.

2. Accesso API tramite Alibaba Cloud

Integra Qwen 3 nelle tue applicazioni utilizzando i servizi API di Alibaba Cloud:

Ottieni le credenziali API: Registrati su Alibaba Cloud e ottieni la tua chiave API.

Scegli il metodo di accesso:

- API compatibile con OpenAI: Utilizza l'endpoint compatibile con OpenAI per un'integrazione perfetta.

bashPOST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions

- SDK DashScopeIn alternativa, per interazioni più personalizzate, puoi utilizzare l'SDK DashScope.

- Imposta ambiente: Configura il tuo ambiente di sviluppo impostando la chiave API come variabile di ambiente e installando gli SDK necessari.

3. Accesso tramite Hugging Face e ModelScope

Per gli sviluppatori che preferiscono le piattaforme open source:

- Abbracciare il viso: Accedi ai modelli Qwen 3 tramite l'organizzazione Qwen su Hugging Face.

pythonfrom transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-14B") model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-14B")

- ModelScope: Esplora i modelli su ModelScope, che offre una gamma di varianti di Qwen 3.

4. Opzioni di distribuzione locale

Distribuisci i modelli Qwen 3 in locale per un controllo e una personalizzazione migliorati:

Ollama: Una piattaforma che semplifica la gestione dei modelli locali.

- SERVIZIO DI: Scarica e installa Ollama da ollama.com.

- Distribuzione del modello: Utilizzare la CLI di Ollama per eseguire localmente i modelli Qwen 3.

bashollama run qwen3-14b

vLLM: Ottimizzato per un'erogazione ad alta produttività e bassa latenza.

- SERVIZIO DI: Installa vLLM usando pip.

bashpip install -U vllm

- Modello che serve: Fornire ai modelli Qwen 3 capacità di ragionamento.

bashvllm serve Qwen/Qwen3-30B-A3B \ --enable-reasoning \ --reasoning-parser deepseek_r1

Interazione: Accedi al modello tramite il server API predefinito all'indirizzo http://localhost:8000.

5. Piattaforme di terze parti: CometAPI

Utilizzare Qwen 3 attraverso CometaAPI offrendo accesso gratuito:

- CometaAPI: Registrati per ottenere una chiave API gratuita e scegli tra modelli come Qwen3-8B, Qwen3-30B o Qwen3-235B da integrare nei tuoi progetti.

Come iniziare con Qwen 3

Per iniziare a usare Qwen 3:

- Determina il tuo caso d'uso: Identifica se hai bisogno di un'interfaccia web, di un'integrazione API o di una distribuzione locale.

- Seleziona il modello appropriato: Scegli una variante del modello che sia in linea con le tue risorse di calcolo e la complessità del compito.

- Configura l'ambiente: Segui i passaggi di installazione e configurazione in base al metodo di accesso scelto.

- Integra e prova: Integra Qwen 3 nelle tue applicazioni ed esegui test per garantire prestazioni ottimali.

Seguendo questi passaggi, potrai sfruttare efficacemente le potenzialità di Qwen 3 per migliorare i tuoi progetti e le tue attività di ricerca.

Implementazione di Qwen 3: considerazioni pratiche

Requisiti di sistema

L'implementazione dei modelli Qwen 3, in particolare delle varianti più grandi, richiede ingenti risorse di calcolo. Gli utenti devono assicurarsi di avere accesso a capacità GPU e memoria adeguate per soddisfare le dimensioni del modello e le esigenze di elaborazione.

Integrazione e personalizzazione

La natura open source di Qwen 3 consente un'ampia personalizzazione. Gli sviluppatori possono perfezionare i modelli su dati specifici del dominio, regolare i parametri per ottimizzare le prestazioni e integrare i modelli nei sistemi esistenti per migliorarne la funzionalità.

Comunità e supporto

Interagire con la community di Qwen 3 attraverso forum, discussioni su GitHub e altre piattaforme collaborative può fornire spunti e supporto preziosi. La condivisione di esperienze e soluzioni contribuisce al progresso collettivo della tecnologia.

Conclusione

Qwen 3 rappresenta un significativo progresso nel campo dei modelli linguistici open source di grandi dimensioni. Grazie alla sua ampia offerta di modelli, all'ampio supporto linguistico e alle piattaforme accessibili, fornisce un solido set di strumenti per un'ampia gamma di applicazioni. Comprendendo come accedere e implementare Qwen 3, gli utenti possono sfruttarne le capacità per promuovere innovazione ed efficienza nei rispettivi ambiti.

Iniziamo

Gli sviluppatori possono accedere Qwen 3 API tramite CometaAPIPer iniziare, esplora le capacità del modello nel Playground e consulta il Guida API per istruzioni dettagliate. Si noti che alcuni sviluppatori potrebbero dover verificare la propria organizzazione prima di utilizzare il modello.