Qwen2.5-VL-32B L'API ha attirato l'attenzione per il suo performance straordinaria in vari compiti complessi, combinando entrambi dati di immagine e testo per una comprensione arricchita del mondo. Sviluppato da Alibaba, questo modello da 32 miliardi di parametri è un aggiornamento del precedente Qwen2.5-VL serie, spingendo i confini di Ragionamento guidato dall'intelligenza artificiale e al comprensione visiva.

Panoramica di Qwen2.5-VL-32B

Qwen2.5-VL-32B è un modello multimodale all'avanguardia e open source progettato per gestire una gamma di attività che coinvolgono sia testo che immagini. Con il suo 32 miliardi di parametri, offre un architettura potente da riconoscimento dell'immagine, ragionamento matematico, generazione di dialoghi, e molto altro. Il suo potenziamento capacità di apprendimento, basati sull'apprendimento per rinforzo, consentono di generare risposte che si allineano meglio alle preferenze umane.

Caratteristiche e funzioni principali

Qwen2.5-VL-32B dimostra notevoli capacità in più domini:

Comprensione e descrizione dell'immagine: Questo modello eccelle in analisi dell'immagine, identificando accuratamente oggetti e scene. Può generare descrizioni dettagliate in linguaggio naturale e persino fornire approfondimenti dettagliati negli attributi degli oggetti e nelle loro relazioni.

Ragionamento matematico e logica: Il modello è attrezzato per risolvere complessi problemi matematici, che vanno da dalla geometria all'algebra—utilizzando ragionamento in più fasi con logica chiara e risultati strutturati.

Generazione di testo e dialogo: Con il suo modello linguistico avanzato, Qwen2.5-VL-32B genera risposte coerenti e contestualmente rilevanti basate su testo o immagini di input. Supporta anche dialogo multi-turn, consentendo interazioni più naturali e continue.

Risposta visiva alle domande: Il modello può rispondere a domande relative al contenuto dell'immagine, come riconoscimento degli oggetti e al descrizione della scena, fornendo sofisticate capacità di logica visiva e di inferenza.

Fondamenti tecnici di Qwen2.5-VL-32B

Per comprendere la potenza dietro Qwen2.5-VL-32B, è fondamentale esplorare i suoi principi tecnici. Di seguito sono riportati gli aspetti chiave che contribuiscono alle sue prestazioni:

- Pre-formazione multimodale: Il modello è stato pre-addestrato utilizzando set di dati su larga scala composto da entrambi dati di testo e immagineCiò consente di apprendere diverse caratteristiche visive e linguistiche, facilitando una comprensione multimodale senza soluzione di continuità.

- Architettura del trasformatore: Costruito sulla robusta Architettura del trasformatore, il modello sfrutta entrambi i codificatore e al decoder strutture per elaborare input di testo e immagini, generando output altamente accurati. Il suo meccanismo di auto-attenzione consente di concentrarsi sui componenti critici nei dati di input, migliorandone la precisione.

- Ottimizzazione dell'apprendimento per rinforzo: Qwen2.5-VL-32B trae vantaggio dall'apprendimento per rinforzo, dove viene messo a punto in base al feedback umano. Questo processo assicura che le risposte del modello siano più allineato con le preferenze umane ottimizzando al contempo molteplici obiettivi quali precisione, logicae scioltezza.

- Allineamento visivo-linguistico: Attraverso apprendimento contrastivo e strategie di allineamento, il modello garantisce che entrambi caratteristiche visive e al informazioni testuali sono adeguatamente integrati nel spazio linguistico, rendendolo altamente efficace per compiti multimodali.

Punti salienti delle prestazioni

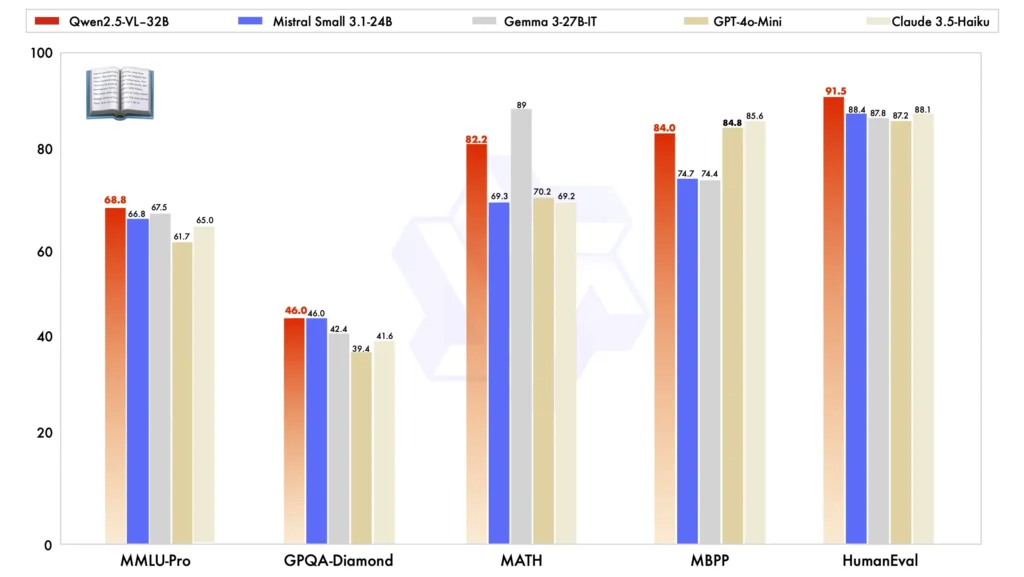

Rispetto ad altri modelli su larga scala, Qwen2.5-VL-32B si distingue in diversi benchmark chiave, mostrando il suo prestazioni superiori in entrambi multimodale e al attività di testo normale:

Confronto di modelli:Contro altri modelli come Mistral-Piccolo-3.1-24B e al Gemma-3-27B-IT, Qwen2.5-VL-32B dimostra capacità notevolmente migliorate. In particolare, è persino supera il più grande Qwen2-VL-72B in vari compiti.

Prestazioni di attività multimodali: Nel complesso compiti multimodali ad esempio MMMU, MMMU-Proe MatematicaVista, Qwen2.5-VL-32B eccelle, fornendo risultati precisi che lo distinguono da altri modelli di dimensioni simili.

Benchmark MM-MT-Bench: Rispetto al suo predecessore, Qwen2-VL-72B-Instruct, la nuova versione mostra un miglioramento significativo, in particolare nella sua ragionamento logico e al ragionamento multimodale capacità.

Prestazioni del testo normale: Nelle attività basate su testo normale, Qwen2.5-VL-32B è emerso come il più performante nella sua categoria, offrendo generazione di testo avanzata, ragionamentoe precisione complessiva.

Risorse del progetto

Per gli sviluppatori e gli appassionati di intelligenza artificiale che desiderano approfondire l'argomento Qwen2.5-VL-32B, sono disponibili diverse risorse chiave:

- Sito ufficiale: Progetto Qwen2.5-VL-32B

- Modello HuggingFace: HuggingFace Qwen2.5-VL-32B-Istruisci

Applicazioni del mondo reale

La versatilità del Qwen2.5-VL-32B lo rende adatto a un'ampia gamma di applicazioni pratiche in vari settori:

Servizio clienti intelligente: Il modello può essere impiegato per gestire automaticamente le richieste dei clienti, sfruttando la sua capacità di comprendere e generare risposte basate su testo e immagini.

Assistenza educativa: Risolvendo problemi matematici, interpretariato contenuto dell'immaginee spiegando i concetti, può migliorare significativamente il processo di apprendimento degli studenti.

Annotazione di immagine: Nei sistemi di gestione dei contenuti, Qwen2.5-VL-32B può automatizzare la generazione di didascalie di immagini e al descrizioni, rendendolo uno strumento prezioso per i settori dei media e della creatività.

Guida autonoma: Analizzando la segnaletica stradale e le condizioni del traffico attraverso le sue capacità di elaborazione visiva, il modello può fornire informazioni in tempo reale per migliorare sicurezza di guida.

Creazione di contenuti:Nei media e nella pubblicità, il modello può generare testo basato su stimoli visivi, aiutando i creatori di contenuti a produrre narrazioni accattivanti per video e pubblicità.

Prospettive e sfide future

Sebbene Qwen2.5-VL-32B rappresenti un balzo in avanti nell'intelligenza artificiale multimodale, restano ancora sfide e opportunità da cogliere. Ritocchi il modello per compiti più specifici, integrandolo con applicazioni in tempo reale e migliorandone modulabilità La gestione di set di dati multimodali più complessi sono aree che richiedono continua ricerca e sviluppo.

Inoltre, poiché vengono rilasciati più modelli di intelligenza artificiale con capacità simili, questioni etiche contenuti generati dall'intelligenza artificiale circostante, pregiudizioe privacy dei dati continuano a catturare l'attenzione. Garantire che i modelli Qwen2.5-VL-32B e simili siano addestrati e utilizzati in modo responsabile sarà fondamentale per il loro successo a lungo termine.

Argomenti correlati:I migliori 8 modelli di intelligenza artificiale più popolari del 2025

Conclusione

Qwen2.5-VL-32B è un potente strumento nell'arsenale dei modelli di intelligenza artificiale progettati per affrontare compiti multimodali con impressionante precisione e raffinatezza. Integrando tecnologie avanzate insegnamento rafforzativo, architettura del trasformatoree allineamento visivo-linguistico, non solo supera i modelli precedenti ma apre anche interessanti possibilità per settori che vanno da continua a guida autonomaIn quanto tecnologia open source, offre un potenziale enorme per sviluppatori e utenti di intelligenza artificiale per sperimentare, ottimizzare e implementare in applicazioni del mondo reale.

Come chiamare l'API Qwen2.5-VL-32B da CometAPI

1.Accesso a cometapi.comSe non sei ancora un nostro utente, registrati prima

2.Ottieni la chiave API delle credenziali di accesso dell'interfaccia. Fai clic su "Aggiungi token" nel token API nel centro personale, ottieni la chiave del token: sk-xxxxx e invia.

-

Ottieni l'URL di questo sito: https://api.cometapi.com/

-

Selezionare l'endpoint Qwen2.5-VL-32B per inviare la richiesta API e impostare il corpo della richiesta. Il metodo e il corpo della richiesta sono ottenuti da il nostro documento API del sito webPer vostra comodità, il nostro sito web fornisce anche il test Apifox.

-

Elabora la risposta API per ottenere la risposta generata. Dopo aver inviato la richiesta API, riceverai un oggetto JSON contenente il completamento generato.