クイックアンサー:2026年に開発者が最優先すべき AI モデルはどれか?

最大限の自律推論と最小限の幻覚を要するタスクには、インテリジェンス・インデックス 60 で市場をリードする GPT-5.5 (xhigh) を選ぶべきです。リアルタイムな対話性を求めるアプリケーションには、約 859 トークン/秒の速度を誇る現行のスピード王者 Mercury 2 が適しています。大規模プロダクションで予算を最優先する場合は、DeepSeek V4 Pro と Kimi K2.6 が、旗艦のプロプライエタリモデルに対してコストの約 10% で最前線級に近い知性を提供します。

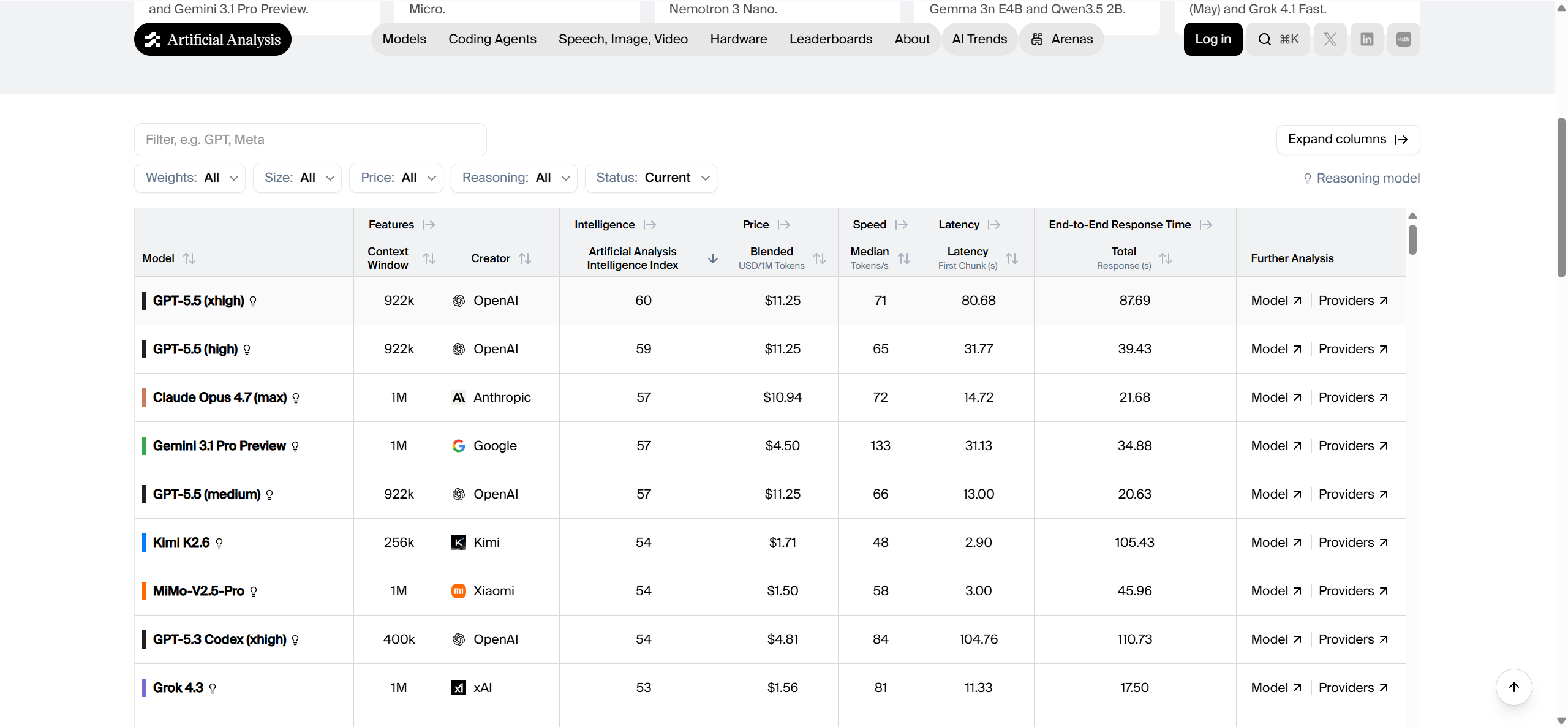

インテリジェンス・インデックス:最先端モデルのランキング

2026 年の AI の潮流は、パラメータ数の追求から「思考」密度の最適化へと移りました。Artificial Analysis Intelligence Index v4.0 は、プロフェッショナル級のコーディングや極限の論理推論を含む 10 の専門ディメンションでモデル能力を定量化する業界標準です。

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | 科学研究と論理 |

| GPT-5.5 (high) | 59 | 922K | プロフェッショナル級のコーディング |

| Claude Opus 4.7 (max) | 57 | 1M | 自律エージェントと計画立案 |

| Gemini 3.1 Pro | 57 | 1M - 2M | マルチモーダルデータ統合 |

| Kimi K2.6 | 54 | 256K | ターミナル中心のエージェント業務 |

| MiMo-V2.5-Pro | 54 | 1M | フルスタックソフトウェアエンジニアリング |

| DeepSeek V4 Pro (Max) | 52 | 1M | スケーラブルな推論ワークフロー |

| GLM-5.1 | 51 | 200K | 長期的な自律タスク |

この表の読み方

上位 5 つのモデルのうち、3 つは GPT-5.5 モデル、GPT-5.5 Medium、Claude Opus 4.7、そして Gemini 3.1 Pro。これら 3 つの欧米の旗艦モデルは互角の争いを繰り広げる一方で、Kimi K2 と mimo-v2.5 pro という 2 つの中国系モデルは、極めて競争力の高い価格でトップクラスに匹敵する性能を示しています。

Artificial Analysis Intelligence Index は、Terminal-Bench Hard や IFBench といった独立した評価に基づく正規化指標です。1 ポイントの差は、モデルの「自律性のしきい値」に統計的に有意な差があることを意味します。たとえば、GPT-5.5(60)と Claude Opus 4.7(57)の 3 ポイント差は、数ステップごとに人手の介入が必要なモデルと、複雑な論理チェーンを自力で完了できるモデルの違いに相当することが多いのです。インデックスが高いほど、「Humanity's Last Exam」における成功率の向上や、エージェント環境でのツールコールエラーの減少と一般に相関します。

反射神経:レイテンシと生成速度

ライブ IDE アシスタントから顧客向け音声エージェントまで、インタラクティブなソフトウェアでは、粗い意味での知性よりも、Time to First Token(TTFT) と 生成スループット が優先されます。

最速モデル Top 5(スループット)

スループットは、初期処理フェーズの後にモデルがテキストを生成する速度を測定します。長文コンテンツ生成や迅速なコードリファクタリングには高いスループットが不可欠です。

- Mercury 2: 約 859 トークン/秒

- Granite 4.0 H Small: 約 407 トークン/秒

- Granite 3.3 8B: 約 365 トークン/秒

- Gemini 3.1 Flash-Lite**** : 約 331 トークン/秒

- Qwen3.5 0.8B: 約 287 トークン/秒

最低レイテンシ Top 5(TTFT)

レイテンシは、最初のトークンがユーザーに届くまでの遅延を示します。これは UI/UX の「vibe」や体感的な応答性にとって重要な指標です。

- NVIDIA Nemotron 3 Nano: 約 0.40 秒

- Ministral 3 3B: 約 0.47 秒

- Qwen3.5 0.8B: 約 0.52 秒

- LFM2 24B A2B: 約 0.55 秒

- Grok 3 mini Reasoning: 約 0.58 秒

2026 年のモデル選定方法

モデル選定では、「Intelligence-per-Dollar」比率と、アプリケーション特有の稼働要件のバランスを取る必要があります。2026 年の市場は、3 つの明確なアーキテクチャ路線に分化しました。

独立開発者と予算重視チーム

個人開発者や、数千回規模の実験的エージェントループを回す小規模チームには、DeepSeek V4 Pro が最適な戦略的選択です。これは 1.6T パラメータの Mixture-of-Experts(MoE)アーキテクチャを採用し、トークンあたり 49B パラメータのみがアクティブ化されるため、約 $0.416/100 万トークンで旗艦級の性能を実現します。コーディング特化のタスクには Kimi K2.6 も優れた選択で、ターミナルファーストのワークフローに特化しています。これらのモデルは、プレミアムモデルの推論力のほぼ 90% を、コストは約 70〜80% 削減した水準で提供し、スタートアップの資金的なランウェイを実質的に延長します。

企業の本番環境

安定性と複雑なシステムプロンプトの遵守が最優先となる全社的展開では、業界標準は GPT-5.5 Pro と Claude Opus 4.7 のままです。GPT-5.5 Pro は高リスク領域向けに設計され、投資銀行のモデリングや科学探究のように、エラーのコストが API コールのコストを上回る分野で卓越します。Claude Opus 4.7 は、マルチデイのプロジェクトで持続的な信頼性を要するチームから支持されており、ターミナル環境での幻覚率が GPT 系全般より有意に低いことが示されています。企業は通常、CometAPI を介してこれらのモデルを単一ゲートウェイで統合し、99.9% の稼働率と、主要プロバイダに地域レイテンシのスパイクが発生した際の即時フェイルオーバーを確保します。

リアルタイム双方向アプリケーション

リアルタイムのカスタマーサポートボットや即時の動画キャプション生成など、「即応的」で瞬時性を感じる AI が求められるカテゴリでは、Mercury 2 と Gemini 3.1 Flash-Lite が優れた選択肢です。Mercury 2 は標準的な推論モデルのほぼ 10 倍に迫るスループットを実現し、リアルタイムの文書起案に最適です。Gemini 3.1 Flash-Lite はバランスの取れたマルチモーダル能力を備え、テキスト・音声・画像を統合コンテキスト内で処理しつつ、従来世代比で約 2.5 倍の速度を達成、さらに 100 万トークンのコンテキストウィンドウをサポートします。

コンテキストウィンドウ:スニペットからリポジトリ全体へ

コンテキストウィンドウは、モデルの「短期記憶」として機能します。2026 年の業界は、標準的なウィンドウ(128K)とリポジトリ規模(1M〜10M)に二分化しています。

- Llama 4 Scout: 10,000,000 トークン

- Grok 4.20: 2,000,000 トークン

- Gemini 3.1 Pro: 約 1,048,576 トークン

- DeepSeek V4 Pro: 1,000,000 トークン

- GPT-5.5 Pro: 1,050,000 トークン

コンテキストサイズが効くのはいつか?

128K のコンテキストウィンドウ(DeepSeek-V3.2 などの標準レンジ)は、基本的な対話チャットや個別記事の要約におけるベースラインです。しかし、プロフェッショナルなソフトウェアエンジニアリングには「システム全体」の把握が必要です。

100 万トークンのウィンドウは、AI エージェントが単一のフォワードパスで、すべてのソースファイル、ドキュメント、履歴ログを含むソフトウェアリポジトリ全体を取り込むことを可能にします。これにより、従来の RAG システムにおけるチャンキングで関連データを取りこぼすことに起因する「メモリドリフト」を防ぎます。具体例として、コードベースのリファクタリングでは、100 万トークンのモデルなら、コアのデータベーススキーマ変更が別々のファイルにまたがる 50 の API エンドポイントにどう影響するかを把握できます。一方で、より小型のモデルは一度に数ファイルしか「見えず」、依存関係の破綻を引き起こしがちです。

経済比較:100 万トークンあたりの単価

以下の表は、現実的な利用パターンを反映した入力:出力 = 3:1 の比率を前提に、ブレンド USD/100 万トークン 指標を用いています。

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | 約 $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | 約 $10.00 | High | 20% OFF |

| Gemini 3.1 Pro | 約 $4.50 | Balanced | 20% OFF |

| Kimi K2.6 | 約 $1.71 | High-Value | 20% OFF |

| DeepSeek V4 Pro | 約 $0.53 | Extreme-Value | 20% OFF |

| Qwen3.5 0.8B | 約 $0.02 | Utility | 20% OFF |

All rates verified as of May 2026. Official vendor rates are typically 20% higher than the discounted rates provided through unified gateways.

コスト最適化戦略

アーキテクチャ設計を支援するため、一般的な 3 つの成長段階における月次支出を試算しました。

- 小規模開発チーム(1000 万トークン/月): 機能実装に Kimi K2.6、簡易ロジックに DeepSeek V4 Flash を主に用いるチームは、月間 $15〜$40 程度の支出になります。これは積極的なプロトタイピングを、一般的な SaaS サブスクリプションと同程度の負担で可能にします。

- 中規模 SaaS(1 億トークン/月): Claude Sonnet 4.6 と Gemini 3.1 Flash を用いて AI 駆動の自動化プラットフォームを拡大するスタートアップは、月間 $250〜$550 を見込みます。これらのモデルで利用可能なプロンプトキャッシュを使うと、実効コストはさらに 15% 低下することが多いです。

- 大企業(10 億トークン/月): GPT-5.5 と Claude Opus 4.7 で高並列のエージェントワークフローを運用するグローバル企業では、月間 $3,000〜$6,500 程度となる見込みです。この規模では、統一 API ゲートウェイによる統合が、請求の一元化や複数ベンダーの個別契約管理に伴うオーバーヘッド回避の観点から不可欠になります。

結論:2026 年の進むべき道を選ぶ

「万能モデル」の時代は終わりました。現代の AI アーキテクチャは、GPT-5.5 を高計算の推論に、Mercury 2 を対話性に、DeepSeek V4 を大規模実行に、といった具合に、特化モデル群をオーケストレーションすることを求めます。CometAPI に一度統合すれば、ベンチマークの進化に合わせてモデルを入れ替える可搬性を獲得しつつ、すべてのリクエストで恒常的に 20〜40% の割引を享受できます。

FAQ

現時点で最も高い知性を持つ AI モデルは?

Artificial Analysis Intelligence Index v4.0 によれば、GPT-5.5 (xhigh) がスコア 60 で最も高い知性を示しています。次点は GPT-5.5 (high) の 59、Claude Opus 4.7 (max) の 57 です。

リアルタイム用途で最速の AI モデルは?

Mercury 2 が 2026 年のスピード王者で、約 859.1 トークン/秒を実現します。レイテンシ(TTFT)が最も低いのは NVIDIA Nemotron 3 Nano で、約 0.40 秒の応答です。

本番エージェントにはどの程度のインテリジェンス・インデックスが必要?

基本的な自動化や分類には 30〜40(たとえば GPT-5.4 nano)で十分な場合が多いです。しかし、AI がコードベースやブラウザセッション全体を管理する「Agentic Engineering」では、長期的な計画を一貫して遂行するために、Kimi K2.6 や GPT-5.5 のような 54 以上を推奨します。

価格が近い場合、GPT-5.5 と Claude Opus 4.7 のどちらを選ぶべき?

ワークフローがターミナル実行や「Vibe Coding」を含むなら、GPT-5.5 がそれらのベンチマークで概して優勢です。一方、プロフェッショナルなライティング、法務調査、低幻覚率でのマルチデイのエージェント運用といった極端な一貫性を要する場合は、Claude Opus 4.7 がそのカテゴリで実証済みのリーダーです。

オープンウエイト(DeepSeek)とプロプライエタリモデルの実際の性能差は?

2026 年時点では、生の推論系ベンチマークで約 10〜15% まで差が縮小しています。「ピーク」論理では GPT-5.5 (xhigh)(Index 60)が先行しますが、オープンウエイトの DeepSeek V4 Pro(Index 52)や Kimi K2.6(Index 54)は、コストが約 1/10 で能力の 85% 超を提供します。

これらのモデルの API コストを全体的に下げる方法は?

CometAPI のような統一 API レイヤーを利用すると、一括調達とインテリジェントなパスルーティングにより、公式ベンダー価格より 20%〜40% 低い レートでカタログ全体にアクセスできます。

長文向けの最大コンテキストウィンドウを持つモデルは?

現在、市場で最大のコンテキストウィンドウをサポートするのは Llama 4 Scout(1000 万トークン)です。続くのは Grok 4.20(200 万トークン)で、GPT-5.5 Pro、Gemini 3.1 Pro、DeepSeek V4 Pro はいずれも約 100 万トークンをサポートします。

高い初期コストなしでベンチマークを試す方法はある?

はい。CometAPI に無料登録すると、クレジットカード不要でテストクレジットを受け取り、内蔵の Playground で 500 以上のモデルを横断した比較性能テストを実行できます。