ChatGPT 동영상 분석을 사용하는 개발자 경험은 자주 벽에 부딪힙니다: YouTube 링크를 직접 붙이면 실패하고, MP4 업로드는 시각적 뉘앙스를 놓친 ‘환각’ 요약을 반환합니다. 이것은 버그가 아니라 아키텍처적 제약입니다. ChatGPT는 동영상을 스트리밍하지 않으며, 추출된 프레임과 전사 텍스트의 시퀀스를 처리합니다. 그래서 MP4 파일을 올려봤더니 작동하긴 했지만… 어딘가 아쉬웠죠. 요약은 오디오 전사를 언급했지만, 전체 맥락을 이해하게 해주던 세 번째 장면의 시각적 농담은 완전히 놓쳤습니다.

ChatGPT는 동영상을 분석할 수 있지만 실제로 ‘시청’하진 않습니다

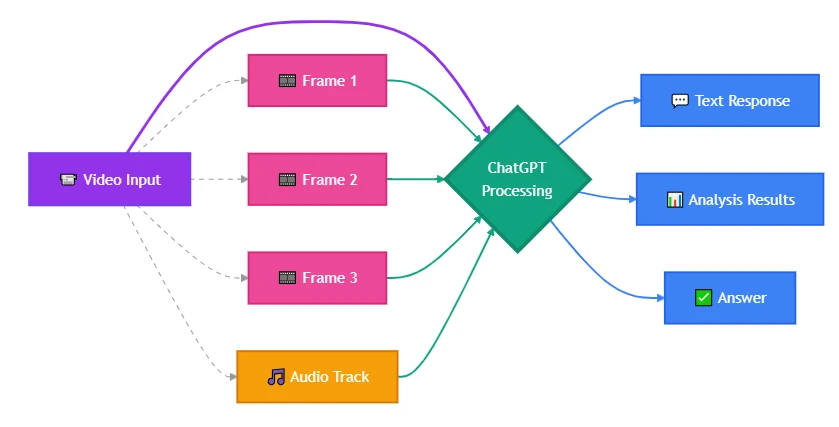

실제로는 이런 일이 벌어집니다: ChatGPT는 여러분처럼 동영상을 “본다”고 할 수 없습니다. 재생을 누르고, 콘텐츠를 스트리밍하며, 시간 흐름 속의 움직임을 관찰하지 않습니다. 대신 동영상을 이미 처리할 줄 아는 구성요소 — 정지 이미지와 텍스트 전사 — 로 분해한 뒤, 그 조각들을 각각 따로 추론합니다. 모델은 여러분의 동영상을 내레이션이 붙은 사진 앨범으로 보지, 연속적인 경험으로 보지 않습니다. 그래서 말로 된 설명은 잡았지만 시각적 펀치라인을 놓친 겁니다. 농담이 담긴 프레임이 표본으로 뽑힌 세트에 없었을 가능성이 큽니다.

누군가 “ChatGPT가 동영상을 볼 수 있나요?”라고 묻는다면, 보통 두 가지를 뜻합니다. 인간 관찰자처럼 시각 콘텐츠를 스트리밍할 수 있느냐, 아니면 장면·대화·타임스탬프·화면상의 동작 같은 동영상 데이터에서 의미를 추출하고 분석할 수 있느냐. 기능적인 답은 두 번째에는 “예”지만, 특정 사용 사례를 완전히 깨뜨리는 제약이 있습니다. 최신 ChatGPT 변형은 동영상을 표본 추출된 프레임과 오디오 전사의 결합으로 취급해 처리합니다. 웹 인터페이스에서 자동 추출되거나, API로 사용자가 제공한 프레임을 받는 방식입니다. 이것은 요약, 장면 설명, 텍스트 추출에는 잘 작동합니다. 반면 모션 트래킹, 타이밍에 의존하는 분석, 프레임 사이에서 벌어지는 일을 모델이 “보도록” 요구하는 과제에는 실패합니다.

대부분의 가이드는 기능이 존재한다는 확인에서 그치고, 왜 여러분의 특정 구현이 실패했는지 — 혹은 어떤 대체 입력 방법이 맞는지 — 를 설명하지 않습니다.

ChatGPT 동영상 기능: 모델이 실제로 보는 것

ChatGPT는 MP4를 로드해서 프레임 단위로 스크럽하지 않습니다. 모델은 정지 이미지를 분석하는 비전 기능과 Whisper 통합을 통한 오디오 전사를 갖고 있습니다. 웹이나 모바일 인터페이스를 통해 동영상을 제출하면, 시스템이 키프레임을 추출하고 오디오는 별도로 전사해, 둘을 분리된 입력으로 모델에 제공합니다. 모델은 프레임에서 “본” 것과 전사에서 “들은” 것을 바탕으로 설명을 생성합니다.

여러분 관점에서는 동영상 이해처럼 보이지만, 모델 관점에서는 이미지 분석 + 텍스트 처리입니다. 이 아키텍처적 차이가 어떤 사용 사례가 작동하고 어떤 것은 실패하는지를 결정합니다.

동영상이 모션, 프레임 간 미묘한 변화, 정밀한 타이밍에 의존한다면 — 예를 들어 특정 객체가 언제 프레임에 들어오는지 정확히 감지하거나, UI 요소가 어떻게 애니메이션되는지 추적하는 과제 — 키프레임 기반 접근은 이를 놓칩니다. ChatGPT는 표본 프레임 사이에 등장하는 2초짜리 시각적 단서를 잡지 못합니다. 또한 명시적으로 진행 과정을 보여주도록 입력을 구조화하지 않으면 시간 축을 따라 객체를 추적하지도 못합니다.

현재 ChatGPT의 동영상 기능(2026년 초 기준):

- 이미지 기반 동영상 분석: 동영상 파일 또는 추출된 프레임을 수용하고, 표본 이미지에서 시각 콘텐츠를 해석

- 오디오 전사: Whisper를 통해 음성을 텍스트로 변환하고, 모델이 전사를 요약·질의 가능

- 장면 설명: 제공된 프레임에서 보이는 객체, 동작, 환경, 텍스트 식별

- 타임스탬프 기반 질의: 프레임 타임스탬프를 제공하거나 수동으로 동영상을 분할하면 특정 순간을 참조 가능

- 텍스트 추출: 화면 자막, UI 라벨, 프레임에 보이는 문서의 텍스트를 읽기

ChatGPT 웹 인터페이스의 구체적 프레임 샘플링 속도와 자동 키프레임 선택 동작 — 지식 컷오프 시점 기준으로는 공개 문서화되지 않음

다음은 포함되지 않습니다:

- API를 통한 실시간 스트리밍 동영상 입력

- 프레임 정밀 모션 트래킹 또는 시간 축에서의 객체 지속성

- 비디오 코덱에 대한 네이티브 지원 — 모든 처리는 추출된 프레임과 오디오에서 수행

- 명시적 사용자 프롬프트 없이 자동 장면 전환 감지

처리 용량은 재생 시간보다 토큰 한도와 파일 크기에 의해 제한됩니다. 5–10분은 실무적 휴리스틱이며, 실제 한계는 시각 밀도에 따라 동적으로 확장됩니다.

해당 기능이 필요하다면, 동영상을 직접 전처리해 적절한 프레임을 추출하거나 네이티브 비디오 지원 모델로 전환해야 합니다. 다음 섹션에서는 특정 시나리오에 맞는 입력 방법을 정리합니다.

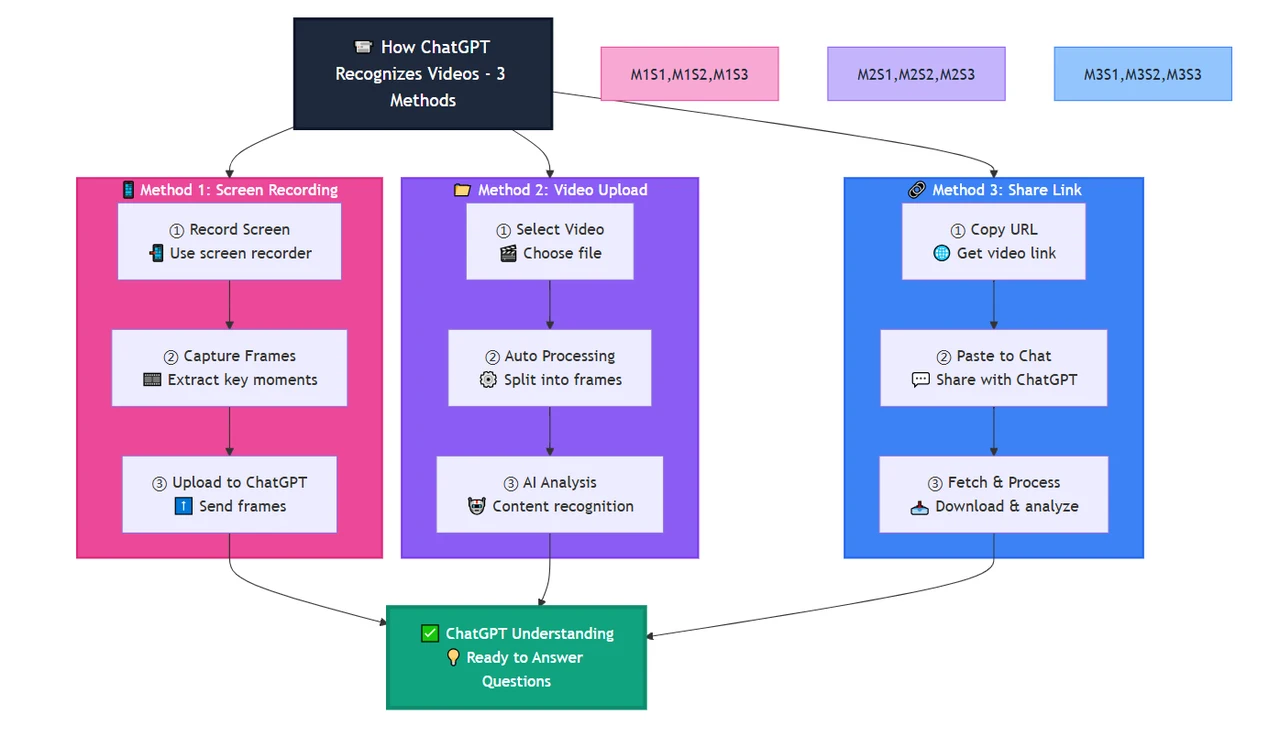

ChatGPT가 동영상을 인식하는 방법: 세 가지 실용적 방식

ChatGPT에 동영상을 제출하는 방법은 하나가 아닙니다. 선택한 방법이 모델이 무엇을 분석할 수 있고 무엇을 놓칠지를 좌우합니다. 대부분의 구현 실패는 편한 방법을 골라야 할 때 올바른 방법을 고르지 않은 데서 발생합니다.

방법 1: 수동 프레임 추출 + 이미지 업로드

ffmpeg 같은 도구로 직접 프레임을 추출한 뒤, 그 프레임들을 이미지로 업로드하세요. 이렇게 하면 ChatGPT가 분석할 내용을 완전히 통제할 수 있습니다.

예시 워크플로(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

이 접근의 장점:

- 중요 순간(인트로, 핵심 동작, 결론)에 분석을 집중해, 불필요한 구간으로 컨텍스트를 낭비하지 않음

- 원하는 샘플링 속도로 연속된 프레임을 업로드해 모션을 포착

- 파일 크기 제한을 우회 — 이미지가 전체 동영상보다 작음

- 자동 압축 과정에서 품질 저하를 피하고 프레임 품질 보존

트레이드오프:

전처리를 직접 처리해야 합니다. 수백 개의 동영상을 규모 있게 분석하려면 자동화가 필요합니다. 단발성 심층 분석이나 특정 장면 디버깅에는 가장 신뢰할 수 있는 방법입니다.

이 방법을 사용할 때:

- 특정 순간에 대한 프레임 정확 분석이 필요할 때

- 중요한 시각 정보가 짧게 나타나거나 일반적 키프레임 간격 사이에 나타날 때

- 시퀀스 전반의 시각 변화를 비교할 때(UI 상태 변화, 애니메이션 프레임)

- 업로드한 정확한 프레임을 확인해 모델이 실제로 “무엇을 보았는지” 검증하고 싶을 때

방법 2: ChatGPT 인터페이스로 직접 파일 업로드

ChatGPT 웹·모바일 앱은 채팅에 동영상 업로드를 직접 지원합니다. MP4나 MOV 파일을 입력 필드에 드롭하면, 시스템이 프레임 추출과 전사를 자동으로 처리합니다.

내부에서 벌어지는 일:

- 서비스가 특정 간격으로 프레임을 샘플링함(문서화된 정확한 비율 없음; 관찰상 초당 1–2프레임 추정)

- 오디오는 Whisper 또는 유사 서비스로 전사

- 두 결과물이 분리된 컨텍스트 입력으로 모델에 전달

- 모델은 프레임에서 보이는 것과 전사에서 들은 것을 바탕으로 응답 생성

이 방법이 적합한 경우:

- 프레임 정밀도가 필요 없는 고수준 동영상 요약

- 장면 전반에 지속적으로 등장하는 핵심 객체, 인물, 환경 식별

- 여러 프레임에 걸쳐 나타나는 음성 콘텐츠나 화면 텍스트 추출

- 전처리 없이 빠르게 탐색적 분석 수행

이 방법이 실패하는 경우:

- 프레임 정밀 분석 — 어떤 프레임이 샘플링되는지 통제할 수 없음

- 모델의 안정적 컨텍스트 용량을 넘는 장시간 동영상은 논리적 분할이 필요. 전략적 청킹이나 전처리 없이 시각 밀도가 높은 콘텐츠를 투입하면 토큰 소비가 급증하면서 성능 저하나 생략이 발생할 수 있음

- 연속 프레임 비교가 필요한 모션, 전환, 타이밍 의존 콘텐츠 감지

- 중요한 시각 정보가 일반 샘플링 간격 사이에 잠깐(1–2초) 나타나는 시나리오

분석할 순간을 통제해야 한다면 방법 1을 사용하세요.

방법 3: YouTube 링크 + 전사 가져오기

일부 ChatGPT 플러그인과 서드파티 도구는 “YouTube 동영상을 분석한다”고 주장합니다. 실제로는 공개 메타데이터와 전사(가능한 경우)를 가져와 그 텍스트를 ChatGPT에 전달합니다.

작동하는 경우:

- 동영상에 자동 생성 또는 업로드된 자막이 있을 때

- 분석이 시각 정보가 아니라 음성 콘텐츠에만 의존할 때

- 동영상이 공개 접근 가능(비공개·미등록·지역 제한 아님)할 때

- 의미의 대부분이 오디오에 담긴 강의, 팟캐스트, 인터뷰 요약

작동하지 않는 경우:

- 시각 콘텐츠(온스크린 데모, 다이어그램, 표정)를 분석해야 할 때

- 전사나 자막이 없을 때

- 중요한 정보가 대화에서 언급되지 않고 시각적으로만 나타날 때

- 비공개 파일이나 인증 뒤의 콘텐츠를 다룰 때

흔한 실수: 개발자들이 시각 + 오디오의 완전한 동영상 이해를 기대하지만, 실제로는 전사 요약만 받습니다. 말해진 내용의 콘텐츠 분석에는 괜찮지만, 제품 데모 리뷰, 시각 디자인 분석, “보는 것”이 말보다 중요한 시나리오에는 무용지물입니다.

패턴: 정밀함이 중요하지 않은 빠른 요약에는 방법 2. 특정 프레임이 필요한 통제된 분석에는 방법 1. 시각 정보가 부차적이거나 없는 오디오 중심 콘텐츠에는 방법 3. 핵심 정보가 어디에 있는지 — 모션, 특정 프레임, 순수 대화 — 에 따라 선택하세요.

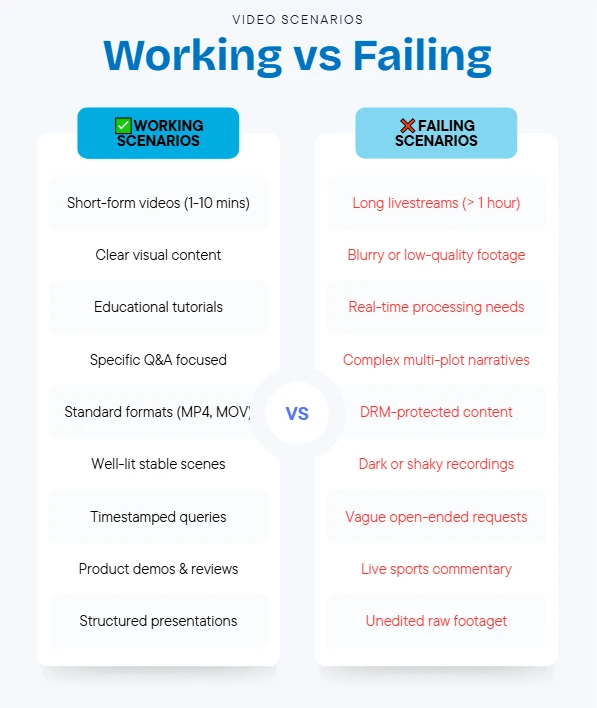

ChatGPT 동영상 적용 시나리오: 실제 프로덕션에서 통하는 것들

ChatGPT가 동영상 구성요소를 처리할 수 있다는 사실은, 여러분 문제에 적합한 도구인지 여부를 알려주지 않습니다. 다음 시나리오는 프레임 기반 분석이 성공하는 곳과, 아키텍처 제약이 사용 사례를 깨뜨리는 지점을 보여줍니다.

시나리오 1: 교육 콘텐츠 요약

사용 사례: 10분짜리 튜토리얼 동영상에서 핵심 단계, 언급된 도구, 시각적 예시를 구조화해 요약해야 합니다.

작동 이유: 교육용 동영상은 일반적으로 명확한 장면 경계, 지속적인 온스크린 텍스트, 시각과 정렬된 내레이션을 갖습니다. 발표자는 보여주는 것을 말로 설명하며, 보여지는 동안 말합니다. ChatGPT는 설명을 전사하고, 표본 프레임의 도구나 다이어그램을 식별한 뒤, 둘을 결합해 구조화된 결과를 냅니다.

구현 접근: ChatGPT 인터페이스로 동영상을 업로드하거나, 주요 주제 전환마다 8–12개의 키프레임을 추출하세요. 프롬프트: “내레이션과 화면의 텍스트·다이어그램·도구 이름을 모두 참조해 이 동영상에서 설명된 주요 단계를 나열하라.”

깨지는 지점: 연속 모션에 의존하는 동영상 — 예: 강사가 여러 파일을 빠르게 타이핑하는 코딩 스크린캐스트 — 은 프레임 사이의 단계가 빠질 수 있습니다. 더 높은 프레임 샘플링 비율이 필요하거나 오디오 전사에 집중해야 합니다.

실무 팁: 강의·튜토리얼 콘텐츠에는 자동 업로드(전사 확보)와, 가장 중요한 시각 순간 3–5개의 수동 프레임 추출을 결합하세요. 포괄적 오디오 커버리지와 핵심 개념의 고품질 이미지를 동시에 얻습니다.

시나리오 2: 제품 데모 분석

사용 사례: 경쟁사의 제품 데모를 검토하며, 화면의 UI 요소, 기능명, 사용자 플로우, 가격 정보를 추출하고 싶습니다.

작동 이유: 제품 데모는 보통 각 화면을 충분히 오래 보여주므로, 표본 프레임이 정적 UI를 포착합니다. 텍스트 오버레이, 버튼 라벨, 메뉴 구조, 가격 표는 여러 프레임에 걸쳐 보입니다. ChatGPT의 비전 기능은 내레이션에서 언급되지 않아도 이런 요소들을 읽고 설명할 수 있습니다.

구현 접근: 주요 장면 전환(인트로 슬라이드, 기능 1 데모, 기능 2 데모, 가격 화면, CTA)에서 프레임을 추출하세요. 업로드 후 프롬프트: “각 프레임마다 보이는 모든 UI 요소, 버튼 라벨, 기능명, 표시된 가격/제품 정보를 식별하라.”

깨지는 지점: 빠른 화면 전환, 잠깐 나타나는 호버 상태, 1–2초만 보여주는 인터랙티브 요소는 프레임 샘플링에서 빠질 수 있습니다. 경쟁사가 기능 비교표를 잠깐 번쩍 보여주면, 그 정확한 순간이 표본으로 뽑히지 않으면 놓칩니다.

실무 팁: 중요한 공개 순간의 타임스탬프를 먼저 수동으로 찾아보세요. 일정 간격 샘플링에 의존하지 말고 그 순간의 프레임을 추출하세요.

시나리오 3: 시각 컨텍스트가 포함된 미팅/인터뷰 전사

사용 사례: 클라이언트 콜을 녹화했고, 전사와 함께 특정 문서, 슬라이드, 화면 공유가 나타난 시점을 주석으로 표시해야 합니다.

작동 이유: 오디오 전사는 대화를 처리합니다. 참가자가 화면을 공유하거나 문서를 보여줄 때, 샘플링된 프레임에 등장합니다. ChatGPT는 전사 옆에 “대략 [timestamp]에 계약 문서가 화면에 보임” 같은 주석을 달 수 있어, 시각 자료를 참조하는 회의록에 유용합니다.

구현 접근: 동영상을 업로드하고 프롬프트: “이 미팅을 전사하고, 문서·프레젠테이션 슬라이드·화면 공유·그 외 시각 레퍼런스가 나타난 순간을 모두 기록하라. 각 시각 요소에 대해 무엇이 보였는지 설명하라.”

깨지는 지점: 5–10초 미만의 짧은 화면 공유는 표본 프레임 사이에서 빠질 수 있습니다. 압축된 프레임에서 텍스트가 너무 작으면 읽을 수 없습니다. 법무·컴플라이언스처럼 화면 문서의 축자 정확성이 필요한 경우, 의존하기 전에 프레임 품질과 샘플링 범위를 검증하세요.

실무 팁: 중요한 회의는 더 높은 해상도로 녹화하고, “이 문서를 보여드릴게요” 같은 발화 직후 순간에 수동으로 프레임을 추출하세요 — 곧 시각 참조가 나타난다는 신호입니다.

시나리오 4: 콘텐츠 모더레이션 또는 컴플라이언스 검토

사용 사례: 사용자 업로드 동영상을 스캔해 금지된 콘텐츠 — 특정 로고, 텍스트 패턴, 정책 위반 시각 요소 — 를 탐지해야 합니다.

작동 이유: ChatGPT는 프레임에서 보이는 텍스트, 식별 가능한 객체, 장면 설명을 스캔할 수 있습니다. “이 동영상 중 어떤 것이 특정 경쟁사 로고를 포함하는가”를 확인한다면, 1–2초 이상 화면에 남는 로고는 프레임 기반 분석으로 잡아낼 수 있습니다.

구현 접근: 3–5초 간격으로 프레임을 추출해 업로드하고 프롬프트: “이 프레임들을 리뷰해 [특정 로고, 브랜드명, 금지 심볼 등]이 포함된 프레임을 식별하라. 각 매치에 대해 프레임 어디에 나타나는지 설명하라.”

깨지는 지점: 오디오 기반 위반(저작권 음악, 금지 발언)은 별도의 오디오 분석이 필요합니다. 모션 기반 위반(금지된 제스처, 여러 프레임에 걸친 행동)은 정지 프레임 분석으로는 잡히지 않습니다. 잠깐 번쩍이는 금지 콘텐츠는 표본 프레임에 나타나지 않을 수 있습니다.

실무 팁: ChatGPT의 시각 스캐닝을 전용 오디오 핑거프린팅 서비스 및 고위험 카테고리에서는 더 높은 프레임 샘플링 비율과 결합하세요. ChatGPT는 1차 필터로 사용하고, 유일한 모더레이션 계층으로 쓰지 마세요.

성공 시나리오의 공통점: 의미 있는 콘텐츠가 분리된 안정 프레임에 존재하고, 오디오나 텍스트 요소와 상관관계를 가집니다. 실패는 중요한 정보가 모션·타이밍·전환에 있거나, 표본으로 잡히기엔 너무 짧게 나타날 때 발생합니다.

Gemini의 동영상 기능 vs. Claude의 동영상 기능 vs. ChatGPT

ChatGPT의 프레임 샘플링 아키텍처가 사용 사례에 맞지 않는다면, 대안을 평가하게 됩니다. Gemini와 Claude는 서로 다른 동영상 관련 기능을 제공하며 — 이 차이가 특정 구현에 어떤 모델이 적합한지를 결정합니다.

Gemini의 네이티브 동영상 처리

Gemini 모델은 API 수준에서 네이티브 동영상 입력을 지원합니다. 프레임 전처리 없이 동영상 파일을 직접 전달합니다. 모델은 동영상을 연속 스트림으로 처리해, 모션 트래킹, 장면 전환 감지, ChatGPT의 프레임 기반 접근으로는 어려운 시계열 추론을 수행합니다.

Gemini가 유리한 사용 사례 예:

30초 클립에서 특정 객체가 프레임에 들어오고 나가는 시점을 감지하거나, 인물이 장면을 가로지르는 움직임을 추적해야 합니다. Gemini는 프레임 전반에서 객체를 따라가며 모션을 추론합니다. ChatGPT는 샘플링된 프레임에서만 객체를 보기 때문에, 진입/이탈을 놓칠 수 있습니다.

트레이드오프:

- Gemini의 네이티브 API는 OpenAI의 프레임 기반 샘플링보다 비용 효율적입니다. 컨텍스트 캐싱으로 선형 토큰 오버헤드를 피함으로써, 장기 분석에서 더 잘 확장됩니다.

- 긴 동영상 처리에는 더 높은 지연이 발생 — 응답 전 파일 전체를 수집해야 함

- 모든 Gemini 변형이 동영상 입력을 지원하는 것은 아님 — 이후 모델 필요

- 동영상 길이 제한이 존재하나, ChatGPT의 컨텍스트 기반 한도보다 관대함

ChatGPT 대신 Gemini를 선택할 때:

- 모션 트래킹, 장면 경계 감지, 시간 관계 이해가 필요할 때

- 중요한 정보가 프레임 사이에서 빠르게 나타났다 사라질 때

- 사건의 전개가 중요(스포츠, 감시 영상, 애니메이션 분석)할 때

- 프레임 추출 전처리를 피하고 싶을 때

Claude의 현재 동영상 한계

2026년 초 기준, Claude 모델은 API로 직접 동영상 입력을 지원하지 않습니다. 이미지는 업로드(수동 추출 프레임 포함)할 수 있지만, Gemini와 같은 네이티브 동영상 처리는 제공하지 않습니다.

Claude가 할 수 있는 것:

- 업로드한 프레임 시퀀스를 ChatGPT의 수동 추출 방식(방법 2)처럼 분석

- 각 프레임의 시각 콘텐츠를 상세 묘사

- 명시적 프롬프트가 있으면 프레임 간 변화나 암시된 모션에 대해 추론

- 더 큰 컨텍스트 윈도우로 많은 이미지 시퀀스를 처리(최대 1M 토큰 in Claude Opus 4.7)

Claude가 할 수 없는 것:

- 어떤 인터페이스에서도 동영상 파일을 직접 수용

- 명시적 프레임별 프롬프트 없이 자동으로 모션·객체를 프레임 간 추적

- 오디오 전사 — Whisper 등 외부 도구로 전처리해 전사를 Claude에 전달해야 함

그럼에도 Claude를 선택할 때:

- 워크플로에 이미 프레임 추출 전처리가 포함되어 있을 때

- 많은 프레임과 방대한 추가 컨텍스트를 함께 분석해야 할 때

- 특정 비주얼 도메인(예: 의료 영상, 기술 도면)에서 Claude의 프레임 설명 품질이 더 정확하다고 판단될 때

- 대량 컨텍스트 윈도우와 동영상 프레임 분석을 결합해야 할 때

기능 비교 표

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direct video file upload | ✓ (web/app interface) | ✓ (API + web interface) | ✗ |

| Native motion tracking | ✗ | ✓ | ✗ |

| Audio transcription | ✓ (Whisper integration) | ✓ (integrated) | ✗ (requires external tool) |

| Frame-based analysis | ✓ | ✓ (also continuous processing) | ✓ (manual extraction only) |

| Scene change detection | ✗ (manual only) | ✓ (automatic) | ✗ |

| Typical video length handling | ~5-10 min (context limited) | ~1 hour (resolution dependent) | N/A (frame count limited by context) |

| Best use case | Quick summaries, frame-level analysis with some control | Motion tracking, temporal reasoning, continuous video | Deep frame-by-frame description with large context needs |

| API video support | ✗ (images only) | ✓ | ✗ |

의사결정 프레임워크:

- ChatGPT를 선택할 때: 빠른 동영상 요약이 필요하고, 핵심 정보가 여러 프레임에 지속적으로 나타나며, 짧은 클립(10분 이하)을 다루고, 모션 트래킹이 필요 없을 때. 교육 콘텐츠, 정적 제품 데모, 미팅 전사에 최적.

- Gemini를 선택할 때: 모션 트래킹, 장면 전환 감지, 시간에 따른 변화·움직임에 대한 추론이 필요할 때. 감시 영상, 스포츠 분석, 애니메이션 리뷰 등 “프레임 사이에서 일어나는 것”이 중요한 시나리오에 필수.

- Claude를 선택할 때: 파이프라인에 이미 프레임 추출이 있고, 많은 프레임과 방대한 추가 컨텍스트를 결합해 분석해야 하며, 특정 비주얼 도메인에서 Claude의 설명 품질이 더 낫다고 판단될 때. 전처리 부담이 가장 크지만 가장 큰 컨텍스트 윈도우 제공.

여러 모델을 병행 평가하는 개발자에게 CometAPI는 GPT, Gemini, Claude 변형을 동일한 입력으로 테스트할 수 있는 통합 인터페이스를 제공합니다. 공급자별 통합 코드를 다시 쓰지 않고도 동영상 처리 품질을 비교한 뒤 선택할 수 있습니다.

“ChatGPT가 동영상을 볼 수 있나요?”에 대한 진짜 답은 이분법적이지 않습니다. “예, 모델이 이미 다루는 형식으로 변환한 뒤 — 특정 사용 사례를 깨뜨리는 한계와 함께”입니다. 대부분의 구현 실패는 아키텍처 불일치에서 비롯됩니다. 모델은 설계대로 작동했고, 개발자가 다른 설계를 기대했을 뿐입니다.

대규모 동영상 분석 기능을 구축한다면, 먼저 에지 케이스로 워크플로를 테스트하세요: 동일한 동영상을 직접 파일 업로드, 수동 프레임 추출, 전사만으로 각각 제출해 결과를 비교합니다. 프로덕션 트래픽을 견디는 것은 구현이 가장 빠른 방법이 아니라, 여러분의 사용 사례에서 핵심 신호를 가장 잘 포착하는 방법입니다.

ChatGPT에 동영상을 도입하기 전에:

- 핵심 정보가 안정 프레임, 모션, 오디오 중 어디에 있는지 식별

- 예상 간격으로 프레임을 수동 추출해 샘플링 범위를 테스트

- 압축 후 해상도에서 화면 텍스트가 읽을 수 있는지 확인

- 구독 플랜의 실무적 컨텍스트 한도 내에 동영상 길이가 들어맞는지 검증

- 잠깐 나타나거나 샘플링 프레임 사이에 끼는 콘텐츠에 대한 폴백을 준비

동영상 워크로드에 대해 다수의 AI 공급자를 평가하는 개발자에게 CometAPI는 동일한 동영상 입력으로 ChatGPT, Gemini, Claude를 테스트할 수 있는 통합 플레이그라운드를 제공합니다 — 공급자별 통합에 착수하기 전 출력 품질, 지연, 비용을 비교할 수 있습니다.

FAQ - AI 동영상 분석 가이드

빠르게 답하는 AI 동영상 분석 FAQ.

ChatGPT가 동영상을 분석할 수 있나요?

예. ChatGPT(GPT-4o 이후)는 초당 약 1프레임 수준으로 프레임을 샘플링하고 오디오를 전사해 동영상을 분석합니다. 미팅 요약, 슬라이드의 텍스트 추출, 객체 식별에 강합니다. 다만 모션 트래킹, 10분 이상의 동영상, 실시간 스트리밍에는 약합니다.

ChatGPT에 동영상을 어떻게 업로드하나요?

직접 URL 업로드(권장): 공개 URL로 업로드해 빠르게 분석합니다. 10분 이하 동영상에 적합합니다.

수동 프레임 추출: 특정 순간을 정밀하게 분석해야 하거나 토큰 비용을 절감하고 싶을 때, 필요한 프레임만 추출해 업로드합니다.

ChatGPT가 처리할 수 있는 최대 동영상 길이는?

ChatGPT는 5–10분 길이의 동영상을 안정적으로 처리합니다. 그 이상은 동영상을 분할하거나 60분까지 네이티브로 지원하는 Gemini 2.5 Pro로 전환하세요.

ChatGPT의 동영상 분석 한계는?

- 연속 모션을 추적하지 못함(스포츠, 춤)

- 타임스탬프가 정밀하지 않음(±1초 정확도)

- 1초 미만으로 나타나는 콘텐츠를 놓침

- 실무적 한계는 약 10분

- 실시간 스트리밍 미지원

- 저화질·암부가 많은 동영상에 취약

- 시간적 인과관계 추론에 약함 *

동영상 분석에는 ChatGPT와 Gemini 중 무엇을 써야 하나요?

ChatGPT를 사용할 때:

- 10분 이하의 동영상

- 동영상 분석 이후 탁월한 텍스트 추론

- 프레임 수준 분석(슬라이드, 스크린샷)

Gemini를 사용할 때:

- 10–60분 길이의 동영상

- 모션 트래킹과 움직임 분석

- 시간적 추론 과제

- 스포츠, 춤, 감시 영상 *

Claude가 동영상을 분석할 수 있나요?

아니요. Claude는 직접 동영상 입력을 지원하지 않습니다. 하지만 동영상에서 프레임을 추출해 Claude로 분석할 수 있으며, 긴 분석에 유리한 대형 컨텍스트 윈도우와 뛰어난 텍스트 추론을 제공합니다.

동영상 분석 비용은 얼마나 드나요?

모델과 동영상 길이에 따라 다릅니다:

- ChatGPT 4o: ~$0.05 per minute

- Gemini 2.5 Pro: ~$0.04 per minute

CometAPI는 신규 사용자에게 시작 크레딧을 제공합니다.