GPT-5.2 API란 무엇인가

GPT-5.2 API는 ChatGPT의 GPT-5.2 Thinking과 동일합니다. GPT-5.2 Thinking은 OpenAI GPT-5.2 제품군의 중간 등급 모델로, 더 깊이 있는 작업을 위해 설계되었습니다. 예를 들어 다단계 추론, 장문서 요약, 고품질 코드 생성, 그리고 단순 처리량보다 정확성과 활용 가능한 구조가 더 중요한 전문 지식 업무에 적합합니다. API에서는 gpt-5.2 모델(Responses API / Chat Completions)로 제공되며, 저지연 Instant 변형과 더 높은 품질이지만 더 비싼 Pro 변형 사이에 위치합니다.

주요 기능

- 매우 긴 컨텍스트 및 압축: 400K 유효 윈도우와 장시간 대화 및 문서 전반의 관련성을 관리하기 위한 압축 도구를 제공합니다.

- 구성 가능한 추론 강도:

none | medium | high | xhigh(xhigh는 어려운 추론을 위해 최대 내부 연산을 활성화).xhigh는 Thinking/Pro 변형에서 제공됩니다. - 강화된 도구 및 함수 지원: 구조화된 출력을 제약하기 위한 퍼스트클래스 도구 호출, 문법(CFG/Lark), 그리고 복잡한 다단계 자동화를 단순화하는 향상된 에이전트형 동작을 지원합니다.

- 멀티모달 이해: 더 풍부한 이미지 + 텍스트 이해와 이를 다단계 작업에 통합하는 기능을 제공합니다.

- 향상된 안전성 / 민감한 콘텐츠 처리: 자해 및 기타 민감한 맥락과 같은 영역에서 바람직하지 않은 응답을 줄이기 위한 표적 개입이 포함됩니다.

기술 기능 및 사양(개발자 관점)

- API 엔드포인트 및 모델 ID: Thinking용

gpt-5.2(Responses API), 채팅/instant 워크플로용gpt-5.2-chat-latest, Pro 등급용gpt-5.2-pro; 표시된 경우 Responses API 및 Chat Completions를 통해 사용할 수 있습니다. - 추론 토큰 및 강도 관리: API는 요청별로 연산량(추론 강도)을 할당하기 위한 명시적 파라미터를 지원합니다. 강도가 높을수록 지연 시간과 비용은 증가하지만 복잡한 작업에서 출력 품질이 향상됩니다.

- 구조화된 출력 도구: 모델 출력을 DSL 또는 정확한 구문으로 제약하기 위한 문법(Lark / CFG)을 지원합니다(SQL, JSON, DSL 생성에 유용).

- 병렬 도구 호출 및 에이전트형 조정: 향상된 병렬성과 더 정돈된 도구 오케스트레이션으로 정교한 시스템 프롬프트와 멀티 에이전트 스캐폴딩의 필요성을 줄여줍니다.

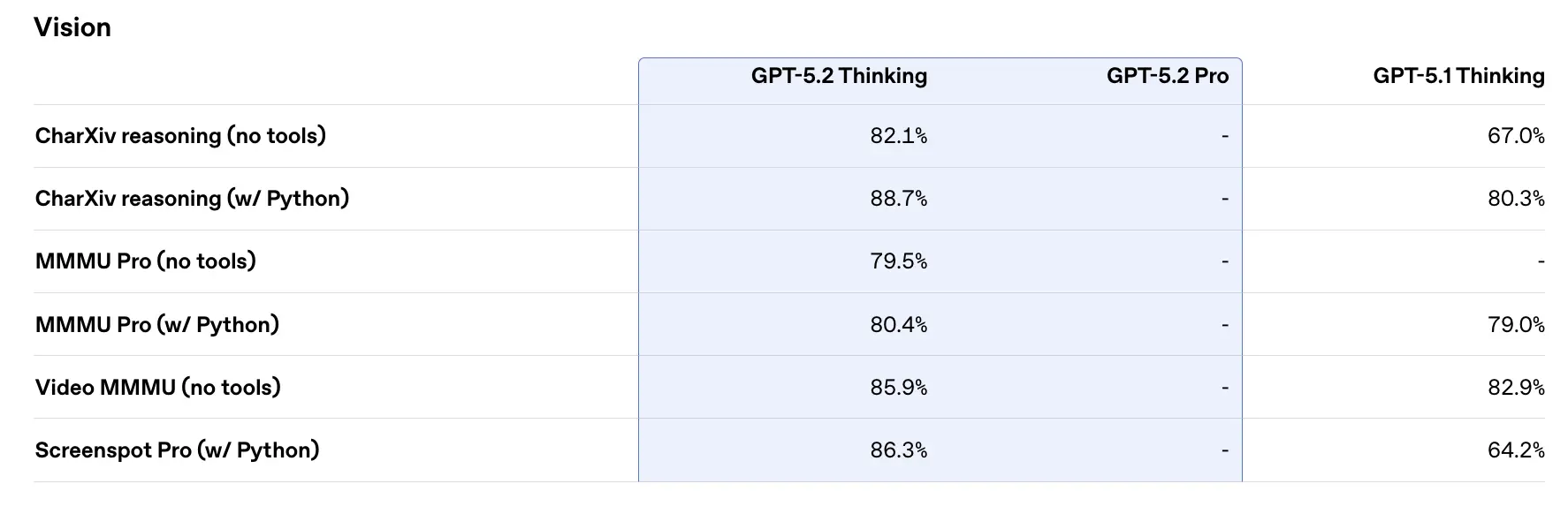

벤치마크 성능 및 지원 데이터

OpenAI는 GPT-5.2에 대한 다양한 내부 및 외부 벤치마크 결과를 공개했습니다. 주요 내용은 다음과 같습니다(OpenAI 발표 수치 기준):

- GDPval(44개 직무, 지식 업무) — GPT-5.2 Thinking은 “비교의 70.9%에서 업계 최고 수준 전문가를 능가하거나 동률”을 기록했습니다. OpenAI는 GDPval 작업에서 결과물이 전문가 대비 11배 초과의 속도와 1% 미만의 비용으로 생성되었다고 보고했습니다(속도 및 비용 추정치는 과거 데이터 기반). 이러한 작업에는 스프레드시트 모델, 프레젠테이션, 짧은 동영상이 포함됩니다.

- SWE-Bench Pro(코딩) — OpenAI에 따르면 GPT-5.2 Thinking은 SWE-Bench Pro에서 약 55.6%, SWE-Bench Verified(Python 전용)에서 **약 80%**를 달성하여, 자사 테스트 기준 코드 생성 / 엔지니어링 평가에서 새로운 최고 수준을 확립했습니다. OpenAI의 예시에 따르면 이는 실제로 더 신뢰할 수 있는 디버깅과 엔드투엔드 수정으로 이어집니다.

- GPQA Diamond(대학원 수준 과학 Q&A) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% on GPQA Diamond(도구 없음, 최대 추론).

- ARC-AGI 시리즈 — 더 어려운 유동적 추론 벤치마크인 ARC-AGI-2에서 GPT-5.2 Thinking은 52.9%, GPT-5.2 Pro는 **54.2%**를 기록했습니다(OpenAI는 이를 chain-of-thought 스타일 모델의 새로운 최고 수준이라고 밝혔습니다).

- 장문 컨텍스트(OpenAI MRCRv2) — GPT-5.2 Thinking은 4-needle MRCR 변형에서 256k 토큰까지 거의 100%에 가까운 정확도를 보였으며, 장문 컨텍스트 설정 전반에서 GPT-5.1 대비 크게 향상된 점수를 기록했습니다. (OpenAI는 MRCRv2 차트와 표를 공개했습니다.)

동시대 모델과의 비교

- vs Google Gemini 3(Gemini 3 Pro / Deep Think): Gemini 3 Pro는 약 1,048,576(≈1M) 토큰 컨텍스트 윈도우, 그리고 텍스트, 이미지, 오디오, 비디오, PDF를 포함한 광범위한 멀티모달 입력과 Vertex AI / AI Studio를 통한 강력한 에이전트형 통합 기능으로 알려져 있습니다. 문서상으로는 Gemini 3의 더 큰 컨텍스트 윈도우가 극도로 큰 단일 세션 워크로드에서 차별점이 됩니다. 다만 도구 지원 범위와 생태계 적합성 측면의 트레이드오프가 있을 수 있습니다.

- vs Anthropic Claude Opus 4.5: Anthropic의 Opus 4.5는 엔터프라이즈 코딩/에이전트 워크플로를 강조하며, 강력한 SWE-bench 결과와 장시간 에이전트형 세션에서의 견고성을 내세웁니다. Anthropic은 200k 컨텍스트 윈도우와 특화된 에이전트/Excel 통합을 바탕으로 Opus를 자동화 및 코드 생성용으로 포지셔닝하고 있습니다. Opus 4.5는 엔터프라이즈 자동화 및 코드 작업에서 강력한 경쟁자입니다.

실용적 요약: GPT-5.2는 균형 잡힌 개선 사항(400k 컨텍스트, 높은 토큰 출력, 향상된 추론/코딩)을 목표로 합니다. Gemini 3는 절대적으로 가장 큰 단일 세션 컨텍스트(≈1M)를 지향하고, Claude Opus는 엔터프라이즈 엔지니어링과 에이전트형 견고성에 초점을 둡니다. 컨텍스트 크기, 모달리티 요구사항, 기능/도구 적합성, 비용/지연 시간의 트레이드오프에 맞춰 선택하세요.

GPT-5.2 API에 액세스하고 사용하는 방법

1단계: API 키 등록

cometapi.com에 로그인하세요. 아직 사용자가 아니라면 먼저 회원가입해 주세요. CometAPI console에 로그인하세요. 인터페이스의 액세스 자격 증명 API 키를 받습니다. 개인 센터의 API token에서 “Add Token”을 클릭하고 token key: sk-xxxxx를 받아 제출하세요.

2단계: GPT-5.2 API로 요청 보내기

API 요청을 보내기 위해 “gpt-5.2” 엔드포인트를 선택하고 요청 본문을 설정하세요. 요청 방식과 요청 본문은 당사 웹사이트의 API 문서에서 확인할 수 있습니다. 당사 웹사이트는 편의를 위해 Apifox 테스트도 제공합니다. <YOUR_API_KEY>를 계정의 실제 CometAPI 키로 바꾸세요. 개발자는 이를 Responses API / Chat 엔드포인트를 통해 호출합니다.

질문이나 요청을 content 필드에 입력하세요. 모델은 이 내용에 응답합니다. 생성된 답변을 얻기 위해 API 응답을 처리하세요.

3단계: 결과 가져오기 및 검증

생성된 답변을 얻기 위해 API 응답을 처리하세요. 처리 후 API는 작업 상태와 출력 데이터를 반환합니다.