요약: OpenClaw의 최근 릴리스는 OpenAI의 GPT-5.4에 대한 일급(first-class), 포워드 호환 지원을 추가하고, 런타임 중 최소한의 중단으로 에이전트가 활성 모델과 메모리 스토어를 교체할 수 있게 하는 “메모리 핫스왑 가능” 아키텍처를 도입했습니다. 이를 통해 대용량 컨텍스트 워크플로우(GPT-5.4의 확장된 컨텍스트 윈도우), 온더플라이 모델 특화, 운영 환경 에이전트의 비용/지연 최적화가 가능해집니다. 업그레이드는 OpenClaw의 릴리스와 문서에 포함되어 있으며, 아래 예시는 실용적 설정, 코드 스니펫, 벤치마크 맥락, 권장 모범 사례를 보여줍니다.

OpenClaw 업데이트에 실제로 포함된 내용(간략 요약)

2026년 3월 9일, 오픈소스 에이전트 프레임워크이자 OpenAI 인접 프로젝트인 OpenClaw가 핵심 대규모 릴리스(2026.3.7)를 배포했습니다. 이 릴리스는 GPT-5.4에 대한 일급 지원과 컨텍스트 엔진에 새로운 메모리 핫스왑 가능 메커니즘을 추가합니다. 이 릴리스는 널리 사용되던 실험적 에이전트 프레임워크를 유지보수자들이 “에이전트 운영 체제(Agent Operating System)”라고 묘사하는 형태로 전환하며, 프로덕션급 에이전트 워크플로우와 모델 전환을 개발자와 팀에게 매끄럽게 제공합니다.

에이전트 빌더에게 중요한 실용적 3가지:

- 일급 GPT-5.4 지원 — 모델 에일리어스와 프로바이더 매핑을 통해 GPT-5.4를 주요 실행 모델로 선택(채널 오버라이드 및 에이전트별 모델 고정 포함).

- 컨텍스트 엔진 & 분산 채널 바인딩 — OpenClaw가 메모리, 도구 출력, 채널 히스토리에서 긴 컨텍스트 윈도우를 조립하는 방식을 개선하여, 고용량 모델이 구조화된 입력을 받도록 함.

- 메모리 핫스왑 아키텍처 — 메모리 플러그인 표면과 워크플로우를 명확히 해, 메모리 백엔드를 교체하거나 에이전트를 업그레이드하면서도 “정체성”을 잃거나 영속 상태를 손상시키지 않도록 함(메모리 자체가 단일 진실 공급원으로 남음). OpenClaw의 메모리 설계(평문 Markdown 파일, 인덱싱 검색, 플러그인화된 검색)는 안전한 핫스왑을 가능하게 하는 핵심입니다.

GPT-5.4 — GPT-5.4 개요와 벤치마크 돌파구

GPT-5.4는 최신 OpenAI 프런티어 모델 릴리스로, 스프레드시트, 문서/프레젠테이션 편집, 다단계 추론 및 도구 구동 등 전문 생산성에 중점을 둡니다. OpenAI 및 독립 언론 보도에 따르면, 이번 릴리스는 다음을 강조합니다:

- 확장된 컨텍스트: GPT-5.4는 실험적 100만 토큰급과 향상된 장문 컨텍스트 처리를 Codex/Codex 호환 엔드포인트를 통해 제공합니다. 개발자를 위해

model_context_window및model_auto_compact_token_limit와 같은 설정 옵션이 노출됩니다. 이를 통해 훨씬 더 큰 대화 상태, 문서, 코드베이스를 활성 컨텍스트에 유지할 수 있습니다. - 스프레드시트 및 추론 정확도 향상 — OpenAI는 자체 은행/애널리스트 스프레드시트 벤치마크에서 GPT-5.2 대비 평균 점수 ~68%에서 GPT-5.4가 ~87%로 크게 향상되었다고 보고합니다.

- 정확도와 사실성 개선: 초기 리뷰와 QA에 따르면 GPT-5.2 대비 환각 ~33% 감소 및 특정 생산성 작업에서 오류 성향 ~18% 감소가 관찰되었습니다. 문서 작성과 스프레드시트 작업에서 두드러진 향상을 보였다는 평가입니다.

- 통합 컴퓨터 사용 및 Codex 계열 개선 — GPT-5.4는 코드 생성, 대화형 디버깅, 운영 도구 구동(일부 데모에서 마우스/키보드/스크린샷 자동화)에 도움이 되는 Codex 계열의 능력을 계승했습니다. 이는 에이전트 루프에서 흔한 작성-실행-점검-패치 사이클에 더 적합합니다.

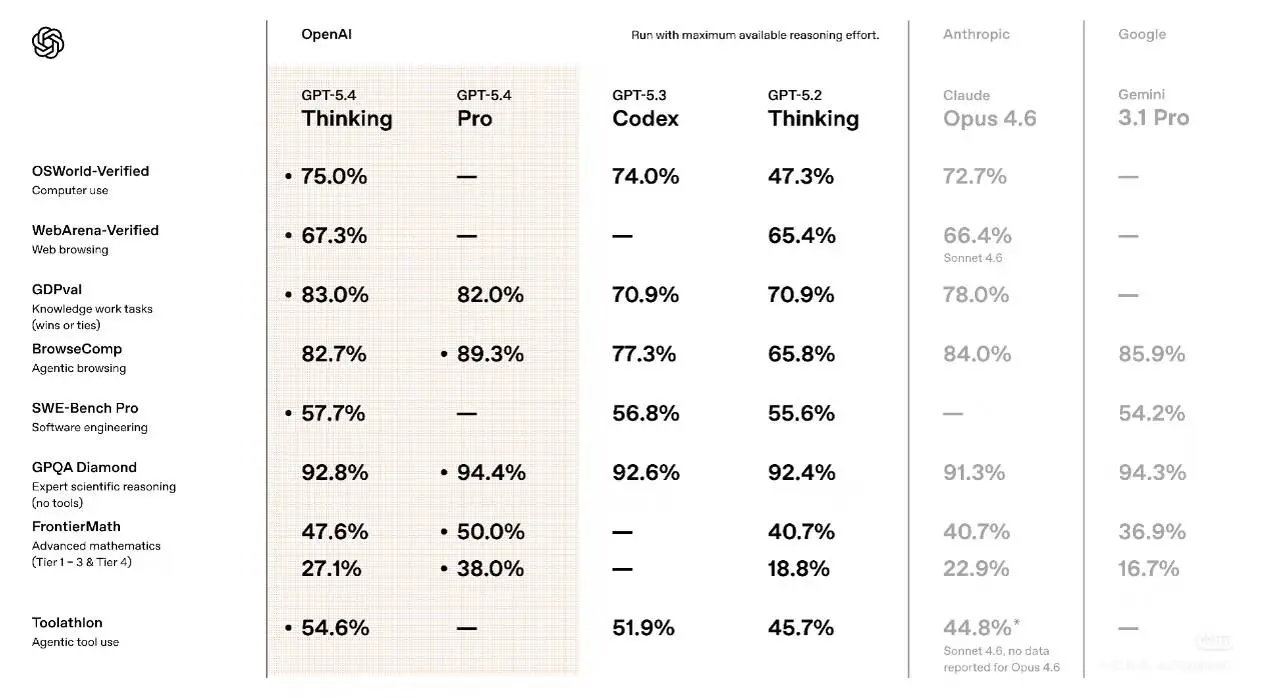

벤치마크 및 비교 맥락(숫자의 의미)

- 스프레드시트 모델링: OpenAI 내부 스프레드시트 벤치마크: GPT-5.4 평균 ~87.3%, GPT-5.2는 ~68.4%. 특정 작업에서의 향상을 보여주는 벤더의 대표 수치입니다.

- 컴퓨터 상호작용(OSWorld/에이전트형 테스트): 독립 테스터와 커뮤니티 실행 결과, GPT-5.4는 데스크톱 또는 시뮬레이션된 UI 조작을 포함하는 에이전트 상호작용 작업에서 개선을 보이며, 일부 작업군에서 최신 Anthropic 모델 변형을 소폭 앞서는 경우도 있습니다(에이전트에는 의미 있는 차이지만 모든 워크로드에서 결정적이지는 않음).

해석: GPT-5.4는 모든 것을 “마법처럼 해결”하는 모델은 아닙니다. 통합 도구 사용, 코드 실행 패턴, 스프레드시트 추론에서 분명한 강점을 보이는데 — 이는 OpenClaw 에이전트가 자주 수행하는 작업과 정확히 맞닿아 있습니다. 에이전트 빌더에게는 실행기 안정성(Codex 계열) + 플래너 역량 + 향상된 장문 컨텍스트 처리가 결합된 점이 특히 중요합니다.

OpenClaw의 GPT-5.4 지원: 무엇이 바뀌었고 왜 중요한가

OpenClaw의 릴리스(프로젝트 릴리스 페이지 참조)는 모델 리졸버와 런타임을 업데이트하여 GPT-5.4의 확장된 컨텍스트 및 토큰 한도에 포워드 호환되도록 하고, 에이전트가 런타임에 메모리 백엔드나 모델을 전환할 수 있는 “메모리 핫스왑” 기능을 추가합니다. 이는 3가지 방식으로 구현됩니다: 1) 더 큰 컨텍스트/토큰 한도를 수용하도록 모델 메타데이터 및 리졸버 업데이트; 2) 모델 교체와 캐시 워밍업을 우아하게 오케스트레이션하도록 에이전트 런타임 변경; 3) 다중 메모리 채널과 핫 스위치 트리거를 허용하는 메모리 API.

버전 2026.3.7의 GPT-5.4 지원과 메모리 핫스왑 설계는 실용적이며 상호 보완적인 두 가지 이점을 제공합니다:

- 간단한 모델 업그레이드 경로. OpenClaw는 이제 에이전트에 GPT-5.4를 선택 가능한 “런타임”으로 제시하여, 기존 GPT-5.x 또는 타사 벤더에서 에이전트 로직을 재작성하지 않고도 전환할 수 있습니다. 이번 업데이트는 코어에서 안정적인 GPT-5.4 통합을 명시적으로 선언합니다.

- 메모리 핫스왑. 단일 선형 메모리 스냅샷을 영속화하는 대신, OpenClaw의 컨텍스트 엔진은 메모리 파티션을 런타임에 분리/교체/마이그레이션할 수 있게 합니다 — 예: 디버깅 시 높은 리콜의 벡터 DB 샤드를 스왑인하거나, 외부 감사용 GDPR 정제 메모리 변형으로 스왑 — 에이전트를 중단하지 않고 수행합니다. 이는 운영 중단 위험을 낮추고, 용도별 메모리 구성을 가능케 합니다(디버깅 vs 프라이버시 vs 성능).

실질적 성능 향상 및 이점

OpenClaw의 통합은 GPT-5.4가 강점을 보이는 세 가지 실용 영역에 초점을 맞춥니다:

- 도구 오케스트레이션 충실도. GPT-5.4의 향상된 내부 도구 탐색과 추론은 도구 호출 소모를 줄입니다(중복 호출 및 재시도 감소). 이는 복잡한 플로우에서 더 적은 API 호출과 더 빠른 완료로 이어집니다. 초기 보고에 따르면 이전 GPT-5.x 대비 토큰 및 도구 호출 효율이 개선되었습니다.

- 더 길고 풍부한 컨텍스트 처리. OpenClaw 에이전트는 이제 훨씬 더 큰 활성 컨텍스트(스왑인된 메모리 샤드 포함)를 유지할 수 있어, 긴 대화, 다중 파일 프로젝트, 반복 디버깅을 상태 손실 없이 관리합니다.

- 더 결정적인 코드 출력. 코드 자동 생성(CI 훅, 함수 스텁, 인프라 템플릿) 워크플로우에서, GPT-5.4는 더 일관되고 실행 가능한 출력을 내는 경향이 있어 인적 검토 부담을 낮춥니다. 독립 테스트에서 이전 GPT-5 대비 코드 품질 메트릭의 유의미한 향상이 관찰되었습니다.

- 메모리 연속성 — “메모리 핫스왑”은 에이전트 상태나 컨텍스트를 잃지 않고 메모리 스토어(로컬 캐시, 벡터 DB, LLM 메모리)를 교체/보강할 수 있어, A/B 테스트, 롤링 업그레이드, 장애 조치에 유리합니다.

OOLONG 벤치마크 테스트에서, 새로운 OpenClaw 버전은 lossless-claw 플러그인과 결합하여 74.8의 높은 점수를 기록하며 Claude Code(70.3점)를 크게 앞질렀습니다. 특히 OpenClaw는 컨텍스트 길이가 증가할수록 안정성과 정확성을 보여, 현장 테스트를 수행한 엔지니어들이 “잘 돌아간다고 말하는 건 너무 보수적인 표현”이라고 감탄했습니다.

OpenClaw에서 GPT-5.4 구성 및 사용 방법(단계별)

GPT 5.4를 활용한 간단한 OpenClaw 워크플로우:

- 일반적인 구성은 다음과 같습니다:

- 사용자는 Discord 또는 Telegram 같은 플랫폼을 통해 메시지를 전송합니다.

- OpenClaw는 게이트웨이 서버를 통해 메시지를 수신합니다.

- 게이트웨이는 프롬프트를 AI API 프로바이더를 통해 GPT 5.4로 전달합니다.

- GPT 5.4는 응답을 생성하거나 도구 동작을 트리거합니다.

- OpenClaw는 최종 결과를 사용자에게 반환합니다.

아래에는 GPT-5.4를 OpenClaw에서 안전하고 재현 가능하게 실행하기 위한 실용적이며 바로 복사/붙여넣기 가능한 구성 예제와 워크플로우를 제시합니다. 의도적으로 보수적으로 작성되었습니다: 먼저 테스트 에이전트에서 모델을 활성화하고, 메트릭과 오류를 위한 계측을 모두 적용하세요.

사전 준비- GPT-5.4 매핑이 포함된 릴리스로 OpenClaw 업그레이드(위 릴리스 노트 참조).

- GPT-5.4 접근 권한이 있는 유효한 OpenAI API 키(저는 더 저렴한 가격의 CometAPI 엔드포인트를 선택).

1) 모델 선택 및 리졸버 구성(Json/ YAML / CLI)

~/.openclaw/openclaw.json에 아래 내용을 넣습니다(혹은 기존 설정에 병합). 환경에 맞게 프로바이더 이름과 토큰 참조를 조정하세요.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw는 논리적 모델명(예: openai/gpt-5.4)을 엔드포인트와 런타임 구성에 매핑하는 모델 리졸버를 사용합니다. 리졸버 파일을 추가/업데이트하세요(예: models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

또는 CLI로 런타임에 설정:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

참고:

context_window및max

참고 사항

agents.defaults.model.primary는 기본 모델을 선택합니다.channels.modelByChannel을 사용해 채널별 오버라이드를 적용하면, 고임팩트 채널은 GPT-5.4로, 덜 까다로운 채널은 더 저렴한 모델로 라우팅할 수 있습니다. OpenClaw 모델 선택 문서에서 우선순위 규칙을 참조하세요.- 구체적 모델명은 CometAPI 모델 페이지를 참조하세요. OpenAI를 사용하려면 URL과 API 키를 OpenAI 것으로 바꾸면 됩니다.

context_window와max_output_tokens키는 OpenClaw 리졸버의 포워드 호환 변경을 반영하여, 에이전트가 오래된 Codex 한도를 사용하려 하지 않도록 합니다.

2) “메모리 핫스왑” 활성화 및 테스트 방법

OpenClaw의 메모리 서브시스템은 파일 기반(Markdown 파일) + 인덱서/검색 플러그인 구조이므로, 원시 메모리 파일을 잃지 않고도 백엔드 플러그인(예: SQLite 벡터, Milvus, 외부 메모리 서비스)을 안전하게 교체할 수 있습니다.

일반적인 패턴:

- 메모리 위치 표준화: git으로 관리되는 작업 공간 사용:

~/.openclaw/workspace/에MEMORY.md및memory/YYYY-MM-DD.md가 권위 소스가 되도록. - 메모리 플러그인 설치 및 구성(예: sqlite-vec) 후 설정에서

plugins.slots.memory가 해당 플러그인을 가리키도록 지정. - 마이그레이션 테스트: 새 플러그인을 추가하고 쉐도우 인덱싱 작업을 실행한 뒤, 검색 결과를 비교하고 만족스러우면

plugins.slots.memory에일리어스를 새 플러그인으로 전환.

플러그인 에일리어스 스왑 예시(bash 의사 명령):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

왜 “핫스왑 가능”인가: 메모리 파일이 단일 진실 공급원으로 남기 때문입니다. 플러그인은 인덱싱과 검색 레이어를 구현하며, 교체 시 재인덱싱은 하되 기본 .md 파일은 변경하지 않습니다. 이는 모델 교체 시에도 치명적인 정체성 드리프트를 방지합니다 — 에이전트는 동일한 메모리를 계속 읽습니다.

3) 예시: 개별 에이전트를 GPT-5.4로 고정(에이전트별 오버라이드)

에이전트별로 모델을 오버라이드할 수 있습니다. 아래와 같이 에이전트 항목을 추가하세요:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

커뮤니티 릴리스나 특정 OpenClaw 버전에서 CLI가 필요하다면, 런타임의 세션 단위로 모델을 설정할 수도 있습니다:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

운영 팁: 고정(pin)하면 해당 에이전트의 동작을 결정적으로 유지하면서, 다른 에이전트에서는 A/B 테스트를 수행할 수 있습니다.

OpenAI를 사용하려면 URL과 API 키를 OpenAI 것으로 바꾸면 됩니다.

4) Codex 100만 컨텍스트 옵션 사용(API 설정)

OpenClaw 배포가 OpenAI Codex 엔드포인트에 직접 접근한다면, 다음과 같이 컨텍스트 옵션을 전달하세요:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

표준 컨텍스트 윈도우를 초과하는 요청은 다른 사용 요율이 적용될 수 있습니다(Codex 프리뷰에서 표준 윈도우 초과 요청에 대한 이중 과금 언급이 OpenAI 문서에 있음).

모범 사례: OpenClaw에서 GPT-5.4의 강점을 극대화

비용, 지연 시간 & 모델 믹스

- 하이브리드 모델 전략: 짧은 질의와 스트림 처리는 더 작고 저렴한 모델을 사용하고, 무거운 분석/요약/장문 컨텍스트가 필요한 코드 생성에는 GPT-5.4로 핫스왑하세요. 전체 토큰 비용을 줄이면서 품질을 유지할 수 있습니다(위 메모리 구성의 트리거로 구현).

- 토큰 압축 & 검색 보강: 토큰 전송량을 줄이기 위해 검색 보강 파이프라인을 사용하세요 — 긴 문서를 벡터 DB에 저장하고 관련 세그먼트만 검색하여, 가장 관련성 높은 청크와 컴팩트한 계획만 포함합니다. GPT-5.4의 도구 검색 능력이 유용한 도구나 문서를 자동으로 찾는 데 도움을 줍니다.

- 웜업 & 콜드 스타트: 모델 교체 후 첫 요청 지연 스파이크를 피하기 위해 짧은 컨텍스트 프라이밍 실행으로 모델을 웜업하세요. 프롬프트 템플릿을 미리 컴파일하고, 핵심 메모리 채널을 재수화하세요. OpenClaw의 롤링 전략(설정 참조)은 프리웜을 지원합니다.

신뢰성 & 안전

- 그레이스풀 폴백: API 속도 제한이나 쿼터 오류에 대비해 타임아웃과 폴백 계획(예: 이전 세션의 캐시 답변으로 강등)을 구현하세요.

- 안전 레이어: 출력이 의사결정에 영향을 미칠 때 정책 필터와 검증 단계를 유지하세요. GPT-5.4가 통계적으로 환각을 줄이지만, 고위험 작업에서는 여전히 검증이 중요합니다.

평가 & 모니터링

- 벤치마크 재현: 코드 완성, 다중 파일 리팩터, 스프레드시트 분석 등 여러분의 워크로드에 대해 표준 루브릭으로 정면 비교 테스트를 수행하세요. 공개 보고는 스프레드시트와 생산성 작업에서의 강점을 시사하지만, 여러분의 데이터로 검증하세요.

- 텔레메트리: 토큰 소비, 모델 지연, 메모리 스왑 빈도, 답변 품질(인간 평정/자동 테스트)을 모니터링하세요. 텔레메트리를 사용해 스왑 임계값을 조정하세요.

예시: 핫스왑하는 코드 리뷰 에이전트

목표: 푸시 시 루틴 린트 + 유닛 테스트 요약은 저렴한 모델로 실행하고, 테스트 실패 또는 변경 파일이 10개를 초과하면 리팩터 제안을 위해 GPT-5.4로 승격.

흐름(상위 수준):

- 프리커밋 트리거가

local/fast-small-coder를 실행해 린트 요약을 생성. test_failures > 0또는diff_files > 10이면hot_swap을openai/gpt-5.4로 트리거. 리포지토리 히스토리를 담은longterm_vector를 승격.- 실패 스택 트레이스 전체와 관련 코드 파일을 컨텍스트로 가져온 GPT-5.4 프롬프트 실행. 리팩터 패치와 유닛 테스트 변경안을 생성.

- 사람이 출력을 평가하고, 피드백이 메모리에 반영.

프롬프트 스켈레톤(검색 & 압축 후 GPT-5.4로 전송):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

이 사용 사례는 대용량 컨텍스트 + 메모리 핫스왑이 왜 가치 있는지 잘 보여줍니다: 실패한 트레이스 전체와 여러 파일을 한 번에 모델에 제공할 수 있습니다. 비용을 통제하기 위해 스왑 트리거는 보수적으로 구현하세요.

마지막으로: 누가 언제 OpenClaw에서 GPT-5.4를 채택해야 하나

- 지금 채택: 에이전트가 다단계 코드/도구 작업, 무거운 스프레드시트 자동화, 복잡한 문서 편집 등 반복적 작성-실행-점검 사이클이 지배적인 경우. 생산성과 신뢰성 향상이 가장 두드러집니다.

- 신중 채택: 단순한 추론으로 충분한 비용 민감, 대량 채팅 채널을 운영한다면 라우팅으로 비용 효율을 유지하세요.

- 단일 모델의 지배를 가정하지 말 것: 여러분의 데이터로 벤치마크하세요. GPT-5.4는 에이전트 워크로드에 강력한 후보지만, 모델 선택은 증거 기반이어야 합니다.

개발자는 지금 CometAPI를 통해 GPT-5.4에 접근할 수 있습니다. 시작하려면 Playground에서 모델 기능을 탐색하고, 자세한 지침은 Openclaw intergration guide를 참고하세요. 접속 전 CometAPI에 로그인하고 API 키를 발급받았는지 확인하세요. CometAPI는 통합을 돕기 위해 공식가보다 훨씬 낮은 가격을 제공합니다.

Ready to Go?→ 지금 OpenClaw에 가입하세요 !