De ontwikkelaarservaring met videoanalyse door ChatGPT loopt vaak stuk: directe YouTube-links werken niet, en MP4-uploads leveren ‘gefantaseerde’ samenvattingen op die visuele nuances missen. Dit is geen bug—het is een architectonische beperking. ChatGPT streamt geen video; het verwerkt reeksen van geëxtraheerde frames en transcriptietekst. Dus je probeerde een MP4 te uploaden, wat werkte… soort van. De samenvatting noemde de audiotranscriptie, maar miste volledig de visuele grap in de derde scène die de hele video begrijpelijk maakte.

ChatGPT kan video’s analyseren — maar niet door ze daadwerkelijk te bekijken

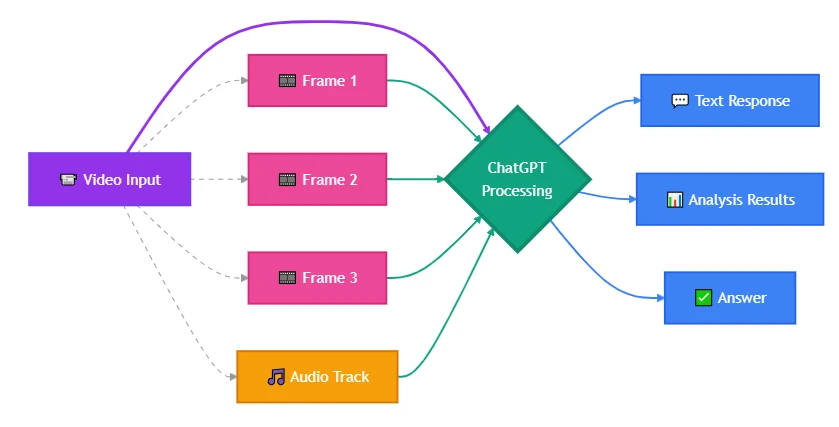

Dit is wat er echt gebeurt: ChatGPT “kijkt” niet naar video’s zoals jij dat doet. Het drukt niet op play, streamt de content en observeert beweging in de tijd. Het breekt video op in componenten die het al kan verwerken—statische beelden en transcriptietekst—en redeneert vervolgens over die stukken afzonderlijk. Het model ziet jouw video als een fotoalbum met een voice-over, niet als een doorlopende ervaring. Daarom pikte het de gesproken uitleg op maar miste het de visuele punchline: het frame met de grap zat waarschijnlijk niet in de bemonsterde set.

Als iemand vraagt “kan ChatGPT video’s bekijken,” bedoelt die meestal een van twee dingen: kan het visuele content streamen zoals een menselijke observator dat zou doen, of kan het betekenis uit videodata halen en analyseren—scènes, dialogen, tijdstempels, acties op het scherm? Het functionele antwoord is ja op de tweede vraag, met beperkingen die sommige use-cases volledig breken. Moderne ChatGPT-varianten verwerken video door die te behandelen als bemonsterde frames gecombineerd met audiotranscriptie, via automatische extractie in de webinterface of door door de gebruiker aangeleverde frames via de API te accepteren. Dit werkt voor samenvattingen, scènebeschrijvingen en teksterkenning. Het faalt bij bewegingsdetectie, timing-afhankelijke analyse of alles waarvoor het model moet “zien” wat er tussen frames gebeurt.

De meeste handleidingen blijven steken bij het bevestigen dat de mogelijkheid bestaat, zonder uit te leggen waarom jouw specifieke implementatie niet werkte—of welke alternatieve invoermethode geschikter was geweest.

ChatGPT Videomogelijkheden: wat het model daadwerkelijk ziet

ChatGPT laadt geen MP4 en scrubt die niet frame-voor-frame door. Het heeft vision-capability—het vermogen om statische beelden te analyseren—en audiotranscriptie via Whisper-integratie. Wanneer je video indient in de ChatGPT web- of mobiele interface, extraheert het systeem keyframes, transcribeert de audio apart en voert beide in als afzonderlijke inputs. Het model beschrijft vervolgens wat het “zag” in die frames en wat het “hoorde” in de transcriptie.

Vanuit jouw perspectief lijkt het op videobegrip. Vanuit het perspectief van het model is het beeldanalyse plus tekstverwerking. Dat architectonische onderscheid bepaalt welke use-cases werken en welke niet.

Als je video afhankelijk is van beweging, subtiele veranderingen tussen frames of precieze timing—zoals exact detecteren wanneer een object het frame binnenkomt, of volgen hoe een UI-element animeert—zal een keyframe-gebaseerde aanpak dat missen. ChatGPT pikt een visuele cue van twee seconden die tussen bemonsterde frames valt niet op. Het volgt ook geen objecten in de tijd, tenzij je de input expliciet zo structureert dat progressie zichtbaar is.

Huidige videomogelijkheden van ChatGPT (stand begin 2026):

- Beeldgebaseerde videoanalyse: accepteert videobestanden of geëxtraheerde frames; interpreteert visuele content uit bemonsterde beelden

- Audiotranscriptie: zet gesproken woorden om naar tekst via Whisper; het model kan de transcriptie vervolgens samenvatten of bevragen

- Scènebeschrijving: identificeert objecten, acties, omgevingen en zichtbare tekst in aangeleverde frames

- Tijdstempelgebaseerde queries: kan naar specifieke momenten verwijzen als je frametijdstempels aanlevert of de video handmatig segmenteert

- Tekstextractie: leest ondertitels, UI-labels of documenten die in frames zichtbaar zijn

Specifieke framesamplingfrequentie en gedrag van automatische keyframe-selectie in de ChatGPT-webinterface — niet openbaar gedocumenteerd per de kennisafkapdatum

Wat niet is inbegrepen:

- Real-time streaming video-invoer via de API

- Frame-perfecte bewegingsvolging of objectpersistentie in de tijd

- Native ondersteuning voor video-codecs — alle verwerking gebeurt op geëxtraheerde frames en audio

- Automatische detectie van scènewissels zonder expliciete aansturing door de gebruiker

Videocapaciteit wordt begrensd door tokenlimieten en bestandsgrootte, niet door duur. Hoewel 5–10 minuten een praktische vuistregel is, schalen de werkelijke limieten dynamisch mee met visuele dichtheid.

Als je use-case die mogelijkheden vereist, ben je óf zelf de video aan het preprocessen om de juiste frames te extraheren, óf schakel je over naar een model met native videosteun. De volgende sectie breekt per scenario uiteen welke invoermethode je gebruikt.

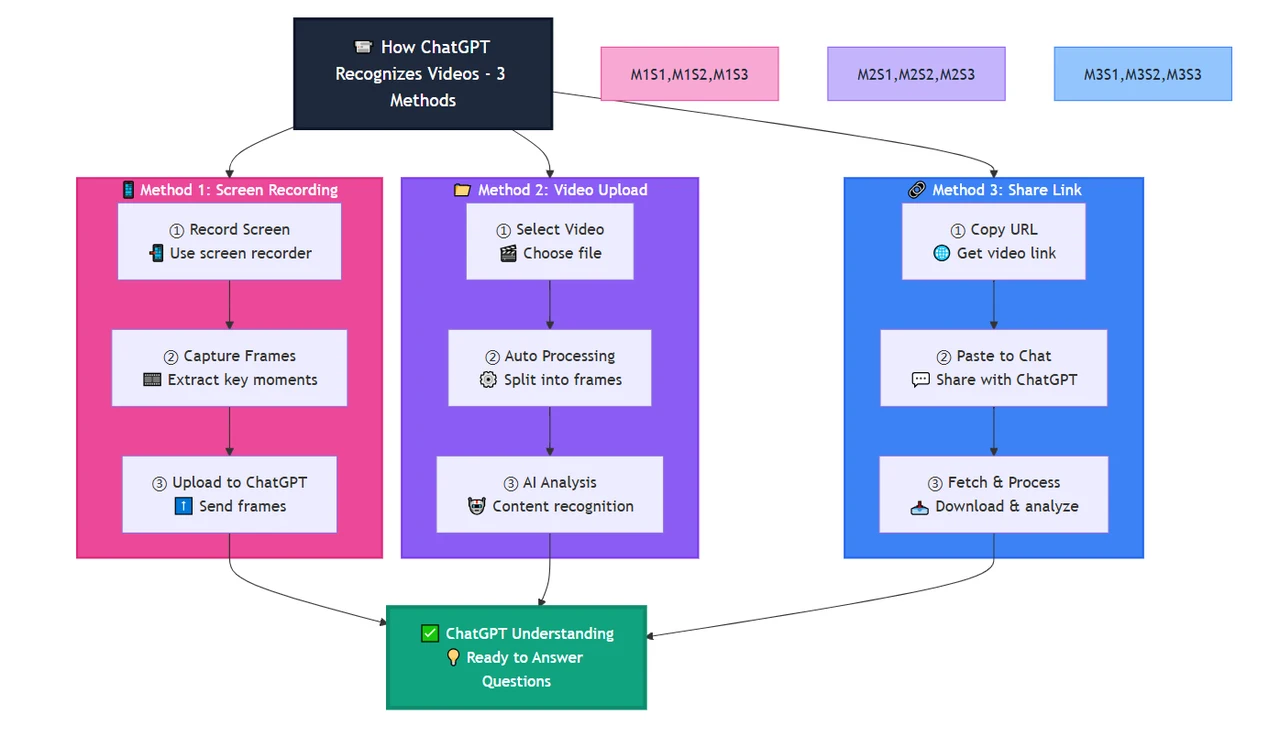

Hoe ChatGPT met video omgaat: drie praktische methoden

Er is niet één manier om video bij ChatGPT aan te leveren. De methode die je kiest, bepaalt wat het model kan analyseren en wat het zal missen. De meeste implementatiefalingen komen voort uit het kiezen van de gemakkelijke methode in plaats van de juiste.

Methode 1: Handmatige frame-extractie + upload van afbeeldingen

Extraheer zelf frames met ffmpeg of vergelijkbare tools, en upload vervolgens die specifieke frames als afbeeldingen. Zo houd je volledige controle over wat ChatGPT analyseert.

Voorbeeldworkflow (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Met deze aanpak kun je:

- De analyse richten op specifieke momenten (intro, kernactie, conclusie) zonder context te verspillen aan irrelevante delen

- Beweging vastleggen door opeenvolgende frames te uploaden met jouw gekozen samplingfrequentie

- Om de bestandsgroottelimieten heen werken—afbeeldingen zijn kleiner dan volledige videobestanden

- De framekwaliteit behouden die mogelijk verslechtert door automatische compressie

De keerzijde:

Je verzorgt de preprocessing zelf. Voor het op schaal analyseren van honderden video’s is automatisering nodig. Voor eenmalige diepgaande analyse of het debuggen van specifieke scènes is dit de meest betrouwbare methode.

Wanneer deze methode gebruiken:

- Je hebt frame-nauwkeurige analyse van specifieke momenten nodig

- De kritieke visuele informatie is kortstondig of valt tussen typische keyframe-intervallen

- Je vergelijkt visuele veranderingen in een reeks (UI-toestandswijzigingen, animatieframes)

- Je wilt verifiëren wat het model daadwerkelijk “zag” door de exacte geüploade frames te inspecteren

Methode 2: Directe bestandsupload via de ChatGPT-interface

De web- en mobiele apps van ChatGPT accepteren video-uploads direct in de chat. Sleep een MP4- of MOV-bestand in het invoerveld en het systeem regelt de frame-extractie en transcriptie automatisch.

Wat er intern gebeurt:

- De service bemonstert frames met intervallen (specifieke frequentie niet gedocumenteerd; geschat op 1–2 frames per seconde op basis van waarnemingen)

- Audio wordt getranscribeerd via Whisper of een vergelijkbare service

- Beide outputs worden als afzonderlijke contextinputs aan het model doorgegeven

- Het model genereert reacties op basis van zichtbare frames en de gehoorde transcriptie

Deze methode werkt voor:

- Hogere-niveau videosamenvattingen waarbij frame-nauwkeurigheid niet cruciaal is

- Identificeren van belangrijke objecten, personen of omgevingen die over scènes heen aanwezig blijven

- Extractie van gesproken content of on-screen tekst die in meerdere frames verschijnt

- Snelle verkennende analyse zonder preprocessing

Deze methode faalt bij:

- Frame-nauwkeurige analyse—je bepaalt niet welke frames bemonsterd worden

- Voor langere video-inhoud die de comfortabele contextcapaciteit van het model overschrijdt is logische segmentatie vereist. Zonder strategische chunking of preprocessing kan de kwaliteit afnemen of truncatie optreden naarmate het tokenverbruik versnelt bij visueel dichte data

- Detectie van beweging, transities of timing-afhankelijke content die opeenvolgende framevergelijking vereist

- Scenario’s waarin kritieke visuele informatie slechts kortstondig verschijnt tussen bemonsterde frames

Als je controle wilt over welke momenten geanalyseerd worden, gebruik je Methode 1.

Methode 3: YouTube-link + transcript ophalen

Sommige ChatGPT-plugins en tools van derden claimen “YouTube-video’s te analyseren.” Wat ze feitelijk doen is de openbare metadata en het transcript (indien beschikbaar) ophalen en die tekst vervolgens aan ChatGPT doorgeven.

Dit werkt wanneer:

- De video automatische of geüploade ondertitels heeft

- Je analyse uitsluitend gesproken content vereist, niet visuele informatie

- De video publiek toegankelijk is (niet privé, niet verborgen, geen regiobeperkingen)

- Je samenvattingen maakt van colleges, podcasts of interviews waarbij de audio het meeste betekenis draagt

Dit werkt niet wanneer:

- Je visuele content moet analyseren (on-screen demonstraties, diagrammen, gezichtsuitdrukkingen)

- De video geen transcript of ondertitels heeft

- Kritieke informatie visueel verschijnt zonder in de dialoog te worden genoemd

- Je met privévideobestanden werkt of content achter authenticatie

Veelgemaakte fout: Ontwikkelaars verwachten volledige videobegrip (visueel + audio) maar krijgen slechts een transcript-samenvatting. Dit is prima voor inhoudsanalyse van gesproken materiaal. Het is nutteloos voor het beoordelen van productdemo’s, het analyseren van visueel ontwerp, of elke situatie waarin wat je ziet belangrijker is dan wat er gezegd wordt.

Het patroon: Methode 2 voor snelle samenvattingen waarbij precisie niet uitmaakt. Methode 1 voor gecontroleerde analyse waarbij je specifieke frames nodig hebt. Methode 3 voor audio-gedreven content waarbij visuele informatie secundair of afwezig is. Kies op basis van waar de kritieke informatie van jouw use-case leeft—in beweging, in specifieke frames, of puur in de dialoog.

Toepassingsscenario’s voor ChatGPT-video: wat in productie daadwerkelijk werkt

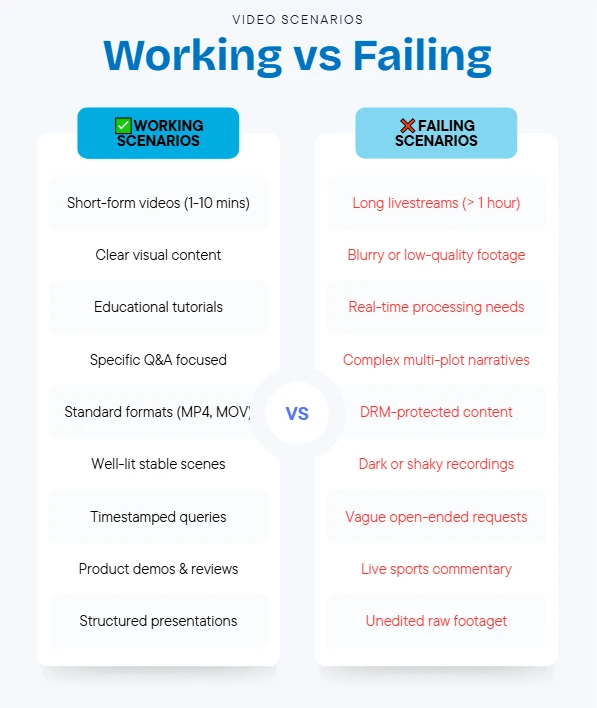

Weten dat ChatGPT videocomponenten kan verwerken, vertelt je niet of het het juiste gereedschap voor jouw probleem is. Deze scenario’s laten zien waar frame-gebaseerde analyse slaagt—en waar de architectonische beperkingen de use-case breken.

Scenario 1: Samenvatting van educatieve content

Gebruiksscenario: Je hebt een tutorialvideo van 10 minuten en wilt een gestructureerde samenvatting met kernstappen, genoemde tools en getoonde visuele voorbeelden.

Waarom dit werkt: Educatieve video’s hebben doorgaans duidelijke scènegrenzen, persistente on-screen tekst en een narratie die met de visuals meeloopt. De spreker beschrijft wat hij laat zien terwijl het zichtbaar is. ChatGPT kan de uitleg transcriberen, tools of diagrammen in bemonsterde frames identificeren en beide combineren in een gestructureerde output.

Implementatieaanpak: Upload de video via de ChatGPT-interface of extraheer 8–12 keyframes bij de belangrijkste overgangsmomenten. Prompt: “Som de hoofd stappen uit deze video op en verwijs zowel naar de narratie als naar on-screen tekst, diagrammen of toolnamen die je ziet.”

Waar het misgaat: Video’s die continu op beweging leunen—zoals een screencast van code waarin de instructeur snel typt over meerdere bestanden—zullen stappen missen tussen frames. Je hebt dan een hogere framesampling of enkel de audiotranscriptie nodig.

Praktische tip: Combineer voor colleges of tutorials de automatische upload (voor de transcriptie) met handmatig geëxtraheerde frames van de 3–5 belangrijkste visuele momenten. Zo krijg je zowel volledige audiodekking als kwalitatieve beelden van kernconcepten.

Scenario 2: Analyse van productdemo’s

Gebruiksscenario: Je beoordeelt de productdemo van een concurrent en wilt UI-elementen, functienamen, gebruikersflows en prijsdetails op het scherm extraheren.

Waarom dit werkt: Productdemo’s houden elk scherm doorgaans lang genoeg in beeld voor framebemonstering om statische UI vast te leggen. Tekstoverlays, knoplabels, menustructuren en prijstabellen blijven zichtbaar over meerdere frames. ChatGPT’s vision-capability kan deze elementen lezen en beschrijven, zelfs als ze niet in de narratie genoemd worden.

Implementatieaanpak: Extraheer frames bij grote scènewissels (intro-dia, feature 1 demo, feature 2 demo, prijsscherm, CTA). Upload die frames en prompt: “Identificeer per frame alle zichtbare UI-elementen, knoplabels, functienamen en eventuele prijs- of productinformatie op het scherm.”

Waar het misgaat: Demo’s met snelle overgangen, hover-staten die kort informatie tonen, of interactieve elementen die slechts 1–2 seconden zichtbaar zijn, worden niet door framesampling vastgelegd. Als de concurrent snel een vergelijkings tabel flitst, mis je die tenzij dat exacte moment is bemonsterd.

Praktische tip: Scrub de video eerst handmatig om tijdstempels van belangrijke onthullingen te vinden. Extraheer frames op die specifieke momenten in plaats van te vertrouwen op automatische intervals.

Scenario 3: Transcriberen van een meeting of interview met visuele context

Gebruiksscenario: Je hebt een klantgesprek opgenomen en wilt zowel een transcript als annotaties die aangeven wanneer specifieke documenten, slides of schermdelen verschenen.

Waarom dit werkt: Audiotranscriptie dekt de gesproken dialoog. Wanneer deelnemers schermen delen of documenten omhoog houden, verschijnen die in bemonsterde frames. ChatGPT kan noteren “rond [timestamp] was een contractdocument zichtbaar op het scherm” naast het transcript—handig voor notulen die naar visueel materiaal verwijzen.

Implementatieaanpak: Upload de video en prompt: “Transcribeer deze meeting en noteer momenten waarop documenten, presentatieslides, gedeelde schermen of andere visuele referenties verschenen. Beschrijf voor elk visueel element wat er getoond werd.”

Waar het misgaat: Korte schermdelen (onder 5–10 seconden) kunnen tussen bemonsterde frames vallen. Tekst die te klein is in gecomprimeerde frames is mogelijk niet leesbaar. Voor juridische/compliance-doeleinden die woordelijke nauwkeurigheid van getoonde documenten vereisen, verifieer framekwaliteit en samplingdekking voordat je op de output vertrouwt.

Praktische tip: Neem belangrijke meetings op in hogere resolutie en extraheer handmatig frames op momenten dat iemand zegt: “ik laat even dit document zien”—een teken dat er zo een visuele referentie komt.

Scenario 4: Contentmoderatie of compliance-review

Gebruiksscenario: Je moet door gebruikers geüploade video’s scannen op verboden content—specifieke logo’s, tekstpatronen of visuele elementen die platformbeleid schenden.

Waarom dit werkt: ChatGPT kan frames scannen op zichtbare tekst, herkenbare objecten of beschreven scènes. Als je wilt checken “komt het logo van een concurrent voor in een van deze video’s,” detecteert frame-gebaseerde analyse logo’s die meer dan een seconde of twee in beeld blijven.

Implementatieaanpak: Extraheer frames op vaste intervallen (elke 3–5 seconden), upload ze, en prompt: “Beoordeel deze frames en identificeer frames die [specifiek logo, merknaam, verboden symbool, etc.] bevatten. Beschrijf per match waar in het frame dit verschijnt.”

Waar het misgaat: Audio-gebaseerde overtredingen (auteursrechtelijk beschermde muziek, verboden uitingen) vereisen aparte audio-analyse. Beweging-gebaseerde overtredingen (verboden gebaren, acties die over meerdere frames lopen) worden niet door stilstaande frames gedetecteerd. Kort geflitste verboden content kan de sampling missen.

Praktische tip: Combineer ChatGPT’s visuele scanning met gespecialiseerde audio-fingerprintingdiensten en hogere framesampling voor hoog-risicocategorieën. Gebruik ChatGPT als eerste filter, niet als enige moderatielaag.

Het patroon in succesvolle scenario’s: betekenisvolle content bestaat in discrete, stabiele frames en correleert met audio of tekst. Falingen treden op wanneer kritieke informatie in beweging, timing, transities leeft of te kort verschijnt om betrouwbaar te worden bemonsterd.

Videomogelijkheden van Gemini versus Claude versus ChatGPT

Als de framesampling-architectuur van ChatGPT niet past bij jouw use-case, ga je alternatieven evalueren. Gemini en Claude bieden verschillende video-gerelateerde mogelijkheden—en die verschillen bepalen welk model werkt voor jouw implementatie.

Gemini’s native videoprocessing

Gemini-modellen ondersteunen native videoinvoer op API-niveau. Je geeft rechtstreeks een videobestand door zonder preprocessing naar frames. Het model verwerkt video als een continue stroom, wat bewegingsvolging, detectie van scènewissels en temporeel redeneren mogelijk maakt—zaken die ChatGPT’s frame-gebaseerde aanpak niet aankan.

Voorbeeld-use-case waarin Gemini wint:

Je moet detecteren wanneer een specifiek object binnenkomt en het frame verlaat in een clip van 30 seconden, of volgen hoe iemand door een scène beweegt. Gemini kan objecten over frames heen volgen en over beweging redeneren. ChatGPT zou het object alleen zien in de frames die toevallig bemonsterd zijn—en mogelijk de entree of exit missen.

Trade-offs:

- De native API van Gemini is kostenefficiënter dan OpenAI’s framesampling. Door lineaire token-overhead te vermijden via context-caching, schaalt Gemini beter voor langvormige analyse.

- Het verwerken van langere video’s levert hogere latency op—het model moet het volledige bestand inlezen voordat het reageert

- Niet alle Gemini-varianten ondersteunen videoinvoer; vereist latere Gemini-modellen

- Er gelden lengtelimieten, maar die zijn royaler dan ChatGPT’s contextgebaseerde beperkingen

Wanneer kies je Gemini boven ChatGPT:

- Je use-case vereist bewegingsvolging, detectie van scènegrenzen of begrip van temporele relaties

- Kritieke informatie verschijnt en verdwijnt snel over frames heen

- Je analyseert video’s waarin de opeenvolging van gebeurtenissen ertoe doet (sportbeelden, surveillance, animatie-analyse)

- Je wilt handmatige frame-extractie als preprocessing vermijden

Huidige videobeperkingen van Claude

Per begin 2026 ondersteunen Claude-modellen geen directe videoinvoer via de API. Je kunt wel afbeeldingen uploaden (inclusief handmatig geëxtraheerde videoframes), maar er is geen native videoprocessing vergelijkbaar met Gemini.

Wat Claude wel kan:

- Reeksen geüploade frames analyseren, vergelijkbaar met ChatGPT’s handmatige extractiemethode (Methode 2)

- Gedetailleerde beschrijvingen geven van visuele content per frame

- Redeneren over impliciete beweging of veranderingen tussen frames als je dat expliciet aanstuurt

- Langere reeksen afbeeldingen verwerken dankzij een uitgebreide contextwindow (tot 1M tokens in Claude Opus 4.7)

Wat Claude niet kan:

- Videobestanden rechtstreeks accepteren via eender welke interface

- Automatisch beweging of objecten door de tijd volgen zonder expliciete frame-voor-frame-aansturing

- Audio transcriberen—vereist aparte preprocessing met Whisper of een vergelijkbare service, en daarna het transcript aan Claude doorgeven

Wanneer je toch Claude kiest:

- Je workflow bevat frame-extractie al als preprocessingstap

- Je analyseert lange video’s die veel frames vereisen en hebt Claude’s grotere contextwindow nodig

- Je vergelijkt de kwaliteit van visuele analyse en vindt Claude’s framebeschrijvingen nauwkeuriger of gedetailleerder voor jouw domein (bijv. medische beeldvorming, technische diagrammen)

- Je moet analyse van videoframes combineren met grote hoeveelheden andere contextinformatie

Vergelijkingstabel met mogelijkheden

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Directe upload van videobestand | ✓ (web/app-interface) | ✓ (API + webinterface) | ✗ |

| Native bewegingsvolging | ✗ | ✓ | ✗ |

| Audiotranscriptie | ✓ (Whisper-integratie) | ✓ (geïntegreerd) | ✗ (vereist externe tool) |

| Frame-gebaseerde analyse | ✓ | ✓ (ook continue verwerking) | ✓ (alleen handmatige extractie) |

| Detectie van scènewissels | ✗ (alleen handmatig) | ✓ (automatisch) | ✗ |

| Typische videolengte | ~5–10 min (context beperkt) | ~1 uur (resolutieafhankelijk) | N.v.t. (aantal frames beperkt door context) |

| Beste use-case | Snelle samenvattingen, frame-niveauanalyse met enige controle | Bewegingsvolging, temporeel redeneren, continue video | Diepe frame-voor-frame-beschrijving met grote contextbehoefte |

| API-videosteun | ✗ (alleen afbeeldingen) | ✓ | ✗ |

Besliskader:

- Kies ChatGPT wanneer: Je snelle videosamenvattingen nodig hebt, de kritieke informatie over meerdere frames aanwezig blijft, je met korte clips (onder 10 minuten) werkt en geen bewegingsvolging nodig hebt. Best voor educatieve content, statische productdemo’s, meetingtranscripties.

- Kies Gemini wanneer: Je use-case bewegingsvolging, detectie van scènewissels of temporeel redeneren vereist over hoe elementen in de tijd bewegen of veranderen. Cruciaal voor surveillancebeelden, sportanalyse, animatiereview of scenario’s waarin “wat er tussen frames gebeurt” ertoe doet.

- Kies Claude wanneer: Je toch al frames extraheert als onderdeel van je pipeline, veel frames met veel extra context moet analyseren, of Claude’s visuele beschrijvingen nauwkeuriger vindt voor jouw domein. Vereist de meeste preprocessing maar biedt het grootste contextwindow.

Voor ontwikkelaars die met meerdere modellen werken, biedt CometAPI een uniforme interface om de kwaliteit van videoprocessing te testen over GPT-, Gemini- en Claude-varianten zonder je integratiecode te herschrijven—handig wanneer je uitvoerkwaliteit wilt vergelijken voordat je je op een specifieke provider vastlegt.

Het echte antwoord op “kan ChatGPT video’s bekijken” is niet binair. Het is “ja, door video om te zetten naar formaten die het al verwerkt—met beperkingen die specifieke use-cases breken.” De meeste implementatiefalingen komen voort uit architectonische mismatches, niet uit capaciteitsgaten. Het model werkt precies zoals ontworpen; ontwikkelaars verwachtten alleen een ander ontwerp.

Als je op schaal videoanalysefeatures bouwt, test je workflow dan eerst met randgevallen: upload dezelfde video via directe bestandsupload, handmatig geëxtraheerde frames en alleen-transcriptmethoden. Vergelijk de outputs. De methode die het kritieke signaal van jouw use-case vastlegt—niet degene die het snelst te implementeren is—is degene die productiebelasting overleeft.

Voordat je je aan ChatGPT voor video commit:

- Bepaal of jouw kritieke informatie in stabiele frames, in beweging of in audio zit

- Test de framesamplingdekking door handmatig frames te extraheren op je verwachte intervallen

- Verifieer dat on-screen tekst leesbaar is op de resolutie van je video na compressie

- Bevestig dat je videolengte binnen de praktische contextlimieten voor je abonnementsniveau past

- Voorzie een fallback voor content die kortstondig verschijnt of tussen bemonsterde frames valt

Voor ontwikkelaars die meerdere AI-providers evalueren voor videowerkloads, biedt CometAPI een uniforme playground om ChatGPT, Gemini en Claude met dezelfde videoinvoer te testen—zodat je uitvoerkwaliteit, latency en kosten kunt vergelijken voordat je provider-specifieke integraties bouwt.

FAQ - Gids voor AI-videoanalyse

Snelle antwoorden op veelgestelde vragen over AI-videoanalyse.

Kan ChatGPT video’s analyseren?

Ja, ChatGPT (GPT-4o en later) kan video’s analyseren door frames te bemonsteren (~1 per seconde) en audio te transcriberen. Het werkt goed voor meetingsamenvattingen, tekstextractie van slides en het identificeren van objecten. Het worstelt echter met bewegingsvolging, video’s langer dan 10 minuten en real-time streaming.

Hoe upload ik video’s naar ChatGPT?

Directe URL-upload (aanbevolen): Upload via een publieke URL voor snelle analyse. Het best voor video’s onder 10 minuten.

Handmatige frame-extractie: Extraheer specifieke frames voor precieze controle. Het best wanneer je bepaalde momenten wilt analyseren of tokenkosten wilt verlagen.

Wat is de maximale videolengte die ChatGPT aankan?

ChatGPT verwerkt betrouwbaar video’s tot 5–10 minuten. Daarboven moet je de video segmenteren of overschakelen naar Gemini 2.5 Pro, dat native video’s tot 60 minuten ondersteunt.

Wat zijn de beperkingen van de videoanalyse van ChatGPT?

- Kan geen continue beweging volgen (sport, dans)

- Onnauwkeurige tijdstempels (±1 seconde)

- Mist content die minder dan 1 seconde verschijnt

- Praktische limiet van 10 minuten

- Geen ondersteuning voor real-time streaming

- Moeite met video’s van lage kwaliteit of donkere beelden

- Zwak in temporeel oorzaak-gevolg-redeneren *

Moet ik ChatGPT of Gemini gebruiken voor videoanalyse?

Gebruik ChatGPT voor:

- Video’s onder 10 minuten

- Superieure tekstredenering na videoanalyse

- Analyse op frameniveau (slides, screenshots)

Gebruik Gemini voor:

- Video’s van 10–60 minuten

- Bewegingsvolging en bewegingsanalyse

- Temporele redeneertaken

- Sport, dans of surveillancebeelden *

Kan Claude video’s analyseren?

Nee, Claude ondersteunt geen directe videoinvoer. Je kunt echter frames uit video’s extraheren en die met Claude analyseren, dat superieure tekstredenering en een groot contextwindow biedt voor lange analyses.

Hoeveel kost videoanalyse?

Kosten variëren per model en videolengte:

- ChatGPT 4o: ~$0.05 per minuut

- Gemini 2.5 Pro: ~$0.04 per minuut

CometAPI biedt tegoed voor nieuwe gebruikers om te starten.