Claude Opus 4.7, uitgebracht op 16 april 2026, is een aanzienlijke upgrade ten opzichte van Opus 4.6 op het gebied van coderen, agent-gestuurde workflows, vision en het opvolgen van instructies. Het scoort +6,8 pp op SWE-bench Verified (87,6% vs 80,8%), +10,9 pp op SWE-bench Pro (64,3% vs 53,4%), +12 pp op CursorBench (70% vs 58%), en levert 3,3× hogere-resolutie vision met zelfverificatie-lussen die hallucinaties bij langlopende taken verminderen. Prijzen blijven officieel identiek ($5/$25 per miljoen tokens), maar low-effort 4.7 evenaart de kwaliteit van medium-effort 4.6, wat de werkelijke kosten verlaagt.

Op CometAPI krijg je beide modellen (Claude Opus 4.7 en Opus 4.6) voor $4 input / $20 output met OpenAI-compatibele endpoints en nul vendor lock-in. Upgrade als je productie-codeagents draait, complexe documentanalyse doet of multi-sessie workflows hebt—4.7 is de nieuwe standaard voor grensverleggend werk.

Claude Opus 4.7 vs Opus 4.6: Snelle vergelijking

Conclusie: Opus 4.7 voelt als “Opus 4.6 maar ongeremd en verfijnd.” Het verwijdert beperkingen die in 4.6 soms opdoken (bijv. voortijdig stoppen met taken, lagere visuele scherpte) en voegt efficiëntie toe via adaptief redeneren. Gebruikers melden dat het model “meer uitgesproken” en collaboratiever is—alsof je werkt met een senior engineer die zijn eigen werk dubbelcheckt.

Waarom Claude Opus 4.7 ertoe doet in 2026

Op 16 april 2026 bracht Anthropic stilletjes zijn meest capabele algemeen beschikbare model tot nu toe uit: Claude Opus 4.7. Slechts weken na de beperkte Mythos Preview (een op cyber gerichte krachtpatser) pakt Opus 4.7 de kroon terug voor productieworkloads, met exact dezelfde prijsstelling als Opus 4.6.

Ontwikkelaars en bedrijven hoeven de moeilijkste codeertaken niet langer constant te babysitten. Gebruikers melden dat ze “de soort taken die eerder nauw toezicht vereisten” met vertrouwen aan 4.7 kunnen overdragen. Het model verifieert nu zelf zijn output, volgt instructies letterlijk op en kan multi-uur agentische runs volhouden met minder toolfouten en betere foutafhandeling.

Het model blinkt uit in:

- Strenge langlopende taken met ingebouwde zelfverificatie (Plan → Execute → Verify → Report).

- Letterlijke opvolging van instructies—geen losse interpretaties meer van “consider” of “you might.”

- Aanzienlijk betere vision (tot 2.576 px lange zijde ≈ 3,75 MP, meer dan 3× eerdere resolutie).

- Hogere smaak en creativiteit in professionele output zoals interfaces, slides en documenten.

- Verbeterd bestandssysteemgeheugen voor echte multi-sessie autonomie.

Nieuwe features omvatten een xhigh effortniveau (tussen high en max), taakbudgetten op de Platform API en integratie met Claude Design. De model-ID is nu claude-opus-4-7. Prijzen zijn officieel ongewijzigd, maar verbeteringen in token-efficiëntie verlagen vaak de effectieve kosten per taak.

Kernverbeteringen – Wat is er daadwerkelijk veranderd

Geavanceerde software-engineering & agent-gestuurd coderen

Opus 4.7 blinkt uit op de moeilijkste problemen. Op een interne benchmark met 93 taken voor coderen behaalde het een 13% hogere oplossingsgraad dan 4.6, met vier opgeloste taken die noch 4.6 noch Sonnet 4.6 wist te kraken. Rakuten-SWE-Bench liet 3× meer productie-waardige taken opgelost zien zonder menselijke interventie. CursorBench (echte IDE-workflows) sprong +12 punten naar 70%.

De interne benchmark met 93 taken liet een stijging van 13% zien, met vier opgeloste taken die noch 4.6 noch Sonnet 4.6 wist te kraken. In agentische workflows rapporteerde Box 2× minder LLM-calls (7,1 vs 16,3) en 30% lagere AI-unitconsumptie voor dezelfde output—wat zich direct vertaalt in winst in kosten en latency.

Waarom dit ertoe doet voor ontwikkelaars: Je kunt Opus 4.7 nu toevertrouwen met “het moeilijkste codeerwerk” dat voorheen toezicht vereiste. Het let zeer precies op instructies, verifieert zijn eigen output en hergebruikt bestandssysteemgeheugen over sessies heen—perfect voor autonome refactors over meerdere dagen.

Succes in de praktijk omvat:

- Autonome Rust-tekst-naar-spraakengine vanuit één prompt.

- Verholpen racecondities en concurrency-bugs die eerdere modellen de baas waren op Terminal-Bench 2.0 (+4,0 pp).

- 10–15% verbetering in Factory Droids-tasksucces met ⅓ minder toolfouten.

- Dubbelcijferige verbeteringen in codekwaliteit, testkwaliteit en reviewnauwkeurigheid (CodeRabbit, Qodo).

Low-effort 4.7 evenaart nu de kwaliteit van medium-effort 4.6, dus je bereikt meer voor dezelfde (of lagere) tokenbesteding.

Vision & multimodale sprong

Dit is de grootste enkele upgrade. De maximale beeldresolutie springt van 1,15 MP (1568 px) naar 3,75 MP (2576 px op de lange zijde) — een 3,3× toename in pixels met 1:1-coördinatenmapping. Geen schaalfactorrekenwerk meer voor screenshots of diagrammen.

Resultaten:

- Benchmark visuele scherpte: 98,5% vs 54,5% op 4.6.

- CharXiv-R (zonder tools): +13,4 pp; met tools: +13,6 pp.

- Ontgrendelt pixel-perfecte computergebruik-agents, dichte screenshotanalyse, chemische-structuurparsing en UI/UX-designreview.

Agent-gestuurde workflows, betrouwbaarheid & opvolgen van instructies

Opus 4.7 introduceert native zelfverificatie—het model plant, voert uit, verifieert en rapporteert. Dit reduceert drastisch zelfverzekerde maar foute antwoorden bij langetermijntaken. Verbeteringen in bestandssysteemgeheugen maken echte autonomie over meerdere dagen mogelijk.

Het opvolgen van instructies is strenger en letterlijker. Prompts die getuned zijn voor de lossere stijl van 4.6 kunnen herziening nodig hebben—zinnen als “consider” worden nu als harde vereisten behandeld. Dit is een feature voor werk waar precisie cruciaal is, maar vereist promptmigratie.

Let op regressies: Retrieval van naalden in lange context (MRCR) daalde merkbaar (bijv. 91,9% → 59,2% bij 256K). Anthropic geeft aan dergelijke synthetische tests uit te faseren ten gunste van toegepaste GraphWalks-metrieken, waar echte codebegrip sterk blijft.

Nieuw xhigh-inspanningniveau + taakbudgetten

Opus 4.7 voegt xhigh toe tussen high en max voor fijnmazige controle. Claude Code gebruikt nu standaard xhigh in plannen. De nieuwe task_budget (public beta) laat het model het totaal aantal tokens over een volledige agentische loop bijhouden en netjes afronden.

Opvolgen van instructies, zelfverificatie & geheugen

Opus 4.7 interpreteert prompts letterlijker — goed voor precisie, maar oude vage prompts hebben mogelijk aanscherping nodig. Het bedenkt nu eigen verificatiestappen (Plan → Execute → Verify → Report) en hergebruikt bestandssysteemgeheugen over multi-sessie werk veel beter dan 4.6. Voor teams die persistente agents bouwen, is dit een van de nuttigste upgrades omdat het herhaald uitleggen, herladen en herplannen vermindert.

Tokenizer-update

De nieuwe tokenizer verbetert de kwaliteit maar kan 1,0–1,35× meer tokens verbruiken (tot +35%). Het endpoint voor tokkentelling geeft nu andere aantallen terug. Per saldo compenseert de hogere kwaliteit per taak vaak de toename, vooral bij lagere effortniveaus.

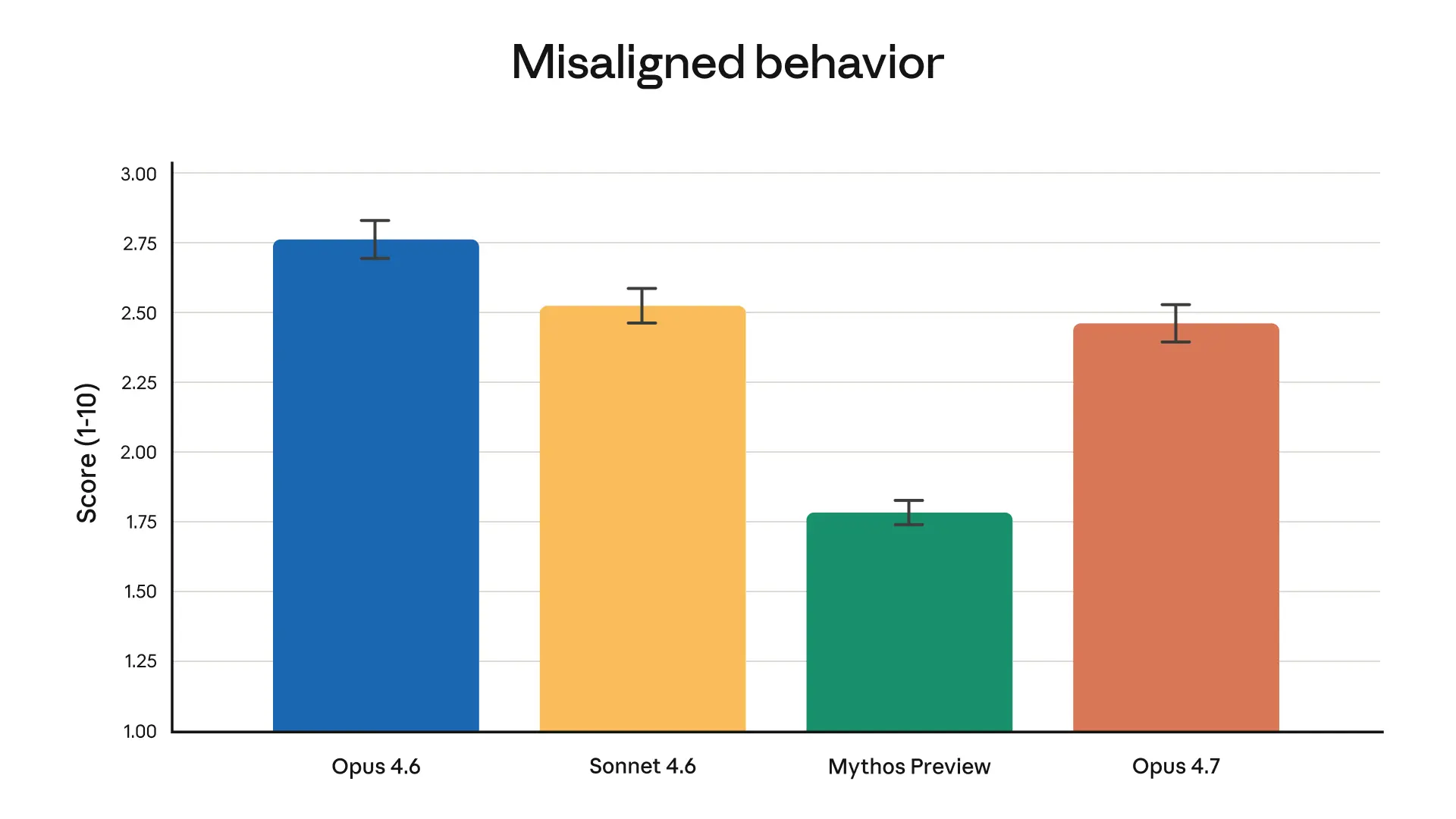

Veiligheid, alignment & cybersecurity

Het veiligheidsprofiel is vergelijkbaar met 4.6 (lage misalignment), met bescheiden verbeteringen in eerlijkheid en weerstand tegen prompt-injecties.

Opus 4.7 levert Project Glasswing-waarborgen: realtime blokkeren van verboden/hoogrisico cybertoepassingen. CyberGym-score bewust vlak. Misaligned gedrag bescheiden verbeterd ten opzichte van 4.6. Volledige systeemkaart beschikbaar op de site van Anthropic.

Prijzen, tokenefficiëntie & CometAPI-besparingen

Officiële prijzen zijn identiek, maar de effectieve kosten per taak dalen omdat low-effort 4.7 ≈ medium-effort 4.6 qua kwaliteit, en hogere succeskans betekent minder retries. De nieuwe tokenizer verhoogt inputtokens met 0–35% bij identieke tekst, maar netto gebruik is vaak gunstig bij gelijke kwaliteitsniveaus.

Voordeel van CometAPI: Toegang tot beide modellen voor $4 input / $20 output per miljoen tokens—20% goedkoper dan officieel—plus naadloos schakelen tussen 500+ modellen (GPT-5.4, Gemini 3.1, enz.) via één OpenAI-compatibel of Anthropic Messages endpoint. Geen downtime als providers prijzen wijzigen. Nul vendor lock-in. Playground-tests en uniforme facturatie maken migratie moeiteloos.

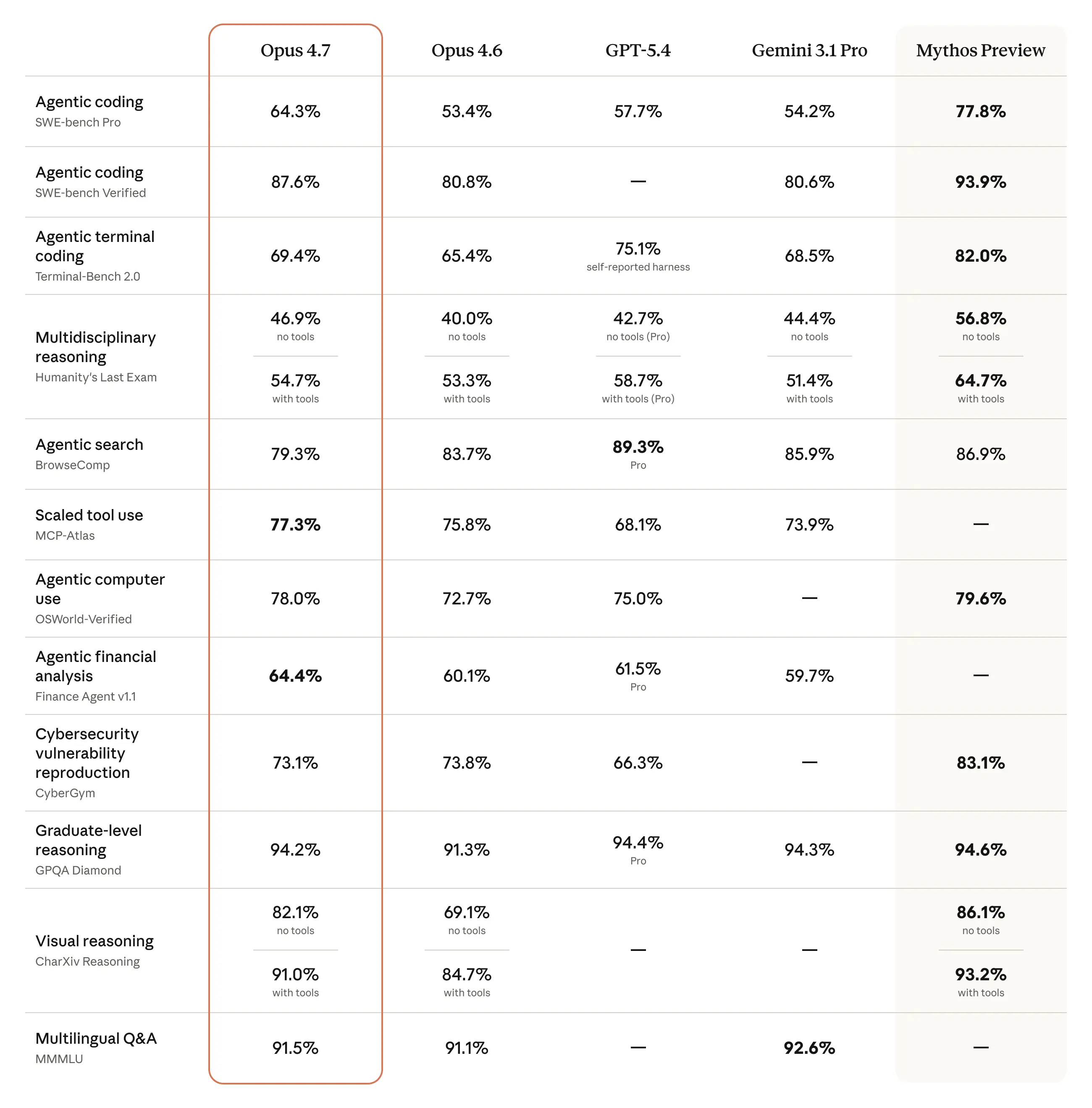

Side-by-Side benchmark deep dive

Hier is de complete kop-aan-kop van 14 benchmarks uit de launchdata van Anthropic (geverifieerd door partners):

Coding-benchmarks

- SWE-bench Verified: 80,8% → 87,6% (+6,8 pp)

- SWE-bench Pro: 53,4% → 64,3% (+10,9 pp)

- Terminal-Bench 2.0: 65,4% → 69,4% (+4,0 pp)

Agentisch & toolgebruik

- MCP-Atlas: 62,7% → 77,3% (+14,6 pp) — grootste enkele sprong

- OSWorld-Verified: 72,7% → 78,0% (+5,3 pp)

- Finance Agent: 60,7% → 64,4% (+3,7 pp)

Redeneren & kennis

- GPQA Diamond: 91,3% → 94,2% (+2,9 pp)

- HLE (zonder tools): 40,0% → 46,9% (+6,9 pp)

- MMMLU: 91,1% → 91,5% (+0,4 pp)

Vision

- CharXiv-R (zonder tools): 68,7% → 82,1% (+13,4 pp)

- CharXiv-R (tools): 77,4% → 91,0% (+13,6 pp)

Regressies (transparant)

- BrowseComp: 84,0% → 79,3% (–4,7 pp) — gevoelig voor testopzet

- CyberGym: 73,8% → 73,1% (–0,7 pp) — bewust voor veiligheid

Interne research-agentbenchmark: 0,715 overall (gedeelde topscore), met de Finance-module van 0,767 naar 0,813.

Prestaties in de praktijk & use-cases

De agentische workflowtests van Box lieten zien dat Opus 4.7 taken afrondde met 7,1 LLM-calls vs 16,3 voor 4.6 (2,3× minder) en 30% lagere AI Unit-consumptie. Latency daalde van 242 s naar 183 s mediaan.

Enterprise-partners (Harvey, Databricks, Hebbia, Ramp, Genspark) rapporteren:

- 21% minder fouten in documentredenering.

- Betere multi-agentcoördinatie over uren.

- Strakkere integratie van slide decks, spreadsheets en code.

Wie moet direct upgraden?

- Software-engineeringteams die Cursor/Claude Code gebruiken.

- AI-agentbouwers die betrouwbare langetermijnautonomie nodig hebben.

- Vision-zware workflows (screenshots, diagrammen, UI-review).

- Finance, legal en automatisering van kenniswerk.

API-wijzigingen, migratiegids & codevoorbeelden

Breaking Changes (Messages API)

- Extended thinking budgets verwijderd → gebruik

thinking: {"type": "adaptive"}. - Samplingparams (

temperature, etc.) niet meer geaccepteerd → gebruik prompting. - Thinking content standaard weggelaten.

- Nieuwe tokenizer vereist extra marge in

max_tokens.

Migratiegids + codevoorbeelden (CometAPI)

Stap 1: Update de modelnaam naar claude-opus-4-7 (of CometAPI-alias).

Stap 2: Audit prompts op letterlijke interpretatie.

Stap 3: Test effortniveaus (begin met xhigh voor coderen).

Stap 4: Gebruik taakbudgetten om de uitgaven te begrenzen.

Hier is een direct uitvoerbaar Python-voorbeeld met CometAPI’s Anthropic-compatibele endpoint (werkt ook met de officiële SDK):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Demo-prompt voor zelfverificatie (werkt veel beter op 4.7):

(tekst):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Voer A/B-tests uit op je eigen workloads—de meeste teams zien 20–40% minder iteraties.

Opmerking:

Ten eerste: De nieuwe tokenizer genereert meer tokens uit dezelfde tekst. Opus 4.7 introduceerde een nieuwe tokenizer die verbetert hoe het model tekst verwerkt. De trade-off is dat dezelfde input naar meer tokens wordt gemapt; het exacte aantal hangt af van het contenttype, maar ligt grofweg tussen 1,0 en 1,35 keer.

Ten tweede: Hogere effortniveaus zorgen voor meer grondige overweging, vooral in agent-scenario’s met meerdere beurten.

Dit leidt tot betere betrouwbaarheid, maar ook tot meer outputtokens.

De officiële oplossing biedt drie benaderingen:

- Het inspanningsniveau aanpassen met de parameter

efficiency - Het budget begrenzen met taakbudgetten

- Het model in de prompt vertellen om “be conciser” te zijn.

Bekende beperkingen en migratienotities

- Extended thinking budgets verwijderd → gebruik

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}wordt niet langer ondersteund; gebruik in plaats daarvan adaptive thinking. - Samplingparams (

temperature, etc.) niet meer geaccepteerd → gebruik prompting.temperature,top_pentop_kmoeten uit requests worden verwijderd bij migratie naar Opus 4.7. - Het model wordt beschreven als letterlijker en directer dan Opus 4.6, wat nuttig is voor precisie maar scherpere prompts kan vereisen.

- Nieuwe tokenizer vereist marge in

max_tokens. Anthropic raadt aan de marge inmax_tokenste herzien, omdat Opus 4.7 hogere aantallen tokens kan produceren voor dezelfde tekst. - Thinking content standaard weggelaten.

Eindoordeel & aanbeveling

Claude Opus 4.7 is de duidelijke winnaar voor elke serieuze coding-, agentische of vision-workload in 2026. De winst is niet incrementeel—ze transformeert productie. Als je Opus 4.6 gebruikt, migreer deze week. De combinatie van hogere kwaliteit, minder calls en identieke (of via CometAPI lagere) prijsstelling maakt het een no-brainer.

Actiestappen:

- Test 4.7 in CometAPI’s playground met je echte workloads.

- Update eerst één service (Cursor of je agentframework).

- Monitor tokengebruik in de eerste week.

- Schaal met vertrouwen, wetende dat je uniforme, goedkopere toegang hebt tot 500+ modellen.