Resposta rápida: qual modelo de IA os desenvolvedores devem priorizar em 2026?

Para tarefas que exigem raciocínio autônomo máximo e mínima alucinação, os desenvolvedores devem escolher o GPT-5.5 (xhigh), que lidera o mercado com um Índice de Inteligência de 60. Aplicações que demandam interatividade em tempo real devem utilizar o Mercury 2, o atual líder em velocidade com aproximadamente 859 tokens por segundo. Para produção em larga escala quando o orçamento é a principal restrição, DeepSeek V4 Pro e Kimi K2.6 oferecem inteligência próxima à de fronteira a cerca de 10% do custo dos modelos proprietários topo de linha.

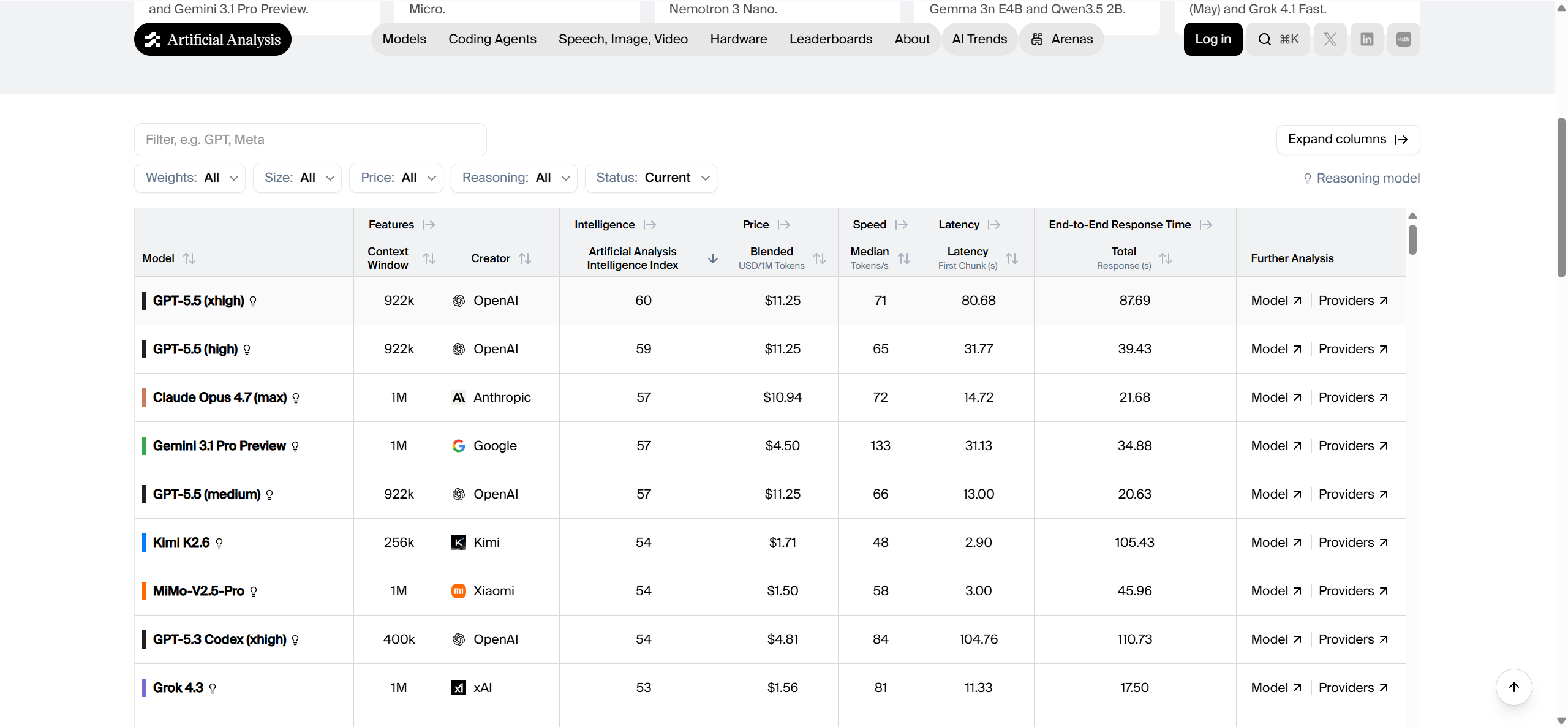

O Índice de Inteligência: classificação dos modelos de fronteira

O cenário de IA em 2026 mudou de perseguir contagem de parâmetros para otimizar a densidade de “pensamento”. O Artificial Analysis Intelligence Index v4.0 serve como padrão do setor para quantificar a capacidade dos modelos em dez dimensões especializadas, incluindo programação em nível profissional e dedução lógica extrema.

| Modelo | Índice de Inteligência | Janela de contexto | Melhor caso de uso |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Pesquisa científica e lógica |

| GPT-5.5 (high) | 59 | 922K | Programação em nível profissional |

| Claude Opus 4.7 (max) | 57 | 1M | Agentes autônomos e planejamento |

| Gemini 3.1 Pro | 57 | 1M - 2M | Síntese multimodal de dados |

| Kimi K2.6 | 54 | 256K | Trabalho orientado a agentes no terminal |

| MiMo-V2.5-Pro | 54 | 1M | Engenharia de software full-stack |

| DeepSeek V4 Pro (Max) | 52 | 1M | Fluxos de trabalho de raciocínio escaláveis |

| GLM-5.1 | 51 | 200K | Tarefas autônomas de longo prazo |

Como ler esta tabela

Dos cinco principais modelos, três são modelos GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 e Gemini 3.1 Pro. Esses três modelos estandartes ocidentais estão empatados, enquanto Kimi K2 e mimo-v2.5 pro, dois modelos chineses, oferecem desempenho comparável aos principais modelos ocidentais a preços extremamente competitivos.

O Artificial Analysis Intelligence Index é uma métrica normalizada derivada de avaliações independentes como Terminal-Bench Hard e IFBench. Um único ponto de diferença representa uma lacuna estatisticamente significativa no “limiar de autonomia” de um modelo. Por exemplo, a diferença de 3 pontos entre GPT-5.5 (60) e Claude Opus 4.7 (57) geralmente se traduz na diferença entre um modelo que requer intervenção humana a cada poucos passos e outro que consegue completar uma cadeia lógica complexa de forma independente. Um índice mais alto está geralmente associado a maiores taxas de sucesso no “Humanity’s Last Exam” e a menos erros de chamadas de ferramenta em ambientes com agentes.

Os reflexos: latência e velocidade de geração

Para software interativo — de assistentes de IDE ao vivo a agentes de voz voltados ao cliente — a inteligência bruta é secundária em relação ao Time to First Token (TTFT) e ao throughput de geração.

Top 5 modelos mais rápidos (throughput)

Throughput mede a velocidade com que um modelo gera texto após a fase de processamento inicial. Alto throughput é essencial para geração de conteúdo de longo formato e refatoração rápida de código.

- Mercury 2: Aproximadamente 859 tokens/s

- Granite 4.0 H Small: Aproximadamente 407 tokens/s

- Granite 3.3 8B: Aproximadamente 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Aproximadamente 331 tokens/s

- Qwen3.5 0.8B: Aproximadamente 287 tokens/s

Top 5 modelos com menor latência (TTFT)

Latência indica o atraso antes que o primeiro token chegue ao usuário. Esta é a métrica crítica para a “vibe” e a responsividade percebida em UI/UX.

- NVIDIA Nemotron 3 Nano: Aproximadamente 0.40s

- Ministral 3 3B: Aproximadamente 0.47s

- Qwen3.5 0.8B: Aproximadamente 0.52s

- LFM2 24B A2B: Aproximadamente 0.55s

- Grok 3 mini Reasoning: Aproximadamente 0.58s

Como escolher seu modelo em 2026

Selecionar um modelo requer equilibrar a razão “Inteligência por dólar” com os requisitos específicos de uptime da sua aplicação. O mercado em 2026 se dividiu em três caminhos arquiteturais distintos.

Desenvolvedores independentes e equipes sensíveis a orçamento

Para desenvolvedores solo ou pequenas equipes executando milhares de loops de agentes experimentais, o DeepSeek V4 Pro é a escolha estratégica ideal. Ele utiliza uma arquitetura Mixture-of-Experts (MoE) massiva de 1.6T parâmetros na qual apenas 49B parâmetros são ativados por token, permitindo entregar desempenho de topo a aproximadamente $0.416 por milhão de tokens. Outra excelente opção para tarefas específicas de programação é o Kimi K2.6, que se especializa em fluxos de trabalho “terminal-first”. Esses modelos oferecem quase 90% do poder de raciocínio dos modelos premium, sendo aproximadamente 70–80% mais baratos, prolongando efetivamente a runway de uma startup.

Ambientes de produção corporativos

Para implantações em toda a empresa, onde estabilidade e aderência a prompts de sistema complexos são inegociáveis, o padrão do setor continua sendo GPT-5.5 Pro e Claude Opus 4.7. O GPT-5.5 Pro é projetado para precisão de alto risco, destacando-se em áreas como modelagem de investment banking e exploração científica, onde o custo de um erro supera o custo da chamada de API. O Claude Opus 4.7 é preferido por equipes que exigem confiabilidade sustentada em projetos de vários dias, pois apresenta uma taxa de alucinação significativamente menor em ambientes de terminal em comparação com a família GPT mais ampla. Empresas normalmente usam o CometAPI para integrar esses modelos por meio de um gateway único, garantindo 99.9% de uptime e failover imediato se um provedor primário apresentar picos de latência regionais.

Aplicações interativas em tempo real

Aplicações como bots de suporte ao cliente em tempo real ou legendagem instantânea de vídeo exigem uma IA “fluida” que pareça instantânea. Nesta categoria, Mercury 2 e Gemini 3.1 Flash-Lite são as escolhas superiores. O Mercury 2 oferece throughput quase dez vezes mais rápido do que modelos de raciocínio padrão, tornando-o ideal para redação de documentos em tempo real. O Gemini 3.1 Flash-Lite fornece uma capacidade multimodal equilibrada, processando texto, áudio e imagens em um contexto unificado a aproximadamente 2.5x a velocidade de gerações anteriores, tudo enquanto oferece uma janela de contexto de 1 milhão de tokens.

Janela de contexto: de trechos a repositórios inteiros

A janela de contexto funciona como a “memória de curto prazo” do modelo. Em 2026, o setor se dividiu entre janelas padrão (128K) e capacidades em escala de repositório (1M–10M).

- Llama 4 Scout: 10,000,000 tokens

- Grok 4.20: 2,000,000 tokens

- Gemini 3.1 Pro: Aproximadamente 1,048,576 tokens

- DeepSeek V4 Pro: 1,000,000 tokens

- GPT-5.5 Pro: 1,050,000 tokens

Quando o tamanho do contexto importa?

Uma janela de contexto de 128K — padrão para modelos como DeepSeek-V3.2 — agora é a base para chat conversacional básico e sumarização de artigos individuais. No entanto, engenharia de software profissional exige consciência do sistema como um todo.

Uma janela de 1 milhão de tokens permite que um agente de IA ingira um repositório de software inteiro, incluindo todos os arquivos-fonte, documentação e logs históricos, em uma única passagem direta. Isso evita a “deriva de memória” associada a sistemas tradicionais de RAG, nos quais dados relevantes podem ser perdidos durante o chunking. Um exemplo concreto é um refator de base de código: um modelo com 1M tokens pode entender como uma mudança em um esquema de banco de dados central afeta cinquenta endpoints de API diferentes em arquivos separados, enquanto um modelo menor pode “ver” apenas alguns arquivos por vez, levando a dependências quebradas.

Comparação econômica: preço unitário por 1 milhão de tokens

A tabela a seguir usa a métrica Blended USD/1M Tokens, assumindo uma razão de 3:1 de tokens de entrada para saída para refletir padrões de uso do mundo real.

| Modelo | Preço médio (por 1M) | Valor relativo | Desconto via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Aproximadamente $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Aproximadamente $10.00 | Alto | 20% OFF |

| Gemini 3.1 Pro | Aproximadamente $4.50 | Equilibrado | 20% OFF |

| Kimi K2.6 | Aproximadamente $1.71 | Alto valor | 20% OFF |

| DeepSeek V4 Pro | Aproximadamente $0.53 | Valor extremo | 20% OFF |

| Qwen3.5 0.8B | Aproximadamente $0.02 | Utilitário | 20% OFF |

Todas as tarifas verificadas em maio de 2026. As tarifas oficiais dos fornecedores são tipicamente 20% mais altas do que as tarifas com desconto fornecidas por meio de gateways unificados.

Estratégia de otimização de custos

Para auxiliar no planejamento de arquitetura, estimamos os gastos mensais para três níveis comuns de crescimento.

- Equipe pequena de desenvolvedores (10M tokens/mês): Equipes usando principalmente Kimi K2.6 para construção de funcionalidades e DeepSeek V4 Flash para lógica simples verão um gasto mensal entre $15 e $40. Isso permite prototipagem agressiva com um ônus financeiro não maior do que uma assinatura SaaS padrão.

- SaaS de médio porte (100M tokens/mês): Uma startup escalando uma plataforma de automação orientada por IA usando Claude Sonnet 4.6 e Gemini 3.1 Flash pode esperar custos mensais entre $250 e $550. Ao utilizar o cache de prompts disponível nesses modelos, o custo efetivo frequentemente cai em mais 15%.

- Grande empresa (1B tokens/mês): Empresas globais executando fluxos de trabalho com agentes de alta concorrência com GPT-5.5 e Claude Opus 4.7 provavelmente gastarão entre $3,000 e $6,500 por mês. Nessa escala, integrar via um gateway de API unificado torna-se essencial para faturamento centralizado e para evitar a sobrecarga de gerenciar contratos separados com múltiplos fornecedores.

Conclusão: escolhendo seu caminho em 2026

A era do “modelo para todos os fins” acabou. A arquitetura moderna de IA requer orquestrar uma frota de modelos especializados: GPT-5.5 para raciocínio de alto compute, Mercury 2 para interatividade e DeepSeek V4 para execução em alto volume. Ao integrar uma vez com o CometAPI, os desenvolvedores ganham portabilidade para trocar modelos à medida que os benchmarks evoluem, garantindo ao mesmo tempo um desconto permanente de 20–40% em cada requisição.

FAQ

Qual modelo de IA é atualmente o mais inteligente?

De acordo com o Artificial Analysis Intelligence Index v4.0, o GPT-5.5 (xhigh) é o modelo mais inteligente disponível, com pontuação 60. Em seguida vêm GPT-5.5 (high) com 59 e Claude Opus 4.7 (max) com 57.

Qual é o modelo de IA mais rápido para aplicações em tempo real?

O Mercury 2 é o campeão de velocidade de 2026, entregando aproximadamente 859.1 tokens por segundo. Para baixa latência (TTFT), o NVIDIA Nemotron 3 Nano lidera com tempo de resposta de aproximadamente 0.40 segundos.

Quão alta precisa ser a pontuação no Índice de Inteligência para agentes em produção?

Para automação básica ou classificação, uma pontuação entre 30 e 40 (como GPT-5.4 nano) costuma ser suficiente. Entretanto, para “Agentic Engineering”, em que a IA gerencia bases de código ou sessões inteiras de navegador, recomenda-se uma pontuação acima de 54 (como Kimi K2.6 ou GPT-5.5) para garantir consistência em planejamento de longo horizonte.

Com preços semelhantes, devo escolher GPT-5.5 ou Claude Opus 4.7?

Se seu fluxo de trabalho envolve execução no terminal e “Vibe Coding”, o GPT-5.5 geralmente se destaca nesses benchmarks específicos. Porém, se você precisa de consistência extrema para escrita profissional, pesquisa jurídica ou ciclos de agentes de vários dias com baixas taxas de alucinação, o Claude Opus 4.7 é o líder documentado nessas categorias.

Qual é a diferença real de desempenho entre modelos de pesos abertos (DeepSeek) e modelos proprietários?

Em 2026, a lacuna diminuiu para aproximadamente 10–15% em benchmarks de raciocínio bruto. Embora os topo de linha proprietários como GPT-5.5 (xhigh) ainda liderem em lógica “de pico” (Índice 60), modelos de pesos abertos como DeepSeek V4 Pro (Índice 52) e Kimi K2.6 (Índice 54) oferecem mais de 85% da capacidade a cerca de 1/10 do custo.

Como posso reduzir meus custos gerais de API para esses modelos?

Usar uma camada de API unificada como o CometAPI permite acessar todo o catálogo com tarifas 20% a 40% menores do que os preços oficiais dos fornecedores, por meio de compras em volume e roteamento de caminho inteligente.

Qual modelo tem a maior janela de contexto para documentos longos?

O Llama 4 Scout atualmente suporta a maior janela de contexto do mercado, com 10 milhões de tokens. O Grok 4.20 vem em seguida com 2 milhões de tokens, enquanto GPT-5.5 Pro, Gemini 3.1 Pro e DeepSeek V4 Pro suportam aproximadamente 1 milhão de tokens.

Existe uma forma de testar esses benchmarks sem um alto custo inicial?

Sim. Você pode criar uma conta gratuita no CometAPI para receber créditos de teste sem necessidade de cartão de crédito, permitindo realizar testes comparativos de desempenho em mais de 500 modelos no Playground integrado.