Principais recursos (lista rápida)

- Duas variantes de modelo:

grok-4-fast-reasoningegrok-4-fast-non-reasoning(ajustáveis para profundidade vs. velocidade). - Janela de contexto muito grande: até 2.000.000 de tokens, permitindo documentos extremamente longos / transcrições de várias horas / fluxos de trabalho com vários documentos.

- Foco em eficiência de tokens / custo: a xAI relata ~40% menos tokens de raciocínio em média em comparação com o Grok-4 e uma alegada ~98% de redução no custo para atingir o mesmo desempenho de benchmark (nas métricas relatadas pela xAI).

- Integração nativa de ferramentas / navegação: treinado de ponta a ponta com RL de uso de ferramentas para navegação na web/X, execução de código e comportamentos de busca agêntica.

- Multimodal e function calling: oferece suporte a imagens e saídas estruturadas; function calling e formatos de resposta estruturados são compatíveis na API.

Detalhes técnicos

Arquitetura de raciocínio unificada: o Grok-4-Fast usa uma única base de pesos de modelo que pode ser direcionada para comportamento de raciocínio (longa cadeia de pensamento) ou sem raciocínio (respostas rápidas) por meio de prompts de sistema ou seleção de variante, em vez de disponibilizar dois modelos de backbone totalmente separados. Isso reduz a latência de alternância e o custo de tokens para cargas de trabalho mistas.

Aprendizado por reforço para densidade de inteligência: a xAI relata o uso de aprendizado por reforço em larga escala focado em densidade de inteligência (maximizar o desempenho por token), que é a base para os ganhos declarados de eficiência de tokens.

Condicionamento por ferramentas e busca agêntica: o Grok-4-Fast foi treinado e avaliado em tarefas que exigem invocação de ferramentas (navegação na web, busca no X, execução de código). O modelo é apresentado como habilidoso em escolher quando chamar ferramentas e como integrar evidências de navegação nas respostas.

Desempenho em benchmarks

Melhorias no BrowseComp (44,9% pass\@1 vs 43,0% para o Grok-4), SimpleQA (95,0% vs 94,0%) e grandes ganhos em certos cenários de navegação/busca em língua chinesa. A xAI também relata uma classificação de topo na Search Arena da LMArena para uma variante grok-4-fast-search.

Casos de uso típicos e recomendados

- Busca e recuperação de alto throughput — agentes de busca que precisam de raciocínio web multi-hop rápido.

- Assistentes e bots agênticos — agentes que combinam navegação, execução de código e chamadas assíncronas de ferramentas (quando permitido).

- Implantações de produção sensíveis a custo — serviços que exigem muitas chamadas e desejam melhor economia de token para utilidade em comparação com um modelo base mais pesado.

- Experimentação para desenvolvedores — prototipagem de fluxos multimodais ou aumentados pela web que dependem de consultas rápidas e repetidas.

- Como acessar a API do Grok 4 fast

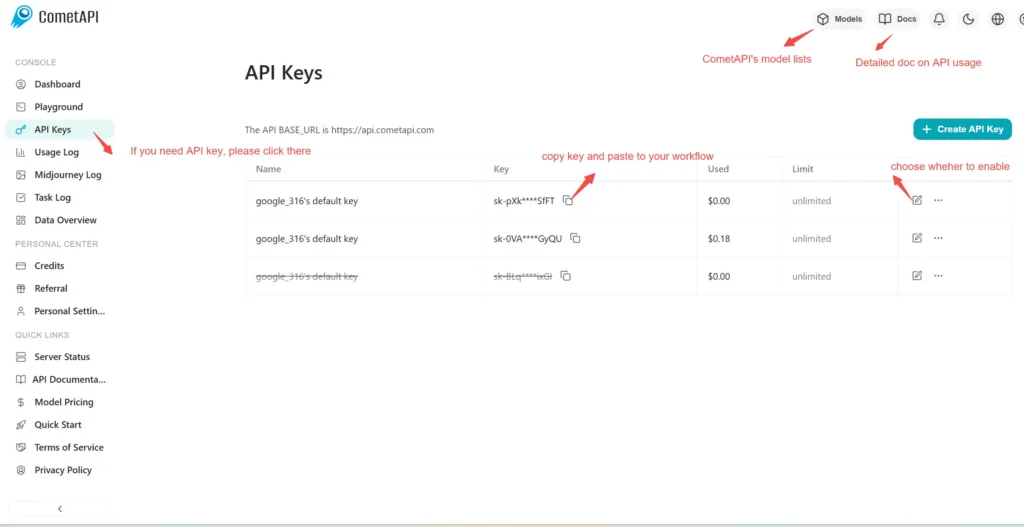

Etapa 1: Cadastre-se para obter uma chave de API

Faça login em cometapi.com. Se você ainda não for nosso usuário, registre-se primeiro. Entre no seu console do CometAPI. Obtenha a credencial de acesso, a chave de API da interface. Clique em “Add Token” na seção de token de API no centro pessoal, obtenha a chave do token: sk-xxxxx e envie.

Etapa 2: Envie solicitações para a API do Grok 4 fast

Selecione o endpoint “\grok-4-fast-reasoning/ grok-4-fast-non-reasoning\” para enviar a solicitação de API e defina o corpo da solicitação. O método de solicitação e o corpo da solicitação podem ser obtidos na documentação da API em nosso site. Nosso site também fornece teste no Apifox para sua conveniência. Substitua <YOUR_API_KEY> pela sua chave real do CometAPI da sua conta. A base url está no formato Chat (https://api.cometapi.com/v1/chat/completions).

Insira sua pergunta ou solicitação no campo content — é a isso que o modelo responderá. Processe a resposta da API para obter a resposta gerada.

Etapa 3: Recupere e verifique os resultados

Processe a resposta da API para obter a resposta gerada. Após o processamento, a API responde com o status da tarefa e os dados de saída.