Короткий ответ: какой ИИ‑модели разработчикам стоит отдать приоритет в 2026 году?

Для задач, требующих максимальной автономной логики и минимальных галлюцинаций, разработчикам стоит выбирать GPT-5.5 (xhigh), лидирующую на рынке с показателем Intelligence Index 60. Приложениям, ориентированным на интерактивность в реальном времени, следует использовать Mercury 2 — текущего лидера по скорости с примерно 859 tokens/s. Для крупномасштабного продакшена при жёстких бюджетных ограничениях DeepSeek V4 Pro и Kimi K2.6 обеспечивают уровень интеллекта, близкий к передовому, примерно за 10% стоимости флагманских проприетарных моделей.

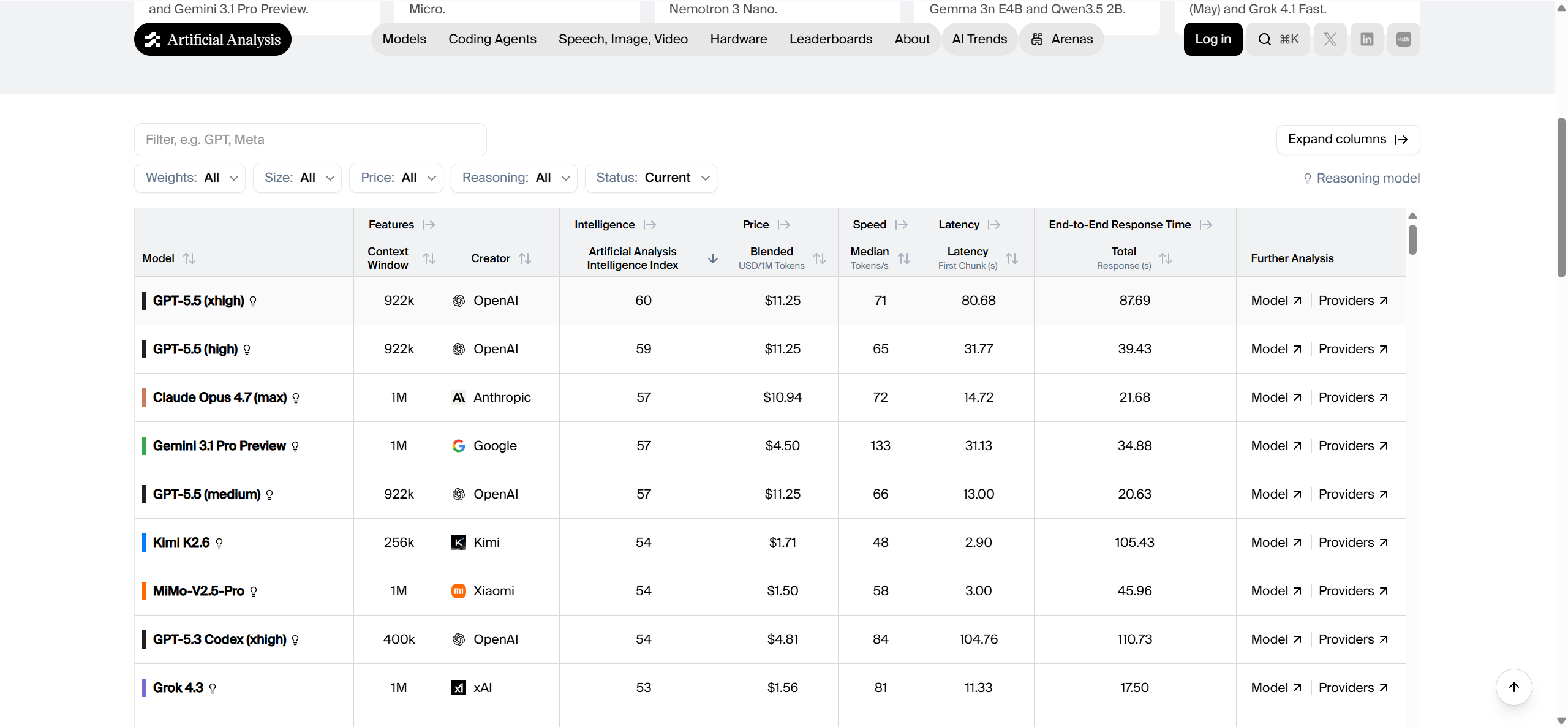

Индекс интеллекта: рейтинг передовых моделей

Ландшафт ИИ в 2026 году сместился от гонки за числом параметров к оптимизации плотности «мышления». Artificial Analysis Intelligence Index v4.0 выступает отраслевым стандартом для количественной оценки возможностей моделей по десяти специализированным измерениям, включая профессиональную разработку кода и экстремальные логические выводы.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Scientific research and logic |

| GPT-5.5 (high) | 59 | 922K | Professional-grade coding |

| Claude Opus 4.7 (max) | 57 | 1M | Autonomous agents and planning |

| Gemini 3.1 Pro | 57 | 1M - 2M | Multimodal data synthesis |

| Kimi K2.6 | 54 | 256K | Terminal-based agentic work |

| MiMo-V2.5-Pro | 54 | 1M | Full-stack software engineering |

| DeepSeek V4 Pro (Max) | 52 | 1M | Scalable reasoning workflows |

| GLM-5.1 | 51 | 200K | Long-horizon autonomous tasks |

Как читать эту таблицу

Из первых пяти моделей три — это модели GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 и Gemini 3.1 Pro. Эти три западных флагмана идут ноздря в ноздрю, в то время как Kimi K2 и mimo-v2.5 pro, две китайские модели, предлагают сопоставимую с ведущими западными моделями производительность по крайне конкурентным ценам.

Artificial Analysis Intelligence Index — нормализованный показатель, основанный на независимых оценках, таких как Terminal-Bench Hard и IFBench. Разница в один пункт представляет собой статистически значимый разрыв в «пороге автономности» модели. Например, разница в 3 пункта между GPT-5.5 (60) и Claude Opus 4.7 (57) часто означает разницу между моделью, которой требуется вмешательство человека каждые несколько шагов, и моделью, способной самостоятельно завершить сложную логическую цепочку. Более высокий индекс, как правило, ассоциируется с более высокой успешностью в "Humanity's Last Exam" и меньшим числом ошибок вызова инструментов в агентных средах.

Рефлексы: задержка и скорость генерации

Для интерактивного софта — от живых ассистентов в IDE до клиентских голосовых агентов — «сырой» интеллект вторичен по сравнению с Time to First Token (TTFT) и Generation Throughput.

Топ‑5 самых быстрых моделей (пропускная способность)

Throughput измеряет скорость генерации текста моделью после начальной фазы обработки. Высокая пропускная способность критична для длинных текстов и быстрого рефакторинга кода.

- Mercury 2: Approximately 859 tokens/s

- Granite 4.0 H Small: Approximately 407 tokens/s

- Granite 3.3 8B: Approximately 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Approximately 331 tokens/s

- Qwen3.5 0.8B: Approximately 287 tokens/s

Топ‑5 моделей с наименьшей задержкой (TTFT)

Latency показывает задержку до появления первого токена у пользователя. Это ключевой показатель «вибрации» и воспринимаемой отзывчивости в UI/UX.

- NVIDIA Nemotron 3 Nano: Approximately 0.40s

- Ministral 3 3B: Approximately 0.47s

- Qwen3.5 0.8B: Approximately 0.52s

- LFM2 24B A2B: Approximately 0.55s

- Grok 3 mini Reasoning: Approximately 0.58s

Как выбрать модель в 2026 году

Выбор модели требует баланса между соотношением «интеллект за доллар» и конкретными требованиями к доступности вашего приложения. Рынок 2026 года разошёлся на три чётких архитектурных пути.

Независимые разработчики и команды с ограниченным бюджетом

Для сольных разработчиков или небольших команд, запускающих тысячи экспериментальных агентных циклов, DeepSeek V4 Pro — оптимальный стратегический выбор. Она использует массивную архитектуру Mixture-of-Experts (MoE) с 1.6T параметров, где на токен активируется лишь 49B параметров, что позволяет выдавать флагманскую производительность примерно за $0.416 за миллион токенов. Ещё один отличный вариант для задач кодинга — Kimi K2.6, специализирующаяся на терминал‑ориентированных сценариях. Эти модели обеспечивают почти 90% мощности рассуждений премиальных решений, при этом приблизительно на 70–80% дешевле, эффективно продлевая «взлётную полосу» стартапа.

Корпоративные эксплуатационные среды

Для внедрений на уровне всей компании, где стабильность и строгое следование сложным системным промптам — безальтернативны, отраслевым стандартом остаются GPT-5.5 Pro и Claude Opus 4.7. GPT-5.5 Pro спроектирована для задач с высокими ставками, блестя в сферах вроде моделирования в инвестиционном банкинге и научных исследований, где стоимость ошибки выше стоимости API‑вызова. Claude Opus 4.7 предпочитают команды, которым нужна стабильная надёжность на протяжении многодневных проектов, поскольку она демонстрирует существенно более низкую частоту галлюцинаций в терминальной среде по сравнению с более широкой семейством GPT. Предприятия обычно используют CometAPI для интеграции всех этих моделей через единый шлюз, обеспечивая доступность 99.9% и мгновенное «переключение» при региональных всплесках задержек у основного провайдера.

Интерактивные приложения в реальном времени

Приложения вроде чат‑ботов поддержки клиентов в реальном времени или мгновенного субтитрирования видео требуют «плавного» ИИ, который ощущается мгновенным. В этой категории Mercury 2 и Gemini 3.1 Flash-Lite — лучшие варианты. Mercury 2 обеспечивает пропускную способность почти в десять раз выше стандартных моделей рассуждений, что делает её идеальной для генерации документов в реальном времени. Gemini 3.1 Flash-Lite предлагает сбалансированные мультимодальные возможности, обрабатывая текст, аудио и изображения в едином контексте примерно в 2.5 раза быстрее, чем ранние поколения, при этом поддерживая окно контекста в 1 миллион токенов.

Окно контекста: от сниппетов до целых репозиториев

Окно контекста работает как «кратковременная память» модели. В 2026 году индустрия разделилась между стандартными окнами (128K) и емкостями уровня репозиториев (1M–10M).

- Llama 4 Scout: 10,000,000 tokens

- Grok 4.20: 2,000,000 tokens

- Gemini 3.1 Pro: Approximately 1,048,576 tokens

- DeepSeek V4 Pro: 1,000,000 tokens

- GPT-5.5 Pro: 1,050,000 tokens

Когда размер контекста имеет значение?

Окно контекста 128K — стандарт для моделей вроде DeepSeek‑V3.2 — стало базовым уровнем для базовых разговорных чатов и суммаризации отдельных статей. Однако профессиональная разработка ПО требует «системного» охвата.

Окно в 1 миллион токенов позволяет ИИ‑агенту «проглотить» весь программный репозиторий, включая исходники, документацию и исторические логи, за один проход. Это предотвращает «дрейф памяти», присущий классическим RAG‑системам, где релевантные данные могут быть упущены при чанкинге. Конкретный пример — рефакторинг кодовой базы: модель с 1M токенов понимает, как изменение в базовой схеме БД влияет на пятьдесят разных API‑эндпоинтов в отдельных файлах, тогда как меньшая модель видит лишь несколько файлов одновременно, что приводит к сломанным зависимостям.

Экономика: цена за 1 миллион токенов

Следующая таблица использует метрику Blended USD/1M Tokens, предполагая соотношение входных к выходным токенам 3:1 для отражения сценариев реального использования.

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Approximately $11.25 | Premium | Скидка 20% |

| Claude Opus 4.7 (max) | Approximately $10.00 | High | Скидка 20% |

| Gemini 3.1 Pro | Approximately $4.50 | Balanced | Скидка 20% |

| Kimi K2.6 | Approximately $1.71 | High-Value | Скидка 20% |

| DeepSeek V4 Pro | Approximately $0.53 | Extreme-Value | Скидка 20% |

| Qwen3.5 0.8B | Approximately $0.02 | Utility | Скидка 20% |

Все тарифы подтверждены по состоянию на май 2026 года. Официальные тарифы вендоров обычно на 20% выше, чем скидочные тарифы , предоставляемые через унифицированные шлюзы.

Стратегия оптимизации затрат

Для поддержки архитектурного планирования мы оценили ежемесячные расходы для трёх типичных уровней роста.

- Небольшая команда разработчиков (10M токенов/месяц): Команды, в основном использующие Kimi K2.6 для разработки фич и DeepSeek V4 Flash для простой логики, увидят ежемесячные затраты на уровне $15–$40. Это позволяет агрессивно прототипировать при финансовой нагрузке не выше стандартной SaaS‑подписки.

- Средний SaaS (100M токенов/месяц): Стартап, масштабирующий платформу автоматизации на основе ИИ с Claude Sonnet 4.6 и Gemini 3.1 Flash, может ожидать ежемесячные расходы $250–$550. Используя кэширование промптов в этих моделях, эффективная стоимость часто снижается ещё на 15%.

- Крупное предприятие (1B токенов/месяц): Глобальные компании, запускающие высококонкурентные агентные пайплайны с GPT-5.5 и Claude Opus 4.7, вероятно, будут тратить $3,000–$6,500 в месяц. В таком масштабе интеграция через единый API‑шлюз становится критичной для централизованного биллинга и избежания накладных расходов на управление отдельными контрактами с множеством вендоров.

Заключение: выберите свой путь в 2026 году

Эпоха «универсальной модели» закончилась. Современная архитектура ИИ требует оркестрации парка специализированных моделей: GPT-5.5 для вычислительно тяжёлых рассуждений, Mercury 2 для интерактивности и DeepSeek V4 для высокообъёмного исполнения. Интегрируясь один раз с CometAPI, разработчики получают переносимость для замены моделей по мере эволюции бенчмарков, одновременно обеспечивая постоянную скидку 20–40% на каждый запрос.

Вопросы и ответы

Какая ИИ‑модель сейчас самая «умная»?

Согласно Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) — самая интеллектуальная доступная модель с оценкой 60. Вслед за ней идут GPT-5.5 (high) с 59 и Claude Opus 4.7 (max) с 57.

Какая модель самая быстрая для приложений реального времени?

Mercury 2 — чемпион скорости 2026 года, обеспечивающий примерно 859.1 tokens/s. Для низкой задержки (TTFT) лидирует NVIDIA Nemotron 3 Nano со временем отклика примерно 0.40s.

Какого значения индекса интеллекта достаточно для продакшен‑агентов?

Для базовой автоматизации или классификации зачастую достаточно оценки 30–40 (как у GPT-5.4 nano). Однако для «Agentic Engineering», где ИИ управляет кодовыми базами или целыми браузерными сессиями, рекомендуется оценка выше 54 (например, Kimi K2.6 или GPT-5.5), чтобы обеспечить согласованность в долгосрочном планировании.

При схожем ценообразовании выбрать GPT-5.5 или Claude Opus 4.7?

Если ваш процесс включает выполнение в терминале и «Vibe Coding», GPT-5.5 обычно превосходит в этих конкретных бенчмарках. Однако если вам нужна предельная консистентность для профессионального письма, юридических исследований или многодневных агентных циклов с низкими галлюцинациями, Claude Opus 4.7 — задокументированный лидер в этих категориях.

Какой фактический разрыв в производительности между open-weights (DeepSeek) и проприетарными моделями?

В 2026 году разрыв сузился примерно до 10–15% в сырых бенчмарках рассуждений. Хотя проприетарные флагманы вроде GPT-5.5 (xhigh) по‑прежнему лидируют в «пиковой» логике (Index 60), модели с открытыми весами, такие как DeepSeek V4 Pro (Index 52) и Kimi K2.6 (Index 54), предоставляют более 85% возможностей примерно за 1/10 стоимости.

Как сократить общие расходы на API для этих моделей?

Использование унифицированного API‑слоя вроде CometAPI позволяет получить доступ ко всему каталогу по ставкам на 20–40% ниже, чем официальные цены вендоров, благодаря оптовым закупкам и интеллектуальной маршрутизации.

У какой модели самый большой контекст для длинных документов?

Llama 4 Scout сейчас поддерживает самое большое окно контекста на рынке — 10 миллионов токенов. За ней следует Grok 4.20 с 2 миллионами токенов, а GPT-5.5 Pro, Gemini 3.1 Pro и DeepSeek V4 Pro поддерживают примерно 1 миллион токенов.

Можно ли протестировать эти бенчмарки без больших стартовых затрат?

Да. Вы можете зарегистрироваться бесплатно на CometAPI, чтобы получить тестовые кредиты без привязки карты и провести сравнительные тесты производительности для более чем 500 моделей во встроенной Playground.