GLM-5-Turbo — это новая базовая LLM от Zhipu AI, специально обученная и настроенная для агентных рабочих процессов (в компании называют целевую экосистему OpenClaw / «lobster»-сценариями). Она предлагает очень длинный контекст (до ~200K токенов), потоковую передачу и структурированные выходы, более низкий уровень ошибок при вызовах инструментов (сообщается о ~0,67% в сторонних тестах) и существенно более низкую цену за токен. Модель стремится обменять небольшую часть пиковой производительности одного шага на значительно лучшую стабильность, надежность инструментов, обработку запланированных/постоянных задач и выполнение длинных цепочек — полезно для автономных агентов, систем оркестрации и мультиинструментальных конвейеров.

What is GLM-5-Turbo?

GLM-5-Turbo представлена Zhipu как фундаментальная модель, изначально созданная для оркестрации агентов и сложных автоматизированных рабочих процессов, а не как универсальная чат- или мультимодальная модель. В проектных решениях сделан акцент на:

- Нативное обучение, дружественное к агентам (использование инструментов, следование командам, задачам с таймингом/персистентностью).

- Очень большие окна контекста и емкость вывода для поддержки длинных сессий, памяти и планирования хода рассуждений.

- Стабильный, высокопроизводительный инференс для длинных бизнес-процессов и запланированных задач.

В отличие от традиционных LLM, оптимизированных под чат или генерацию текста, GLM-5-Turbo:

- Агент-прежде всего (не чат-прежде всего)

- Создана для сред OpenClaw («лобстер»)

- Спроектирована для многошаговых автономных рабочих процессов

🦞 Что означает «Lobster Agent»?

Концепция «lobster» относится к OpenClaw, экосистеме агентного ИИ Zhipu, где модели:

- Динамически используют инструменты

- Исполняют длинные цепочки задач

- Поддерживают постоянную память

- Работают через терминалы, приложения и API

GLM-5-Turbo глубоко оптимизирована под эту парадигму, решая ключевые агентные проблемы, такие как:

- Надежность вызовов инструментов

- Декомпозиция задач

- Долгосрочное планирование

- Стабильность исполнения

Key features and why they matter

Длинный контекст + огромная емкость вывода (200K / 128K)

Окно контекста в 200K токенов и возможность вывода до 128K позволяют GLM-5-Turbo:

- Сохранять расширенную память предыдущего контекста (диалоги, результаты инструментов, промежуточные итоги).

- Генерировать очень длинные артефакты (многоэтапные планы, большие отчеты, кодовые базы) без повторной сборки контекста.

- Поддерживать многотуровых агентов, которым важно сохранять полную историю исполнения для точного принятия решений.

Это осознанный технический выбор для агентов: вместо разбиения задач на короткие подсказки агенты могут поддерживать согласованное состояние на протяжении тысяч ходов или шагов.

Агентные примитивы заложены в обучение

Вместо доработки универсальной модели под агентные задачи GLM-5-Turbo обучалась с агентными целями (например, поведение при вызове инструментов, парсинг команд/аргументов). Заявленный эффект — меньше галлюцинаций при вызовах инструментов, более стабильные многошаговые планы и сниженная задержка на длинных прогонах — все это ценно там, где автоматизация должна надежно связывать множество внешних API или инструментов.

Пропускная способность и стабильность исполнения

Вариант GLM-5-Turbo улучшает стабильность исполнения и пропускную способность для длинных бизнес-процессов по сравнению с обобщенными крупными моделями — в маркетинговых материалах подчеркиваются «высокопроизводительное исполнение» и «ведущая стабильность отклика» среди аналогов. Для корпоративных агентных внедрений это критично: сбой одного шага может разорвать весь конвейер. Независимые сторонние бенчмарки все еще появляются.

Benchmark data of GLM-5-Turbo

Примечание: Zhipu опубликовала внутренние оценки, и для GLM-5 доступны сторонние/академические бенчмарки. GLM-5-Turbo только что выпущена; независимым запускам в сообществе потребуется время. Ниже приводим наиболее обоснованные, опубликованные цифры и контекст.

GLM-5 (референс) — репрезентативные опубликованные метрики

GLM-5 (флагман-предшественник Turbo) показывает высокие позиции в задачах инженерии/рабочих процессов, например:

- SWE-bench Verified: 77.8 (в документации GLM-5 заявлен лидирующий результат среди открытых моделей).

- Terminal Bench 2.0: 56.2 (заявлена топовая производительность среди открытых моделей на данной выборке).

Эти показатели закрепляют GLM-5 как высокий базовый уровень в разработке ПО и задачах исполнения; GLM-5-Turbo позиционируется как обмен части «сырых» параметров/размера на лучшую надежность агента и пропускную способность. В их сравнительных прогонах у GLM-5-Turbo зафиксирована ~0,67% ошибка вызова инструментов, существенно ниже, чем у сравниваемых провайдеров GLM-5 (диапазон ~2,33%–6,41%).

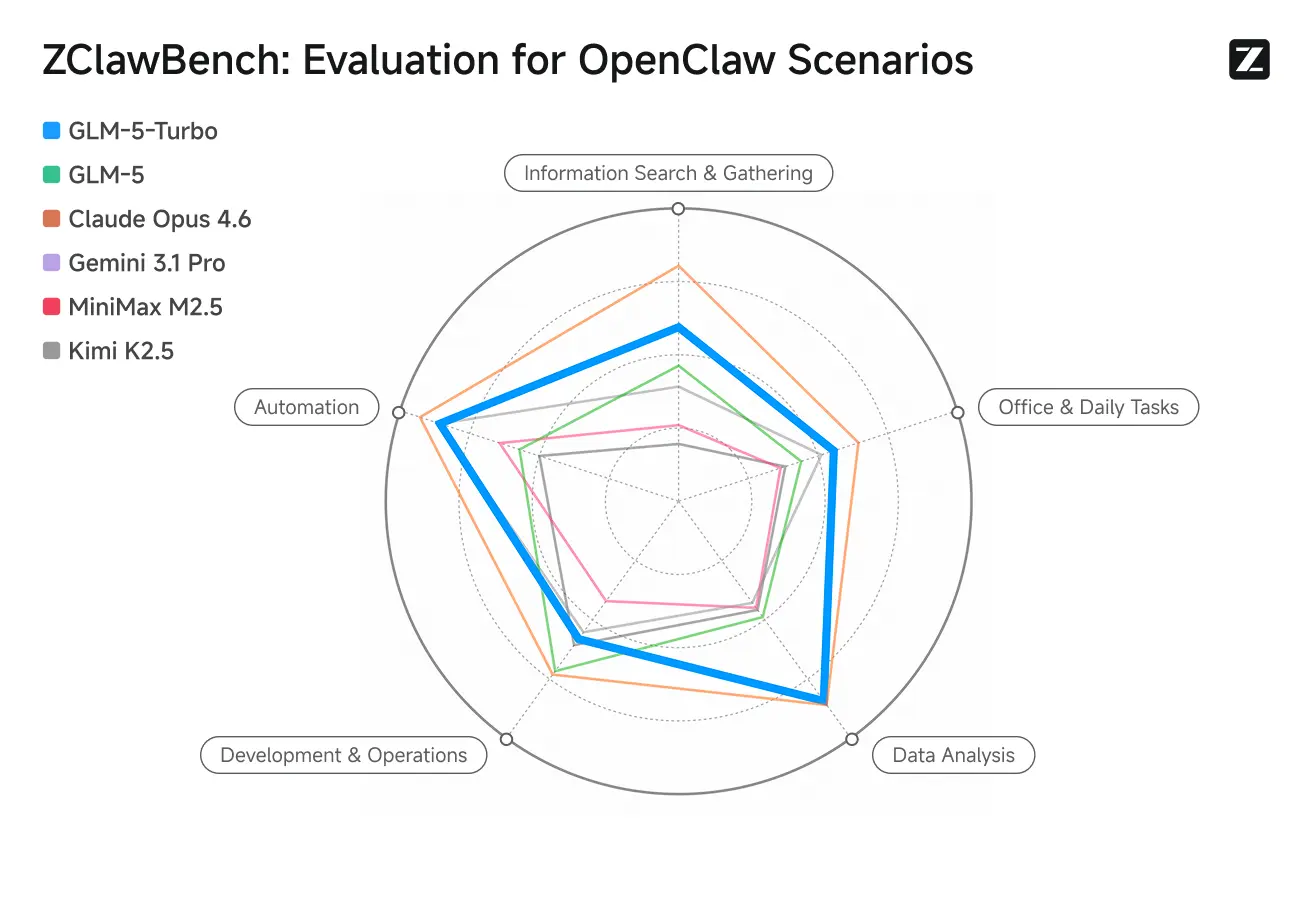

ZClawBench: тестовый бенчмарк для прокси-сценариев OpenClaw

Zhipu также выпустила бенчмарк ZClawBench для оценки интеллектуальных агентов. В слепых тестах, охватывающих такие области, как разработка кода, анализ данных и создание контента, новая модель с кодовым именем Pony-Alpha-2 получила предпочтение у 90% респондентов.

Pricing & availability (who sells it and how much)

Zhipu внедрила ~20% повышение цены API для GLM-5-Turbo при запуске и одновременно представила абонементы «Lobster Package», призванные сгладить стоимость токенов для агентных внедрений.

Заявленные тарифные уровни (пример пакетов)

Два иллюстративных пакета Lobster (цены — приблизительные пересчеты):

- Entry Lobster plan:

39 CNY / месяц (US$5.66) за 35,000,000 токенов. - Mid Lobster plan:

99 CNY / месяц (US$14.36) за 100,000,000 токенов.

Исходя из опубликованных чисел, стоимость за 1 миллион токенов примерно:

- Entry plan: ~US$0.162 за 1M токенов.

- Mid plan: ~US$0.144 за 1M токенов.

Эти показатели «за 1M» — простой пересчет стоимости подписки и лимита токенов и иллюстрируют экономику для высокообъемных агентных нагрузок. (Расчеты основаны на курсах и объемах токенов из новостей.)

API Price

Репрезентативный маркетплейс (CometAPI) указывает: $0.96 за 1M входных токенов и $3.20 за 1M выходных токенов для GLM-5-Turbo.

Собственная страница цен для разработчиков Zhipu (Z.ai) показывает немного более высокую прямую ставку для GLM-5-Turbo: $1.20 за 1M входных токенов и $4.00 за 1M выходных токенов (ставки для кэшируемого ввода ниже).

GLM-5-Turbo vs GLM-5 — side-by-side comparison

В общих чертах:

- GLM-5 = флагманская универсальная базовая модель (сильное рассуждение, код, бенчмарки)

- GLM-5-Turbo = агент-оптимизированный вариант GLM-5 (фокус на длинные рабочие процессы, инструменты, стабильность)

GLM-5-Turbo — это не полностью новая архитектура, а специализированная, производственно-оптимизированная версия GLM-5, созданная для агентных систем, таких как OpenClaw.

Core positioning

| Model | Positioning |

|---|---|

| GLM-5 | Универсальная флагманская LLM (рассуждение, программирование, бенчмарки) |

| GLM-5-Turbo | Модель с приоритетом на агентов (автоматизация, оркестрация, использование инструментов) |

👉 Проще говоря:

- Используйте GLM-5 → когда вам нужна максимальная «интеллектуальность»

- Используйте GLM-5-Turbo → когда вам нужна стабильная автоматизация / агенты

Agent capability comparison (САМОЕ ВАЖНОЕ)

GLM-5 (агентные возможности) уже поддерживает:

- Использование инструментов

- Многошаговое рассуждение

- Кодирующие агенты

Но есть ограничения:

- Может терять контекст в длинных цепочках

- Вызовы инструментов могут деградировать со временем

- Требуется больше логики оркестрации

GLM-5-Turbo явно оптимизирована под агентов:

Ключевые улучшения:

- Надежность вызовов инструментов ↑

- Декомпозиция задач (планирование) ↑

- Согласованность на длинных цепочках ↑

- Поддержка устойчивого исполнения ↑

Пример улучшения:

- Стабильное исполнение на протяжении 10+ шагов без потери контекста

👉 Это критично для:

- Систем в стиле AutoGPT

- Многоагентных рабочих процессов

- Автоматизации SaaS

Speed & efficiency

| Aspect | GLM-5 | GLM-5-Turbo |

|---|---|---|

| Inference speed | Умеренная | Быстрее |

| Throughput | Стандартная | Выше |

| Long-task latency | Может ухудшаться | Оптимизирована |

GLM-5-Turbo призвана решить реальную отраслевую проблему:

Крупные модели замедляются или «ломаются» в ходе длинных рабочих процессов

Pricing comparison

| Model | Input ($/1M tokens) | Output ($/1M tokens) |

|---|---|---|

| GLM-5 | ~$1.00 | ~$3.20 |

| GLM-5-Turbo | ~$1.20 | ~$4.00 |

👉 GLM-5-Turbo дороже (~на 20%)

Почему дороже?

Потому что обеспечивает:

- Лучшую надежность оркестрации

- Более высокую стабильность в продакшене

- Специализированные оптимизации под агентов

👉 В корпоративной среде:

- Вы платите больше за токен

- Но снижаете стоимость сбоев и повторов

| Attribute | GLM-5 | GLM-5-Turbo |

|---|---|---|

| Primary goal | Флагманская универсальная базовая модель (широкие возможности, сильное программирование/бенчмарки) | Агентная/«OpenClaw»/оптимизированная под «lobster» базовая модель |

| Context window | (сообщается о большом; GLM-5 ориентируется на ~200K (GLM-5 также поддерживает длинный контекст) | 200,000 токенов (явно задокументировано). |

| Maximum output tokens | (большое, зависит от модели) | 128,000 токенов (задокументировано). |

| Notable benchmark scores | SWE-bench: 77.8; Terminal Bench 2.0: 56.2 (заявленные числа для GLM-5). | Внутренние оценки утверждают улучшенную стабильность на длинных цепочках и пропускную способность для агентных рабочих процессов; независимые публичные бенчмарки в ожидании. |

| Modalities | Текст (основной), семейство GLM имеет визионные варианты в родственных моделях | Только текст (по документации) — оптимизирована для агентов, работающих с инструментами. |

| Recommended use cases | Широкие: чат, код, рассуждение, контент | Оркестрация агентов, вызов инструментов, долгосрочная автоматизация |

| Pricing | Действующие цены GLM-5 (зависят от плана) | Новый релиз — заявлено ~20% повышение цены API; введены новые подписки Lobster |

How to use GLM-5-Turbo

CometAPI — единый API-доступ ко многим моделям (совместим с OpenAI)

CometAPI указывает доступность GLM-5-Turbo и предоставляет совместимый с OpenAI базовый URL и SDK. Используйте строку модели, опубликованную ими (на их сайте для GLM-5-Turbo указаны сопоставимые цены). Примеры адаптированы из документации CometAPI:

curl (CometAPI):

curl -X POST "https://api.cometapi.com/v1/chat/completions" \ -H "Authorization: Bearer YOUR_COMETAPI_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "z-glm-5-turbo", // или используйте точный slug модели, указанный в интерфейсе CometAPI "messages": [{"role":"user","content":"Создай 5-шаговый чек-лист для онбординга нового сотрудника."}], "max_tokens": 800 }'

Ценность CometAPI — удобство агрегатора (единая интеграция для множества моделей). Подтвердите точный slug модели в панели CometAPI перед вызовом.

Best practices when building Lobster / OpenClaw agents with GLM-5-Turbo

- Проектируйте под надежность, а не под минимальную задержку: Преимущество Turbo — более низкая частота ошибок вызовов инструментов в длинных цепочках. Структурируйте прогоны агента в пользу надежных ответов (ретраи, идемпотентные вызовы инструментов), а не незначительного выигрыша в первом токене.

- Используйте стриминг и инкрементальные вызовы инструментов: Применяйте потоковые/поштучные ответы, чтобы уменьшить переработку и позволить ранние вызовы инструментов там, где это уместно. GLM-5-Turbo поддерживает стриминг.

- Структурированные выходы для парсеров: Отдавайте предпочтение JSON или хорошо отформатированным результатам для детерминированного последующего парсинга инструментами. Turbo поддерживает структурированные выходы.

- Планируйте расписание/персистентность: Если вашему агенту нужно периодически проверять или запускать фоновые задачи, используйте улучшенные временные семантики и функции кэширования Turbo, чтобы не перепланировать каждый цикл.

- Инструментируйте вызовы инструментов и резервные сценарии: Логируйте вызовы и проектируйте корректные фоллбеки (например, повтор с немного измененной температурой или вызов резервного инструмента), поскольку агентные конвейеры хрупки, если один внешний API дает сбой. Turbo снижает уровень ошибок, но не устраняет внешние откази.

Разработчики уже могут получить доступ к API GLM-5 и GLM-5 Turbo через CometAPI. Для начала обратитесь к руководству по API за подробными инструкциями. Перед доступом убедитесь, что вы вошли в CometAPI и получили ключ API. CometAPI предлагает цену значительно ниже официальной, чтобы помочь вам с интеграцией.

Готовы начать?→ Зарегистрируйтесь для доступа к GLM-5 и GLM-5 Turbo сегодня !