Kısa Cevap: Geliştiriciler 2026'da hangi yapay zeka modeline öncelik vermeli?

Maksimum otonom akıl yürütme ve minimum halüsinasyon gerektiren görevler için geliştiriciler, Zekâ Endeksi 60 ile pazara liderlik eden GPT-5.5 (xhigh) modelini seçmelidir. Gerçek zamanlı etkileşim gerektiren uygulamalar için, yaklaşık 859 token/saniye hızla mevcut hız lideri olan Mercury 2 tercih edilmelidir. Bütçenin birincil kısıt olduğu büyük ölçekli üretimde ise DeepSeek V4 Pro ve Kimi K2.6, amiral gemisi kapalı modellerin maliyetinin yaklaşık %10’u ile sınır düzeyine yakın zekâ sunar.

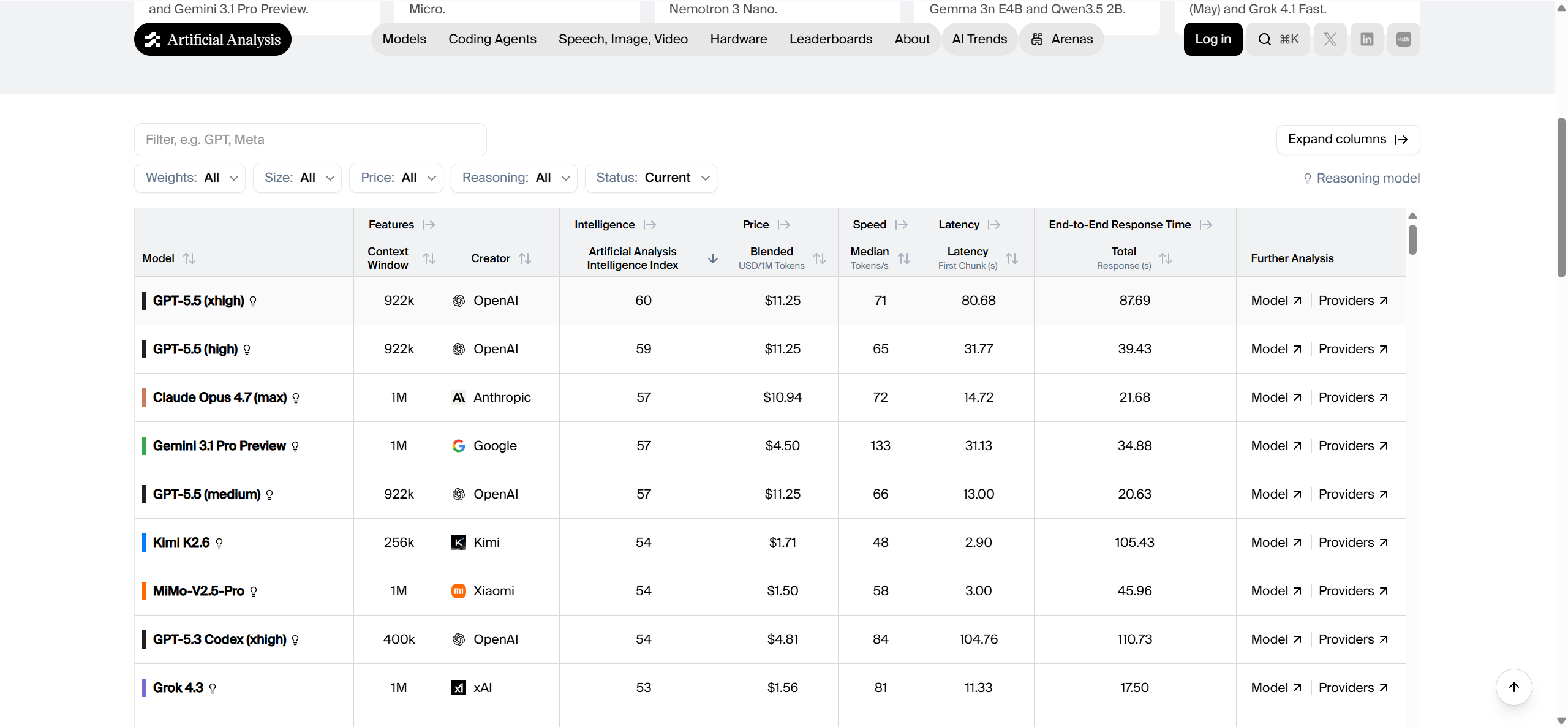

Zekâ Endeksi: Sınır Modellerin Sıralaması

2026’daki yapay zeka manzarası, parametre sayısını kovalamaktan “düşünme” yoğunluğunu optimize etmeye kaydı. Artificial Analysis Intelligence Index v4.0, profesyonel düzeyde kodlama ve aşırı mantıksal çıkarım dahil on uzmanlaşmış boyutta model yeteneğini nicelleştiren sektör standardıdır.

| Model | Zekâ Endeksi | Bağlam Penceresi | En İyi Kullanım Senaryosu |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Bilimsel araştırma ve mantık |

| GPT-5.5 (high) | 59 | 922K | Profesyonel düzeyde kodlama |

| Claude Opus 4.7 (max) | 57 | 1M | Otonom ajanlar ve planlama |

| Gemini 3.1 Pro | 57 | 1M - 2M | Çok modlu veri sentezi |

| Kimi K2.6 | 54 | 256K | Terminal odaklı ajan iş akışları |

| MiMo-V2.5-Pro | 54 | 1M | Uçtan uca yazılım mühendisliği |

| DeepSeek V4 Pro (Max) | 52 | 1M | Ölçeklenebilir akıl yürütme iş akışları |

| GLM-5.1 | 51 | 200K | Uzun ufuklu otonom görevler |

Bu tablo nasıl okunur

İlk beş modelin üçü GPT-5.5 modelleridir, GPT-5.5 Medium, Claude Opus 4.7 ve Gemini 3.1 Pro. Bu üç Batılı amiral gemisi model başa baş ilerlerken, iki Çinli model olan Kimi K2 ve mimo-v2.5 pro, son derece rekabetçi fiyatlarla Batılı üst düzey modellere yakın performans sunar.

Artificial Analysis Intelligence Index, Terminal-Bench Hard ve IFBench gibi bağımsız değerlendirmelerden türetilmiş normalize bir metriktir. Tek puanlık fark, bir modelin “özerklik eşiği”nde istatistiksel olarak anlamlı bir boşluğu temsil eder. Örneğin, GPT-5.5 (60) ile Claude Opus 4.7 (57) arasındaki 3 puanlık fark, çoğu zaman her birkaç adımda insan müdahalesi gerektiren bir model ile karmaşık bir mantık zincirini bağımsız olarak tamamlayabilen bir model arasındaki fark anlamına gelir. Daha yüksek bir endeks puanı genellikle “Humanity’s Last Exam”de daha yüksek başarı oranları ve ajan ortamlarında daha az araç çağırma hatasıyla ilişkilidir.

Refleksler: Gecikme ve Üretim Hızı

Etkileşimli yazılımlar için—canlı IDE asistanlarından müşteri odaklı sesli ajanlara kadar—ham zekâ, Time to First Token (TTFT) ve Generation Throughput’un gerisinde kalır.

En hızlı 5 model (throughput)

Throughput, modelin ilk işlem aşamasından sonra metni üretme hızını ölçer. Yüksek throughput, uzun biçimli içerik üretimi ve hızlı kod yeniden düzenleme için kritiktir.

- Mercury 2: Yaklaşık 859 token/sn

- Granite 4.0 H Small: Yaklaşık 407 token/sn

- Granite 3.3 8B: Yaklaşık 365 token/sn

- Gemini 3.1 Flash-Lite**** : Yaklaşık 331 token/sn

- Qwen3.5 0.8B: Yaklaşık 287 token/sn

En düşük gecikmeli 5 model (TTFT)

Gecikme, ilk token’ın kullanıcıya ulaşmasından önceki beklemeyi gösterir. Bu, UI/UX’te “vibe” ve algılanan duyarlılık için kritik metriktir.

- NVIDIA Nemotron 3 Nano: Yaklaşık 0.40 sn

- Ministral 3 3B: Yaklaşık 0.47 sn

- Qwen3.5 0.8B: Yaklaşık 0.52 sn

- LFM2 24B A2B: Yaklaşık 0.55 sn

- Grok 3 mini Reasoning: Yaklaşık 0.58 sn

2026'da Modelinizi Nasıl Seçersiniz

Bir model seçmek, “dolar başına zekâ” oranını uygulamanızın özgül çalışma süresi gereksinimleriyle dengelemeyi gerektirir. 2026’da pazar, üç farklı mimari yola ayrılmış durumdadır.

Bağımsız geliştiriciler ve bütçe duyarlı ekipler

Binlerce deneysel ajan döngüsü çalıştıran tek başına geliştiriciler veya küçük ekipler için DeepSeek V4 Pro en uygun stratejik seçimdir. Token başına yalnızca 49B parametrenin etkinleştiği devasa 1.6T parametreli bir Mixture-of-Experts (MoE) mimarisi kullanır; bu sayede yaklaşık $0.416/milyon token maliyetle amiral gemisi performansı sunar. Kodlamaya özel görevler için bir diğer mükemmel seçenek ise terminal öncelikli iş akışlarında uzmanlaşan Kimi K2.6’dır. Bu modeller, premium modellere kıyasla yaklaşık %70-80 daha ucuza, yeteneğin yaklaşık %90’ını sunarak bir girişimin süresini etkin biçimde uzatır.

Kurumsal üretim ortamları

Stabilitenin ve karmaşık sistem komutlarına (prompt) uyumun pazarlık konusu olmadığı şirket çapındaki dağıtımlar için sektör standardı hâlâ GPT-5.5 Pro ve Claude Opus 4.7’dir. GPT-5.5 Pro, yüksek riskli hassasiyet için tasarlanmıştır; hata maliyetinin API çağrısı maliyetinden yüksek olduğu yatırım bankacılığı modelleme ve bilimsel keşif gibi alanlarda öne çıkar. Claude Opus 4.7 ise çok günlük projelerde sürdürülebilir güvenilirliğe ihtiyaç duyan ekipler tarafından tercih edilir; zira terminal ortamlarında daha geniş GPT ailesine kıyasla anlamlı ölçüde daha düşük halüsinasyon oranı sergiler. Kurumlar genellikle bu modelleri tek bir ağ geçidi üzerinden entegre etmek için CometAPI kullanır; bu sayede birincil sağlayıcı bölgesel gecikme artışları yaşadığında anında geçiş ile birlikte 99.9% çalışma süresi sağlanır.

Gerçek zamanlı etkileşimli uygulamalar

Gerçek zamanlı müşteri destek botları veya anlık video altyazılama gibi uygulamalar, anında hissedilen “akışkan” bir yapay zeka gerektirir. Bu kategoride Mercury 2 ve Gemini 3.1 Flash-Lite üstün seçeneklerdir. Mercury 2, standart akıl yürütme modellerinden neredeyse on kat daha yüksek throughput sunarak gerçek zamanlı doküman taslağı çıkarmak için idealdir. Gemini 3.1 Flash-Lite ise yaklaşık 2.5 kat daha yüksek hızda metin, ses ve görselleri tek bir bağlamda işleyen dengeli bir çok modlu yetenek sağlar ve 1 milyon token’lık bağlam penceresini destekler.

Bağlam Penceresi: Parçalardan Tüm Depolara

Bağlam penceresi, modelin “kısa süreli belleği” gibi davranır. 2026’da sektör, standart pencereler (128K) ile depo ölçeğinde kapasiteler (1M-10M) arasında ikiye bölünmüştür.

- Llama 4 Scout: 10,000,000 token

- Grok 4.20: 2,000,000 token

- Gemini 3.1 Pro: Yaklaşık 1,048,576 token

- DeepSeek V4 Pro: 1,000,000 token

- GPT-5.5 Pro: 1,050,000 token

Bağlam boyutu ne zaman önemlidir?

128K bağlam penceresi—DeepSeek-V3.2 gibi modeller için standart—artık temel sohbet ve tekil makalelerin özetlenmesi için taban çizgisidir. Ancak profesyonel yazılım mühendisliği “bütün-sistem” farkındalığı gerektirir.

1 milyon token’lık bir pencere, bir yapay zeka ajanının tek bir ileri geçişte tüm yazılım deposunu; tüm kaynak dosyaları, dokümantasyon ve tarihsel günlükler dahil, içselleştirmesini sağlar. Bu, geleneksel RAG sistemlerinde parçalara bölme sırasında ilgili verinin kaçırılmasından kaynaklanan “hafıza kaymasını” önler. Somut bir örnek olarak kod tabanı refaktörü: 1M token bağlamlı bir model, çekirdek veritabanı şemasındaki bir değişikliğin ayrı dosyalardaki elli farklı API uç noktasını nasıl etkilediğini anlayabilir; daha küçük bir model ise aynı anda yalnızca birkaç dosyayı “görebildiği” için bozuk bağımlılıklara yol açabilir.

Ekonomik Karşılaştırma: 1 Milyon Token Başına Birim Fiyat

Aşağıdaki tablo, gerçek kullanım kalıplarını yansıtmak üzere 3:1 girdi:çıktı token oranını varsayan Harmanlanmış USD/1M Token metriğini kullanır.

| Model | Harmanlanmış Fiyat (1M başına) | Göreli Değer | CometAPI ile İndirim |

|---|---|---|---|

| GPT-5.5 (xhigh) | Yaklaşık $11.25 | Premium | 20% İNDİRİM |

| Claude Opus 4.7 (max) | Yaklaşık $10.00 | Yüksek | 20% İNDİRİM |

| Gemini 3.1 Pro | Yaklaşık $4.50 | Dengeli | 20% İNDİRİM |

| Kimi K2.6 | Yaklaşık $1.71 | Yüksek Değer | 20% İNDİRİM |

| DeepSeek V4 Pro | Yaklaşık $0.53 | Çok Yüksek Değer | 20% İNDİRİM |

| Qwen3.5 0.8B | Yaklaşık $0.02 | Temel | 20% İNDİRİM |

Tüm oranlar Mayıs 2026 itibarıyla doğrulanmıştır. Resmi satıcı oranları genellikle birleşik ağ geçitleri üzerinden sunulan indirimli fiyatlardan tipik olarak %20 daha yüksektir.

Maliyet Optimizasyon Stratejisi

Mimari planlamayı desteklemek için, üç yaygın büyüme kademesi için aylık harcamaları tahmin ettik.

- Küçük geliştirici ekibi (ayda 10M token): Özellik geliştirmede ağırlıklı olarak Kimi K2.6 ve basit mantık için DeepSeek V4 Flash kullanan ekipler, aylık $15 ila $40 aralığında harcama görecektir. Bu, standart bir SaaS aboneliğinden daha büyük olmayan bir mali yükle agresif prototiplemeye olanak tanır.

- Orta ölçekli SaaS (ayda 100M token): Claude Sonnet 4.6 ve Gemini 3.1 Flash kullanan, ölçeklenen bir yapay zeka destekli otomasyon platformu ayda $250 ile $550 arası maliyet bekleyebilir. Bu modellerde mevcut prompt önbellekleme kullanılarak, efektif maliyet genellikle ek %15 düşer.

- Büyük işletme (ayda 1B token): GPT-5.5 ve Claude Opus 4.7 ile yüksek eşzamanlı ajan iş akışları yürüten küresel firmalar, aylık $3,000 ile $6,500 arası harcama yapacaktır. Bu ölçekte, birleşik bir API ağ geçidi üzerinden entegrasyon; merkezi faturalama ve çoklu sağlayıcıyla ayrı sözleşmeleri yönetme yükünden kaçınmak için kritik hâle gelir.

Sonuç: 2026'da Yolunu Seç

“Her işe yarar model” dönemi bitti. Modern yapay zeka mimarisi, uzmanlaşmış bir model filosunu orkestre etmeyi gerektirir: yüksek hesaplama gerektiren akıl yürütme için GPT-5.5, etkileşim için Mercury 2 ve yüksek hacimli icra için DeepSeek V4. CometAPI ile tek seferlik entegrasyon sayesinde geliştiriciler, kıyaslamalar evrildikçe modelleri değiştirme taşınabilirliği kazanır ve her istekte kalıcı %20-40 indirim elde eder.

SSS

Şu anda en zeki yapay zeka modeli hangisi?

Artificial Analysis Intelligence Index v4.0’a göre, GPT-5.5 (xhigh) şu anda 60 puanla en zeki modeldir. Bunu 59 puanla GPT-5.5 (high) ve 57 puanla Claude Opus 4.7 (max) yakından takip eder.

Gerçek zamanlı uygulamalar için en hızlı yapay zeka modeli hangisi?

Mercury 2, yaklaşık 859.1 token/saniye çıktıyla 2026’nın hız şampiyonudur. Düşük gecikme (TTFT) için, yaklaşık 0.40 saniyelik yanıt süresiyle NVIDIA Nemotron 3 Nano liderdir.

Üretim ajanları için Zekâ Endeksi puanı ne kadar yüksek olmalı?

Temel otomasyon veya sınıflandırma için 30 ile 40 arasındaki bir puan (ör. GPT-5.4 nano) çoğu zaman yeterlidir. Ancak yapay zekanın kod tabanlarını veya tüm tarayıcı oturumlarını yönettiği “Agentic Engineering” için, uzun ufuklu planlamada tutarlılık sağlamak adına 54’ün üzerindeki bir puan (ör. Kimi K2.6 veya GPT-5.5) önerilir.

Fiyatlar benzerken GPT-5.5 mi yoksa Claude Opus 4.7 mi seçilmeli?

İş akışınız terminal yürütme ve “Vibe Coding” içeriyorsa, GPT-5.5 genellikle bu özel kıyaslarda üstün gelir. Ancak profesyonel yazım, hukuk araştırması veya düşük halüsinasyon oranıyla çok günlük ajan döngüleri gibi aşırı tutarlılık gerektiren durumlarda Claude Opus 4.7 belgelenmiş liderdir.

Açık ağırlıklar (DeepSeek) ile kapalı modeller arasındaki gerçek performans farkı nedir?

2026’da, ham akıl yürütme kıyaslarında fark yaklaşık %10-15’e düşmüştür. GPT-5.5 (xhigh) (Endeks 60) gibi kapalı amiral gemileri hâlâ “zirve” mantıkta önde olsa da, DeepSeek V4 Pro (Endeks 52) ve Kimi K2.6 (Endeks 54) gibi açık ağırlık modelleri, kabaca 1/10 maliyetle yeteneğin %85’inden fazlasını sunar.

Bu modeller için toplam API maliyetimi nasıl azaltabilirim?

CometAPI gibi birleşik bir API katmanı kullanmak, toplu satın alma ve akıllı yol yönlendirme sayesinde resmi satıcı fiyatlarından %20 ila %40 daha düşük oranlarla tüm kataloğa erişmenizi sağlar.

Uzun dokümanlar için en büyük bağlam penceresine hangi model sahip?

Pazardaki en büyük bağlam penceresi şu anda Llama 4 Scout’ta, 10 milyon token ile mevcuttur. Grok 4.20 2 milyon token ile onu takip ederken, GPT-5.5 Pro, Gemini 3.1 Pro ve DeepSeek V4 Pro yaklaşık 1 milyon token’ı destekler.

Yüksek başlangıç maliyeti olmadan bu kıyasları test etmenin bir yolu var mı?

Evet. CometAPI üzerinde ücretsiz bir hesap açarak kredi kartı gerekmeksizin deneme kredileri alabilir; yerleşik Playground’da 500’den fazla model arasında karşılaştırmalı performans testleri çalıştırabilirsiniz.