GLM-5-Turbo, Zhipu AI tarafından özellikle ajan tarzı iş akışları için eğitilmiş ve ayarlanmış yeni bir temel LLM’dir (şirket hedef ekosistemi OpenClaw / “lobster” senaryoları olarak adlandırır). Çok uzun bir bağlam (yaklaşık ~200K token’a kadar), akış (streaming) ve yapılandırılmış çıktılar, daha düşük araç çağrısı hata oranları (üçüncü taraf testlerde bildirilen ~%0,67) ve anlamlı ölçüde daha düşük token başı fiyatlandırma sunar. Model, çok daha iyi kararlılık, araç güvenilirliği, zamanlanmış/kalıcı görev işleme ve uzun zincir yürütme için, en yüksek tek tur veriminin küçük bir kısmını takas etmeyi hedefler — otonom ajanlar, orkestrasyon sistemleri ve çoklu araç boru hatları için kullanışlıdır.

GLM-5-Turbo nedir?

GLM-5-Turbo, Zhipu tarafından genel sohbet veya çok modlu bir modelden ziyade, ajan orkestrasyonu ve karmaşık otomatik iş akışları için amaçlanmış bir temel model olarak sunuluyor. Tasarım tercihleri şunları vurgular:

- Yerel ajan-dostu eğitim (araç kullanımı, komut takibi, zamanlı/kalıcı görevler).

- Uzun oturumlar, bellek ve düşünme zinciri planlaması için çok büyük bağlam pencereleri ve çıktı kapasitesi.

- Uzun iş akışları ve zamanlanmış görevler için kararlı, yüksek verimli çıkarım.

Sohbet veya metin üretimi için optimize edilmiş geleneksel LLM’lerden farklı olarak, GLM-5-Turbo:

- Ajan-öncelikli (sohbet-öncelikli değil)

- OpenClaw (“lobster”) ortamları için inşa edilmiş

- Çok adımlı otonom iş akışları için tasarlanmış

🦞 “Lobster Agent” ne anlama gelir?

“Lobster” kavramı, modellerin:

- Araçları dinamik biçimde kullandığı,

- Uzun görev zincirleri yürüttüğü,

- Kalıcı belleği koruduğu,

- Terminaller, uygulamalar ve API’ler arasında çalıştığı

Zhipu’nun OpenClaw adlı yapay zekâ ajan ekosistemine atıfta bulunur.

GLM-5-Turbo, bu paradigma için derinlemesine optimize edilmiştir ve aşağıdaki temel ajan sorunlarını çözer:

- Araç çağrısı güvenilirliği

- Görev ayrıştırma

- Uzun ufuklu planlama

- Yürütme kararlılığı

Temel özellikler ve neden önemli

Uzun bağlam + büyük çıktı kapasitesi (200K / 128K)

200K token’lık bağlam penceresi ve 128K çıktı yeteneği, GLM-5-Turbo’nun şunları yapmasına olanak tanır:

- Önceki bağlamın (konuşmalar, araç çıktıları, ara sonuçlar) genişletilmiş belleğini korumak.

- Tekrarlanan bağlam birleştirmeleri olmadan çok uzun üretilmiş eserler (çok aşamalı planlar, uzun raporlar, kod tabanları) üretmek.

- Doğru karar alma için tam yürütme geçmişini koruması gereken çok turlu ajanlara ev sahipliği yapmak.

Bu, ajanlar için kasıtlı bir teknik seçimdir — görevleri kısa istemlere bölmek yerine, ajanlar binlerce konuşma turu veya adım boyunca tutarlı durumu koruyabilir.

Ajan temel ögeleri eğitime gömülü

Genel amaçlı bir modeli ajan görevlerine sonradan uydurmak yerine, GLM-5-Turbo ajan tarzı hedeflerle (ör. araç çağırma davranışı, komut/argüman ayrıştırma) eğitildi. İddia edilen etki, araç çağrılarında daha az halüsinasyon, daha kararlı çok adımlı planlar ve uzun çalışmalarda iyileştirilmiş gecikme — çok sayıda harici API veya aracı güvenilir şekilde zincirlemesi gereken otomasyonlar için değerli.

İşlem hacmi ve yürütme kararlılığı

GLM-5-Turbo varyantı, genelleştirilmiş büyük modellere kıyasla uzun iş akışlarında yürütme kararlılığını ve işlem hacmini iyileştirir — pazarlama dili, benzer modeller arasında “yüksek işlem hacimli yürütme” ve “önde gelen yanıt kararlılığı”nı vurgular. Bunlar, tek bir adımın tüm boru hattını bozabileceği kurumsal ajan dağıtımları için anlamlıdır. Bağımsız üçüncü taraf kıyaslamaları hâlâ oluşmaktadır.

GLM-5-Turbo’nun karşılaştırma verileri

Not: Zhipu dahili değerlendirmeler yayımladı ve GLM-5 için üçüncü taraf/akademik karşılaştırmalar mevcut. GLM-5-Turbo yeni yayımlandı; bağımsız topluluk kıyaslamalarının görünmesi zaman alacaktır. Aşağıda en savunulabilir, yayımlanmış rakamları ve bağlamı listeliyoruz.

GLM-5 (referans) — yayımlanan temsili ölçümler

Zhipu’nun GLM-5’i (Turbo’nun amiral gemisi öncülü), birçok mühendislik/iş akışı görevinde güçlü sıralamalar bildiriyor — örneğin:

- SWE-bench Verified: 77.8 (GLM-5 dokümantasyonunda önde gelen açık model skoru olarak raporlanmıştır).

- Terminal Bench 2.0: 56.2 (ilgili dağıtımda en üst açık model performansı olarak raporlanmıştır).

Bu rakamlar, GLM-5’i yazılım mühendisliği ve yürütme görevlerinde yüksek bir başlangıç noktası olarak konumlandırır; GLM-5-Turbo ise ham boyut/parametre vurgusunun bir kısmını daha iyi ajan güvenilirliği ve işlem hacmi için takas etmeye konumlandırılmıştır. GLM-5-Turbo, karşılaştırma çalışmalarında ~%0,67 araç çağrısı hatası göstermiştir; bu, ~%2,33 ila %6,41 aralığındaki karşılaştırmalı GLM-5 sağlayıcı koşularından anlamlı ölçüde düşüktür.

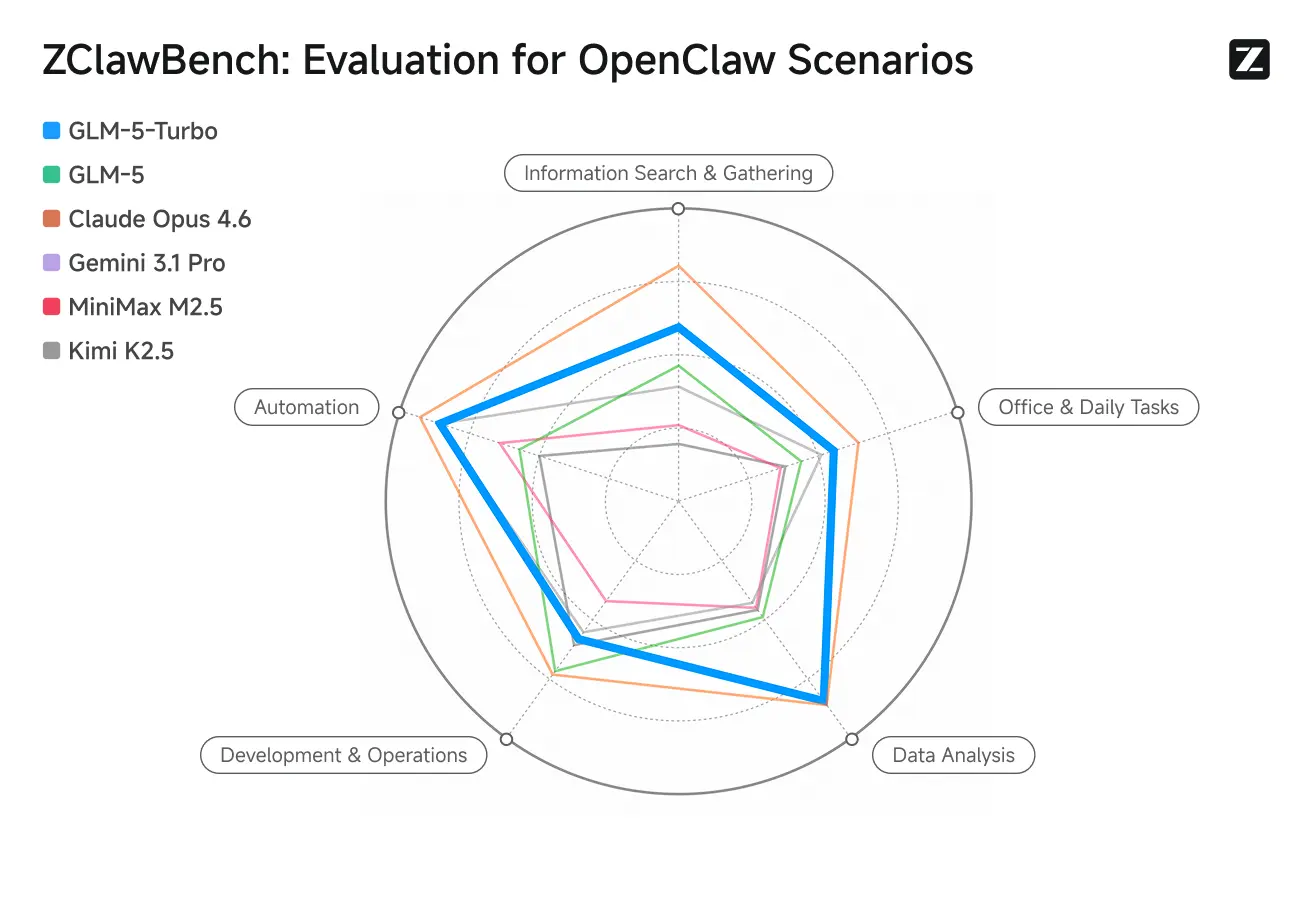

ZClawBench: OpenClaw Proxy Senaryoları için Karşılaştırma Testi

Zhipu ayrıca akıllı ajanları değerlendirmek için ZClawBench karşılaştırmasını yayımladı. Kod geliştirme, veri analizi ve içerik oluşturma gibi farklı alanları kapsayan kör testlerde, Pony-Alpha-2 kod adlı yeni model katılımcıların %90’ının beğenisini kazandı.

Fiyatlandırma ve erişilebilirlik (kim satıyor ve fiyatı ne kadar)

Zhipu, GLM-5-Turbo sunumu için ~%20 API fiyat artışı uyguladı ve eşzamanlı olarak ajan dağıtımlarında token fiyatlandırmasını düzleştirmeyi amaçlayan “Lobster Package” abonelik kademelerini tanıttı.

Bildirilen abonelik kademeleri (örnek paketler)

İki örnek Lobster paketi (fiyatlar çevrim ve yaklaşık değerlerdir):

- Entry Lobster planı: ayda ~39 CNY (~5,66 ABD$) karşılığında 35.000.000 token.

- Mid Lobster planı: ayda ~99 CNY (~14,36 ABD$) karşılığında 100.000.000 token.

Bu yayımlanan sayılar kullanıldığında, 1 milyon token başına maliyet yaklaşık olarak:

- Entry plan: ~1M token başına 0,162 ABD$.

- Mid plan: ~1M token başına 0,144 ABD$.

Bu 1M başına rakamlar, yayımlanan abonelik maliyetinin ve token üst sınırının basit dönüştürmeleridir ve yüksek hacimli ajan iş yükleri için ekonomiyi örneklendirir. (Hesaplamalar basında bildirilen para birimi ve token miktarlarına dayanmaktadır.)

API fiyatı

Temsili pazar yeri (CometAPI) listesi: GLM-5-Turbo için 1M giriş token’ı başına 0,96 ABD$ ve 1M çıkış token’ı başına 3,20 ABD$.

Zhipu’nun (Z.ai) geliştirici fiyatlandırma sayfası, GLM-5-Turbo için biraz daha yüksek doğrudan oranlar listeliyor: 1M giriş token’ı başına 1,20 ABD$ ve 1M çıkış token’ı başına 4,00 ABD$ (önbelleğe alınmış giriş oranları daha düşüktür).

GLM-5-Turbo vs GLM-5 — yan yana karşılaştırma

Üst düzeyde:

- GLM-5 = amiral gemisi genel amaçlı temel model (güçlü akıl yürütme, kodlama, kıyaslamalar)

- GLM-5-Turbo = ajanlara optimize edilmiş GLM-5 varyantı (uzun iş akışları, araç kullanımı, kararlılık odaklı)

GLM-5-Turbo, tamamen yeni bir model mimarisi değil, OpenClaw gibi ajan sistemleri için tasarlanmış özelleştirilmiş, üretim-odaklı GLM-5 sürümüdür.

Çekirdek konumlandırma

| Model | Konumlandırma |

|---|---|

| GLM-5 | Genel amaçlı amiral gemisi LLM (akıl yürütme, kodlama, kıyaslamalar) |

| GLM-5-Turbo | Ajan-öncelikli model (otomasyon, orkestrasyon, araç kullanımı) |

👉 Basitçe:

- GLM-5 → maksimum zekâ istediğinizde

- GLM-5-Turbo → kararlı otomasyon / ajanlar istediğinizde

Ajan yetenek karşılaştırması (EN ÖNEMLİ)

GLM-5 (ajan yeteneği), hâlihazırda şunları destekler:

- Araç kullanımı

- Çok adımlı akıl yürütme

- Kodlama ajanları

Ancak sınırlamalar:

- Uzun zincirlerde bağlam kaybedebilir

- Araç çağrıları zamanla bozulabilir

- Daha fazla orkestrasyon mantığı gerektirir

GLM-5-Turbo özellikle ajanlar için optimize edilmiştir:

Temel iyileştirmeler:

- Araç çağrısı güvenilirliği ↑

- Görev ayrıştırma (planlama) ↑

- Uzun zincir tutarlılığı ↑

- Kalıcı yürütme desteği ↑

Örnek iyileştirme:

- Bağlamı kaybetmeden 10+ adım boyunca kararlı yürütme

👉 Şunlar için kritiktir:

- AutoGPT tarzı sistemler

- Çoklu ajan iş akışları

- SaaS otomasyonu

Hız ve verimlilik

| Boyut | GLM-5 | GLM-5-Turbo |

|---|---|---|

| Çıkarım hızı | Orta | Daha hızlı |

| İşlem hacmi | Standart | Daha yüksek |

| Uzun görev gecikmesi | Bozulabilir | Optimize edildi |

GLM-5-Turbo, gerçek bir sektör sorununu çözmek için tasarlanmıştır:

Büyük modeller uzun iş akışlarında yavaşlar veya bozulur

Fiyat karşılaştırması

| Model | Girdi (ABD$/1M token) | Çıktı (ABD$/1M token) |

|---|---|---|

| GLM-5 | ~$1.00 | ~$3.20 |

| GLM-5-Turbo | ~$1.20 | ~$4.00 |

👉 GLM-5-Turbo daha pahalıdır (~%20 daha yüksek)

Neden daha pahalı?

Çünkü şunları sağlar:

- Daha iyi orkestrasyon güvenilirliği

- Daha yüksek üretim kararlılığı

- Ajan-özgü optimizasyonlar

👉 Kurumsalda:

- Token başına daha fazla ödersiniz

- Ancak başarısızlık maliyeti + yeniden denemeler azalır

| Öznitelik | GLM-5 | GLM-5-Turbo |

|---|---|---|

| Birincil hedef | Genel amaçlı amiral gemisi temel model (geniş yetenekler, güçlü kodlama/kıyaslamalar) | Ajan/“OpenClaw” / lobster-optimize edilmiş temel model |

| Bağlam penceresi | (yüksek raporlanır; GLM-5 ~200K odaklanır (GLM-5 de uzun bağlam destekler) | 200.000 token (açıkça belgelendi). |

| Azami çıktı token’ları | (büyük, modele bağlı) | 128.000 token (belgelendi). |

| Dikkate değer skorlar | SWE-bench: 77.8; Terminal Bench 2.0: 56.2 (GLM-5 raporlanan sayılar). | Dahili değerlendirmeler, ajan iş akışları için geliştirilmiş uzun zincir kararlılığı ve işlem hacmi iddia eder; bağımsız veriler bekleniyor. |

| Modaliteler | Metin (birincil), GLM ailesinde kardeş modellerde görsel varyantlar | Yalnızca metin (dokümanlara göre) — araç tabanlı ajanlar için optimize edilmiştir. |

| Önerilen kullanımlar | Geniş: sohbet, kod, akıl yürütme, içerik | Ajan orkestrasyonu, araç çağrısı, uzun ufuklu otomasyon |

| Fiyatlandırma | Mevcut GLM-5 fiyatlandırması (plana göre değişir) | Yeni lansman — bildirilen ~%20 API fiyat artışı; yeni Lobster abonelik kademeleri tanıtıldı |

GLM-5-Turbo nasıl kullanılır

CometAPI — birçok modele tek API erişimi (OpenAI uyumlu)

CometAPI, GLM-5-Turbo’yu listeler ve OpenAI uyumlu bir temel URL ve SDK sağlar. Yayınladıkları model dizesini kullanın (sitelerinde GLM-5-Turbo benzer fiyatlandırmayla listelenir). Aşağıdaki örnekler CometAPI dokümanlarından uyarlanmıştır:

curl (CometAPI):

curl -X POST "https://api.cometapi.com/v1/chat/completions" \ -H "Authorization: Bearer YOUR_COMETAPI_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "z-glm-5-turbo", // or use the exact model slug shown in CometAPI UI "messages": [{"role":"user","content":"Create a 5-step checklist for onboarding a new hire."}], "max_tokens": 800 }'

CometAPI’nin değeri, toplayıcı kolaylığıdır (birçok model için tek entegrasyon). Arama yapmadan önce CometAPI panosunda tam model kısa adını doğrulayın.

GLM-5-Turbo ile Lobster / OpenClaw ajanları geliştirirken en iyi uygulamalar

- Ham gecikme yerine güvenilirlik için tasarlayın: Turbo’nun avantajı, uzun zincirlerde daha düşük araç çağrısı hatasıdır. Ajan çalıştırmalarını, küçük ilk token kazanımlarından ziyade sağlam tamamlamaları (yeniden denemeler, idempotent araç çağrıları) tercih edecek şekilde yapılandırın.

- Akış ve artımlı araç çağrılarını kullanın: Yeniden işi azaltmak ve uygun olduğunda erken araç çağrısına izin vermek için akış/küme çıktıları benimseyin. GLM-5-Turbo akışı destekler.

- Ayrıştırıcılar için yapılandırılmış çıktılar: Kararlı aşağı akış araç ayrıştırması için JSON veya iyi biçimlendirilmiş sonuçları tercih edin. Turbo yapılandırılmış çıktıları destekler.

- Zamanlama/kalıcılık için plan yapın: Ajanınız periyodik olarak kontrol etmeli veya arka plan görevleri çalıştırmalıysa, her döngüde yeniden planlamamak için Turbo’nun daha iyi zaman semantiği ve önbellekleme özelliklerini kullanın.

- Araç çağrılarını ve geri dönüşleri enstrümante edin: Araç çağrılarını günlükleyin ve zarif geri dönüşleri tasarlayın (ör. sıcaklığı biraz değiştirerek yeniden dene veya yedek bir aracı çağır) çünkü ajanik iş akışları, tek bir harici API’nin başarısız olmasıyla kırılgandır. Turbo hata oranlarını düşürür ancak harici başarısızlıkları ortadan kaldırmaz.

Geliştiriciler, GLM-5 ve GLM-5 turbo API’sine şu anda CometAPI üzerinden erişebilir. Başlamak için ayrıntılı talimatlar için API guide bölümüne bakın. Erişmeden önce CometAPI’ye giriş yaptığınızdan ve API anahtarını aldığınızdan emin olun. CometAPI entegrasyona yardımcı olmak için resmi fiyattan çok daha düşük bir fiyat sunuyor.

Ready to Go?→ Sign up fo GLM-5 and GLM-5 turbo today !