Trả lời nhanh: Nhà phát triển nên ưu tiên mô hình AI nào vào năm 2026?

Đối với các tác vụ đòi hỏi suy luận tự chủ tối đa và mức ảo giác tối thiểu, nhà phát triển nên chọn GPT-5.5 (xhigh), mô hình dẫn đầu thị trường với Chỉ số Trí tuệ là 60. Những ứng dụng yêu cầu tính tương tác thời gian thực nên sử dụng Mercury 2, hiện là quán quân tốc độ với khoảng 859 token mỗi giây. Đối với sản xuất quy mô lớn khi ngân sách là ràng buộc chính, DeepSeek V4 Pro và Kimi K2.6 mang lại trí tuệ gần mức tiên phong với chi phí vào khoảng 10% so với các mô hình độc quyền hàng đầu.

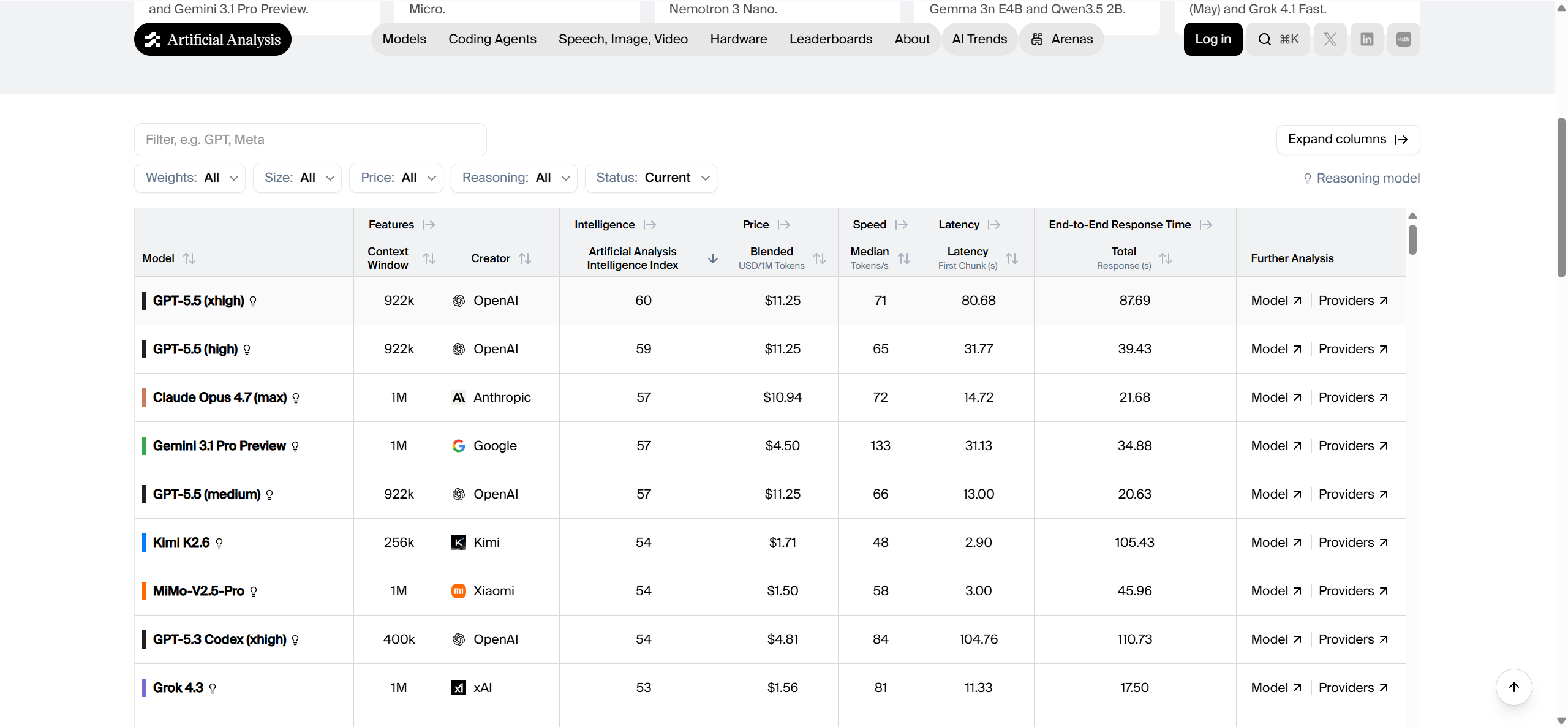

Chỉ số Trí tuệ: Xếp hạng các mô hình tiên phong

Bức tranh AI năm 2026 đã chuyển từ chạy theo số lượng tham số sang tối ưu mật độ "tư duy". Artificial Analysis Intelligence Index v4.0 đóng vai trò tiêu chuẩn ngành để định lượng năng lực mô hình trên mười chiều chuyên biệt, bao gồm lập trình cấp độ chuyên nghiệp và suy luận logic cực hạn.

| Mô hình | Chỉ số Trí tuệ | Cửa sổ ngữ cảnh | Trường hợp sử dụng tốt nhất |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Nghiên cứu khoa học và suy luận |

| GPT-5.5 (high) | 59 | 922K | Lập trình cấp độ chuyên nghiệp |

| Claude Opus 4.7 (max) | 57 | 1M | Tác tử tự chủ và lập kế hoạch |

| Gemini 3.1 Pro | 57 | 1M - 2M | Tổng hợp dữ liệu đa phương thức |

| Kimi K2.6 | 54 | 256K | Công việc tác tử dựa trên terminal |

| MiMo-V2.5-Pro | 54 | 1M | Kỹ nghệ phần mềm full‑stack |

| DeepSeek V4 Pro (Max) | 52 | 1M | Quy trình suy luận có thể mở rộng |

| GLM-5.1 | 51 | 200K | Nhiệm vụ tự chủ tầm nhìn dài |

Cách đọc bảng này

Trong năm mô hình hàng đầu, có ba là các mô hình GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 và Gemini 3.1 Pro. Ba mô hình chủ lực phương Tây này ngang ngửa nhau, trong khi Kimi K2 và mimo-v2.5 pro, hai mô hình Trung Quốc, cung cấp hiệu năng tương đương các mô hình hàng đầu phương Tây với mức giá cực kỳ cạnh tranh.

Artificial Analysis Intelligence Index là một chỉ số chuẩn hóa được suy ra từ các đánh giá độc lập như Terminal-Bench Hard và IFBench. Mỗi một điểm chênh lệch đại diện cho một khoảng cách mang ý nghĩa thống kê trong “ngưỡng tự chủ” của mô hình. Ví dụ, khoảng cách 3 điểm giữa GPT-5.5 (60) và Claude Opus 4.7 (57) thường chuyển hóa thành sự khác biệt giữa một mô hình cần con người can thiệp sau mỗi vài bước so với một mô hình có thể hoàn tất một chuỗi logic phức tạp một cách độc lập. Điểm chỉ số cao hơn thường gắn với tỉ lệ thành công cao hơn trong "Humanity's Last Exam" và giảm lỗi gọi công cụ trong môi trường tác tử.

Phản xạ: Độ trễ và tốc độ sinh

Đối với phần mềm tương tác—từ trợ lý IDE trực tiếp đến tác nhân thoại hướng khách hàng—trí tuệ thuần túy đứng sau Thời gian đến token đầu tiên (TTFT) và Thông lượng sinh.

Top 5 mô hình nhanh nhất (thông lượng)

Thông lượng đo tốc độ mà mô hình tạo văn bản sau giai đoạn xử lý ban đầu. Thông lượng cao rất quan trọng cho tạo nội dung dài và tái cấu trúc mã nhanh.

- Mercury 2: Khoảng 859 tokens/s

- Granite 4.0 H Small: Khoảng 407 tokens/s

- Granite 3.3 8B: Khoảng 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Khoảng 331 tokens/s

- Qwen3.5 0.8B: Khoảng 287 tokens/s

Top 5 mô hình có độ trễ thấp nhất (TTFT)

Độ trễ cho biết độ trễ trước khi token đầu tiên đến tay người dùng. Đây là chỉ số quyết định “cảm giác” và độ phản hồi trong UI/UX.

- NVIDIA Nemotron 3 Nano: Khoảng 0.40s

- Ministral 3 3B: Khoảng 0.47s

- Qwen3.5 0.8B: Khoảng 0.52s

- LFM2 24B A2B: Khoảng 0.55s

- Grok 3 mini Reasoning: Khoảng 0.58s

Cách chọn mô hình của bạn vào năm 2026

Chọn mô hình đòi hỏi cân bằng giữa tỷ lệ “Trí tuệ trên mỗi đô-la” và yêu cầu uptime cụ thể của ứng dụng. Thị trường năm 2026 đã phân nhánh thành ba con đường kiến trúc riêng biệt.

Nhà phát triển độc lập và đội ngũ nhạy về ngân sách

Đối với nhà phát triển solo hoặc đội nhỏ chạy hàng nghìn vòng lặp tác tử thử nghiệm, DeepSeek V4 Pro là lựa chọn chiến lược tối ưu. Mô hình này sử dụng kiến trúc Mixture-of-Experts (MoE) khổng lồ 1.6T tham số, trong đó chỉ 49B tham số được kích hoạt trên mỗi token, cho phép đạt hiệu năng hàng đầu với chi phí khoảng $0.416 trên mỗi triệu tokens. Một lựa chọn tuyệt vời khác cho tác vụ chuyên lập trình là Kimi K2.6, chuyên về các quy trình ưu tiên terminal. Những mô hình này cung cấp gần 90% sức mạnh suy luận của các mô hình cao cấp trong khi rẻ hơn khoảng 70–80%, hiệu quả kéo dài runway của startup.

Môi trường sản xuất cấp doanh nghiệp

Đối với triển khai toàn công ty nơi tính ổn định và tuân thủ prompt hệ thống phức tạp là không thể thương lượng, tiêu chuẩn ngành vẫn là GPT-5.5 Pro và Claude Opus 4.7. GPT-5.5 Pro được thiết kế cho độ chính xác rủi ro cao, vượt trội trong các lĩnh vực như mô hình hóa ngân hàng đầu tư và khám phá khoa học nơi chi phí sai sót cao hơn chi phí cuộc gọi API. Claude Opus 4.7 được ưa chuộng bởi các đội cần độ tin cậy bền bỉ trong các dự án kéo dài nhiều ngày, vì cho thấy tỉ lệ ảo giác thấp hơn đáng kể trong môi trường terminal so với họ GPT nói chung. Doanh nghiệp thường sử dụng CometAPI để tích hợp các mô hình này qua một cổng duy nhất, đảm bảo thời gian hoạt động 99.9% và chuyển mạch dự phòng tức thì nếu nhà cung cấp chính gặp đột biến độ trễ theo khu vực.

Ứng dụng tương tác thời gian thực

Các ứng dụng như bot hỗ trợ khách hàng thời gian thực hoặc phụ đề video tức thì đòi hỏi AI “trôi chảy” mang lại cảm giác tức thời. Ở hạng mục này, Mercury 2 và Gemini 3.1 Flash-Lite là lựa chọn vượt trội. Mercury 2 cung cấp thông lượng nhanh gần mười lần so với các mô hình suy luận tiêu chuẩn, lý tưởng cho soạn thảo tài liệu thời gian thực. Gemini 3.1 Flash-Lite cân bằng năng lực đa phương thức, xử lý văn bản, âm thanh và hình ảnh trong một ngữ cảnh thống nhất với tốc độ khoảng 2.5x so với các thế hệ trước, đồng thời hỗ trợ cửa sổ ngữ cảnh 1 triệu token.

Cửa sổ ngữ cảnh: Từ đoạn nhỏ đến toàn bộ kho mã

Cửa sổ ngữ cảnh đóng vai trò “bộ nhớ ngắn hạn” của mô hình. Năm 2026, ngành đã tách ra giữa cửa sổ tiêu chuẩn (128K) và năng lực tầm kho mã (1M–10M).

- Llama 4 Scout: 10,000,000 tokens

- Grok 4.20: 2,000,000 tokens

- Gemini 3.1 Pro: Khoảng 1,048,576 tokens

- DeepSeek V4 Pro: 1,000,000 tokens

- GPT-5.5 Pro: 1,050,000 tokens

Khi nào kích thước ngữ cảnh quan trọng?

Một cửa sổ ngữ cảnh 128K—tiêu chuẩn cho các mô hình như DeepSeek‑V3.2—giờ là đường cơ sở cho trò chuyện cơ bản và tóm tắt từng bài viết. Tuy nhiên, kỹ nghệ phần mềm chuyên nghiệp đòi hỏi nhận thức “toàn hệ thống”.

Một cửa sổ 1 triệu token cho phép một tác tử AI nạp toàn bộ kho mã phần mềm, gồm tất cả tệp nguồn, tài liệu và log lịch sử, trong một lượt truyền tiến duy nhất. Điều này ngăn hiện tượng “trôi bộ nhớ” gắn với các hệ thống RAG truyền thống nơi dữ liệu liên quan có thể bị bỏ sót khi chia khối. Ví dụ cụ thể là tái cấu trúc codebase: một mô hình với 1M token có thể hiểu cách thay đổi ở schema cơ sở dữ liệu cốt lõi ảnh hưởng đến năm mươi endpoint API khác nhau trên các tệp riêng biệt, trong khi mô hình nhỏ hơn có thể chỉ “nhìn thấy” vài tệp tại một thời điểm, dẫn đến phụ thuộc bị hỏng.

So sánh kinh tế: Giá đơn vị trên mỗi 1 triệu token

Bảng sau dùng thước đo Giá USD pha trộn/1M tokens, giả định tỷ lệ 3:1 giữa token đầu vào và đầu ra để phản ánh mẫu sử dụng thực tế.

| Mô hình | Giá pha trộn (trên 1M) | Giá trị tương đối | Giảm giá qua CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Xấp xỉ $11.25 | Cao cấp | 20% OFF |

| Claude Opus 4.7 (max) | Xấp xỉ $10.00 | Cao | 20% OFF |

| Gemini 3.1 Pro | Xấp xỉ $4.50 | Cân bằng | 20% OFF |

| Kimi K2.6 | Xấp xỉ $1.71 | Giá trị cao | 20% OFF |

| DeepSeek V4 Pro | Xấp xỉ $0.53 | Giá trị cực cao | 20% OFF |

| Qwen3.5 0.8B | Xấp xỉ $0.02 | Tiện ích | 20% OFF |

Đã xác minh tất cả mức giá tính đến tháng 5/2026. Mức giá chính thức từ nhà cung cấp thường cao hơn 20% so với mức giá chiết khấu được cung cấp qua các cổng hợp nhất.

Chiến lược tối ưu chi phí

Để hỗ trợ lập kế hoạch kiến trúc, chúng tôi ước tính chi tiêu hàng tháng cho ba mốc tăng trưởng phổ biến.

- Nhóm nhà phát triển nhỏ (10M tokens/tháng): Các đội chủ yếu dùng Kimi K2.6 cho xây dựng tính năng và DeepSeek V4 Flash cho logic đơn giản sẽ có chi phí hàng tháng trong khoảng $15 đến $40. Điều này cho phép thử nghiệm nguyên mẫu mạnh mẽ với gánh nặng tài chính không lớn hơn một gói SaaS tiêu chuẩn.

- SaaS tầm trung (100M tokens/tháng): Một startup mở rộng nền tảng tự động hóa do AI dẫn dắt bằng Claude Sonnet 4.6 và Gemini 3.1 Flash có thể kỳ vọng chi phí hàng tháng từ $250 đến $550. Bằng cách tận dụng bộ nhớ đệm prompt có trên các mô hình này, chi phí hiệu dụng thường giảm thêm 15%.

- Doanh nghiệp lớn (1B tokens/tháng): Các công ty toàn cầu chạy quy trình tác tử đồng thời cao với GPT-5.5 và Claude Opus 4.7 có khả năng chi $3,000 đến $6,500 mỗi tháng. Ở quy mô này, tích hợp qua một cổng API hợp nhất trở nên thiết yếu để tập trung hóa thanh toán và tránh chi phí quản lý nhiều hợp đồng riêng với nhiều nhà cung cấp.

Kết luận: Chọn con đường của bạn vào năm 2026

Thời đại của “mô hình vạn năng” đã kết thúc. Kiến trúc AI hiện đại đòi hỏi điều phối một đội mô hình chuyên trách: GPT-5.5 cho suy luận nặng, Mercury 2 cho tương tác, và DeepSeek V4 cho thực thi khối lượng lớn. Bằng cách tích hợp một lần với CometAPI, nhà phát triển có được khả năng di động để hoán đổi mô hình khi benchmark tiến hóa đồng thời đảm bảo mức chiết khấu 20–40% vĩnh viễn cho mỗi yêu cầu.

Câu hỏi thường gặp

Hiện tại mô hình AI nào thông minh nhất?

Theo Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) là mô hình thông minh nhất hiện có, với điểm số 60. Theo sát là GPT-5.5 (high) với 59 và Claude Opus 4.7 (max) với 57.

Mô hình AI nhanh nhất cho ứng dụng thời gian thực là gì?

Mercury 2 là nhà vô địch tốc độ năm 2026, đạt khoảng 859.1 token mỗi giây. Về độ trễ thấp (TTFT), NVIDIA Nemotron 3 Nano dẫn đầu với thời gian phản hồi khoảng 0.40 giây.

Điểm Chỉ số Trí tuệ cần cao đến mức nào cho các tác tử sản xuất?

Đối với tự động hóa cơ bản hoặc phân loại, điểm từ 30 đến 40 (như GPT-5.4 nano) thường là đủ. Tuy nhiên, với "Agentic Engineering" nơi AI quản lý codebase hoặc toàn bộ phiên trình duyệt, khuyến nghị điểm trên 54 (chẳng hạn Kimi K2.6 hoặc GPT-5.5) để đảm bảo nhất quán trong lập kế hoạch tầm dài.

Với mức giá tương tự, tôi nên chọn GPT-5.5 hay Claude Opus 4.7?

Nếu quy trình làm việc của bạn liên quan đến thực thi trên terminal và “Vibe Coding”, GPT-5.5 thường vượt trội ở các benchmark cụ thể đó. Tuy nhiên, nếu bạn cần độ nhất quán cực cao cho viết chuyên nghiệp, nghiên cứu pháp lý, hoặc chu kỳ tác tử kéo dài nhiều ngày với tỉ lệ ảo giác thấp, Claude Opus 4.7 là lựa chọn được ghi nhận là dẫn đầu ở các hạng mục này.

Khoảng cách hiệu năng thực tế giữa mô hình open-weights (DeepSeek) và mô hình độc quyền là gì?

Năm 2026, khoảng cách đã thu hẹp xuống còn khoảng 10–15% trong các benchmark suy luận thô. Trong khi các đầu bảng độc quyền như GPT-5.5 (xhigh) vẫn dẫn đầu ở logic “đỉnh” (Index 60), các mô hình open-weight như DeepSeek V4 Pro (Index 52) và Kimi K2.6 (Index 54) cung cấp hơn 85% năng lực với chi phí xấp xỉ 1/10.

Làm thế nào để giảm tổng chi phí API cho các mô hình này?

Sử dụng một lớp API hợp nhất như CometAPI cho phép bạn truy cập toàn bộ danh mục với mức giá thấp hơn 20% đến 40% so với giá chính thức của nhà cung cấp nhờ mua theo khối và định tuyến đường đi thông minh.

Mô hình nào có cửa sổ ngữ cảnh lớn nhất cho tài liệu dài?

Llama 4 Scout hiện hỗ trợ cửa sổ ngữ cảnh lớn nhất trên thị trường với 10 triệu token. Grok 4.20 theo sau với 2 triệu token, trong khi GPT-5.5 Pro, Gemini 3.1 Pro, và DeepSeek V4 Pro đều hỗ trợ khoảng 1 triệu token.

Có cách nào thử các benchmark này mà không tốn chi phí ban đầu cao không?

Có. Bạn có thể đăng ký tài khoản miễn phí tại CometAPI để nhận tín dụng thử nghiệm mà không cần thẻ tín dụng, cho phép bạn chạy các thử nghiệm hiệu năng so sánh trên hơn 500 mô hình trong Playground tích hợp sẵn.