Trải nghiệm của nhà phát triển với phân tích video bằng ChatGPT thường vấp phải bức tường: liên kết YouTube trực tiếp không hoạt động, và tải lên MP4 trả về các bản tóm tắt “ảo giác” bỏ lỡ những tinh tế thị giác. Đây không phải lỗi — mà là ràng buộc kiến trúc. ChatGPT không phát trực tuyến video; nó xử lý chuỗi khung hình được trích xuất và văn bản phiên âm. Vì thế bạn thử tải lên tệp MP4, và nó “hoạt động”… kiểu như vậy. Bản tóm tắt nhắc đến phần âm thanh phiên âm nhưng hoàn toàn bỏ lỡ trò đùa thị giác ở cảnh thứ ba vốn giúp cả video trở nên có ý nghĩa.

ChatGPT có thể phân tích video — nhưng không phải bằng cách “xem” chúng thực sự

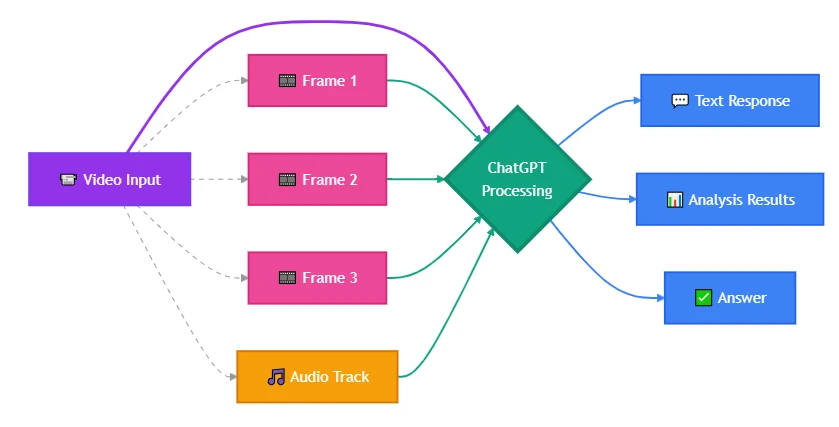

Thực tế là: ChatGPT không “xem” video như bạn. Nó không nhấn phát, phát trực tuyến nội dung, rồi quan sát chuyển động theo thời gian. Thay vào đó, nó tách video thành những thành phần mà nó đã biết cách xử lý — ảnh tĩnh và văn bản phiên âm — rồi suy luận về từng phần độc lập. Mô hình nhìn video của bạn như một album ảnh kèm thuyết minh, chứ không phải trải nghiệm liên tục. Đó là lý do nó bắt được phần giải thích đã nói nhưng bỏ lỡ cú “điểm nhấn” thị giác: khung có trò đùa có thể không nằm trong tập mẫu.

Khi ai đó hỏi “ChatGPT có xem được video không”, họ thường hỏi một trong hai điều: Nó có thể phát trực tiếp nội dung hình ảnh như người quan sát không, hay nó có thể trích xuất và phân tích ý nghĩa từ dữ liệu video — cảnh, đối thoại, dấu thời gian, hành động trên màn hình? Câu trả lời về chức năng là có với câu hỏi thứ hai, nhưng có các ràng buộc khiến một số trường hợp sử dụng hoàn toàn không phù hợp. Các biến thể ChatGPT hiện đại xử lý video bằng cách coi đó là các khung hình được lấy mẫu kết hợp với phiên âm âm thanh, hoặc qua trích xuất tự động trong giao diện web, hoặc bằng cách chấp nhận khung hình do người dùng cung cấp qua API. Cách này hiệu quả cho tóm tắt, mô tả cảnh, và trích xuất văn bản. Nó thất bại với theo dõi chuyển động, phân tích phụ thuộc thời gian, hoặc bất cứ thứ gì yêu cầu mô hình “nhìn” những gì xảy ra giữa các khung.

Hầu hết hướng dẫn dừng ở việc xác nhận năng lực tồn tại mà không giải thích vì sao triển khai cụ thể của bạn không hoạt động — hoặc phương thức nhập thay thế nào phù hợp hơn.

ChatGPT Khả năng video: Mô hình thực sự “thấy” gì

ChatGPT không tải một tệp MP4 rồi tua qua từng khung hình. Nó có năng lực thị giác — khả năng phân tích ảnh tĩnh — và phiên âm âm thanh nhờ tích hợp Whisper. Khi bạn gửi video qua giao diện web hoặc ứng dụng di động của ChatGPT, hệ thống trích xuất các khung hình chính, phiên âm âm thanh riêng, rồi đưa cả hai vào mô hình như những đầu vào tách biệt. Mô hình sau đó mô tả những gì nó “thấy” trong các khung và những gì nó “nghe” trong phiên âm.

Từ góc nhìn của bạn, có vẻ như hiểu video. Từ góc nhìn của mô hình, đó là phân tích ảnh cộng xử lý văn bản. Khác biệt về kiến trúc này quyết định trường hợp sử dụng nào phù hợp và trường hợp nào không.

Nếu video của bạn phụ thuộc vào chuyển động, thay đổi tinh tế giữa các khung, hoặc thời gian chính xác — như phát hiện chính xác khi một đối tượng đi vào khung hình, hoặc theo dõi cách một phần tử giao diện người dùng được animate — phương pháp dựa trên khung hình chính sẽ bỏ lỡ. ChatGPT sẽ không bắt được tín hiệu thị giác 2 giây nằm giữa các khung được lấy mẫu. Nó cũng sẽ không theo dõi đối tượng qua thời gian trừ khi bạn cấu trúc đầu vào một cách tường minh để cho thấy tiến trình.

Khả năng video hiện tại của ChatGPT (đầu 2026):

- Phân tích video dựa trên ảnh: Chấp nhận tệp video hoặc khung hình trích xuất; diễn giải nội dung thị giác từ các ảnh được lấy mẫu

- Phiên âm âm thanh: Chuyển lời nói thành văn bản qua Whisper; mô hình có thể tóm tắt hoặc truy vấn phiên âm

- Mô tả cảnh: Nhận diện đối tượng, hành động, môi trường, và văn bản hiển thị trong các khung được cung cấp

- Truy vấn theo dấu thời gian: Có thể tham chiếu khoảnh khắc cụ thể nếu bạn cung cấp dấu thời gian khung hoặc phân đoạn thủ công video

- Trích xuất văn bản: Đọc phụ đề trên màn hình, nhãn UI, hoặc tài liệu hiển thị trong các khung

Tốc độ lấy mẫu khung hình cụ thể và hành vi chọn khung hình chính tự động trong giao diện web ChatGPT — không được công bố công khai tính đến thời điểm kiến thức chốt

Những gì không bao gồm:

- Đầu vào video phát trực tuyến thời gian thực qua API

- Theo dõi chuyển động chính xác từng khung hoặc duy trì đối tượng qua thời gian

- Hỗ trợ codec video gốc — mọi xử lý diễn ra trên các khung hình trích xuất và âm thanh

- Phát hiện chuyển cảnh tự động nếu không có nhắc nhở tường minh

Khả năng xử lý video bị ràng buộc bởi giới hạn token và kích thước tệp, không phải thời lượng. Dù 5–10 phút là kinh nghiệm thực tiễn, giới hạn thực tế co giãn theo mật độ hình ảnh.

Nếu trường hợp sử dụng của bạn cần các khả năng đó, bạn hoặc là tiền xử lý video để trích xuất khung phù hợp, hoặc chuyển sang một mô hình có hỗ trợ video gốc. Phần tiếp theo phân tích phương thức nhập nào phù hợp với kịch bản của bạn.

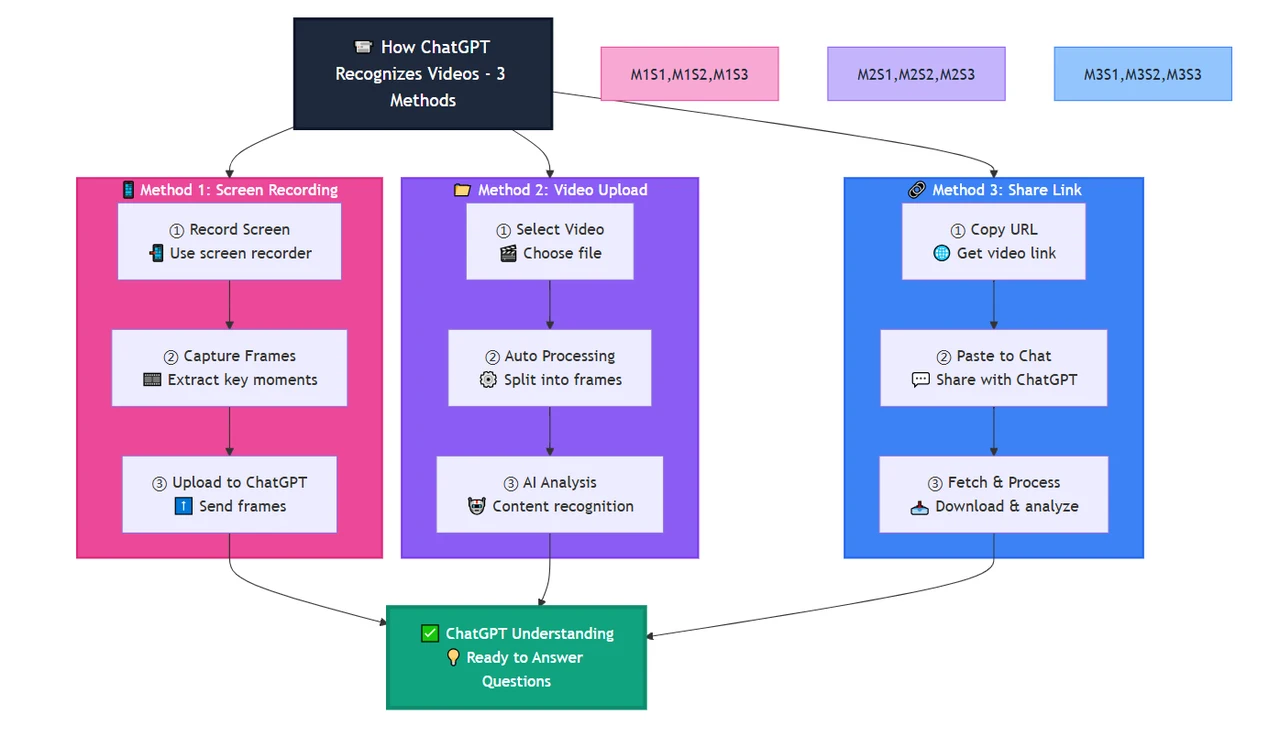

Cách ChatGPT nhận biết video: Ba phương pháp thực dụng

Không có một cách duy nhất để gửi video cho ChatGPT. Phương pháp bạn chọn quyết định mô hình có thể phân tích gì và bỏ lỡ gì. Hầu hết thất bại triển khai đến từ việc chọn phương pháp tiện thay vì phương pháp đúng.

Phương pháp 1: Trích xuất khung thủ công + tải ảnh lên

Tự trích xuất khung bằng ffmpeg hoặc công cụ tương tự, rồi tải những khung cụ thể đó lên dạng ảnh. Cách này cho bạn kiểm soát hoàn toàn những gì ChatGPT phân tích.

Ví dụ quy trình (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Cách tiếp cận này cho phép bạn:

- Tập trung phân tích vào khoảnh khắc cụ thể (mở đầu, hành động chính, kết luận) mà không lãng phí ngữ cảnh cho phần không liên quan

- Bắt chuyển động bằng cách tải lên các khung liên tiếp theo tốc độ lấy mẫu bạn chọn

- Vượt qua giới hạn kích thước tệp — ảnh nhỏ hơn tệp video đầy đủ

- Giữ chất lượng khung hình có thể bị suy giảm trong nén tự động

Đánh đổi:

Bạn tự xử lý tiền xử lý. Để phân tích hàng trăm video ở quy mô lớn, cần tự động hóa. Cho các phân tích chuyên sâu một lần hoặc gỡ lỗi cảnh cụ thể, đây là phương pháp tin cậy nhất.

Khi nào dùng phương pháp này:

- Bạn cần phân tích chính xác theo khung tại những khoảnh khắc cụ thể

- Thông tin thị giác quan trọng ngắn ngủi hoặc xảy ra giữa khoảng khung hình chính điển hình

- Bạn đang so sánh thay đổi thị giác qua chuỗi (thay đổi trạng thái UI, khung hình animation)

- Bạn muốn xác minh mô hình thực sự “thấy” gì bằng cách kiểm tra chính xác những khung bạn đã tải

Phương pháp 2: Tải tệp trực tiếp qua giao diện ChatGPT

Ứng dụng web và di động ChatGPT chấp nhận tải video trực tiếp trong cuộc trò chuyện. Kéo một MP4 hoặc MOV vào ô nhập, và hệ thống sẽ tự động xử lý trích xuất khung và phiên âm.

Những gì xảy ra bên trong:

- Dịch vụ lấy mẫu khung theo khoảng thời gian (tốc độ cụ thể không được công bố; ước tính 1–2 khung/giây dựa trên quan sát)

- Âm thanh được phiên âm qua Whisper hoặc dịch vụ tương tự

- Cả hai đầu ra được truyền vào mô hình như những ngữ cảnh riêng

- Mô hình tạo phản hồi dựa trên khung nhìn thấy và phiên âm nghe được

Phương pháp này phù hợp cho:

- Tóm tắt cấp cao nơi bạn không cần chi tiết chính xác từng khung

- Nhận diện đối tượng, người, hoặc môi trường chính tồn tại xuyên suốt các cảnh

- Trích xuất nội dung nói hoặc văn bản trên màn hình xuất hiện trong nhiều khung

- Khảo sát nhanh mà không cần tiền xử lý

Phương pháp này thất bại khi:

- Phân tích chính xác từng khung — bạn không kiểm soát được khung nào được lấy mẫu

- Với nội dung video dài vượt quá khả năng ngữ cảnh thoải mái của mô hình, cần phân đoạn hợp lý. Không có chia nhỏ chiến lược hoặc tiền xử lý, mô hình có thể suy giảm hoặc cắt cụt khi mức tiêu thụ token tăng nhanh với dữ liệu hình ảnh dày đặc

- Phát hiện chuyển động, chuyển cảnh, hoặc nội dung phụ thuộc thời gian cần so sánh khung liên tiếp

- Tình huống mà thông tin thị giác quan trọng xuất hiện ngắn ngủi giữa các khung được lấy mẫu

Nếu bạn cần kiểm soát khoảnh khắc nào được phân tích, hãy dùng Phương pháp 1.

Phương pháp 3: Liên kết YouTube + lấy phiên âm

Một số plugin ChatGPT và công cụ bên thứ ba tuyên bố “phân tích video YouTube.” Thực tế, chúng lấy metadata công khai và phiên âm (nếu có), rồi chuyển văn bản đó cho ChatGPT.

Cách này hoạt động khi:

- Video có phụ đề tự động hoặc do người dùng tải lên

- Phân tích của bạn chỉ cần nội dung nói, không cần thông tin thị giác

- Video được công khai (không riêng tư, không không công khai, không bị giới hạn vùng)

- Bạn đang tóm tắt bài giảng, podcast, hoặc phỏng vấn nơi âm thanh chứa phần lớn ý nghĩa

Cách này không hoạt động khi:

- Bạn cần phân tích nội dung thị giác (trình diễn trên màn hình, sơ đồ, nét mặt)

- Video không có phiên âm hoặc phụ đề

- Thông tin quan trọng xuất hiện dưới dạng hình ảnh mà không được nhắc trong lời thoại

- Bạn làm việc với tệp video riêng tư hoặc nội dung sau xác thực

Sai lầm thường gặp: Nhà phát triển kỳ vọng hiểu video đầy đủ (hình + âm) nhưng chỉ nhận tóm tắt phiên âm. Điều này phù hợp cho phân tích nội dung nói. Nó vô dụng cho xem lại demo sản phẩm, phân tích thiết kế thị giác, hoặc bất kỳ tình huống nào thị giác quan trọng hơn lời nói.

Mẫu số chung: Phương pháp 2 cho tóm tắt nhanh nơi độ chính xác không quan trọng. Phương pháp 1 cho phân tích có kiểm soát khi bạn cần khung cụ thể. Phương pháp 3 cho nội dung tập trung âm thanh khi thông tin thị giác là thứ yếu hoặc không có. Hãy chọn dựa trên nơi tín hiệu quan trọng của trường hợp sử dụng của bạn nằm — trong chuyển động, trong các khung cụ thể, hay thuần ở lời thoại.

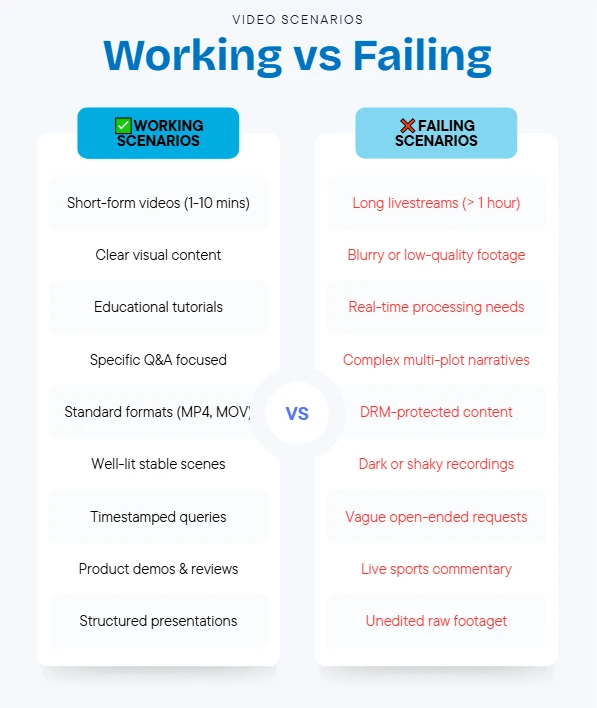

Kịch bản ứng dụng video của ChatGPT: Những gì thực sự hoạt động trong sản xuất

Biết ChatGPT có thể xử lý các thành phần video không cho bạn biết nó có phải công cụ đúng cho vấn đề của bạn không. Các kịch bản này cho thấy nơi phân tích dựa trên khung thành công — và nơi ràng buộc kiến trúc làm hỏng trường hợp sử dụng.

Kịch bản 1: Tóm tắt nội dung giáo dục

Trường hợp sử dụng: Bạn có video hướng dẫn 10 phút và cần bản tóm tắt có cấu trúc các bước chính, công cụ đề cập, và ví dụ thị giác được trình bày.

Vì sao hoạt động: Video giáo dục thường có ranh giới cảnh rõ, văn bản trên màn hình bền, và thuyết minh khớp với hình ảnh. Người nói mô tả những gì họ cho xem khi nó hiển thị. ChatGPT có thể phiên âm lời giải thích, xác định công cụ hoặc sơ đồ trong các khung được lấy mẫu, và kết hợp cả hai thành đầu ra có cấu trúc.

Cách triển khai: Tải video qua giao diện ChatGPT hoặc trích xuất 8–12 khung tại các chuyển chủ đề chính. Nhắc lệnh: “Liệt kê các bước chính được giải thích trong video này, tham chiếu cả thuyết minh và bất kỳ văn bản trên màn hình, sơ đồ, hoặc tên công cụ bạn thấy.”

Nơi bị vỡ: Video dựa vào chuyển động liên tục — như screencast coding nơi người hướng dẫn gõ nhanh qua nhiều tệp — sẽ thiếu bước giữa các khung. Bạn cần tốc độ lấy mẫu cao hơn hoặc tập trung vào phiên âm âm thanh.

Mẹo thực tiễn: Với nội dung bài giảng/hướng dẫn, kết hợp tải lên tự động (để có phiên âm) với các khung trích xuất thủ công ở 3–5 khoảnh khắc thị giác quan trọng. Bạn sẽ có cả phủ âm thanh toàn diện và ảnh chất lượng cao của khái niệm chính.

Kịch bản 2: Phân tích demo sản phẩm

Trường hợp sử dụng: Bạn xem lại demo sản phẩm của đối thủ và muốn trích xuất thành phần UI, tên tính năng, luồng người dùng, và chi tiết giá hiển thị trên màn hình.

Vì sao hoạt động: Demo sản phẩm thường giữ mỗi màn hình đủ lâu để lấy mẫu khung bắt được UI tĩnh. Văn bản phủ, nhãn nút, cấu trúc menu, và bảng giá hiển thị trên nhiều khung. Khả năng thị giác của ChatGPT có thể đọc và mô tả các phần tử này ngay cả khi chúng không được nhắc trong thuyết minh.

Cách triển khai: Trích xuất khung ở các chuyển cảnh chính (slide mở đầu, demo tính năng 1, demo tính năng 2, màn hình giá, CTA). Tải các khung đó lên và nhắc: “Với mỗi khung, xác định tất cả phần tử UI hiển thị, nhãn nút, tên tính năng, và bất kỳ thông tin sản phẩm hoặc giá nào được hiển thị.”

Nơi bị vỡ: Demo có chuyển màn nhanh, trạng thái hover để lộ thông tin trong thời gian ngắn, hoặc thành phần tương tác chỉ hiển thị 1–2 giây sẽ không bị bắt bởi lấy mẫu khung. Nếu đối thủ lướt nhanh bảng so sánh tính năng, bạn sẽ bỏ lỡ trừ khi đúng khoảnh khắc đó được lấy mẫu.

Mẹo thực tiễn: Tua video thủ công trước để xác định dấu thời gian của các lần hé lộ quan trọng. Trích xuất khung ở những khoảnh khắc đó thay vì dựa vào khoảng lấy mẫu tự động.

Kịch bản 3: Phiên âm họp/phỏng vấn kèm ngữ cảnh thị giác

Trường hợp sử dụng: Bạn ghi lại cuộc gọi với khách hàng và cần cả bản phiên âm lẫn chú thích thời điểm tài liệu, slide, hoặc chia sẻ màn hình xuất hiện.

Vì sao hoạt động: Phiên âm xử lý đối thoại. Khi người tham gia chia sẻ màn hình hoặc giơ tài liệu, chúng xuất hiện trong các khung được lấy mẫu. ChatGPT có thể chú thích “vào khoảng [timestamp], một tài liệu hợp đồng hiển thị trên màn hình” cùng với phiên âm — hữu ích cho biên bản họp tham chiếu tài liệu thị giác.

Cách triển khai: Tải video lên và nhắc: “Phiên âm cuộc họp này và ghi chú bất kỳ khoảnh khắc nào có tài liệu, slide thuyết trình, chia sẻ màn hình, hoặc tham chiếu thị giác khác xuất hiện. Với mỗi phần tử thị giác, mô tả những gì được hiển thị.”

Nơi bị vỡ: Chia sẻ màn hình ngắn (dưới 5–10 giây) có thể rơi giữa các khung lấy mẫu. Văn bản quá nhỏ để đọc trong khung bị nén sẽ không trích xuất được. Với mục đích pháp lý/tuân thủ yêu cầu độ chính xác nguyên văn của tài liệu hiển thị, hãy xác minh chất lượng khung và độ phủ lấy mẫu trước khi tin cậy đầu ra.

Mẹo thực tiễn: Với cuộc họp quan trọng, ghi ở độ phân giải cao hơn và trích xuất khung thủ công vào những lúc ai đó nói “để tôi cho xem tài liệu này” — báo hiệu sắp có tham chiếu thị giác.

Kịch bản 4: Kiểm duyệt nội dung hoặc rà soát tuân thủ

Trường hợp sử dụng: Bạn cần quét video do người dùng tải lên để tìm nội dung bị cấm — logo, kiểu văn bản, hoặc phần tử thị giác cụ thể vi phạm chính sách nền tảng.

Vì sao hoạt động: ChatGPT có thể quét khung để tìm văn bản hiển thị, đối tượng nhận diện được, hoặc cảnh được mô tả. Nếu bạn kiểm tra “có video nào hiển thị logo của đối thủ không”, phân tích dựa trên khung sẽ phát hiện logo tồn tại trên màn hình hơn một hai giây.

Cách triển khai: Trích xuất khung theo khoảng đều (mỗi 3–5 giây), tải lên, và nhắc: “Xem các khung này và xác định khung nào chứa [logo cụ thể, tên thương hiệu, biểu tượng cấm, v.v.]. Với mỗi khớp, mô tả vị trí xuất hiện trong khung.”

Nơi bị vỡ: Vi phạm dựa trên âm thanh (nhạc có bản quyền, lời nói bị cấm) cần phân tích âm thanh riêng. Vi phạm dựa trên chuyển động (cử chỉ bị cấm, hành động kéo dài nhiều khung) sẽ không bị bắt bởi phân tích ảnh tĩnh. Nội dung bị cấm nháy nhanh có thể không xuất hiện trong khung được lấy mẫu.

Mẹo thực tiễn: Kết hợp quét thị giác của ChatGPT với dịch vụ dấu vân tay âm thanh chuyên dụng và tốc độ lấy mẫu khung cao hơn cho hạng mục rủi ro cao. Dùng ChatGPT như bộ lọc vòng đầu, không phải lớp kiểm duyệt duy nhất.

Mẫu số chung của kịch bản thành công: nội dung có ý nghĩa tồn tại trong các khung ổn định rời rạc và tương quan với phần âm thanh hoặc văn bản. Thất bại xảy ra khi thông tin quan trọng nằm ở chuyển động, thời gian, chuyển cảnh, hoặc xuất hiện quá ngắn để được lấy mẫu đáng tin cậy.

Khả năng video của Gemini vs. Claude vs. ChatGPT

Nếu kiến trúc lấy mẫu khung của ChatGPT không phù hợp với trường hợp sử dụng của bạn, bạn sẽ đánh giá lựa chọn khác. Gemini và Claude có khả năng video khác nhau — và khác biệt đó quyết định mô hình nào phù hợp với triển khai cụ thể của bạn.

Xử lý video gốc của Gemini

Các mô hình Gemini hỗ trợ đầu vào video gốc ở cấp API. Bạn truyền trực tiếp tệp video mà không cần tiền xử lý thành khung. Mô hình xử lý video như dòng liên tục, cho phép theo dõi chuyển động, phát hiện chuyển cảnh, và lập luận theo thời gian mà cách dựa trên khung của ChatGPT không làm được.

Trường hợp sử dụng mà Gemini thắng:

Bạn cần phát hiện khi một đối tượng cụ thể vào và rời khung trong clip 30 giây, hoặc theo dõi cách một người di chuyển qua cảnh. Gemini có thể theo dõi đối tượng qua các khung và suy luận về chuyển động. ChatGPT chỉ thấy đối tượng ở những khung tình cờ được lấy mẫu — có thể bỏ lỡ lúc vào hoặc ra.

Đánh đổi:

- API gốc của Gemini tiết kiệm chi phí hơn so với lấy mẫu khung của OpenAI. Bằng cách tránh chi phí token tuyến tính nhờ bộ nhớ đệm ngữ cảnh, Gemini mở rộng tốt hơn cho phân tích dài

- Xử lý video dài hơn gây độ trễ cao hơn — mô hình phải nạp toàn bộ tệp trước khi phản hồi

- Không phải biến thể Gemini nào cũng hỗ trợ đầu vào video; yêu cầu các phiên bản Gemini về sau

- Giới hạn độ dài video tồn tại nhưng hào phóng hơn ràng buộc dựa trên ngữ cảnh của ChatGPT

Khi chọn Gemini thay vì ChatGPT:

- Trường hợp sử dụng cần theo dõi chuyển động, phát hiện ranh giới cảnh, hoặc hiểu quan hệ theo thời gian

- Thông tin quan trọng xuất hiện và biến mất nhanh qua các khung

- Bạn phân tích video nơi tiến trình sự kiện quan trọng (cảnh thể thao, giám sát, đánh giá animation)

- Bạn muốn tránh tiền xử lý trích xuất khung thủ công

Hạn chế video hiện tại của Claude

Tính đến đầu 2026, mô hình Claude không hỗ trợ đầu vào video trực tiếp qua API. Bạn có thể tải ảnh (bao gồm khung trích xuất từ video), nhưng không có khả năng xử lý video gốc tương tự Gemini.

Claude có thể làm:

- Phân tích chuỗi khung được tải lên, tương tự phương pháp trích xuất thủ công (Phương pháp 2)

- Cung cấp mô tả chi tiết nội dung thị giác trong mỗi khung

- Suy luận về chuyển động ngụ ý hoặc thay đổi giữa khung khi được nhắc tường minh

- Xử lý chuỗi ảnh dài hơn nhờ cửa sổ ngữ cảnh mở rộng (tới 1M token trong Claude Opus 4.7)

Claude không thể làm:

- Nhận tệp video trực tiếp qua bất kỳ giao diện nào

- Tự động theo dõi chuyển động hoặc đối tượng qua khung nếu không có hướng dẫn từng khung

- Phiên âm âm thanh — cần tiền xử lý riêng bằng Whisper hoặc dịch vụ tương tự, rồi truyền phiên âm cho Claude

Khi vẫn chọn Claude:

- Quy trình của bạn đã bao gồm bước trích xuất khung như tiền xử lý

- Bạn phân tích video dài cần nhiều khung và cần cửa sổ ngữ cảnh lớn của Claude

- Bạn so sánh chất lượng phân tích thị giác và thấy mô tả khung của Claude chính xác/chi tiết hơn cho miền của bạn (ví dụ: hình ảnh y tế, sơ đồ kỹ thuật)

- Bạn cần kết hợp phân tích khung video với lượng lớn thông tin ngữ cảnh khác

Bảng so sánh khả năng

| Tính năng | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Tải tệp video trực tiếp | ✓ (giao diện web/app) | ✓ (API + giao diện web) | ✗ |

| Theo dõi chuyển động gốc | ✗ | ✓ | ✗ |

| Phiên âm âm thanh | ✓ (tích hợp Whisper) | ✓ (tích hợp) | ✗ (cần công cụ ngoài) |

| Phân tích dựa trên khung | ✓ | ✓ (cũng xử lý liên tục) | ✓ (chỉ trích xuất thủ công) |

| Phát hiện chuyển cảnh | ✗ (chỉ thủ công) | ✓ (tự động) | ✗ |

| Xử lý độ dài video điển hình | ~5–10 phút (giới hạn ngữ cảnh) | ~1 giờ (phụ thuộc độ phân giải) | N/A (số khung bị giới hạn bởi ngữ cảnh) |

| Trường hợp dùng tốt nhất | Tóm tắt nhanh, phân tích cấp khung có chút kiểm soát | Theo dõi chuyển động, lập luận theo thời gian, video liên tục | Mô tả từng khung sâu với nhu cầu ngữ cảnh lớn |

| Hỗ trợ video qua API | ✗ (chỉ ảnh) | ✓ | ✗ |

Khung ra quyết định:

- Chọn ChatGPT khi: Bạn cần tóm tắt video nhanh, thông tin quan trọng tồn tại qua nhiều khung, làm việc với clip ngắn (dưới 10 phút), và không cần theo dõi chuyển động. Phù hợp cho nội dung giáo dục, demo sản phẩm tĩnh, phiên âm cuộc họp.

- Chọn Gemini khi: Trường hợp sử dụng cần theo dõi chuyển động, phát hiện chuyển cảnh, hoặc lập luận theo thời gian về cách phần tử di chuyển/thay đổi theo thời gian. Quan trọng với cảnh giám sát, thể thao, đánh giá animation, hoặc bất kỳ tình huống nào “những gì xảy ra giữa các khung” là mấu chốt.

- Chọn Claude khi: Quy trình của bạn đã có bước trích xuất khung, cần phân tích nhiều khung với lượng ngữ cảnh bổ sung lớn, hoặc thấy mô tả thị giác của Claude chính xác hơn cho miền của bạn. Yêu cầu tiền xử lý nhiều nhất nhưng cung cấp cửa sổ ngữ cảnh lớn nhất.

Với nhà phát triển làm việc trên nhiều mô hình, CometAPI cung cấp giao diện thống nhất để thử chất lượng xử lý video giữa GPT, Gemini, và Claude mà không phải viết lại mã tích hợp — hữu ích khi so sánh chất lượng đầu ra trước khi cam kết với nhà cung cấp cụ thể.

Câu trả lời thực cho “ChatGPT có xem được video không” không phải nhị phân. Đó là “có, bằng cách chuyển đổi video thành những định dạng nó đã xử lý được — với hạn chế phá vỡ một số trường hợp sử dụng.” Hầu hết thất bại triển khai đến từ sai lệch kiến trúc, không phải thiếu năng lực. Mô hình hoạt động đúng như thiết kế; các nhà phát triển chỉ kỳ vọng một thiết kế khác.

Nếu bạn xây tính năng phân tích video ở quy mô lớn, hãy thử quy trình với trường hợp biên trước: tải cùng video qua tệp trực tiếp, khung trích xuất thủ công, và chỉ phiên âm. So sánh đầu ra. Phương pháp bắt được tín hiệu mấu chốt của trường hợp sử dụng — không phải phương pháp nhanh nhất để triển khai — mới là phương pháp tồn tại qua tải sản xuất.

Trước khi cam kết dùng ChatGPT cho video:

- Xác định liệu thông tin quan trọng nằm trong khung ổn định, chuyển động, hay âm thanh

- Kiểm tra độ phủ lấy mẫu khung bằng cách trích xuất thủ công theo khoảng bạn kỳ vọng

- Xác minh văn bản trên màn hình đọc được ở độ phân giải video sau nén

- Xác nhận độ dài video phù hợp giới hạn ngữ cảnh thực tiễn cho gói của bạn

- Có phương án dự phòng cho nội dung xuất hiện ngắn ngủi hoặc giữa các khung được lấy mẫu

Với nhà phát triển đánh giá nhiều nhà cung cấp AI cho khối lượng công việc video, CometAPI cung cấp playground thống nhất để thử ChatGPT, Gemini, và Claude với cùng đầu vào video — cho phép bạn so sánh chất lượng đầu ra, độ trễ, và chi phí trước khi xây tích hợp riêng theo nhà cung cấp.

FAQ - Hướng dẫn phân tích video bằng AI

Câu trả lời nhanh cho các câu hỏi thường gặp về phân tích video bằng AI.

ChatGPT có thể phân tích video không?

Có, ChatGPT (GPT-4o và mới hơn) có thể phân tích video bằng cách lấy mẫu khung (~1 khung/giây) và phiên âm âm thanh. Nó hoạt động tốt cho tóm tắt cuộc họp, trích xuất văn bản từ slide, và nhận diện đối tượng. Tuy nhiên, nó gặp khó với theo dõi chuyển động, video trên 10 phút, và phát trực tuyến thời gian thực.

Tôi tải video lên ChatGPT như thế nào?

Tải bằng URL trực tiếp (Khuyến nghị): Tải qua URL công khai để phân tích nhanh. Tốt nhất cho video dưới 10 phút.

Trích xuất khung thủ công: Trích xuất khung cụ thể để kiểm soát chính xác. Tốt nhất khi bạn cần phân tích khoảnh khắc cụ thể hoặc giảm chi phí token.

Độ dài video tối đa ChatGPT xử lý được là bao nhiêu?

ChatGPT xử lý ổn định video đến 5–10 phút. Vượt quá, bạn cần phân đoạn video hoặc chuyển sang Gemini 2.5 Pro, hỗ trợ video gốc đến 60 phút.

Hạn chế phân tích video của ChatGPT là gì?

- Không thể theo dõi chuyển động liên tục (thể thao, khiêu vũ)

- Dấu thời gian không chính xác tuyệt đối (sai số ±1 giây)

- Bỏ lỡ nội dung xuất hiện dưới 1 giây

- Giới hạn thực tiễn 10 phút

- Không hỗ trợ phát trực tuyến thời gian thực

- Khó với video chất lượng thấp hoặc tối

- Yếu trong lập luận nhân–quả theo thời gian *

Tôi nên dùng ChatGPT hay Gemini để phân tích video?

Dùng ChatGPT cho:

- Video dưới 10 phút

- Lập luận văn bản vượt trội sau khi phân tích video

- Phân tích cấp khung (slide, ảnh chụp màn hình)

Dùng Gemini cho:

- Video dài 10–60 phút

- Theo dõi chuyển động và phân tích chuyển động

- Nhiệm vụ lập luận theo thời gian

- Cảnh thể thao, khiêu vũ, hoặc giám sát *

Claude có thể phân tích video không?

Không, Claude không hỗ trợ đầu vào video trực tiếp. Tuy nhiên, bạn có thể trích xuất khung từ video và phân tích bằng Claude, vốn cung cấp lập luận văn bản và cửa sổ ngữ cảnh lớn cho phân tích dài.

Phân tích video tốn bao nhiêu?

Chi phí tùy mô hình và độ dài video:

- ChatGPT 4o: ~$0.05 mỗi phút

- Gemini 2.5 Pro: ~$0.04 mỗi phút

CometAPI cung cấp tín dụng cho người dùng mới để bắt đầu.