DeepSeek đã chính thức giới thiệu trước V4 như một họ mô hình mã nguồn mở, và tiêu đề không chỉ là “một bản cập nhật mô hình nữa.” Công ty định vị V4 là một hệ thống ngữ cảnh dài, thân thiện với tác tử (agent), được xây cho khối lượng công việc thực tế: phân tích nặng tài liệu, trợ lý lập trình, agent tìm kiếm và tự động hóa nhiều bước. Bản phát hành đã hoạt động trên web, ứng dụng và API, và dòng V4 giới thiệu một cửa sổ ngữ cảnh 1M token hiệu quả về chi phí trên các dịch vụ chính thức của hãng.

Điều khiến lần ra mắt này đặc biệt đáng chú ý là sự kết hợp giữa quy mô và hiệu suất. DeepSeek cho biết V4-Pro có 1.6T tham số tổng với 49B đang hoạt động, trong khi V4-Flash có 284B tham số tổng với 13B đang hoạt động. Trong báo cáo kỹ thuật, DeepSeek cũng khẳng định kiến trúc V4 dùng cơ chế chú ý lai, định tuyến MoE và hậu huấn luyện nhằm cải thiện hành vi mang tính tác tử đồng thời cắt giảm gánh nặng tính toán của ngữ cảnh siêu dài.

DeepSeek V4 là gì?

DeepSeek-V4 là họ sản phẩm flagship preview mới nhất của công ty, và bản phát hành gồm hai biến thể công khai: V4-Pro và V4-Flash. DeepSeek mô tả V4-Pro là mô hình mạnh hơn về tri thức thế giới, toán, STEM, lập trình và coding mang tính tác tử, trong khi V4-Flash là lựa chọn phản hồi nhanh, hiệu quả chi phí nhưng vẫn giữ nhiều chất lượng suy luận và khả năng ngữ cảnh dài. V4-Pro dẫn đầu các mô hình mở hiện nay về coding tác tử và tri thức thế giới, còn V4-Flash được thiết kế cho tốc độ và triển khai kinh tế.

V4 sử dụng một kiến trúc chú ý lai kết hợp Compressed Sparse Attention (CSA) và Heavily Compressed Attention (HCA), cùng Manifold-Constrained Hyper-Connections và bộ tối ưu Muon. Công ty cũng cho biết các mô hình được tiền huấn luyện trên hơn 32T token và ở ngữ cảnh 1M, V4-Pro chỉ cần 27% FLOPs suy luận một token và 10% bộ đệm KV so với DeepSeek-V3.2. Câu chuyện hiệu suất đó mới là tiêu điểm thực sự phía sau lần ra mắt này.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro là mô hình flagship dành cho người dùng coi trọng chất lượng. DeepSeek-V4-Pro mang lại hiệu năng coding mang tính tác tử mạnh hơn, tri thức thế giới phong phú hơn và khả năng suy luận hàng đầu, và theo trang ra mắt thì nó dẫn trước các mô hình mở hiện tại, chỉ xếp sau Gemini-3.1-Pro về tri thức thế giới. Trong báo cáo kỹ thuật, V4-Pro là mô hình lớn hơn trong gia đình, và DeepSeek-V4-Pro khả dụng qua cùng các giao diện tương thích OpenAI và tương thích Anthropic như V4-Flash.

DeepSeek-V4-Flash

V4-Flash là mô hình ưu tiên hiệu quả; khả năng suy luận của nó tiến rất sát V4-Pro, và đạt ngang V4-Pro trên các tác vụ agent đơn giản, trong khi dùng ít tham số hoạt động hơn và phản hồi nhanh hơn; nó hỗ trợ cả chế độ suy nghĩ và không suy nghĩ, với cùng độ dài ngữ cảnh 1M và cùng các tính năng lõi như Pro, nhưng với chi phí thấp hơn nhiều.

Nên chọn cái nào?

Dùng V4-Pro khi tác vụ có rủi ro cao, nặng tri thức hoặc khó thẩm định: nghiên cứu doanh nghiệp, lập trình phức tạp, hỗ trợ quyết định nhiều bước, hoặc khi bạn muốn câu trả lời mạnh nhất có thể. Dùng V4-Flash khi thông lượng, độ trễ hoặc chi phí token quan trọng hơn việc vắt thêm vài điểm benchmark cuối cùng. Lựa chọn đó phù hợp với định vị chính thức và với khoảng cách benchmark được báo cáo giữa hai mô hình.

| Hạng mục | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Tổng số tham số | 284B | 1.6T |

| Tham số hoạt động | 13B | 49B |

| Độ dài ngữ cảnh | 1M | 1M |

| Chế độ suy luận | Không suy nghĩ + Suy nghĩ | Không suy nghĩ + Suy nghĩ |

| Phù hợp nhất | Suy luận nhanh, ứng dụng thông lượng cao, agent nhạy chi phí | Suy luận năng lực cao nhất, bài toán code và tri thức khó |

| Giá API chính thức | Cache hit $0.028 / cache miss $0.14 / output $0.28 mỗi 1M token | Cache hit $0.145 / cache miss $1.74 / output $3.48 mỗi 1M token |

| Đầu ra tối đa | 384K | 384K |

CometAPI cung cấp quyền truy cập vào Deepseek v4 Pro và V4 Flash,— rẻ hơn 20% so với chính thức — cùng khả năng chuyển đổi liền mạch giữa 500+ mô hình (GPT-5.4, Gemini 3.1, v.v.) qua một endpoint tương thích OpenAI hoặc Anthropic Messages duy nhất.

Hiệu năng benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Trong bảng so sánh mô hình base, V4-Flash và V4-Pro đều vượt DeepSeek-V3.2 trên các benchmark cốt lõi, với V4-Pro thường dẫn đầu. Ví dụ, báo cáo liệt kê các điểm số sau: AGIEval 82.6 / 83.1 so với 80.1 của V3.2; MMLU 88.7 / 90.1 so với 87.8; MMLU-Pro 68.3 / 73.5 so với 65.5; HumanEval 69.5 / 76.8 so với 62.8; và LongBench-V2 44.7 / 51.5 so với 40.2 của V3.2, trong đó số ở giữa là V4-Flash và số cuối là V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Nguồn: Báo cáo kỹ thuật DeepSeek-V4, Bảng 1.

Mẫu hình rất rõ ràng: Flash thu hẹp khoảng cách với Pro, nhưng Pro vẫn là mô hình tổng quát mạnh hơn. Điều đó khiến V4-Flash trở thành mặc định thực dụng cho nhiều hệ thống sản xuất, còn V4-Pro là mô hình nên chọn khi chất lượng câu trả lời quan trọng hơn chi phí hoặc độ trễ.

So sánh với mô hình phương Tây: V4 ở đâu

Trong một đánh giá con người về các nhiệm vụ nhân viên văn phòng tiếng Trung, báo cáo cho biết DeepSeek-V4-Pro-Max vượt Claude Opus 4.6-Max, với tỷ lệ không thua 63%. DeepSeek-V4-Pro “vượt trội đáng kể” Claude Sonnet 4.5 và tiến gần Claude Opus 4.5 trên một benchmark coding R&D.

| Khu vực đánh giá | Kết quả DeepSeek | So sánh với mô hình phương Tây | Gợi ý điều gì |

|---|---|---|---|

| Nhiệm vụ văn phòng tiếng Trung | V4-Pro-Max, tỷ lệ không thua 63% | so với Claude Opus 4.6-Max | Thể hiện mạnh ở các tác vụ kiểu doanh nghiệp thực tế |

| Benchmark coding R&D | V4-Pro-Max pass rate 67 | so với Claude Sonnet 4.5 ở 47; Opus 4.5 ở 70; Opus 4.6 Thinking ở 80 | Cạnh tranh với các mô hình tuyến đầu, đặc biệt so với các hệ Sonnet |

Không phải “số một ở mọi khía cạnh”, nhưng đã ở mức “phải được đánh giá nghiêm túc”.

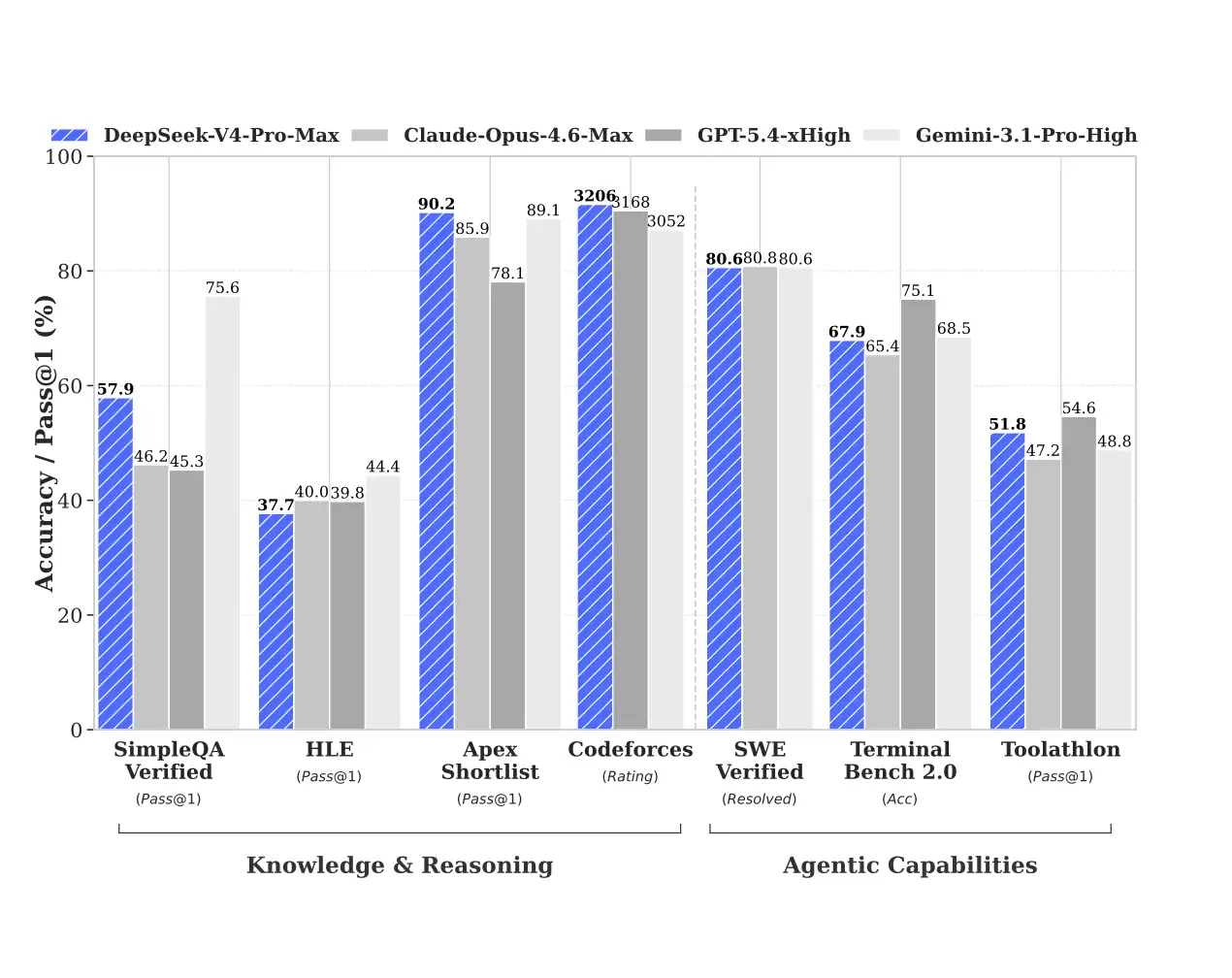

Báo cáo kỹ thuật của DeepSeek so sánh V4-Pro-Max với Claude Opus 4.6 Max, GPT-5.4 xHigh và Gemini 3.1 Pro High trong cùng một bảng. Kết quả không đơn giản: các mô hình đóng nguồn của phương Tây vẫn rất mạnh ở một số phương diện tri thức và suy luận; tuy nhiên, V4-Pro-Max có hiện diện rất mạnh ở code, ngữ cảnh dài và một số tác vụ agent. Nói cách khác, không còn là câu chuyện một chiều kiểu “phương án thay thế nội địa”, mà đã bước vào giai đoạn “mô hình nào phù hợp hơn với kịch bản của bạn”.

Về năng lực tri thức và suy luận, nó ngang tầm với Opus 4.6 Max, GPT-5.4 xHigh và Gemini 3.1 ProHigh. Tuy vậy, nó hơi kém một chút về khả năng tác tử, dù khoảng cách không lớn.

DeepSeek-V4-Pro-Max rất cạnh tranh trong các kịch bản thiên về code và ngữ cảnh dài, trong khi các mô hình phương Tây vẫn cực kỳ mạnh trên một số benchmark suy luận thuần túy và tri thức. Đó là cách đúng để đọc về bản phát hành này: DeepSeek V4 đã đứng vững trong cuộc đua tuyến đầu, nhưng vị thế dẫn đầu benchmark vẫn phụ thuộc vào từng nhiệm vụ.

Cách truy cập DeepSeek V4

1) Dùng web và ứng dụng chính thức

DeepSeek cho biết V4 Preview hiện có sẵn ngay trên web, ứng dụng và API. Với người dùng thông thường, con đường đơn giản nhất vẫn là giao diện chat chính thức, nơi có thể truy cập mô hình qua Expert Mode hoặc Instant Mode.

2) Dùng API

Tôi rất khuyến nghị CometAPI để truy cập DeepSeek V4, vì nó mang lại mức giá tốt nhất và lợi thế tổng hợp.

Tên mô hình là:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek cũng cho biết các tên cũ

deepseek-chatvàdeepseek-reasonersẽ bị loại bỏ và hiện ánh xạ tới chế độ không suy nghĩ và suy nghĩ của V4-Flash cho đến 2026-07-24. Điều đó quan trọng cho kế hoạch di trú nếu bạn đã có tích hợp cũ trong sản xuất.

- Đăng ký tại CometAPI và lấy API key của bạn.

- Dùng OpenAI Python SDK tiêu chuẩn (hoặc bất kỳ client tương thích nào) với base URL tùy chỉnh:

Dưới đây là một ví dụ gọn theo định dạng tương thích OpenAI chính thức:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Mẫu yêu cầu này tuân theo hướng dẫn khởi động nhanh: đặt base URL, chọn deepseek-v4-pro hoặc deepseek-v4-flash, và bật thinking khi bạn cần suy luận sâu hơn.

Cách sử dụng DeepSeek V4 hiệu quả

Với quy trình tài liệu dài, mẫu hiệu quả nhất là giữ ngữ cảnh sạch và có cấu trúc. Cửa sổ 1M token của V4 là một lợi thế lớn, nhưng mô hình vẫn hoạt động tốt nhất khi đầu vào được tổ chức theo phần, trích đoạn nguồn, hướng dẫn tác vụ và ràng buộc đầu ra rõ ràng. Đó là cách tự nhiên nhất để khai thác khả năng ngữ cảnh dài mà DeepSeek đang quảng bá.

Với quy trình code và agent, hãy bắt đầu với V4-Flash để lặp nhanh, rồi nâng lên V4-Pro cho lần chạy cuối hoặc các bước khó nhất. Cách tiếp cận này khớp với định vị chính thức: Flash là lựa chọn hiệu quả, Pro là mô hình mạnh hơn, và cả hai cùng chia sẻ bề mặt API và độ dài ngữ cảnh.

Lời cuối

DeepSeek-V4 đáng chú ý vì nó kết hợp cùng lúc bốn điều mà thị trường đang yêu cầu: ngữ cảnh dài, suy luận mạnh, mở và giá tích cực. Câu chuyện thực sự không chỉ là DeepSeek ra mắt thêm một mô hình. Mà là công ty đang cố biến AI tuyến đầu trở nên khả dụng về kinh tế trong sản xuất. Với các đội đang đánh giá khoản đầu tư AI tiếp theo, đó là một tín hiệu đáng để thử nghiệm, không nên bỏ qua.

Với các đội xây dựng đa nhà cung cấp, đây chính là kiểu bản phát hành đáng để benchmark ngay trong ngăn xếp của bạn. CometAPI có thể là lớp thực dụng để so sánh DeepSeek-V4 song song với các mô hình tuyến đầu khác mà không buộc đội sản phẩm phải xây lại tích hợp mỗi khi thị trường dịch chuyển.