快速解答:2026 年開發者應優先選擇哪個 AI 模型?

若任務需要最大化自主推理且盡量降低幻覺,應選擇 GPT-5.5 (xhigh),其以 60 的智能指數領先市場。需要即時互動的應用應使用 Mercury 2,目前的速度領先者,吞吐約 859 tokens/s。若是以預算為主要考量的大規模生產,DeepSeek V4 Pro 與 Kimi K2.6 以約為旗艦專有模型 10% 的成本,提供接近前沿的智能水準。

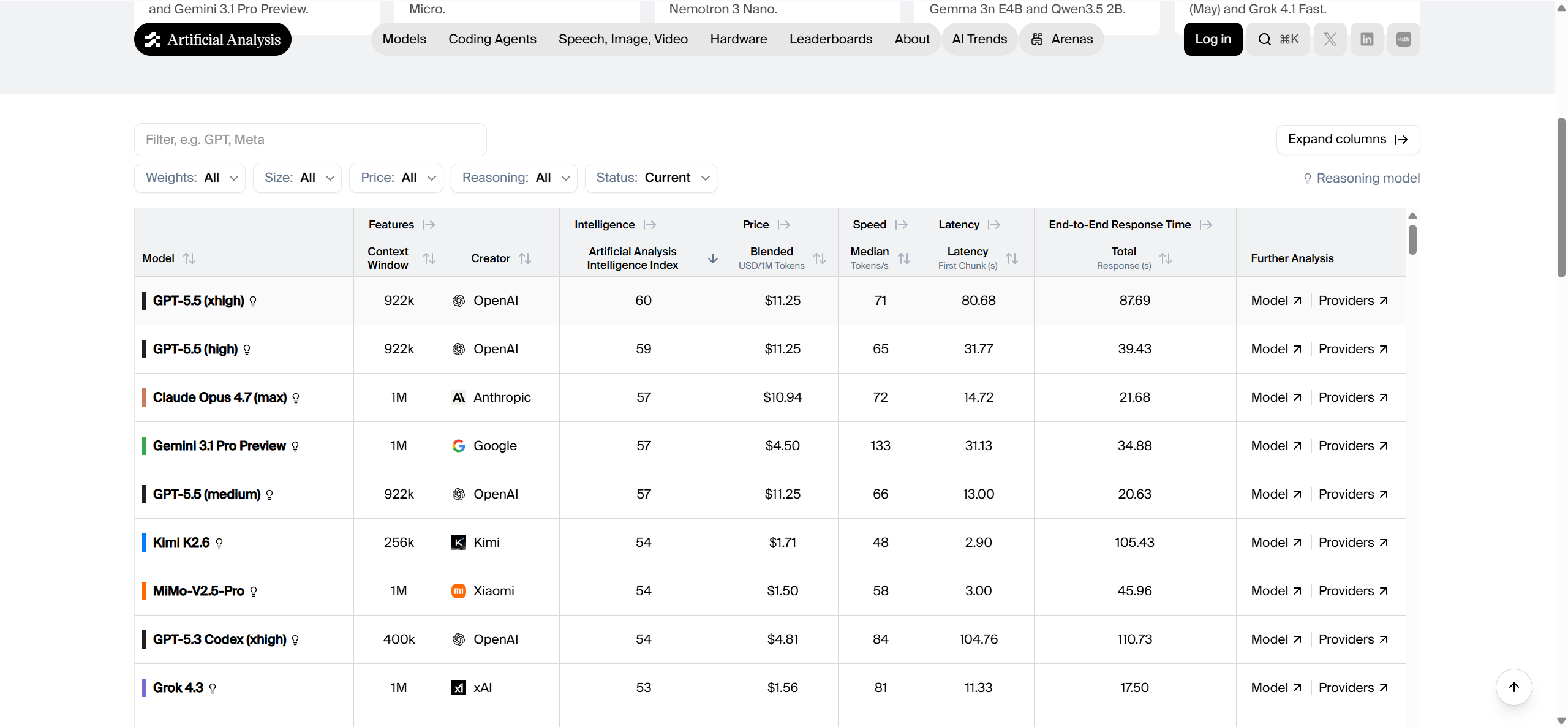

智能指數:前沿模型排名

2026 年的 AI 版圖已從追逐參數量轉向優化「思考密度」。人工分析智能指數 v4.0(Artificial Analysis Intelligence Index v4.0) 已成為量化模型能力的業界標準,涵蓋包含專業級程式開發與極限邏輯推演在內的十個專項維度。

| 模型 | 智能指數 | 上下文視窗 | 最佳使用情境 |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | 科學研究與邏輯 |

| GPT-5.5 (high) | 59 | 922K | 專業級程式開發 |

| Claude Opus 4.7 (max) | 57 | 1M | 自主代理與規劃 |

| Gemini 3.1 Pro | 57 | 1M - 2M | 多模態資料綜合 |

| Kimi K2.6 | 54 | 256K | 以終端機為主的代理型工作 |

| MiMo-V2.5-Pro | 54 | 1M | 全端軟體工程 |

| DeepSeek V4 Pro (Max) | 52 | 1M | 可擴展的推理工作流程 |

| GLM-5.1 | 51 | 200K | 長時程自主任務 |

如何閱讀此表

在前五名模型中,有三款為 GPT-5.5 系列、GPT-5.5 Medium、Claude Opus 4.7 與 Gemini 3.1 Pro。這三款西方旗艦模型勢均力敵,而兩款中國模型 Kimi K2 與 mimo-v2.5 pro 以極具競爭力的價格提供可與西方頂級模型相當的表現。

人工分析智能指數是一個經正規化的指標,來源於如 Terminal-Bench Hard 與 IFBench 等獨立評測。一分之差代表模型「自主門檻」上的統計顯著差距。例如,GPT-5.5(60)與 Claude Opus 4.7(57)之間的 3 分差,往往意味著前者可獨立完成複雜的邏輯鏈,而後者可能每隔幾步就需要人類介入。較高的指數分數通常與在「人類最後的考試」中更高的成功率,以及在代理環境中較低的工具調用錯誤相關。

反應力:延遲與生成速度

對於互動型軟體——從即時 IDE 助手到面向客戶的語音代理——原始智能次於「首字延遲(TTFT)」與「生成吞吐(Generation Throughput)」。

最高吞吐(Throughput)前 5 名

吞吐衡量模型在初始處理階段之後生成文本的速度。高吞吐對長篇內容生成與快速程式碼重構至關重要。

- Mercury 2:約 859 tokens/s

- Granite 4.0 H Small:約 407 tokens/s

- Granite 3.3 8B:約 365 tokens/s

- Gemini 3.1 Flash-Lite****:約 331 tokens/s

- Qwen3.5 0.8B:約 287 tokens/s

最低延遲(TTFT)前 5 名

延遲表示第一個 token 抵達使用者前的等待時間。這是 UI/UX 中「體感」與回應速度的關鍵指標。

- NVIDIA Nemotron 3 Nano:約 0.40s

- Ministral 3 3B:約 0.47s

- Qwen3.5 0.8B:約 0.52s

- LFM2 24B A2B:約 0.55s

- Grok 3 mini Reasoning:約 0.58s

2026 年如何選擇你的模型

選擇模型需要在「智能/美元」比與應用的特定可用性需求之間取得平衡。2026 年的市場已分化為三條明顯的架構路徑。

獨立開發者與預算敏感團隊

對於單人開發者或小團隊在大量實驗性代理循環中的需求,DeepSeek V4 Pro 是最佳戰略選擇。它採用 1.6T 參數的 Mixture-of-Experts(MoE)架構,每個 token 僅啟用 49B 個參數,能以約 $0.416/百萬 token 的成本提供旗艦級表現。另一個針對程式開發任務的優秀選項是 Kimi K2.6,專精於以終端機為先的工作流程。這些模型以約 70-80% 的成本節省,提供接近 90% 的高階推理能力,實際上延長了新創的資金續航。

企業級生產環境

在全公司部署、穩定性與嚴格遵循複雜系統提示不可妥協的情境下,業界標準仍是 GPT-5.5 Pro 與 Claude Opus 4.7。GPT-5.5 Pro 為高風險精準度而設計,特別擅長投行建模與科學探索等錯誤成本遠高於 API 成本的領域。對於需要在多日專案中維持穩定可靠性的團隊,Claude Opus 4.7 更受青睞,其在終端環境中的幻覺率顯著低於更廣泛的 GPT 家族。企業通常透過 CometAPI 將這些模型整合至單一閘道,確保 99.9% 正常運行時間,並在主要供應商出現區域性延遲尖峰時即時故障切換。

即時互動型應用

諸如即時客服機器人或即時影片字幕的應用,需要給人「流暢」且幾乎瞬時的體驗。在此類別中,Mercury 2 與 Gemini 3.1 Flash-Lite 是更優選。Mercury 2 的吞吐幾乎是標準推理模型的十倍,非常適合即時文件撰寫。Gemini 3.1 Flash-Lite 則在多模態能力上取得平衡,以約先前世代 2.5x 的速度在單一上下文中處理文字、音訊與影像,同時支援 100 萬 token 的上下文視窗。

上下文視窗:從片段到整個儲存庫

上下文視窗相當於模型的「短期記憶」。到了 2026 年,業界分化為標準視窗(128K)與儲存庫尺度的容量(1M-10M)。

- Llama 4 Scout:10,000,000 tokens

- Grok 4.20:2,000,000 tokens

- Gemini 3.1 Pro:約 1,048,576 tokens

- DeepSeek V4 Pro:1,000,000 tokens

- GPT-5.5 Pro:1,050,000 tokens

何時上下文大小很重要?

對於像 DeepSeek-V3.2 這類模型而言,128K 上下文視窗 已成為基礎——足以處理一般對話與單篇文章摘要。然而,專業軟體工程需要「整體系統」的全局意識。

100 萬 token 的視窗 允許 AI 代理在一次前向傳遞中攝取整個軟體儲存庫,包括所有原始碼檔案、文件與歷史日誌。這可避免傳統 RAG 系統在分塊過程中可能遺漏相關資料所造成的「記憶漂移」。具體例子是程式碼庫重構:擁有 1M tokens 能力的模型可以理解核心資料庫結構變更如何影響分散在不同檔案的五十個 API 端點;而較小模型可能一次只能「看到」少數檔案,導致依賴關係斷裂。

經濟比較:每 100 萬 token 的單位價格

下表使用 綜合 USD/每 1M tokens 指標,假設輸入:輸出 token 比為 3:1,以反映真實使用模式。

| 模型 | 綜合價格(每 1M) | 相對價值 | 透過 CometAPI 的折扣 |

|---|---|---|---|

| GPT-5.5 (xhigh) | 約 $11.25 | 高端 | 20% OFF |

| Claude Opus 4.7 (max) | 約 $10.00 | 高 | 20% OFF |

| Gemini 3.1 Pro | 約 $4.50 | 均衡 | 20% OFF |

| Kimi K2.6 | 約 $1.71 | 高性價比 | 20% OFF |

| DeepSeek V4 Pro | 約 $0.53 | 極致性價比 | 20% OFF |

| Qwen3.5 0.8B | 約 $0.02 | 工具型 | 20% OFF |

所有價格已於 2026 年 5 月驗證。官方供應商掛牌價通常比 折扣價 (透過統一閘道提供)高出 20%。

成本最佳化策略

為協助架構規劃,我們對三種常見成長層級的月度支出進行了估算。

- 小型開發團隊(每月 10M tokens):主要使用 Kimi K2.6 進行功能開發,並以 DeepSeek V4 Flash 處理簡單邏輯,月費約 $15 至 $40。這允許在不超過標準 SaaS 訂閱的財務負擔下進行積極原型設計。

- 中型 SaaS(每月 100M tokens):以 Claude Sonnet 4.6 與 Gemini 3.1 Flash 擴展 AI 驅動的自動化平台,月費約 $250 至 $550。透過這些模型可用的提示快取(prompt caching),實際成本常可再降低 15%。

- 大型企業(每月 1B tokens):以 GPT-5.5 與 Claude Opus 4.7 執行高並發代理型工作流程的全球企業,月費可能落在 $3,000 至 $6,500。在此規模下,透過統一 API 閘道整合對於集中計費與避免管理多家供應商合約的額外負擔至關重要。

結論:2026 年的選擇路徑

「萬用模型」的時代已經結束。現代 AI 架構需要協同一支專用模型艦隊:高計算推理用 GPT-5.5、即時互動用 Mercury 2、高流量執行用 DeepSeek V4。透過一次整合 CometAPI,開發者在基準更新時可便捷置換模型,同時為每筆請求鎖定永久 20-40% 的折扣。

常見問題

目前哪個 AI 模型最智能?

根據 Artificial Analysis Intelligence Index v4.0,GPT-5.5 (xhigh) 以 60 分為目前最智能的模型,其次是 GPT-5.5 (high) 的 59 分與 Claude Opus 4.7 (max) 的 57 分。

即時應用中最快的 AI 模型是什麼?

Mercury 2 是 2026 年的速度冠軍,吞吐約 859.1 tokens/s。若看首字延遲(TTFT),NVIDIA Nemotron 3 Nano 以約 0.40 秒領先。

生產級代理需要多高的智能指數分數?

對於基本自動化或分類,介於 30 到 40 分(如 GPT-5.4 nano)通常足夠。然而,若是「Agentic Engineering」——由 AI 管理程式碼庫或完整的瀏覽器工作階段——建議使用 54 分以上(如 Kimi K2.6 或 GPT-5.5),以確保長時程規劃的一致性。

在價格相近時,我該選 GPT-5.5 還是 Claude Opus 4.7?

若你的流程涉及終端執行與「Vibe Coding」,GPT-5.5 通常在這些基準上表現更佳。但若你需要在專業寫作、法務研究或低幻覺率的多日代理循環中維持極高一致性,Claude Opus 4.7 是文獻記錄中的領先者。

開放權重(DeepSeek)與專有模型之間的實際性能差距是多少?

到 2026 年,在原始推理基準上的差距約縮小至 10-15%。雖然像 GPT-5.5 (xhigh) 這樣的專有旗艦在「峰值」邏輯上仍領先(指數 60),但開放權重模型如 DeepSeek V4 Pro(指數 52)與 Kimi K2.6(指數 54)以約 1/10 的成本提供超過 85% 的能力。

我該如何降低這些模型的整體 API 成本?

使用像 CometAPI 這樣的統一 API 層,可透過批量採購與智慧路由,以比官方價格低 20% 至 40% 的費率存取完整型錄。

哪個模型擁有處理長文件的最大上下文視窗?

Llama 4 Scout 目前以 1,000 萬 tokens 的上下文視窗居冠。Grok 4.20 以 200 萬 tokens 其次,而 GPT-5.5 Pro、Gemini 3.1 Pro 與 DeepSeek V4 Pro 均支援約 100 萬 tokens。

有沒有在初期成本不高的情況下測試這些基準的方法?

有。你可以在 CometAPI 註冊免費帳號,無需信用卡即可獲得測試點數,並在內建的 Playground 中對超過 500 種模型進行比較效能測試。