重點摘要(TL;DR): OpenClaw 近期版本新增對 OpenAI 的 GPT-5.4 的一等公民、前向相容支援,並引入「記憶熱插拔」架構,讓 OpenClaw 代理可在執行時以最小中斷切換使用中的模型與記憶儲存。這解鎖了大上下文工作流程(GPT-5.4 擴大的上下文視窗)、即時模型專業化,以及面向生產代理的成本/延遲最佳化。升級已在 OpenClaw 的發佈與隨附文件中提供;以下範例展示實用的設定、程式碼片段、基準背景與建議最佳實踐。

OpenClaw 這次更新實際交付了什麼(快速摘要)

在 2026 年 3 月 9 日,開源代理框架、與 OpenAI 生態相近的專案 OpenClaw 發佈了主要核心版本(2026.3.7),新增對 GPT-5.4 的一等公民支援,並在其上下文引擎中加入新穎的「記憶熱插拔」機制。此版本將一個廣泛使用的實驗性代理框架轉化為維護者所描述的「Agent Operating System」,旨在讓生產級代理工作流程與模型切換對開發者與團隊更為無縫。

3 個對代理開發者重要的實務重點:

- 一等公民的 GPT-5.4 支援 — 透過模型別名與供應商對應,讓代理可選擇 GPT-5.4 作為主要執行模型(包含通道覆寫與每代理的模型釘選)。

- 上下文引擎與分散式通道綁定 — 改進 OpenClaw 如何從記憶、工具輸出與通道歷史組裝長上下文,讓高容量模型獲得良好結構的輸入。

- 記憶熱插拔架構 — 更清晰的記憶外掛介面與流程,讓你在不丟失「身分」或破壞持久狀態的前提下替換記憶後端或升級代理(記憶本身仍是單一真實來源)。OpenClaw 的記憶設計(純 Markdown 檔、索引搜尋、外掛式檢索)正是安全熱插拔的關鍵。

GPT-5.4 — 何為 GPT-5.4 與基準突破

GPT-5.4 是 OpenAI 最新的前沿模型發佈,重點聚焦於「專業生產力」(試算表、文件與簡報編輯、多步推理與工具驅動)。根據 OpenAI 與獨立媒體的報導,該版本強調:

- 擴大上下文:GPT-5.4 引入下一級別的上下文視窗,提供實驗性的 1M token 與改進的長上下文處理,透過 Codex/Codex 相容端點提供——像是

model_context_window與model_auto_compact_token_limit等設定旋鈕向開發者開放。這讓你能將更大規模的對話狀態、文件與程式碼庫維持在活躍上下文中。 - 更高的試算表與推理準確度 — OpenAI 報告在試算表建模任務上大幅提升(其銀行/分析師試算表基準:GPT-5.4 平均分數約 ~87% 對比 GPT-5.2 的 ~68%)。

- 準確性與事實性改進:早期評測與 QA 顯示相較 GPT-5.2,幻覺減少約 ~33%,在文件撰寫與試算表工作中降低易錯輸出。評論者也指出某些生產力任務上的易錯回應下降約 ~18%。

- 內建電腦操作與 Codex 系譜的改進 — GPT-5.4 承襲 Codex 系譜能力,提升程式碼生成、互動除錯與操作型工具驅動(部分展示包含滑鼠/鍵盤/截圖自動化)。這使其更擅長代理循環中常見的「寫-跑-檢-補」週期。

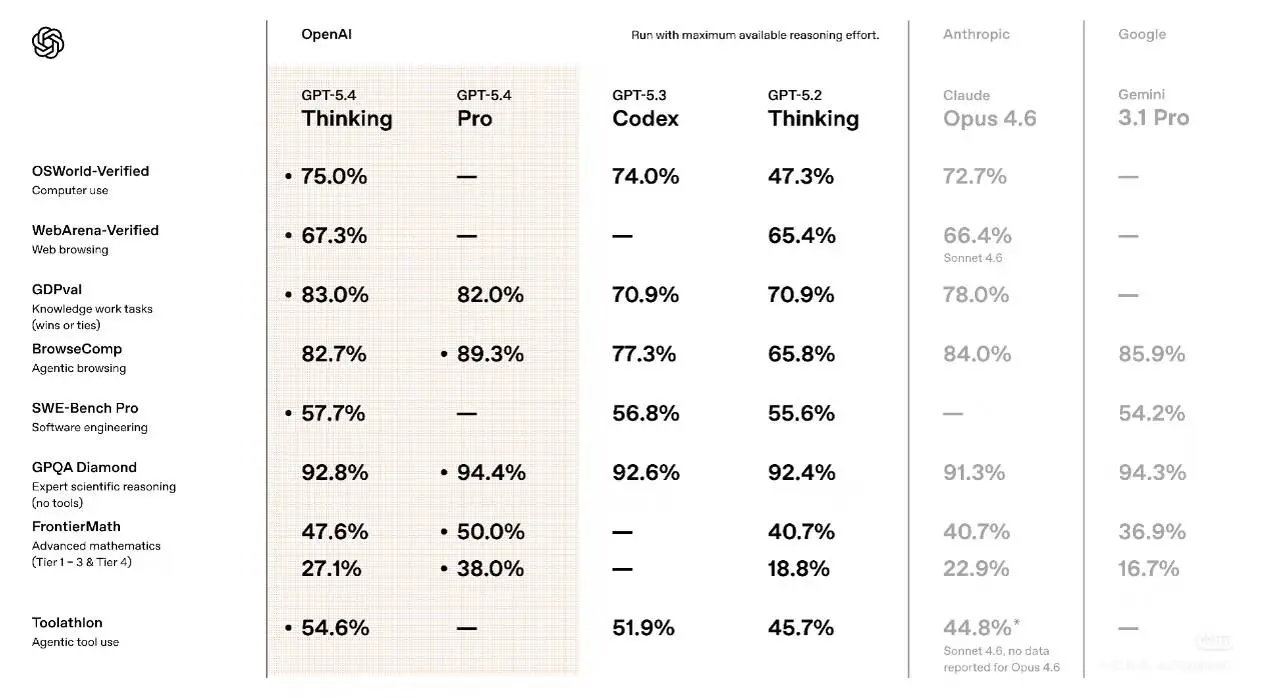

基準與比較脈絡(這些數字代表什麼)

- 試算表建模:OpenAI 內部試算表基準:GPT-5.4 平均約 ~87.3%,GPT-5.2 約 ~68.4%。這是廠商用以展示任務特定提升的標題數字。

- 電腦互動(OSWorld/代理風格測試):獨立測試者與社群執行顯示,GPT-5.4 在涉及桌面或模擬 UI 操作的代理互動任務上有所提升,部分情境下小幅超越近期的 Anthropic 模型變體(對代理而言差異有意義,但不一定在所有工作負載上決定勝負)。

解讀:GPT-5.4 並非「萬靈丹」。它在整合工具使用、程式碼執行模式與試算表推理上有明確長處——這正是 OpenClaw 代理常見的工作負載。對代理開發者而言,改進的執行器可靠性(Codex 系譜)+ 規劃能力 + 更佳的長上下文處理,極具相關性。

OpenClaw 已支援 GPT-5.4:變更內容與重要性

OpenClaw 的發佈(見專案發佈頁)更新了模型解析器與執行時,以「前向相容」支援 GPT-5.4 擴大的上下文與 token 上限,並新增「記憶熱插拔」能力,讓代理能在執行時切換記憶後端或模型。這透過三個具體方式達成:1)更新模型中繼資料與解析器以接受更大的上下文與 token 上限;2)代理執行時調整以協調優雅的模型切換與快取預熱;3)提供記憶 API,允許多個記憶通道與熱切換觸發。

版本 2026.3.7 對 GPT-5.4 的支援,加上記憶熱插拔設計,帶來兩個實用且互補的優勢:

- 直覺的模型升級路徑。OpenClaw 現可將 GPT-5.4 作為可選「執行時」呈現給代理,使你能從舊版 GPT-5.x 或其他供應商平滑切換,而不需重做代理邏輯。此更新在核心中明確宣告對 GPT-5.4 的穩定整合。

- 記憶熱插拔。OpenClaw 的上下文引擎不再只持久化單一線性記憶快照,而是允許在執行時卸載、替換或遷移記憶分區——例如:為除錯切入高召回的向量資料庫分片,或為外部稽核切換至 GDPR 淨化的記憶變體——無需停止代理。這降低生產中斷風險,並使特定用例(除錯/隱私/效能)下的記憶設定成為可能。

實務效能突破與優勢

OpenClaw 的整合聚焦 GPT-5.4 擅長的三個實務面:

- 工具協作保真度。GPT-5.4 改進的內部工具搜尋與推理降低工具呼叫震盪(更少冗餘呼叫與重試)。這轉化為較低的 API 呼叫數與較快的複雜流程完成時間。早期回報顯示相較舊版 GPT-5.x,token 與工具呼叫效率皆有提升。

- 更長且更豐富的上下文處理。OpenClaw 代理現在可保留更大的活躍上下文(包含被交換進來的記憶分片),使其能維持長對話、多檔專案與反覆除錯而不丟失狀態。

- 更具決定性的程式碼輸出。對自動生成程式碼(CI hooks、函式存根、基礎設施樣板)的工作流程,GPT-5.4 更常產生可執行且一致的輸出,降低人工審閱負擔。獨立測試顯示其程式碼品質指標較先前 GPT-5 模型顯著改善。

- 記憶延續性 ——「記憶熱插拔」讓你可替換或增補記憶存放(本地快取、向量 DB、LLM 記憶)而不丟失代理狀態或上下文,支持 A/B 測試、滾動升級與故障切換。

在 OOLONG 基準測試中,新版 OpenClaw 結合 lossless-claw 外掛,取得 74.8 的高分,遠遠拋離 Claude Code(70.3 分)。尤其在上下文長度增加時表現出穩定與精準,讓現場測試的工程師直呼「說它表現良好都太保守了」。

如何在 OpenClaw 中設定與使用 GPT-5.4(逐步指南)

一個使用 GPT 5.4 的簡單 OpenClaw 工作流程:

- 典型配置如下:

- 使用者透過 Discord 或 Telegram 等平台發送訊息。

- OpenClaw 經由其閘道伺服器接收訊息。

- 閘道透過 AI API 供應商將提示轉發至 GPT 5.4。

- GPT 5.4 產生回應或觸發工具動作。

- OpenClaw 將最終結果回傳給使用者。

以下是務實、可直接複製貼上、並可安全重現的配置範例與工作流程,用於在 OpenClaw 中運行 GPT-5.4。這些設定刻意保守:先在測試代理啟用模型,並對一切進行度量與錯誤監控。

先決條件

- OpenClaw 已升級至包含 GPT-5.4 對應的發佈版本(見上述發佈說明)。

- 具備可存取 GPT-5.4 的有效 OpenAI API 金鑰(我選擇較便宜的 CometAPI 端點)。

1) 模型選擇與解析器設定(JSON / YAML / CLI)

將以下內容寫入 ~/.openclaw/openclaw.json(或合併進你既有的設定)。依你的環境調整供應商名稱與 token 參照。

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw 使用模型解析器將邏輯模型名稱(例如 openai/gpt-5.4)對應至端點與執行時設定。新增或更新你的解析器檔(例如 models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

或透過 CLI 在執行時設定:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

注意:

context_window與max

注意事項

agents.defaults.model.primary選擇預設模型。使用channels.modelByChannel進行每通道覆寫,將高影響通道路由至 GPT-5.4,而將需求較低的通道路由至更便宜的模型。模型選擇的排序語義請參考 OpenClaw 文件。- 具體模型名稱請參考 CometAPI 的模型頁面。若希望使用 OpenAI,請將 URL 與 API 金鑰替換為 OpenAI 的。

context_window與max_output_tokens反映了 OpenClaw 解析器的前向相容調整,以避免代理仍使用過時的 Codex 限制。

2) 如何啟用並測試「記憶熱插拔」

OpenClaw 的記憶子系統由檔案(Markdown 檔)加上索引器/搜尋外掛構成,因此你可以安全地替換後端外掛(如 SQLite 向量、Milvus、或外部記憶服務)而不會丟失原始記憶檔案。

常見模式:

- 標準化記憶位置:使用 git 支援的工作空間:

~/.openclaw/workspace/,其中MEMORY.md與memory/YYYY-MM-DD.md為權威來源。 - 安裝並設定記憶外掛(例如:sqlite-vec),並在設定中將

plugins.slots.memory指向它。 - 測試遷移:新增外掛、執行影子索引任務、比較檢索結果,待滿意後將

plugins.slots.memory別名切換至新外掛。

外掛別名切換範例(bash 偽指令):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

為何稱為「熱插拔」: 記憶檔案始終是單一真實來源。外掛實作索引與檢索層;替換它們會重新索引,但不會更動底層 .md 檔。這也讓模型切換不致造成身分漂移——代理仍讀取相同的記憶。

3) 範例:將單一代理釘選至 GPT-5.4(每代理覆寫)

你可以針對每個代理覆寫模型;新增如下代理項目:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

若社群發佈或你的特定 OpenClaw 版本需要 CLI,也可在執行時設定每次工作階段的模型:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

操作提示:釘選可確保該代理在你對其他代理進行 A/B 測試時維持確定性行為。

若希望使用 OpenAI,請將 URL 與 API 金鑰替換為 OpenAI 的。

4) 使用 Codex 100 萬上下文選項(API 參數)

若你的 OpenClaw 佈署能直接存取 OpenAI Codex 端點,傳遞上下文參數如下:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

超出標準上下文視窗的請求,可能會以不同費率計費(OpenAI 文件指出,在 Codex 預覽中,超出標準視窗的請求可能會雙倍計算)。

最佳實踐:在 OpenClaw 中最大化 GPT-5.4 的優勢

成本、延遲與模型組合

- 混合模型策略:對短查詢與串流處理使用較小、較便宜的模型;當需要重度分析、摘要或長上下文的程式碼生成時再熱切換到 GPT-5.4。如此可降低整體 token 成本,同時保留品質。(可透過上述記憶設定中的觸發器實作。)

- Token 壓縮與檢索增強:使用檢索增強流程以限制送入模型的 token —— 將長文檔存於向量資料庫,檢索相關片段,僅包含最相關的區塊與精簡計畫。GPT-5.4 的工具搜尋可協助自動定位有用的工具或文檔。

- 預熱與冷啟動:模型切換後,先用短上下文的引導執行進行預熱,以避免首次請求延遲尖峰。預先編譯提示模板並重載關鍵記憶通道。OpenClaw 的滾動策略(見設定)支援預熱。

可靠性與安全

- 優雅回退:實作逾時與回退方案(例如降級為先前工作階段的快取答案)以應對 API 速率限制或配額錯誤。

- 安全層:當輸出影響決策時,保留政策過濾與驗證步驟。GPT-5.4 在統計上降低幻覺,但高風險任務仍需驗證。

評測與監控

- 重現你的基準:針對你的工作負載(程式碼補全、多檔重構、試算表分析)進行正面對比測試並採用標準量表。公開報告指出其在試算表與生產力任務上的長處——請用你的資料驗證。

- 遙測:監控 token 消耗、模型延遲、記憶切換頻率與答案品質(人工評分/自動測試)。據此微調切換門檻。

範例:支援熱插拔的程式碼審查代理

目標:在 push 時執行常規 lint + 單元測試摘要(便宜模型),若測試失敗或差異檔超過 10 個,則升級至 GPT-5.4 以產生多檔重構建議。

高層流程:

- Pre-commit 觸發執行

local/fast-small-coder產生 lint 摘要。 - 若

test_failures > 0或diff_files > 10,觸發hot_swap至openai/gpt-5.4。提升longterm_vector,包含版本庫歷史。 - 使用 GPT-5.4 的提示,將完整失敗堆疊追蹤 + 關聯程式檔拉入上下文。生成重構補丁與單元測試變更。

- 人工作審者評分輸出;回饋寫入記憶。

提示樣板(在檢索與壓縮後送至 GPT-5.4):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

此用例突顯大上下文 + 記憶熱插拔的價值:你能一次性帶入完整失敗追蹤與多個檔案。以保守方式實作切換觸發,以控制成本。

最後:誰該在何時於 OpenClaw 採用 GPT-5.4

- 立即採用:若你的代理進行多步程式碼/工具任務、重度試算表自動化、或複雜文件編輯,且迭代的「寫-跑-檢-補」週期耗時顯著。生產力與可靠性提升在此最明顯。

- 審慎採用:若你運營成本敏感的高流量聊天通道、且只需簡單推理;請使用路由策略以兼顧成本效率。

- 別假設單一模型稱王:用你的資料做基準。GPT-5.4 是代理工作負載的強力競爭者,但模型選擇應以證據為本。

開發者現在可透過 CometAPI 存取 GPT-5.4。開始之前,先在 Playground 探索模型能力,並參考 Openclaw 的整合指南以取得詳細說明。使用前請先登入 CometAPI 並取得 API 金鑰。CometAPI 提供遠低於官方的價格,協助你完成整合。

準備好了嗎?→ 立即註冊 OpenClaw!