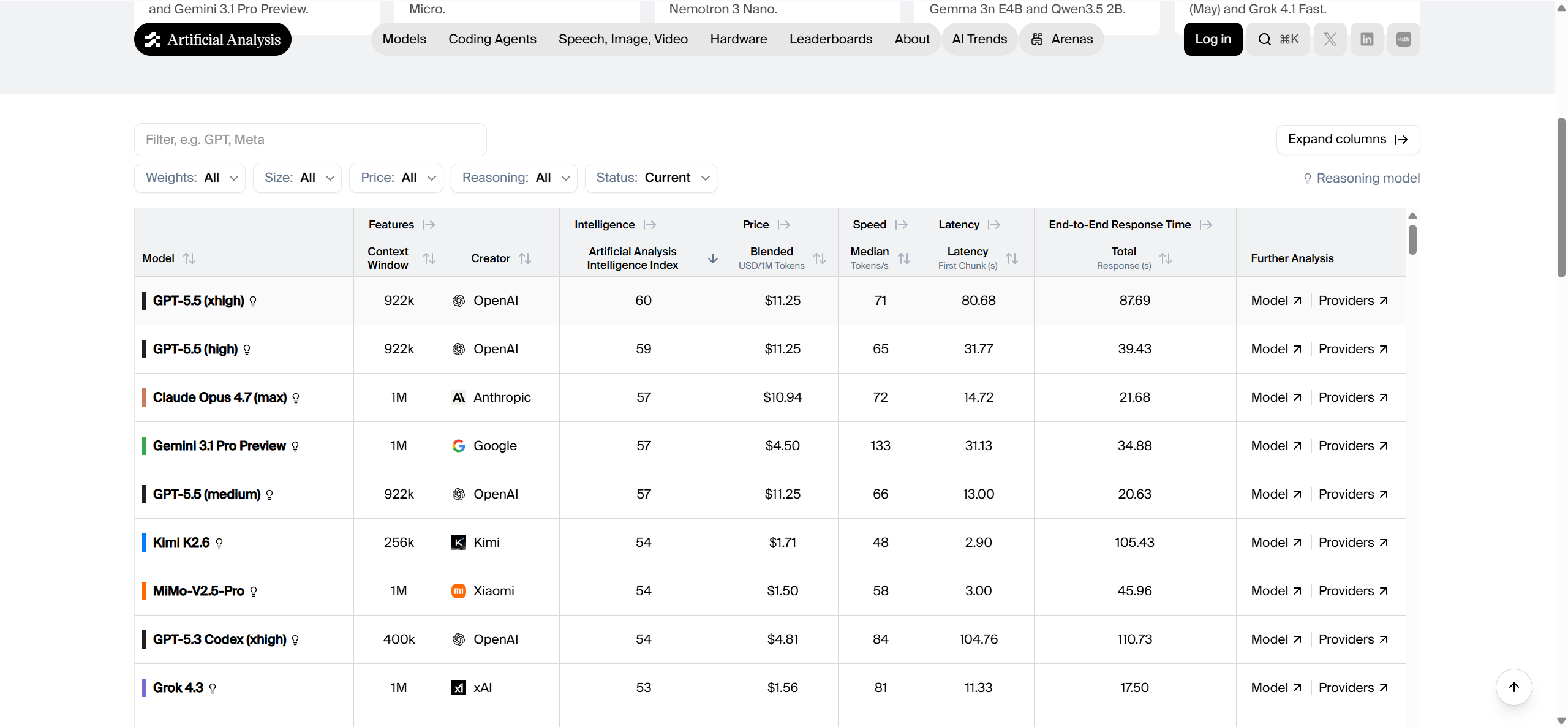

Respuesta rápida: ¿Qué modelo de IA deberían priorizar los desarrolladores en 2026?

Para tareas que requieren el máximo razonamiento autónomo y mínima alucinación, los desarrolladores deberían elegir GPT-5.5 (xhigh), que lidera el mercado con un Índice de Inteligencia de 60. Las aplicaciones que exigen interactividad en tiempo real deberían utilizar Mercury 2, el líder actual en velocidad con aproximadamente 859 tokens por segundo. Para producción a gran escala donde el presupuesto es la principal restricción, DeepSeek V4 Pro y Kimi K2.6 ofrecen inteligencia cercana a la frontera a aproximadamente el 10% del costo de los modelos propietarios insignia.

El Índice de Inteligencia: clasificación de los modelos de vanguardia

El panorama de la IA en 2026 ha pasado de perseguir el conteo de parámetros a optimizar la densidad de “pensamiento”. El Artificial Analysis Intelligence Index v4.0 funciona como el estándar de la industria para cuantificar la capacidad del modelo en diez dimensiones especializadas, incluyendo programación de nivel profesional y deducción lógica extrema.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Investigación científica y lógica |

| GPT-5.5 (high) | 59 | 922K | Programación de nivel profesional |

| Claude Opus 4.7 (max) | 57 | 1M | Agentes autónomos y planificación |

| Gemini 3.1 Pro | 57 | 1M - 2M | Síntesis multimodal de datos |

| Kimi K2.6 | 54 | 256K | Trabajo agentivo basado en terminal |

| MiMo-V2.5-Pro | 54 | 1M | Ingeniería de software full‑stack |

| DeepSeek V4 Pro (Max) | 52 | 1M | Flujos de razonamiento escalables |

| GLM-5.1 | 51 | 200K | Tareas autónomas de largo horizonte |

Cómo leer esta tabla

De los cinco primeros modelos, tres son modelos GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 y Gemini 3.1 Pro. Estos tres modelos insignia occidentales están codo con codo, mientras que Kimi K2 y mimo-v2.5 pro, dos modelos chinos, ofrecen un rendimiento comparable a los mejores modelos occidentales a precios extremadamente competitivos.

El Artificial Analysis Intelligence Index es una métrica normalizada derivada de evaluaciones independientes como Terminal-Bench Hard e IFBench. Un solo punto de diferencia representa una brecha estadísticamente significativa en el “umbral de autonomía” de un modelo. Por ejemplo, la diferencia de 3 puntos entre GPT-5.5 (60) y Claude Opus 4.7 (57) a menudo se traduce en la diferencia entre un modelo que requiere intervención humana cada pocos pasos y otro que puede completar de forma independiente una cadena lógica compleja. Un índice más alto se asocia generalmente con mayores tasas de éxito en “Humanity's Last Exam” y una reducción de errores de llamadas a herramientas en entornos agentivos.

Los reflejos: latencia y velocidad de generación

Para software interactivo —desde asistentes de IDE en vivo hasta agentes de voz de cara al cliente— la inteligencia bruta es secundaria frente al Time to First Token (TTFT) y el rendimiento de generación.

Los 5 modelos más rápidos (rendimiento)

El rendimiento mide la velocidad a la que un modelo genera texto tras la fase inicial de procesamiento. Un alto rendimiento es esencial para la generación de contenido de formato largo y la refactorización rápida de código.

- Mercury 2: Aproximadamente 859 tokens/s

- Granite 4.0 H Small: Aproximadamente 407 tokens/s

- Granite 3.3 8B: Aproximadamente 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Aproximadamente 331 tokens/s

- Qwen3.5 0.8B: Aproximadamente 287 tokens/s

Los 5 modelos de menor latencia (TTFT)

La latencia indica la demora antes de que el primer token llegue al usuario. Esta es la métrica crítica para el “vibe” y la sensación de respuesta en UI/UX.

- NVIDIA Nemotron 3 Nano: Aproximadamente 0.40s

- Ministral 3 3B: Aproximadamente 0.47s

- Qwen3.5 0.8B: Aproximadamente 0.52s

- LFM2 24B A2B: Aproximadamente 0.55s

- Grok 3 mini Reasoning: Aproximadamente 0.58s

Cómo elegir tu modelo en 2026

Seleccionar un modelo requiere equilibrar la relación “inteligencia por dólar” con los requisitos específicos de disponibilidad de tu aplicación. El mercado en 2026 se ha dividido en tres rutas arquitectónicas distintas.

Desarrolladores independientes y equipos sensibles al presupuesto

Para desarrolladores en solitario o equipos pequeños que ejecutan miles de bucles agentivos experimentales, DeepSeek V4 Pro es la elección estratégica óptima. Utiliza una arquitectura Mixture-of-Experts (MoE) masiva de 1.6T parámetros donde solo se activan 49B parámetros por token, lo que le permite ofrecer rendimiento de nivel insignia a aproximadamente $0.416 por millón de tokens. Otra excelente opción para tareas específicas de programación es Kimi K2.6, que se especializa en flujos de trabajo centrados en la terminal. Estos modelos proporcionan casi el 90% de la capacidad de razonamiento de los modelos premium mientras son aproximadamente un 70-80% más baratos, extendiendo efectivamente la pista financiera de una startup.

Entornos de producción empresariales

Para despliegues a nivel de empresa donde la estabilidad y la adhesión a prompts de sistema complejos son innegociables, el estándar de la industria sigue siendo GPT-5.5 Pro y Claude Opus 4.7. GPT-5.5 Pro está diseñado para precisión de alto riesgo, destacando en áreas como la modelización en banca de inversión y la exploración científica, donde el costo de un error supera el costo de la llamada a la API. Claude Opus 4.7 es preferido por equipos que requieren confiabilidad sostenida en proyectos de varios días, ya que muestra una tasa de alucinación significativamente menor en entornos de terminal en comparación con la familia GPT en general. Las empresas suelen usar CometAPI para integrar estos modelos a través de una única puerta de enlace, asegurando un 99.9% de tiempo de actividad y conmutación inmediata por error si un proveedor principal experimenta picos de latencia regionales.

Aplicaciones interactivas en tiempo real

Aplicaciones como bots de atención al cliente en tiempo real o subtitulado instantáneo de video requieren una IA “fluida” que se sienta instantánea. En esta categoría, Mercury 2 y Gemini 3.1 Flash-Lite son las opciones superiores. Mercury 2 ofrece un rendimiento casi diez veces más rápido que los modelos de razonamiento estándar, lo que lo hace ideal para la redacción de documentos en tiempo real. Gemini 3.1 Flash-Lite proporciona una capacidad multimodal equilibrada, procesando texto, audio e imágenes en un contexto unificado a aproximadamente 2.5x la velocidad de generaciones anteriores, a la vez que admite una ventana de contexto de 1 millón de tokens.

Ventana de contexto: de fragmentos a repositorios completos

La ventana de contexto actúa como la “memoria a corto plazo” del modelo. En 2026, la industria se ha dividido entre ventanas estándar (128K) y capacidades a escala de repositorio (1M-10M).

- Llama 4 Scout: 10,000,000 tokens

- Grok 4.20: 2,000,000 tokens

- Gemini 3.1 Pro: Aproximadamente 1,048,576 tokens

- DeepSeek V4 Pro: 1,000,000 tokens

- GPT-5.5 Pro: 1,050,000 tokens

¿Cuándo importa el tamaño del contexto?

Una ventana de contexto de 128K —estándar para modelos como DeepSeek-V3.2— es ahora la base para chat conversacional básico y el resumen de artículos individuales. Sin embargo, la ingeniería de software profesional requiere una conciencia de “todo el sistema”.

Una ventana de 1 millón de tokens permite a un agente de IA ingerir un repositorio de software completo, incluyendo todos los archivos fuente, documentación y registros históricos, en una sola pasada. Esto evita la “deriva de memoria” asociada con los sistemas RAG tradicionales donde los datos relevantes pueden perderse durante el troceado. Un ejemplo concreto es la refactorización de una base de código: un modelo con 1M de tokens puede entender cómo un cambio en un esquema de base de datos central afecta a cincuenta endpoints de API diferentes en archivos separados, mientras que un modelo más pequeño podría “ver” solo unos pocos archivos a la vez, provocando dependencias rotas.

Comparación económica: precio unitario por 1 millón de tokens

La siguiente tabla utiliza una métrica de USD combinados/1M tokens, asumiendo una proporción de 3:1 de tokens de entrada a salida para reflejar patrones de uso del mundo real.

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Approximately $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Approximately $10.00 | High | 20% OFF |

| Gemini 3.1 Pro | Approximately $4.50 | Balanced | 20% OFF |

| Kimi K2.6 | Approximately $1.71 | High-Value | 20% OFF |

| DeepSeek V4 Pro | Approximately $0.53 | Extreme-Value | 20% OFF |

| Qwen3.5 0.8B | Approximately $0.02 | Utility | 20% OFF |

Todas las tarifas verificadas en mayo de 2026. Las tarifas oficiales de los proveedores suelen ser un 20% más altas que las tarifas con descuento ofrecidas a través de puertas de enlace unificadas.

Estrategia de optimización de costos

Para ayudar en la planificación arquitectónica, hemos estimado los gastos mensuales para tres niveles de crecimiento comunes.

- Equipo de desarrolladores pequeño (10M tokens/mes): Los equipos que principalmente usan Kimi K2.6 para creación de funcionalidades y DeepSeek V4 Flash para lógica simple verán un gasto mensual en el rango de $15 a $40. Esto permite un prototipado agresivo con una carga financiera no mayor que la de una suscripción SaaS estándar.

- SaaS mediano (100M tokens/mes): Una startup que escale una plataforma de automatización impulsada por IA usando Claude Sonnet 4.6 y Gemini 3.1 Flash puede esperar costos mensuales entre $250 y $550. Al utilizar el almacenamiento en caché de prompts disponible en estos modelos, el costo efectivo a menudo cae un 15% adicional.

- Gran empresa (1B tokens/mes): Firmas globales que ejecutan flujos de trabajo agentivos de alta concurrencia con GPT-5.5 y Claude Opus 4.7 probablemente gastarán entre $3,000 y $6,500 mensuales. A esta escala, integrarse a través de una puerta de enlace API unificada se vuelve esencial para la facturación centralizada y evitar la sobrecarga de gestionar contratos separados con múltiples proveedores.

Conclusión: elige tu camino en 2026

La era del “modelo para todo” ha terminado. La arquitectura moderna de IA requiere orquestar una flota de modelos especializados: GPT-5.5 para razonamiento de alto cómputo, Mercury 2 para interactividad y DeepSeek V4 para ejecución de alto volumen. Al integrarte una sola vez con CometAPI, los desarrolladores obtienen la portabilidad para intercambiar modelos a medida que evolucionan los benchmarks mientras aseguran un descuento permanente del 20-40% en cada solicitud.

Preguntas frecuentes

¿Cuál es actualmente el modelo más inteligente?

Según el Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) es el modelo más inteligente disponible, con una puntuación de 60. Le siguen de cerca GPT-5.5 (high) con 59 y Claude Opus 4.7 (max) con 57.

¿Cuál es el modelo de IA más rápido para aplicaciones en tiempo real?

Mercury 2 es el campeón de velocidad de 2026, entregando aproximadamente 859.1 tokens por segundo. Para baja latencia (TTFT), NVIDIA Nemotron 3 Nano lidera con un tiempo de respuesta de aproximadamente 0.40 segundos.

¿Qué tan alto debe ser un puntaje del Índice de Inteligencia para agentes en producción?

Para automatización básica o clasificación, un puntaje entre 30 y 40 (como GPT-5.4 nano) suele ser suficiente. Sin embargo, para “Ingeniería agentiva” donde la IA gestiona bases de código o sesiones de navegador completas, se recomienda un puntaje por encima de 54 (como Kimi K2.6 o GPT-5.5) para garantizar la consistencia en la planificación de largo horizonte.

Con un precio similar, ¿debería elegir GPT-5.5 o Claude Opus 4.7?

Si tu flujo de trabajo implica ejecución en terminal y “Vibe Coding”, GPT-5.5 generalmente sobresale en esos benchmarks específicos. Sin embargo, si requieres consistencia extrema para redacción profesional, investigación legal o ciclos agentivos de varios días con bajas tasas de alucinación, Claude Opus 4.7 es el líder documentado en esas categorías.

¿Cuál es la brecha de rendimiento real entre los modelos de pesos abiertos (DeepSeek) y los propietarios?

En 2026, la brecha se ha reducido aproximadamente al 10-15% en benchmarks de razonamiento bruto. Aunque los insignia propietarios como GPT-5.5 (xhigh) siguen liderando en lógica “peak” (Índice 60), los modelos de pesos abiertos como DeepSeek V4 Pro (Índice 52) y Kimi K2.6 (Índice 54) aportan más del 85% de la capacidad a aproximadamente 1/10 del costo.

¿Cómo puedo reducir mis costos generales de API para estos modelos?

Usar una capa de API unificada como CometAPI te permite acceder a todo el catálogo a tarifas 20% a 40% más bajas que los precios oficiales de los proveedores mediante compras al por mayor y enrutamiento inteligente de rutas.

¿Qué modelo tiene la ventana de contexto más grande para documentos largos?

Llama 4 Scout actualmente admite la ventana de contexto más grande del mercado con 10 millones de tokens. Grok 4.20 le sigue con 2 millones de tokens, mientras que GPT-5.5 Pro, Gemini 3.1 Pro y DeepSeek V4 Pro admiten aproximadamente 1 millón de tokens.

¿Hay alguna forma de probar estos benchmarks sin un alto costo inicial?

Sí. Puedes registrarte para obtener una cuenta gratuita en CometAPI para recibir créditos de prueba sin necesidad de tarjeta de crédito, lo que te permite ejecutar pruebas comparativas de rendimiento en más de 500 modelos en el Playground incorporado.