快速回答:开发者在 2026 年应优先选择哪种 AI 模型?

对于需要最高自主推理能力和最低幻觉率的任务,开发者应选择 GPT-5.5 (xhigh),它以 60 的 Intelligence Index 领跑市场。需要实时交互的应用应采用 Mercury 2,它是当前速度领先者,吞吐量约为每秒 859 个 token。对于预算是主要约束的大规模生产环境,DeepSeek V4 Pro 和 Kimi K2.6 以大约旗舰专有模型 10% 的成本,提供接近前沿水平的智能能力。

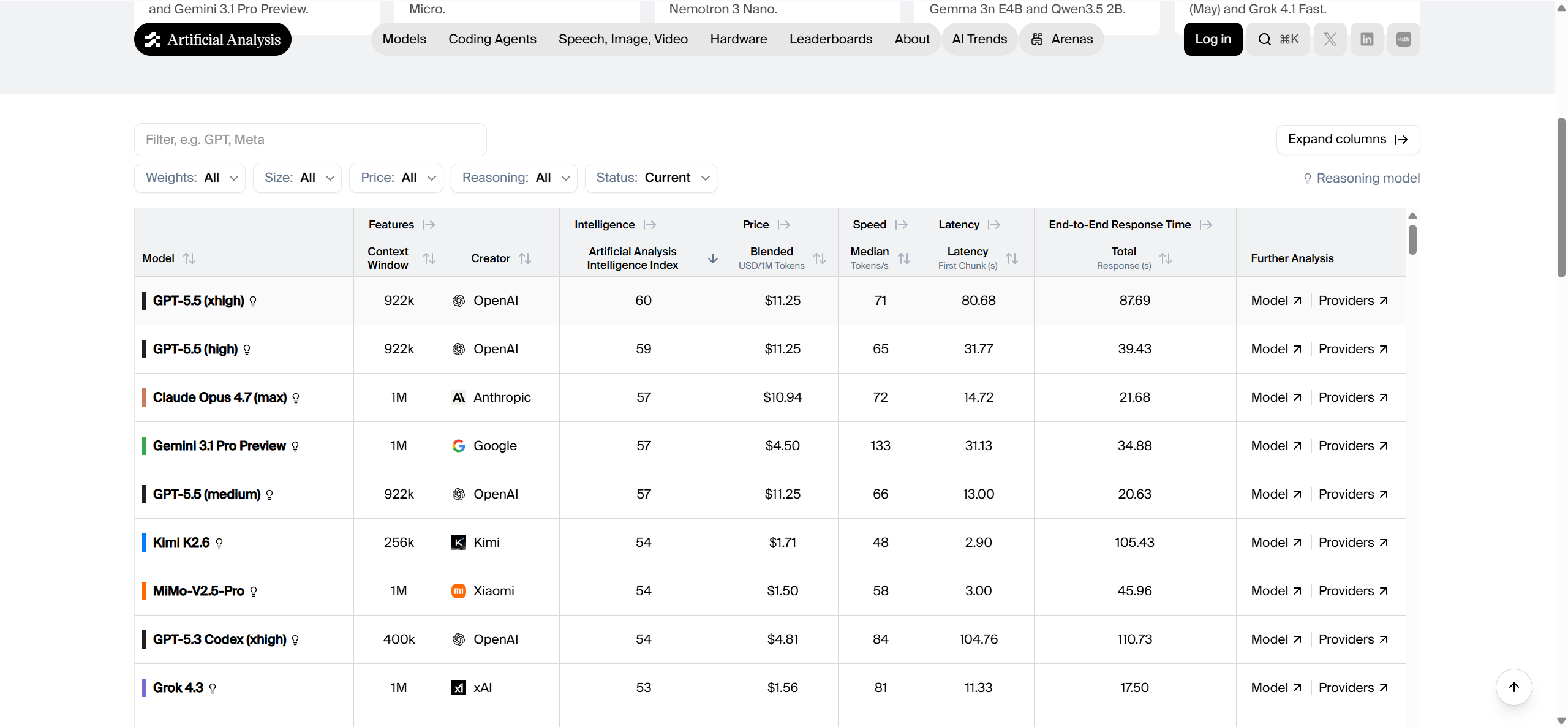

Intelligence Index:前沿模型排名

2026 年的 AI 格局已从追逐参数规模转向优化“思考”密度。Artificial Analysis Intelligence Index v4.0 已成为衡量模型能力的行业标准,覆盖十个专门维度,包括专业级编码和极限逻辑推理。

| 模型 | Intelligence Index | Context Window | 最佳使用场景 |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | 科学研究与逻辑推理 |

| GPT-5.5 (high) | 59 | 922K | 专业级编码 |

| Claude Opus 4.7 (max) | 57 | 1M | 自主代理与规划 |

| Gemini 3.1 Pro | 57 | 1M - 2M | 多模态数据综合 |

| Kimi K2.6 | 54 | 256K | 基于终端的代理式工作 |

| MiMo-V2.5-Pro | 54 | 1M | 全栈软件工程 |

| DeepSeek V4 Pro (Max) | 52 | 1M | 可扩展推理工作流 |

| GLM-5.1 | 51 | 200K | 长周期自主任务 |

如何阅读此表

在排名前五的模型中,有三款是 GPT-5.5 模型,分别是 GPT-5.5 Medium、Claude Opus 4.7 和 Gemini 3.1 Pro。这三款西方旗舰模型势均力敌,而 Kimi K2 和 mimo-v2.5 pro 这两款中国模型,则以极具竞争力的价格提供了可与顶级西方模型相媲美的性能。

Artificial Analysis Intelligence Index 是一个标准化指标,源自 Terminal-Bench Hard 和 IFBench 等独立评测。每 1 分的差距都代表模型“自主性阈值”的统计显著差异。例如,GPT-5.5(60)与 Claude Opus 4.7(57)之间的 3 分差距,通常意味着一个模型每隔几步就需要人工介入,而另一个则可以独立完成复杂的逻辑链。更高的指数分数通常与在 “Humanity's Last Exam” 中更高的成功率,以及在代理式环境中更少的工具调用错误相关。

Reflexes:延迟与生成速度

对于交互式软件——从实时 IDE 助手到面向客户的语音代理——原始智能次于 Time to First Token (TTFT) 和 Generation Throughput。

速度最快的前 5 个模型(throughput)

Throughput 衡量的是模型在初始处理阶段之后生成文本的速度。高吞吐量对于长篇内容生成和快速代码重构至关重要。

- Mercury 2:约 859 tokens/s

- Granite 4.0 H Small:约 407 tokens/s

- Granite 3.3 8B:约 365 tokens/s

- Gemini 3.1 Flash-Lite**** :约 331 tokens/s

- Qwen3.5 0.8B:约 287 tokens/s

低延迟最低的前 5 个模型(TTFT)

Latency 表示首个 token 到达用户之前的延迟。这是决定 UI/UX 中“vibe”和感知响应速度的关键指标。

- NVIDIA Nemotron 3 Nano:约 0.40s

- Ministral 3 3B:约 0.47s

- Qwen3.5 0.8B:约 0.52s

- LFM2 24B A2B:约 0.55s

- Grok 3 mini Reasoning:约 0.58s

2026 年如何选择你的模型

选择模型需要在“每美元智能”比率与应用的具体正常运行时间要求之间取得平衡。2026 年的市场已分化为三条截然不同的架构路径。

独立开发者与预算敏感型团队

对于运行成千上万个实验性 agent loop 的独立开发者或小团队,DeepSeek V4 Pro 是最优的战略选择。它采用了规模巨大的 1.6T 参数 Mixture-of-Experts (MoE) 架构,每个 token 仅激活 49B 参数,从而能够以约 $0.416/百万 tokens 的价格提供旗舰级表现。另一个适合特定编码任务的优秀选择是 Kimi K2.6,它专注于 terminal-first 工作流。这些模型以大约高端模型 70-80% 的低成本,提供了接近 90% 的推理能力,实际上可延长初创公司的 runway。

企业生产环境

对于企业范围部署、且稳定性与对复杂系统提示词的遵循是不可妥协的场景,行业标准仍然是 GPT-5.5 Pro 和 Claude Opus 4.7。GPT-5.5 Pro 面向高风险精度场景而设计,在投资银行建模和科学探索等领域表现出色,在这些场景中,错误的代价高于 API 调用的成本。Claude Opus 4.7 更受需要在多日项目中保持稳定可靠性的团队青睐,因为与更广泛的 GPT 家族相比,它在 terminal 环境中的幻觉率明显更低。企业通常使用 CometAPI 通过单一网关集成这些模型,从而确保 99.9% 的正常运行时间,并在主提供商出现区域性延迟峰值时实现即时故障转移。

实时交互式应用

实时客户支持机器人或即时视频字幕生成等应用需要感觉“即时”的流畅 AI。在这一类别中,Mercury 2 和 Gemini 3.1 Flash-Lite 是更优选择。Mercury 2 的吞吐量几乎是标准推理模型的十倍,非常适合实时文档起草。Gemini 3.1 Flash-Lite 提供平衡的多模态能力,可在统一上下文中处理文本、音频和图像,速度约为前几代的 2.5 倍,同时支持 100 万 token 的上下文窗口。

Context Window:从片段到整个代码库

上下文窗口充当模型的“短期记忆”。在 2026 年,行业已分化为标准窗口(128K)和仓库级容量(1M-10M)。

- Llama 4 Scout:10,000,000 tokens

- Grok 4.20:2,000,000 tokens

- Gemini 3.1 Pro:约 1,048,576 tokens

- DeepSeek V4 Pro:1,000,000 tokens

- GPT-5.5 Pro:1,050,000 tokens

什么时候上下文大小很重要?

对于像 DeepSeek-V3.2 这样的模型,128K 上下文窗口如今已成为基础对话聊天和单篇文章摘要的基线。然而,专业软件工程需要“全系统”感知。

100 万 token 窗口使 AI agent 能够在一次前向传递中摄取整个软件仓库,包括所有源文件、文档和历史日志。这避免了传统 RAG 系统中与“记忆漂移”相关的问题,即相关数据可能在分块过程中被遗漏。一个具体例子是代码库重构:拥有 1M tokens 的模型可以理解核心数据库 schema 的变更如何影响分散在不同文件中的五十个 API 端点,而较小的模型可能一次只能“看到”少量文件,从而导致依赖关系断裂。

经济比较:每 100 万 tokens 的单价

下表使用 Blended USD/1M Tokens 指标,并假设输入与输出 token 的比例为 3:1,以反映真实使用模式。

| 模型 | Blended Price (per 1M) | 相对价值 | 通过 CometAPI 的折扣 |

|---|---|---|---|

| GPT-5.5 (xhigh) | 约 $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | 约 $10.00 | High | 20% OFF |

| Gemini 3.1 Pro | 约 $4.50 | Balanced | 20% OFF |

| Kimi K2.6 | 约 $1.71 | High-Value | 20% OFF |

| DeepSeek V4 Pro | 约 $0.53 | Extreme-Value | 20% OFF |

| Qwen3.5 0.8B | 约 $0.02 | Utility | 20% OFF |

所有费率截至 2026 年 5 月已验证。官方供应商费率通常比通过统一网关提供的 折扣费率 高 20%。

成本优化策略

为协助架构规划,我们估算了三种常见增长层级的月度支出。

- 小型开发团队(每月 10M tokens):主要使用 Kimi K2.6 进行功能构建、并使用 DeepSeek V4 Flash 处理简单逻辑的团队,每月支出预计在 $15 到 $40 之间。这使得激进原型开发的财务负担不超过标准 SaaS 订阅。

- 中型 SaaS(每月 100M tokens):使用 Claude Sonnet 4.6 和 Gemini 3.1 Flash 构建 AI 驱动自动化平台的初创公司,月成本预计在 $250 到 $550 之间。通过利用这些模型提供的 prompt caching,实际成本通常还能再降低 15%。

- 大型企业(每月 1B tokens):使用 GPT-5.5 和 Claude Opus 4.7 运行高并发 agentic 工作流的全球企业,每月很可能支出在 $3,000 到 $6,500 之间。在这一规模下,通过统一 API gateway 集成对于集中计费以及避免管理多个供应商独立合同所带来的开销至关重要。

结论:在 2026 年选择你的路径

“通用型模型”的时代已经结束。现代 AI 架构需要协调一组专用模型:用于高计算推理的 GPT-5.5、用于交互性的 Mercury 2,以及用于高吞吐执行的 DeepSeek V4。通过一次性接入 CometAPI,开发者可以在基准演进时灵活切换模型,同时确保每次请求永久享有 20-40% 的折扣。

FAQ

哪个 AI 模型目前最智能?

根据 Artificial Analysis Intelligence Index v4.0,GPT-5.5 (xhigh) 是目前可用的最智能模型,得分为 60。紧随其后的是得分 59 的 GPT-5.5 (high) 和得分 57 的 Claude Opus 4.7 (max)。

哪个 AI 模型最适合实时应用?

Mercury 2 是 2026 年的速度冠军,吞吐量约为每秒 859.1 个 token。对于低延迟(TTFT),NVIDIA Nemotron 3 Nano 以约 0.40 秒的响应时间领先。

生产级 agent 的 Intelligence Index 分数需要多高?

对于基础自动化或分类,30 到 40 之间的分数(如 GPT-5.4 nano)通常已经足够。然而,对于 AI 管理代码库或完整浏览器会话的“Agentic Engineering”,建议分数高于 54(例如 Kimi K2.6 或 GPT-5.5),以确保长周期规划中的一致性。

在价格相近的情况下,我应该选择 GPT-5.5 还是 Claude Opus 4.7?

如果你的工作流涉及终端执行和 “Vibe Coding”,GPT-5.5 通常在这些特定基准上表现更好。不过,如果你需要在专业写作、法律研究或低幻觉率的多日 agent 周期中保持极高一致性,Claude Opus 4.7 是这些类别中的公认领先者。

开源权重模型(DeepSeek)与专有模型之间的实际性能差距有多大?

到 2026 年,这一差距在原始推理基准上已缩小到约 10-15%。虽然像 GPT-5.5 (xhigh) 这样的专有旗舰机型在“峰值”逻辑上仍然领先(Index 60),但像 DeepSeek V4 Pro(Index 52)和 Kimi K2.6(Index 54)这样的开源权重模型,以大约 1/10 的成本提供了超过 85% 的能力。

我如何降低这些模型的总体 API 成本?

使用像 CometAPI 这样的统一 API 层,可以通过批量采购和智能路径路由,以比官方供应商定价低 20% 到 40% 的费率访问整个目录。

哪个模型拥有用于长文档的最大上下文窗口?

Llama 4 Scout 目前支持市场上最大的上下文窗口,达到 1000 万 tokens。Grok 4.20 以 200 万 tokens 紧随其后,而 GPT-5.5 Pro、Gemini 3.1 Pro 和 DeepSeek V4 Pro 都支持约 100 万 tokens。

是否有办法在不产生高额初始成本的情况下测试这些基准?

有。你可以在 CometAPI 注册免费账户,获取无需信用卡的测试额度,从而在内置 Playground 中对 500 多个模型进行对比性能测试。