Tilgang til toppmodeller til lav kostnad

500+ modeller i ett API, opptil 20% rabatt

Integrer én gang og bytt motorer uten anstrengelse. Gir en out-of-the-box SDK, interaktivt Playground, Postman-samling og eksempelprosjekter. Innebygd sammenlignende testing, responsvisualisering og bruksanalyse lar ingeniører lage prototyper på timer og velge den optimale modellkombinasjonen gjennom sammenligning.

AI Bildegenererings-API'er

Lag fantastiske, merkevennlige bilder umiddelbart med Nano Banana Pro, GPT-4O Image og Flux 2 API. Kontroller belysning, tekstur og gjentakbar karakterdesign på tvers av alle stilarter—fra fotorealistiske renders til stiliserte illustrasjoner. Design og ingeniørfag leverer polerte visuelle effekter uten omskrivninger eller leverandørbytte.

AI Videogenererings-API'er

Tilbyr fleksible kombinasjoner av Sora 2, Veo 3.1 og Kling 2.5. Sora 2 er egnet for detaljerte scener og audiovisuelle synkronisering, Veo 3.1 utmerker seg i visuell realisme og bevegelseskontinuitet, og Kling AI understreker en balanse mellom hastighet og kostnad—velg den optimale renderingsstrategien basert på prosjektbehov.

AI Musikkgenererings-API'er

Generer raskt lydspor, fullstendige spor og uttrykksfulle lydeffekter gjennom våre enhetlige musikkmodell-API-er. Støtter flersegment komposisjon, temavariasjoner og royalty-fritt output — tilpasningsdyktig til spill, reklame og diverse applikasjonsscenarier. Forkort audition- og iterasjonssykluser, og gjør lyd like kontrollerbar og reproduserbar som kode.

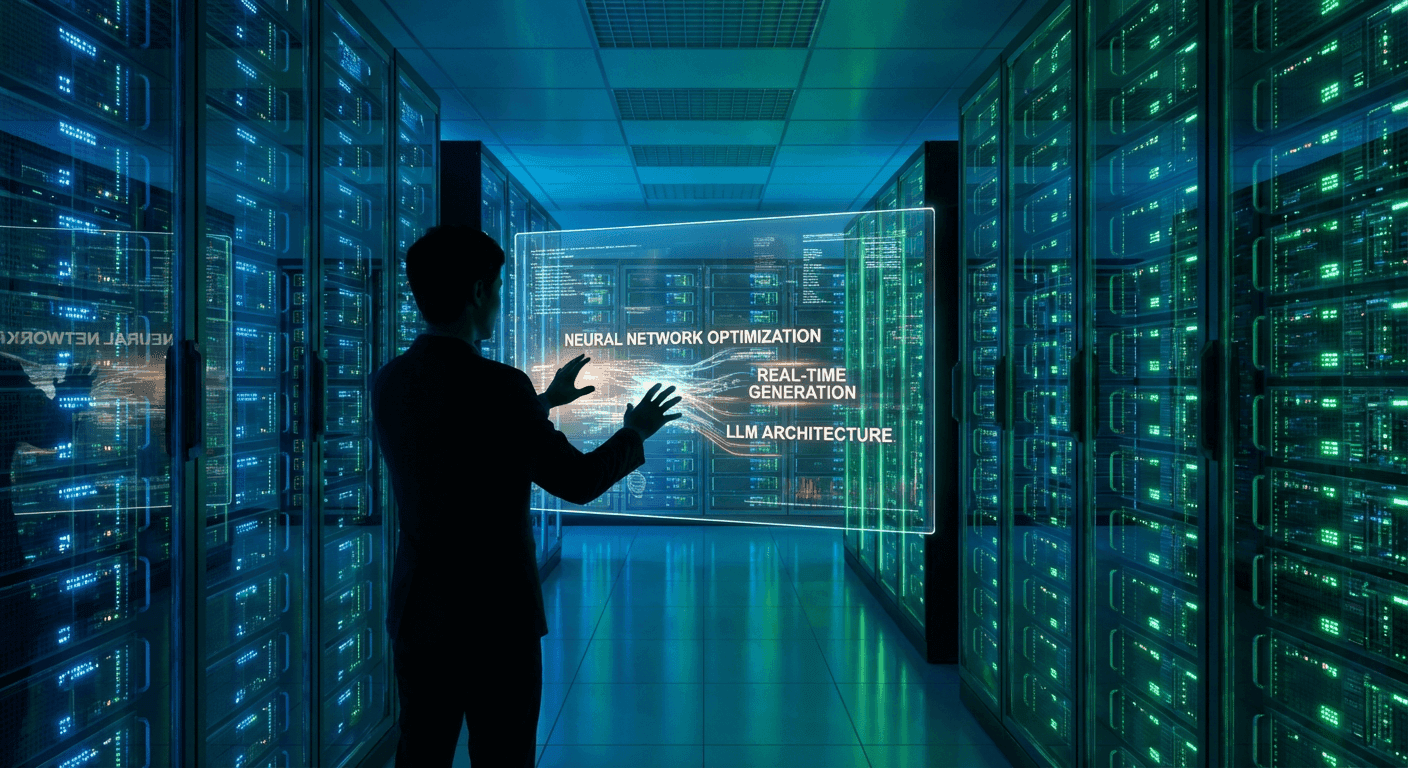

LLM & AI Chat-API'er

Driv søk, chat og resonnement med de nyeste LLM'ene som er Claude 4.5, GPT 5.1 og Gemini 3 Pro. Hver modell balanserer latens, kostnad og sikkerhet for å matche brukssaken din—fra lav-latens assistenter til dyp retrieval-forsterket resonnement.

Oppdag modeller fra OpenAI, Anthropic, Google, Aliyun, xAI, Deepseek og flere. Hver leverandørgruppe har unike styrker — fra avansert resonnement og kodegenerering til multimodal forståelse og sanntidsinferens. Finn riktig modell for prosjektet ditt.

Enkel integrasjon

Koble CometAPI til stacken din på minutter — lette SDK'er, tydelig dokumentasjon og eksempelkode for å få ditt første API-kall til å fungere raskt.

Dokumentasjonsstøtte

1:1 Menneskelig Støtte

Ytelses- og Kostnadsjustering

Utforsk våre mest populære modeller, betrodd av utviklere for ytelse, pålitelighet og enkel integrasjon i virkelige applikasjoner.

Funksjoner

Hvorfor velge CometAPI for dine AI-integrasjonsbehov

Bruksanalyse

Detaljert innsikt i API-bruksmønstre og ytelsesmålinger.Betal etter bruk

Fleksibel prismodell som skalerer med din bruk og budsjett.Personvern

Sikkerhet og personvernbeskyttelse av bedriftsklasse for dine data.Hva brukerne våre sier

Hør fra utviklere og team som stoler på CometAPI — ekte tilbakemeldinger om pålitelighet, integrasjonsenkelhet, ytelse og støtte.

FAQ

Finn konsise svar på vanlige spørsmål om CometAPI — fra API-dokumentasjon og autentisering til prising, integreringstrinn og feilsøkingstips.